Примечание.

Для доступа к этой странице требуется авторизация. Вы можете попробовать войти или изменить каталоги.

Для доступа к этой странице требуется авторизация. Вы можете попробовать изменить каталоги.

Microsoft Fabric — это единое решение для аналитики для предприятий, охватывающих все, от перемещения данных до обработки и анализа данных, аналитики в режиме реального времени и бизнес-аналитики. Он предлагает полный набор услуг, включая озеро данных, обработку данных и интеграцию данных, всё в одном месте. Дополнительные сведения см. в статье "Что такое Microsoft Fabric?"

В этом учебном пособии вас проводят через сценарий от начала до конца: от получения данных и до их потребления. Это поможет вам создать базовое представление о Fabric, включая различные интерфейсы и их интеграцию, а также профессиональный и гражданский опыт разработчиков, которые приходят с работой на этой платформе. Это руководство не предназначено для использования в качестве эталонной архитектуры, исчерпывающего списка функций и функциональных возможностей или рекомендаций по конкретным передовым практикам.

Комплексный сценарий Lakehouse

Традиционно организации строят современные хранилища данных для своих транзакционных и структурированных потребностей в аналитике данных. И озера данных для аналитики больших данных (полуструктурированных) данных. Эти две системы работали параллельно, создавая силосы, дублирование данных и увеличивая общую стоимость владения.

Структура с объединением хранилища данных и стандартизации в формате Delta Lake позволяет исключить силосы, удалить дублирование данных и резко сократить общую стоимость владения.

Благодаря гибкости, предоставляемой платформой Fabric, вы можете реализовать архитектуры озеро-хранилища или склад данных, или объединить их, чтобы извлечь лучшее из обоих подходов при простой реализации. В этом руководстве вы собираетесь взять пример розничной организации и создать его lakehouse с начала до конца. В нем используется архитектура медальона, в которой бронзовый слой содержит необработанные данные, серебряный слой имеет проверенные и дедупликированные данные, а золотой слой имеет высокоуровневые данные. Вы можете использовать тот же подход для внедрения lakehouse в любой организации, независимо от отрасли.

В этом руководстве объясняется, как разработчик в вымышленной компании Wide World Importers из розничного домена выполняет следующие действия:

Войдите в свою учетную запись Power BI и зарегистрируйтесь на бесплатную пробную версию Microsoft Fabric. Если у вас нет лицензии Power BI, зарегистрируйтесь на бесплатную лицензию Fabric, чтобы затем запустить пробную версию Fabric.

Создайте и реализуйте комплексный lakehouse для вашей организации:

- Создайте рабочую область Fabric.

- Создайте лейкхаус.

- Прием данных, преобразование данных и его загрузка в lakehouse. Вы также можете изучить OneLake, одну копию ваших данных в режиме озеро-хранилища и режиме конечной точки аналитической обработки SQL.

- Подключитесь к вашему Lakehouse с помощью аналитической конечной точки SQL и создайте семантическую модель и отчет для анализа данных о продажах по различным измерениям.

- При необходимости можно организовать и запланировать прием и преобразование данных с помощью pipeline. Конвейеры данных включают действия, ориентированные на Lakehouse, такие как действие "Обслуживание Lakehouse" (для автоматизации обслуживания таблицы Delta с помощью OPTIMIZE и VACUUM) и действие "Обновление конечной точки SQL" (для синхронизации конечной точки аналитики SQL после загрузки данных). Построитель выражений конвейера также включает помощь Copilot для более быстрого, более точного создания выражений. Дополнительные сведения см. в разделе "Действия по обслуживанию Lakehouse".

Очистка ресурсов путем удаления рабочей области и других элементов.

Архитектура

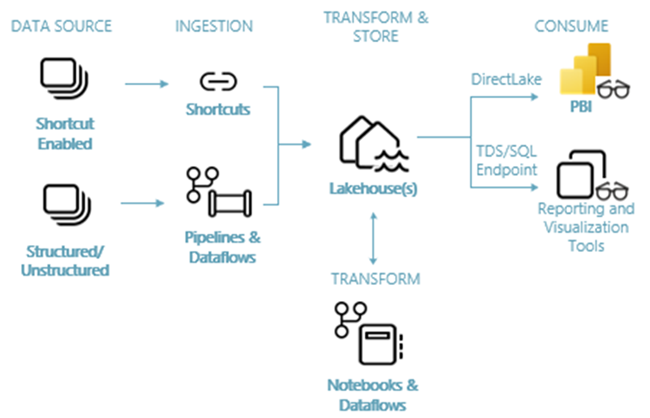

На следующем рисунке показана сквозная архитектура Lakehouse. Компоненты, участвующие в этом разделе, описаны в следующем списке.

Источники данных: Структура позволяет быстро и легко подключаться к службам данных Azure, а также другим облачным платформам и локальным источникам данных для упрощения приема данных.

Интеграция: Вы можете быстро создавать аналитическую информацию для вашей организации с помощью более чем 200 встроенных коннекторов. Эти соединители интегрируются в канал Fabric и используют удобное для пользователя преобразование данных методом перетаскивания с потоком данных. Кроме того, с помощью функции ярлыка в Fabric можно подключиться к существующим данным, не скопировав или переместив ее. Сочетания клавиш OneLake также могут ссылаться на продукты данных между клиентами через общий доступ к внешним данным OneLake, предоставляя доступ к динамическим, управляемым операционным данным без копирования или создания конвейеров ETL. Структура также включает высокопроизводительные векторные средства чтения файлов для распространенных форматов, таких как CSV-файл (с поддержкой JSON) для уменьшения задержки приема.

Преобразование и хранение: Структура стандартизирует формат Delta Lake. Это означает, что все подсистемы Fabric могут получать доступ к одному и тому же набору данных, хранящимся в OneLake, без дублирования данных. Единая модель управления OneLake гарантирует, что доступ к данным с помощью сочетаний клавиш входит в те же политики безопасности и соответствия требованиям, что и локальные хранимые данные, предоставляя единую версию истины в организации. Эта система хранения обеспечивает гибкость для создания lakehouse с использованием архитектуры медальона или модели данных, в зависимости от требований вашей организации. Вы можете выбрать один из низкокодовых или безкодовых интерфейсов для преобразования данных, используя конвейеры, потоки данных или записную книжку или Spark для взаимодействия с кодом. Таблицы Lakehouse также поддерживают оптимизацию производительности, такие как Z-упорядочение и кластеризация Liquid, чтобы повысить производительность запросов и эффективно управлять макетом данных в масштабе. Кроме того, представления Materialized Lake доступны для предварительной компиляции и кэширования результатов по данным lakehouse, что ускоряет повторную аналитику. Операции могут включать автоматическое обслуживание таблиц Lakehouse Delta с помощью действия обслуживания Lakehouse в конвейерах и активации обновления конечной точки аналитики SQL в рамках шагов после загрузки. Дополнительные сведения см. в описании дополнительного шага оркестрации конвейеров в приведенном выше обзоре сценария.

Использование: Power BI может использовать данные из Lakehouse для создания отчетов и визуализации. Каждый Lakehouse имеет встроенную конечную точку TDS, конечную точку аналитики SQL для простого подключения и запроса данных в таблицах Lakehouse из других средств отчетности. Оркестрация потоков может включать шаг для обновления конечной точки аналитики SQL Lakehouse, чтобы убедиться, что схема и метаданные актуальны для инструментов отчетности после загрузки данных, см. необязательный шаг оркестрации потока в описании сценария выше для подробностей.

Благодаря совместному использованию данных между клиентами, отчетам, семантических моделях и рабочим нагрузкам искусственного интеллекта и обработки и анализа данных также можно использовать общие данные OneLake в пределах организации, что обеспечивает совместную работу без дублирования данных.

Пример набора данных

В этом руководстве используется пример базы данных WWI, импортируемой в lakehouse в следующем руководстве. Для комплексного сценария Lakehouse набор данных содержит достаточные данные для изучения возможностей масштабирования и производительности платформы Fabric.

Wide World Importers (WWI) является оптовым импортером и дистрибьютором новинок, работающим из района залива Сан-Франциско. Клиенты WWI, как оптового продавца, в основном включают компании, которые перепродают частным лицам. WWI продает розничным клиентам по всей территории США, включая специализированные магазины, супермаркеты, компьютерные магазины, магазины при туристических достопримечательностях и некоторых индивидуальных покупателей. WWI также продает другим оптовикам через сеть агентов, которые продвигают продукцию от имени WWI. Дополнительные сведения о профиле и работе компании см. в примерах баз данных Wide World Importers для Microsoft SQL.

Как правило, данные из транзакционных систем или корпоративных приложений переносятся в lakehouse. Однако для простоты в этом руководстве используется модель измерения, предоставляемая WWI в качестве исходного источника данных. Вы загружаете данные в lakehouse и преобразуете их через различные этапы (Бронза, Серебро, Золото) медальной архитектуры.

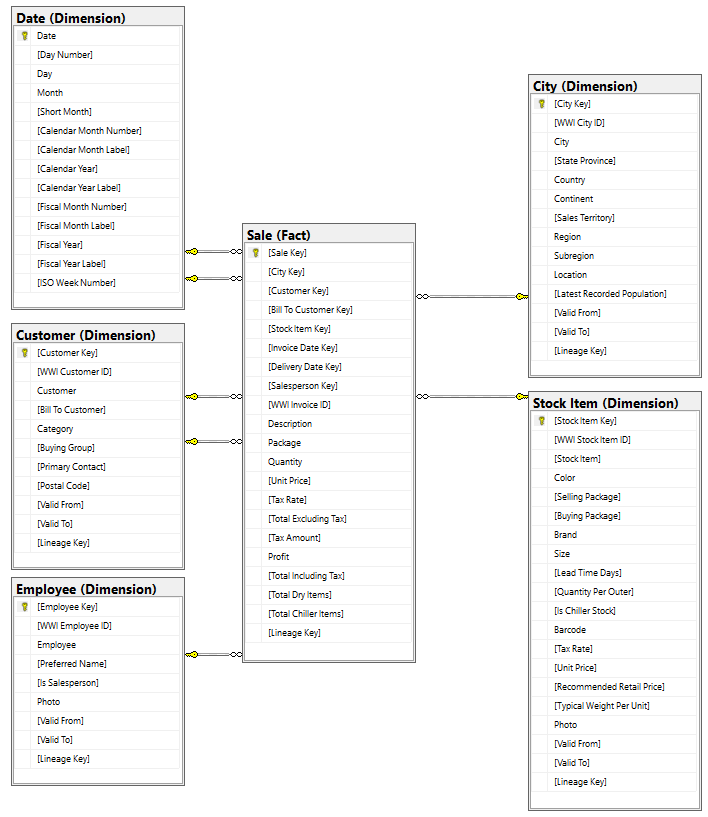

Модель данных

В то время как измерительная модель WWI содержит многочисленные таблицы фактов, в этом руководстве используется таблица фактов Продаж и ее связанные измерения. В следующем примере показана модель данных WWI:

Поток данных и преобразования

Как описано ранее, в этом руководстве используются примеры данных из примера данных WWI для создания комплексного озера. В этой реализации образец данных хранится в учетной записи хранения данных Azure в формате файла Parquet для всех таблиц. Однако в реальных сценариях данные обычно исходят из различных источников и в различных форматах.

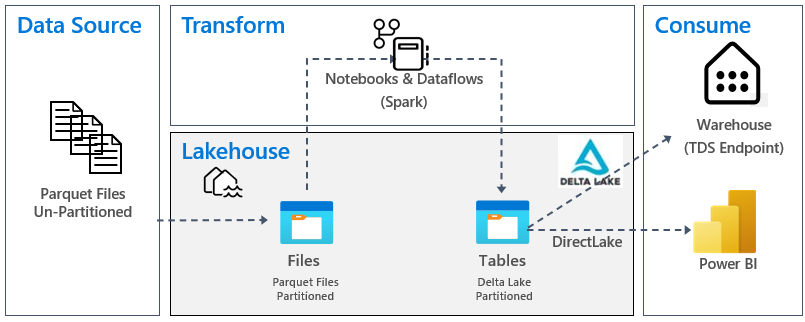

На следующем рисунке показано преобразование источника, назначения и данных:

Источник данных: исходные данные отображаются в формате файла Parquet и в непараментируемой структуре. Он хранится в папке для каждой таблицы. В этом руководстве вы настраиваете конвейер для приема всех полных исторических или однократных данных в лейкхаус.

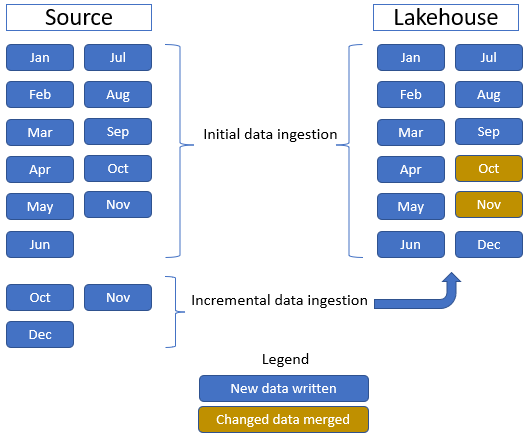

В этом руководстве вы используете таблицу фактов Sale, которая содержится в одной родительской папке с историческими данными на протяжении 11 месяцев (по одной вложенной папке для каждого месяца) и другой папке с добавочными данными на протяжении трех месяцев (одна вложенная папка для каждого месяца). Во время начальной загрузки данных 11 месяцев данных загружаются в таблицу Lakehouse. При поступлении добавочных данных обновленные данные октября и ноября объединяются с существующими данными, а новые декабрьские данные записываются в таблицу Lakehouse, как показано на следующем рисунке:

Lakehouse. В этом руководстве вы создадите хранилище данных, загрузите данные в раздел файлов хранилища, а затем создадите таблицы Delta Lake в разделе "Таблицы" хранилища данных.

Преобразование. Для подготовки и преобразования данных в этом руководстве рассматриваются два различных подхода: записные книжки и Spark для взаимодействия с кодом, а также конвейеры и потоки данных для работы с низким кодом или без кода. Последняя среда выполнения Fabric включает в себя собственный исполнительный механизм, обеспечивающий значительные улучшения производительности по сравнению с открытым исходным кодом Spark для записных книжек и задач Spark. Построитель выражений конвейера включает в себя помощь Copilot, упрощая написание выражений и создание логики конвейера для более быстрой и точной генерации выражений.

Использование: Power BI может использовать данные из lakehouse для создания отчетов и визуализации. Каждый lakehouse имеет встроенную конечную точку TDS, называемую конечной точкой аналитики SQL для простого подключения и запроса данных в таблицах Lakehouse из других средств отчетности. Вы также можете использовать Direct Lake поверх OneLake, чтобы Power BI напрямую запрашивал таблицы в хранилище без импорта или выделенного цикла обновления семантической модели. Кроме того, вы можете сделать данные доступными для средств отчетов, отличных от Майкрософт, с помощью конечной точки аналитики TDS/SQL для подключения и запуска запросов SQL для аналитики.