Poznámka

Na prístup k tejto stránke sa vyžaduje oprávnenie. Môžete sa skúsiť prihlásiť alebo zmeniť adresáre.

Na prístup k tejto stránke sa vyžaduje oprávnenie. Môžete skúsiť zmeniť adresáre.

Poznámka

Fabric Runtime 2.0 je momentálne v experimentálnej ukážke. Viac informácií nájdete v obmedzeniach a poznámkach.

Fabric Runtime poskytuje bezproblémovú integráciu v rámci ekosystému Microsoft Fabric a ponúka robustné prostredie pre projekty dátového inžinierstva a dátovej vedy poháňané Apache Spark.

Tento článok predstavuje Fabric Runtime 2.0 Experimental (Preview), najnovší runtime navrhnutý pre výpočty veľkých dát v Microsoft Fabric. Zdôrazňuje kľúčové funkcie a komponenty, ktoré robia toto vydanie významným krokom vpred pre škálovateľnú analytiku a pokročilé pracovné zaťaženia.

Fabric Runtime 2.0 zahŕňa nasledujúce komponenty a vylepšenia navrhnuté na zlepšenie vašich schopností spracovania dát:

- Apache Spark 4.0

- Operačný systém: Azure Linux 3.0 (Mariner 3.0)

- Java: 21

- Scala: 2.13

- Python: 3.12

- Delta Lake: 4,0

Povoliť Runtime 2.0

Runtime 2.0 môžete povoliť buď na úrovni pracovného priestoru, alebo na úrovni predmetu prostredia. Použite nastavenie workspace na aplikáciu Runtime 2.0 ako predvoleného pre všetky Spark workloady vo vašom workspace. Prípadne vytvorte položku Environment v Runtime 2.0 na použitie so špecifickými poznámkovými blokmi alebo definíciami úloh v Spark, ktorá prepíše predvolené nastavenie pracovného priestoru.

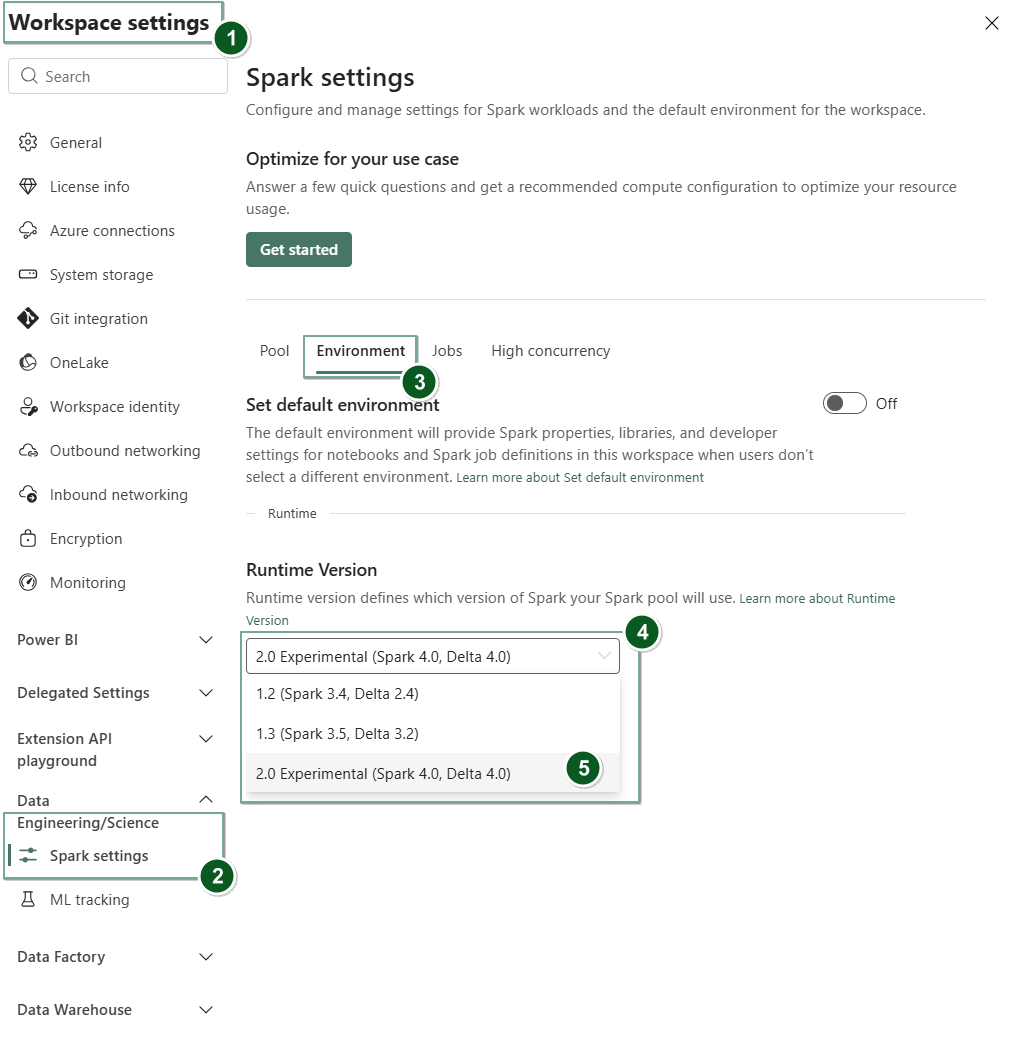

Povolte Runtime 2.0 v nastaveniach Workspace

Ak chcete nastaviť Runtime 2.0 ako predvolený pre celý váš pracovný priestor:

Prejdite v pracovnom priestore na kartu Nastavenia pracovného priestoru.

Choď na záložku Data Engineering/Science a vyber nastavenia Spark.

Vyberte kartu Prostredie.

V rozbaľovacom menu Runtime verzie vyberte 2.0 Experimental (Spark 4.0, Delta 4.0) a uložte si zmeny. Táto akcia nastavuje Runtime 2.0 ako predvolené runtime pre váš pracovný priestor.

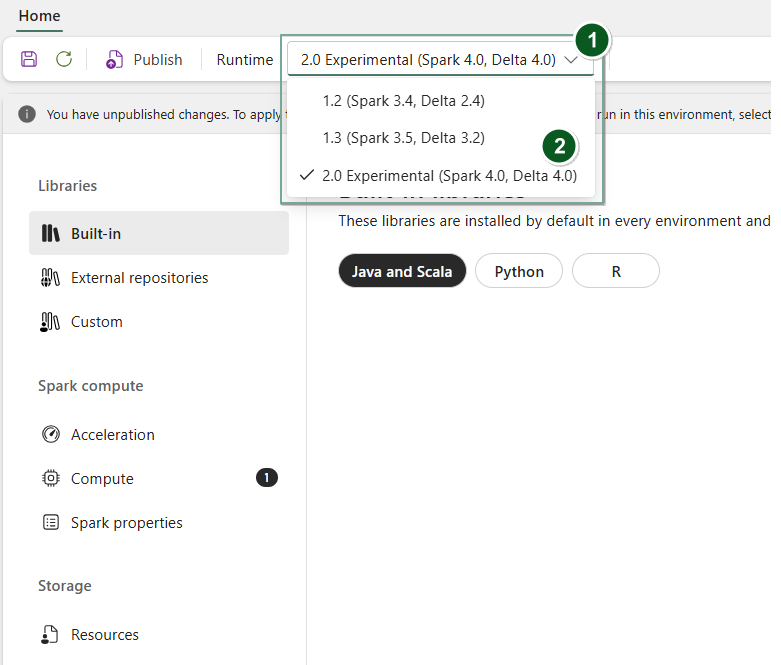

Povoliť Runtime 2.0 v položke Environment

Na použitie Runtime 2.0 so špecifickými poznámkovými blokmi alebo definíciami úloh v Sparku:

Vytvorte nový predmet Environment alebo otvorený a existujúci.

V rozbaľovacom menu Runtime vyberte 2.0 Experimental (Spark 4.0, Delta 4.0)

SaveaPublishsvoje zmeny.Dôležité

Začiatok Spark 2.0 môže trvať približne 2-5 minút, keďže štartovacie skupiny nie sú súčasťou skorého experimentálneho vydania.

Ďalej môžete použiť túto položku Environment s vaším

NotebookaleboSpark Job Definition.

Teraz môžete začať experimentovať s najnovšími vylepšeniami a funkciami predstavenými v Fabric Runtime 2.0 (Spark 4.0 a Delta Lake 4.0).

Experimentálna verejná ukážka

Experimentálna fáza náhľadu Fabric runtime 2.0 vám poskytuje skorý prístup k novým funkciám a API zo Spark 4.0 aj Delta Lake 4.0. Náhľad vám umožní okamžite použiť najnovšie vylepšenia založené na Sparku, čím zabezpečíte plynulú pripravenosť a prechod na budúce zmeny, ako sú novšie verzie pre Java, Scala a Python.

Prepitné

Ak chcete získať aktuálne informácie, podrobný zoznam zmien a konkrétne poznámky k vydaniu modulov CLR služby Fabric, skontrolujte a prihláste sa na odber vydaní a aktualizácií služby Spark Runtime.

Obmedzenia a poznámky

Fabric Runtime 2.0 je momentálne v experimentálnej verejnej náhľadovej fáze, navrhnutej pre používateľov na preskúmanie a experimentovanie s najnovšími funkciami a API od Spark a Delta Lake vo vývojovom alebo testovacom prostredí. Hoci táto verzia ponúka prístup k základným funkciám, existujú určité obmedzenia:

Môžete používať Spark 4.0 sessions, písať kód do notebookov, plánovať definície úloh v Sparku a používať s PySparkom, Scalou a Spark SQL. Jazyk R však v tomto skorom vydaní nie je podporovaný.

Knižnice môžete inštalovať priamo do svojho kódu pomocou pip a conda. Nastavenia Spark si môžete nastaviť cez %%configure možnosti v notebookoch a Spark Job Definitions (SJDs).

Môžete čítať a zapisovať do Lakehouse s Delta Lake 4.0, ale niektoré pokročilé funkcie ako V-order, natívne písanie v Parquet, autokompakcija, optimalizácia zápisu, low-shuffle merge, merge, evolúcia schémy a cestovanie v čase v tomto skorom vydaní nie sú zahrnuté.

Spark Advisor momentálne nie je dostupný. Monitorovacie nástroje ako Spark UI a logy sú však podporované v tejto skorej verzii.

Funkcie ako Data Science integrácie vrátane Copilotu a konektory ako Kusto, SQL Analytics, Cosmos DB a MySQL Java Connector momentálne nie sú v tejto skorej verzii podporované. Knižnice dátovej vedy nie sú podporované v prostredí PySpark. PySpark funguje len so základným Conda nastavením, ktoré zahŕňa samotný PySpark bez ďalších knižníc.

Integrácie s environment item a Visual Studio Code nie sú v tejto skorej verzii podporované.

Nepodporuje čítanie a zápis dát do účtov Azure Storage General Purpose v2 (GPv2) s protokolmi WASB alebo ABFS.

Poznámka

Podeľte sa o svoju spätnú väzbu na Fabric Runtime na platforme Ideas. Určite uveďte verziu a štádium vydania, o ktorom hovoríte. Ceníme si spätnú väzbu od komunity a uprednostňujeme zlepšenia na základe hlasovaní, aby sme spĺňali potreby používateľov.

Kľúčové zvýraznenia

Apache Spark 4.0

Apache Spark 4.0 predstavuje významný míľnik ako prvé vydanie v sérii 4.x, ktoré stelesňuje kolektívne úsilie živej open-source komunity.

V tejto verzii je Spark SQL výrazne obohatený o výkonné nové funkcie navrhnuté na zvýšenie expresívnosti a všestrannosti SQL záťaží, ako je podpora dátových typov VARIANT, SQL používateľom definované funkcie, relačné premenné, syntax potrubia a triedenie reťazcov. PySpark sa neustále venuje svojej funkčnej šírke aj celkovému zážitku vývojárov, prináša natívne API na kreslenie, nové API pre Python Data Source, podporu pre Python UDTF a jednotné profilovanie pre PySpark UDF, spolu s mnohými ďalšími vylepšeniami. Structured Streaming sa vyvíja s kľúčovými doplnkami, ktoré poskytujú väčšiu kontrolu a jednoduchšie ladenie, najmä zavedením Arbitrary State API v2 pre flexibilnejšiu správu stavov a State Data Source pre jednoduchšie ladenie.

Úplný zoznam a podrobné zmeny môžete skontrolovať tu: https://spark.apache.org/releases/spark-release-4-0-0.html.

Poznámka

V Spark 4.0 je SparkR zastaraný a môže byť v budúcej verzii odstránený.

Delta Lake 4.0

Delta Lake 4.0 predstavuje kolektívny záväzok urobiť Delta Lake interoperabilným naprieč formátmi, jednoduchším na prácu a výkonnejším. Delta 4.0 je míľnikové vydanie plné výkonných nových funkcií, optimalizácií výkonu a základných vylepšení pre budúcnosť otvorených dátových jazerných domov.

Celý zoznam a podrobné zmeny zavedené v Delta Lake 3.3 a 4.0 si môžete pozrieť tu: https://github.com/delta-io/delta/releases/tag/v3.3.0. https://github.com/delta-io/delta/releases/tag/v4.0.0.

Dôležité

Špecifické funkcie Delta Lake 4.0 sú experimentálne a fungujú len na Spark zážitkoch, ako sú Notebooks a Spark Job Definitions. Ak potrebujete používať tie isté Delta Lake tabuľky naprieč viacerými Microsoft Fabric záťažami, tieto funkcie nezapájajte. Ak sa chcete dozvedieť viac o tom, ktoré verzie a funkcie protokolov sú kompatibilné naprieč všetkými zážitkami Microsoft Fabric, prečítajte si interoperabilitu formátov tabuliek Delta Lake.

Súvisiaci obsah

- Apache Spark runtime v Fabric – prehľad, verziovanie a podpora viacerých runtime

- Sprievodca migráciou do služby Spark Core

- Príručky migrácie sql, množín údajov a údajového rámca

- Sprievodca migráciou štruktúrovaného streamovania

- Sprievodca migráciou do služby MLlib (strojové učenie)

- Sprievodca migráciou do súboru PySpark (Python on Spark)

- Sprievodca migráciou sparkr (R on Spark)