Kommentar

Åtkomst till den här sidan kräver auktorisering. Du kan prova att logga in eller ändra kataloger.

Åtkomst till den här sidan kräver auktorisering. Du kan prova att ändra kataloger.

Viktigt!

Den här funktionen är i förhandsversion.

Fabric Runtime levererar sömlös integrering i Microsoft Fabric-ekosystemet och erbjuder en robust miljö för datateknik och datavetenskapsprojekt som drivs av Apache Spark.

Den här artikeln introducerar offentlig förhandsversion av Fabric Runtime 2.0, den senaste körmiljön som är utformad för stordataberäkningar för Microsoft Fabric. Den belyser de viktigaste funktionerna och komponenterna som gör den här versionen till ett viktigt steg framåt för skalbar analys och avancerade arbetsbelastningar.

Fabric Runtime 2.0 innehåller följande komponenter och uppgraderingar som är utformade för att förbättra dina databehandlingsfunktioner:

- Apache Spark 4.0

- Operativsystem: Azure Linux 3.0 (Mariner 3.0)

- Java: 21

- Scala: 2.13

- Python: 3.12

- Delta lake: 4.0

- R: 4.5.2

Viktigt!

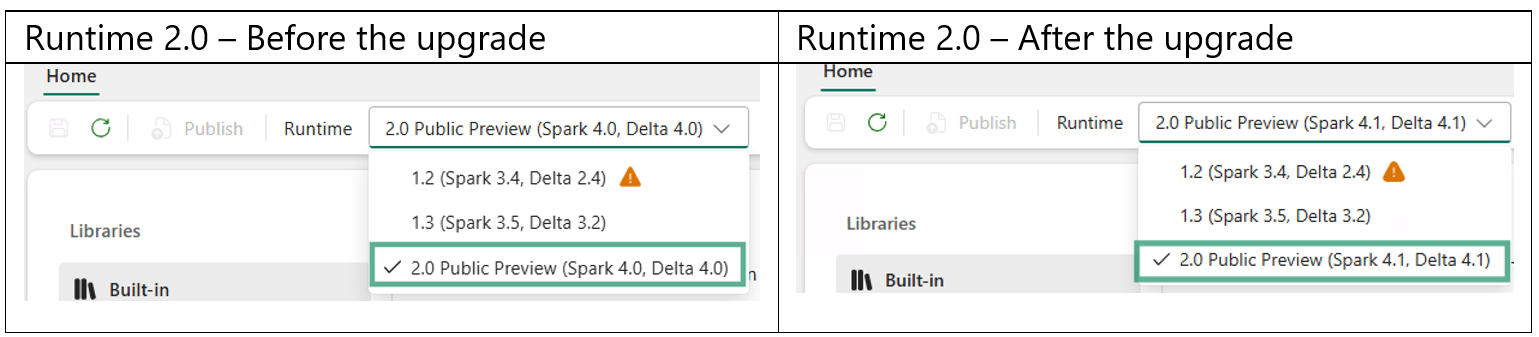

Fabric Runtime 2.0 uppdateras till Spark 4.1. Den Fabric Runtime-version som visas i portalen (arbetsyteinställningar och körningsalternativet i Miljö-UX) ändras inte, men följande komponenter uppgraderas.

| Component | Aktuell version | Uppdaterad version |

|---|---|---|

| Spark | 4.0 | 4.1 |

| Delta Lake | 4.0 | 4.1 |

| Python | 3.12 | 3.13 |

Breaking change: Uppgraderingen av Python kräver att du publicerar om varje miljö som har bibliotek. Tills du publicerar igen visas flikarna Offentliga bibliotek och Anpassade bibliotek tomma och Spark-jobb som riktar sig mot den berörda miljön misslyckas med felen "Ingen modul hittades" eller "Klassen hittades inte".

Nödvändiga åtgärder

- Före uppgraderingen registrerar eller exporterar du bibliotekslistan från varje miljö.

- Efter uppgraderingen lägger du till biblioteken igen och väljer Publicera för att återskapa dem mot Spark 4.1.

Tips/Råd

Fabric Runtime 2.0 har stöd för den interna körningsmotorn, vilket avsevärt kan förbättra prestandan utan mer kostnader. Du kan aktivera den inbyggda exekveringsmotorn på miljönivå så att alla jobb och notebook-filer automatiskt ärver de förbättrade prestandaförmågorna.

Aktivera Runtime 2.0

Du kan aktivera Runtime 2.0 på antingen arbetsytenivå eller miljöobjektnivå. Använd arbetsyteinställningen för att tillämpa Runtime 2.0 som standard för alla Spark-arbetsbelastningar på din arbetsyta. Du kan också skapa ett miljöobjekt med Runtime 2.0 som ska användas med specifika notebook-filer eller Spark-jobbdefinitioner, vilket åsidosätter standardinställningen för arbetsytan.

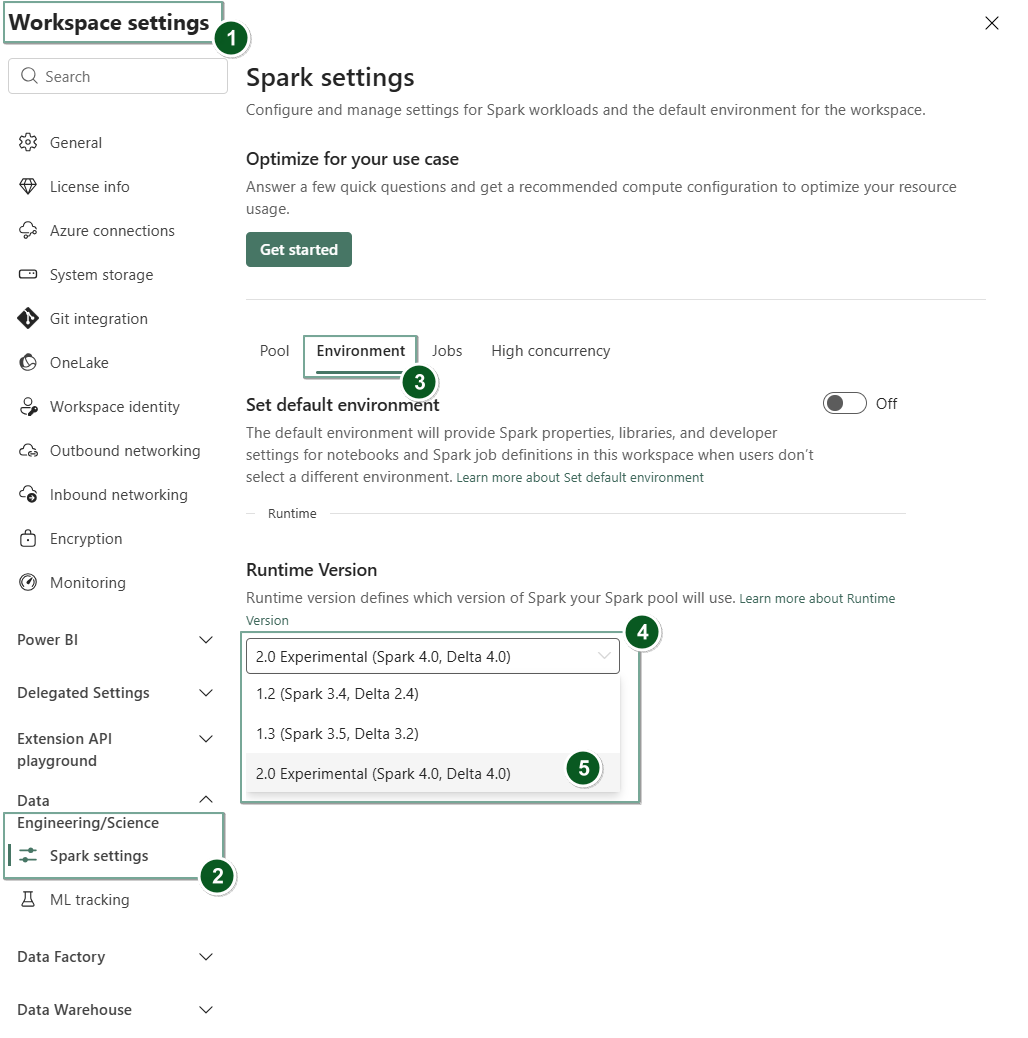

Aktivera Runtime 2.0 i arbetsyteinställningar

Så här anger du Runtime 2.0 som standard för hela arbetsytan:

Gå till sidan Inställningar för arbetsyta i din Fabric-arbetsyta.

Välj fliken Datateknik/vetenskap och välj sedan Spark-inställningar.

Välj fliken Miljö.

Under listrutan Körningsversion väljer du 2.0 Offentlig förhandsversion (Spark 4.0, Delta 4.0) och sparar ändringarna.

Runtime 2.0 har ställts in som standardkörning för din arbetsyta.

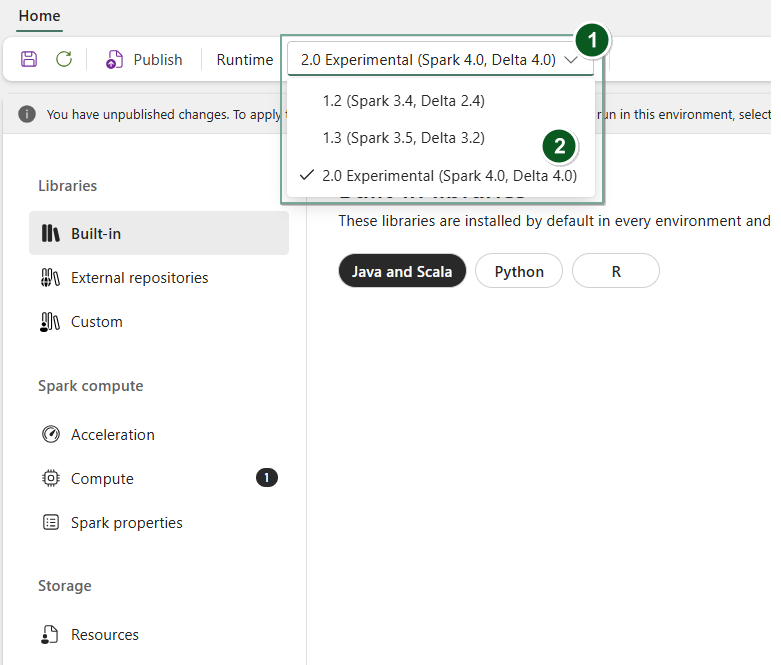

Aktivera Runtime 2.0 i ett miljöobjekt

För att använda Runtime 2.0 med specifika anteckningsböcker eller Spark-jobbdefinitioner:

Skapa ett nytt miljöobjekt eller öppna ett befintligt objekt.

Under listrutan Körning väljer du 2.0 Offentlig förhandsversion (Spark 4.0, Delta 4.0)

SaveochPublishdina ändringar.Sedan kan du använda det här miljöobjektet med ditt

NotebookellerSpark Job Definition.

Nu kan du börja experimentera med de senaste förbättringarna och funktionerna som introducerades i Fabric Runtime 2.0 (Spark 4.0 och Delta Lake 4.0).

Tips/Råd

Det kan ta några minuter att starta den första Spark-sessionen för Runtime 2.0 under den offentliga förhandsversionen. För att minska fördröjningarna vid kallstart använder du Custom Live Pools (förhandsversion) för att förvärma Spark-pooler eller konfigurera resursprofiler för att allokera resurser i förväg.

Anmärkning

WASB-protokollet för GPv2(General Purpose v2) Azure Storage-konton är inaktuellt. Du bör använda det senaste ABFS-protokollet i stället för att läsa från och skriva till GPv2-lagringskonton.

Offentlig förhandsversion

Den offentliga förhandsversionen av Fabric Runtime 2.0 ger dig åtkomst till nya funktioner och API:er från både Spark 4.0 och Delta Lake 4.0. Med förhandsversionen kan du använda de senaste Spark- och Delta-baserade förbättringarna direkt samt säkerställa en smidig beredskap och övergång för förbättrade och förbättrade ändringar som nyare Java-, Scala- och Python-versioner.

Tips/Råd

För uppdaterad information, en detaljerad lista över ändringar och specifika versionsanteckningar för Fabric-körtider, kontrollera och prenumerera på utgåvor och uppdateringar av Spark-körtider.

Viktiga höjdpunkter

Förbättringar av prestanda- och exekveringsmotorn.

Fabric Runtime 2.0 innehåller den inbyggda körningsmotorn, som ger betydande prestandaförbättringar jämfört med Spark med öppen källkod. Motorn använder vektoriserad bearbetning för att påskynda Spark-frågor på lakehouse-infrastrukturen utan att kräva kodändringar.

Viktiga prestandafunktioner i Runtime 2.0:

- Upp till sex gånger snabbare: Prestandamått visar upp till sex gånger snabbare prestanda jämfört med Spark med öppen källkod för TPC-DS arbetsbelastningar.

- Vektoriserad CSV-parsning: Den inbyggda körningsmotorn innehåller en vektoriserad CSV-parser som påskyndar CSV-inmatning och frågearbetsbelastningar. Stöd för vektoriserad JSON-parsning och Spark Structured Streaming planeras för framtida uppdateringar.

Information om hur du aktiverar den inbyggda körmotorn finns i Inbyggd körmotor för Fabric Datateknik.

Apache Spark 4.0

Apache Spark 4.0 markerar en viktig milstolpe som den första versionen i 4.x-serien, som förkroppsligar den samlade ansträngningen i den livliga communityn med öppen källkod.

I den här versionen är Spark SQL avsevärt berikat med kraftfulla nya funktioner som är utformade för att öka uttryckskraften och mångsidigheten för SQL-arbetsbelastningar, till exempel stöd för VARIANT-datatyp, användardefinierade SQL-funktioner, sessionsvariabler, pipe-syntax och strängsortering. PySpark ser ett kontinuerligt engagemang för både dess funktionella bredd och den övergripande utvecklarupplevelsen, vilket ger ett inbyggt api för plottning, ett nytt API för Python-datakälla, stöd för Python-UDF:er och enhetlig profilering för PySpark-UDF:er, tillsammans med många andra förbättringar. Strukturerad strömning utvecklas med viktiga tilläggsfunktioner som ger bättre kontroll och enklare felsökning, särskilt införandet av det godtyckliga tillstånds-API v2 för mer flexibel tillståndshantering och State Data Source för enklare felsökning.

Du kan kontrollera hela listan och detaljerade ändringar här: https://spark.apache.org/releases/spark-release-4-0-0.html.

Anmärkning

I Spark 4.0 är SparkR inaktuellt och kan tas bort i en framtida version.

Delta lake 4.0

Delta Lake 4.0 markerar ett gemensamt åtagande att göra Delta Lake samverkande mellan format, enklare att arbeta med och mer högpresterande. Delta 4.0 är en milstolpeversion fullspäckad med kraftfulla nya funktioner, prestandaoptimeringar och grundläggande förbättringar för framtiden för öppna datasjöhus.

Du kan kontrollera hela listan och detaljerade ändringar som introduceras med Delta Lake 3.3 och 4.0 här: https://github.com/delta-io/delta/releases/tag/v3.3.0. https://github.com/delta-io/delta/releases/tag/v4.0.0.

Datalayout och optimering

Runtime 2.0 stöder funktioner för datalayout och optimering för Delta-tabeller:

- Z-ordning: Organisera data i Delta-tabellfiler efter angivna kolumner för att förbättra frågeprestanda för filtrerade förfrågningar.

- Liquid Clustering: En flexibel klustringsmetod som automatiskt optimerar datalayouten utan manuellt underhåll.

- Parallell inläsning av Delta-ögonblicksbilder: Den inbyggda körningsmotorn läser in Delta-ögonblicksbilder parallellt, vilket minskar uppstartstiden för frågor för stora tabeller.

Viktigt!

Delta Lake 4.0-specifika funktioner är experimentella och fungerar bara med Spark-upplevelser, till exempel notebook-filer och Spark-jobbdefinitioner. Om du behöver använda samma Delta Lake-tabeller i flera Microsoft Fabric-arbetsbelastningar ska du inte aktivera dessa funktioner. Mer information om vilka protokollversioner och funktioner som är kompatibla för alla Microsoft Fabric-upplevelser finns i Delta Lake-tabellformatets samverkan.

Beräkningshantering i Runtime 2.0

Runtime 2.0 stöder följande funktioner för beräkningshantering:

- Resursprofiler: Konfigurera fördefinierade resursallokeringar för Spark-sessioner för att matcha arbetsbelastningskrav och kontrollera kostnader.

- Anpassade livepooler (förhandsversion): Skapa dedikerade, förvärmda Spark-pooler som minskar starttiden för sessioner. Anpassade livepooler för Runtime 2.0-arbetsbelastningar är tillgängliga som förhandsversion.

Begränsningar och anteckningar

- Delta Lake 4.0-specifika funktioner är experimentella och fungerar bara med Spark-upplevelser, till exempel notebook-filer och Spark-jobbdefinitioner. Om du behöver använda samma Delta Lake-tabeller i flera Fabric-arbetsbelastningar ska du inte aktivera dessa funktioner. Mer information finns i Delta Lake-tabellformatets samverkan.

- Runtime 2.0 finns i offentlig förhandsversion. Vissa funktioner och API:er kan ändras före allmän tillgänglighet.

- VS Code-tillägget för Fabric Spark stöder Runtime 2.0 för utveckling av notebook- och Spark-jobbdefinition.

Relaterat innehåll

- Apache Spark-miljöer i Fabric – översikt, versionshantering och stöd för flera körmiljöer

- Migreringsguide för Spark Core

- Migreringsguider för SQL, datauppsättningar och DataFrame

- Migreringsguide för strukturerad direktuppspelning

- Migreringsguide för MLlib (strojové učenie)

- Migreringsguide för PySpark (Python på Spark)

- Migreringsguide för SparkR (R on Spark)