Bemærk

Adgang til denne side kræver godkendelse. Du kan prøve at logge på eller ændre mapper.

Adgang til denne side kræver godkendelse. Du kan prøve at ændre mapper.

Microsoft Fabric Maps tilbyder geospatial visualisering og analyse for at levere handlingsorienterede indsigter fra realtids- og historiske rumlige data.

I denne vejledning bruger en feltdispatcher i elforsyningsselskabet Microsoft Fabric Maps til at oprette og administrere reparationsarbejdsordrer, når der rapporteres om strømafbrydelser eller fejl i aktiverne. Scenariet fokuserer på at lokalisere berørte kunder, visualisere aktive arbejdsordrer i realtid og effektivt sende hold ud for at genoprette servicen.

Denne vejledning demonstrerer, hvordan kundernes placeringer kortlægges, live arbejdsordrer vises på kortet, og en optimal rute beregnes ved hjælp af Azure Maps Route Directions API. Tutorialen afsluttes med en optimeret rute, der vises på kortet.

Fabric Maps kører inden for Fabric Real-Time Intelligence og indsamler streaming-telemetri ved hjælp af Eventstream og Eventhouse til realtidsovervågning. Færdiggørelser af arbejdsordrer og driftsresultater gemmes i OneLake, hvor de kan bruges til ruteoptimering og analyser, som vises på kortet.

I denne vejledning vil du:

- Opret et søhus og upload eksempler på arbejdsordredata.

- Opsæt en eventstream til at skrive arbejdsordredata til et eventhouse.

- Opret et KQL-forespørgselssæt for at udtrække kundekoordinater fra de importerede arbejdsordredata.

- Opret et kort og tilføj forespørgselssættet som et kortlag.

- Beregn en optimal rute ved hjælp af Azure Maps Route Directions API.

- Tilføj den optimerede rute til kortet som et lag.

- Konfigurer kort- og lagindstillinger.

Forudsætninger

Før du starter denne tutorial, er det nyttigt at gennemgå Real-Time Intelligence-tutorials for at blive fortrolig med kernekoncepterne og workflows.

Hvis du ikke har et Azure-abonnement, skal du oprette en gratis konto, inden du begynder.

En Fabric-konto. For mere information om Microsoft Fabric, se Hvad er Microsoft Fabric?.

Tilladelse til at oprette Eventstream, Eventhouse (KQL-database), Lakehouse, notesbøger og kortobjekt. For mere information, se Om lejerindstillinger

Et arbejdsområde med en Microsoft Fabric-aktiveret -kapacitet. Du kan finde flere oplysninger om oprettelse af et arbejdsområde under Oprette et arbejdsområde

En grundlæggende forståelse af Fabric Lakehouse, et dataarkiv til opbevaring, håndtering og analyse af strukturerede og ustrukturerede data samlet ét sted. For information om at oprette et søhus, se Opret et søhus i Microsoft Fabric.

En grundlæggende forståelse af Fabric Eventhouse, brugt til at indlæse, behandle og analysere data næsten i realtid. For information om at skabe et eventhouse, se Create an eventhouse.

En grundlæggende forståelse af Kusto-forespørgselssproget.

En grundlæggende forståelse af , hvordan man bruger Microsoft Fabric-notebooks.

Opret et søhus og upload eksempler på arbejdsordredata

For at simulere en realtids streamingkilde bruger notesbogen i de følgende trin eksempeldata uploadet til et søhus. I produktion ville disse data blive streamet i stedet for statiske.

Opret arbejdsordredatafilen

Arbejdsordredatafilen indeholder eksempler på arbejdsordreposter, der bruges i denne vejledning til at simulere en realtids streamingkilde. Efter at have oprettet filen, importerer du den til et sommerhus ved søen i næste trin.

Kopier og indsæt følgende indhold i en tekstfil, og gem det derefter som WorkorderLocations.csv. Du vil bruge denne fil i næste trin.

WorkorderID,Latitude,Longitude

100,48.22610712,16.32977412

101,48.23519063,16.37364699

102,48.19785896,16.38669028

103,48.18125837,16.37068261

107,48.15151126,16.41766590

108,48.20290349,16.32492121

104,48.23400591,16.4563533

105,48.18145603,16.40506946

106,48.16366378,16.36001083

Opret et lakehouse og importer arbejdsordredatafilen

Opret et nyt lakehouse til indkommende arbejdsordredata og importer den tidligere oprettede arbejdsordre-lokationsfil.

- Fra dit arbejdsområde vælger du Nyt element, og indtast lakehouse i søgefeltet og vælg det for at oprette et nyt lakehouse.

- Indtast et navn WorkorderLocationsLakehouse og vælg Opret dem.

- I det nye søhus vælger du Upload filer og uploader den WorkorderLocations.csv fil, der blev oprettet i det forrige trin.

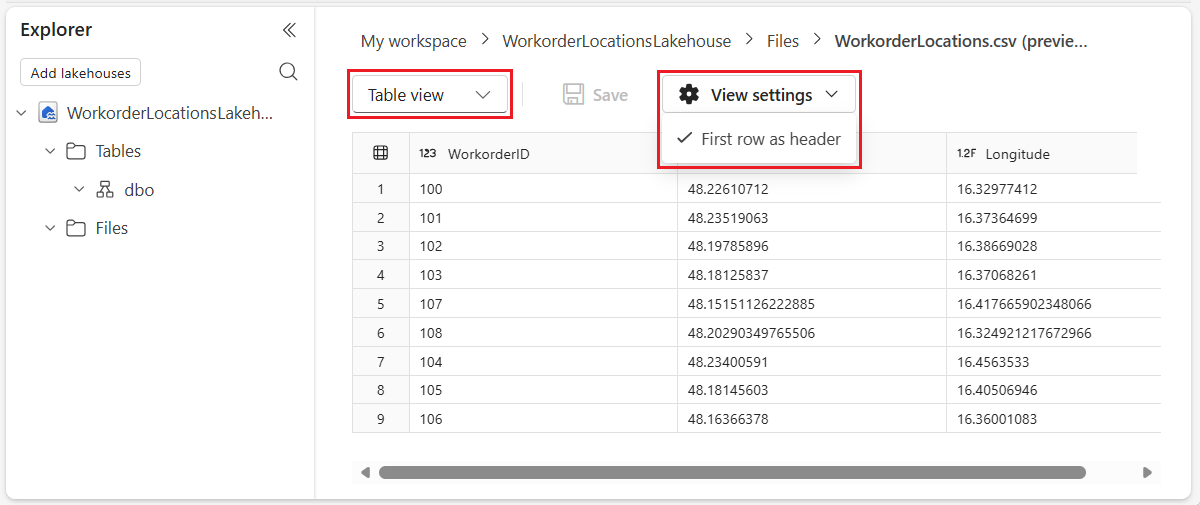

- I det nye søhus skal du vælge Explorer-panelet i venstre side af skærmen.

- I Filer-sektionen i Stifinder skal du vælge WorkorderLocations.csv for at se den fil, du har uploadet.

- I Visningsindstillingerne vælger du første række som header.

- (Valgfrit) I rullemenuen for visning, vælg Table View.

Opret en eventstream og skriv data til et eventhouse

I dette afsnit designer du et eventstream-flow ved hjælp af et brugerdefineret endpoint og sender data via en notebook for at simulere realtidsstreaming.

Microsoft Fabric Eventstream er en realtids datastreamingtjeneste, der gør det muligt for brugere at indlæse, behandle og rute hændelsesdata inden for Microsoft Fabric-økosystemet. Det giver en no-code-oplevelse til at opbygge hændelsesdrevne arbejdsgange, hvilket muliggør problemfri integration af realtidsdata fra forskellige kilder og dirigering til flere destinationer. For mere information om understøttede datakilder eller hvordan man forbinder til et brugerdefineret endpoint, se Oversigt over Microsoft Fabric eventstreams.

Ved at indlæse eventstream-data i et eventhouse gør du streaming-events tilgængelige for behandling med Kusto Query Language (KQL). Dette giver dig mulighed for at forespørge, transformere og analysere dataene, efterhånden som de ankommer. Du kan få flere oplysninger under Oversigt over Eventhouse.

Opret en eventstream og eventhouse

Fra dit arbejdsområde vælger du Nyt element, og indtast eventstream i søgefeltet.

Vælg Eventstream.

I dialogen Ny Eventstream indtaster du et Navn: "WorkordersEventstream", og vælg derefter Create.

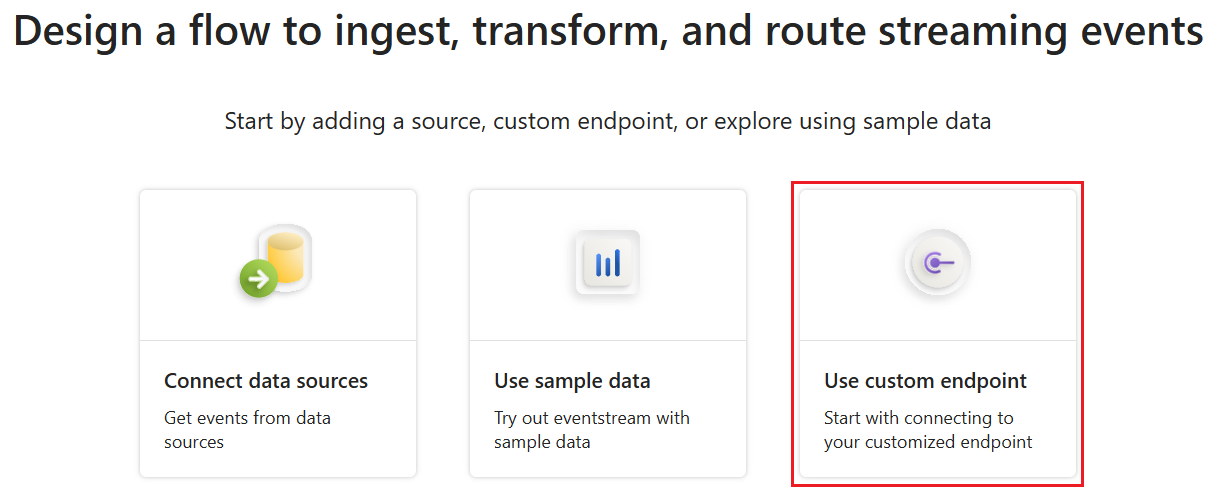

I skærmen Design et flow til at indlæse, transformere og rute streamingbegivenheder , vælg Brug brugerdefineret endpoint

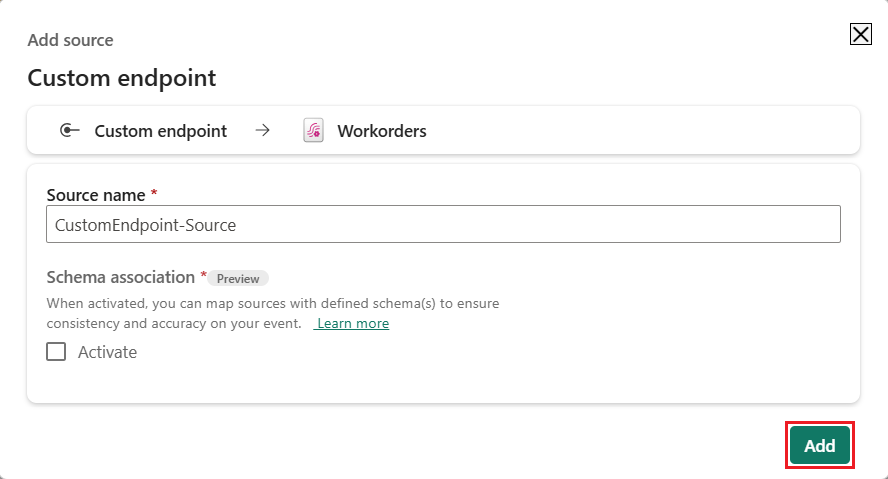

I dialogen for brugerdefineret endpoint Tilføj kilde, vælg Tilføje.

Eventstrømmen er nu oprettet. Dernæst tilføjer du et Eventhouse som destination.

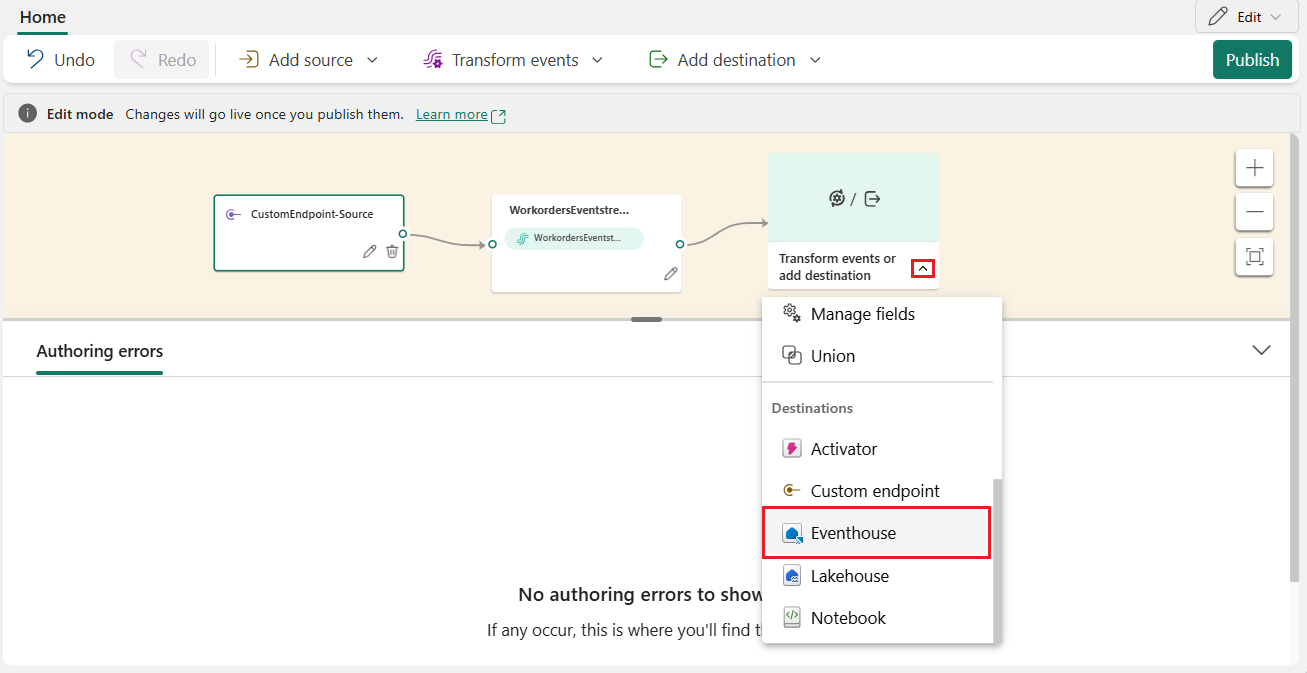

I WorkordersEventstream-noden i eventstream-designeren vælg Eventhouse fra Transform-events eller tilføj destinationsdropdown-listen.

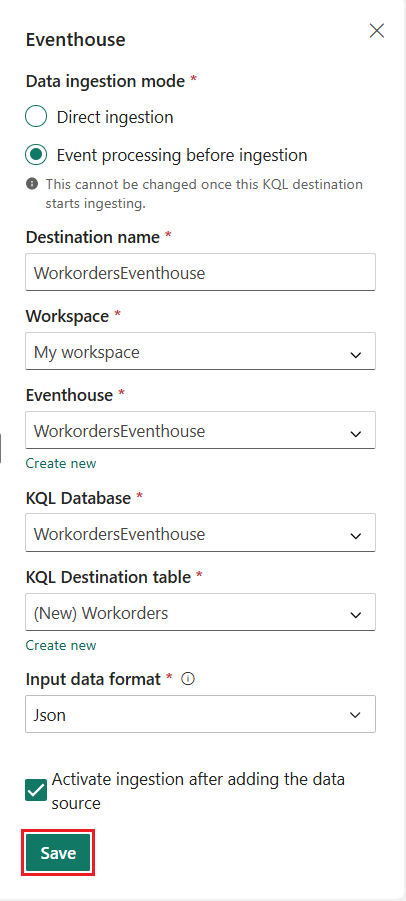

Eventhouse-destinationskonfigurationspanelet vises på højre side af skærmen. Udfyld de ønskede oplysninger som følger, og vælg derefter Gem:

- Dataindlæsningstilstand: Sæt til hændelsesbehandling før indlæsning.

- Destinationsnavn: Sæt til arbejdsordrerEventhouse.

- Arbejdsområde: En dropdown-menu, der viser navnet på dit arbejdsområde.

- Eventhouse: Vælg Opret nyt og opret et eventhouse kaldet WorkordersEventhouse.

- KQL-database: Vælg arbejdsordrerEventhouse.

- KQL Destinationstabell: Vælg Opret nyt link og opret en ny tabel kaldet WorkordersEventhouse.

- Inputdataformat: Vælg Json.

- Aktiver indtagelse efter tilføjelse af datakilden: sæt kryds i boksen.

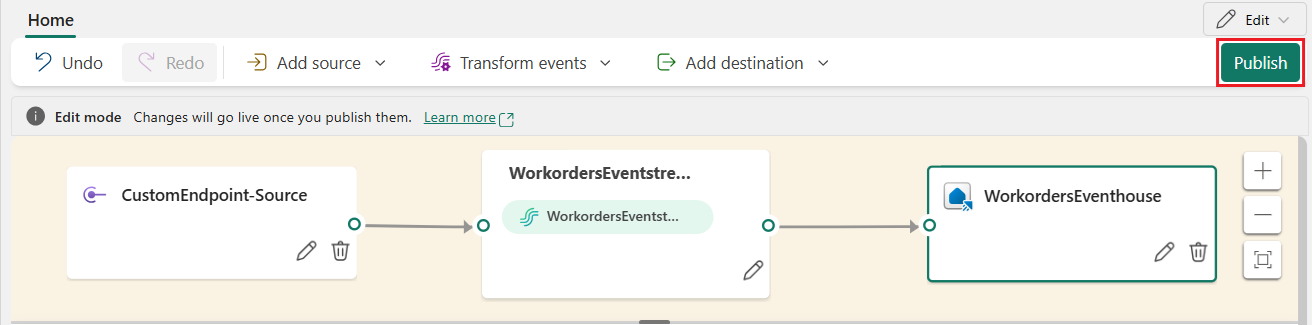

Når eventhouset er tilføjet som destination, vælger du Publish for at offentliggøre din nye eventstream.

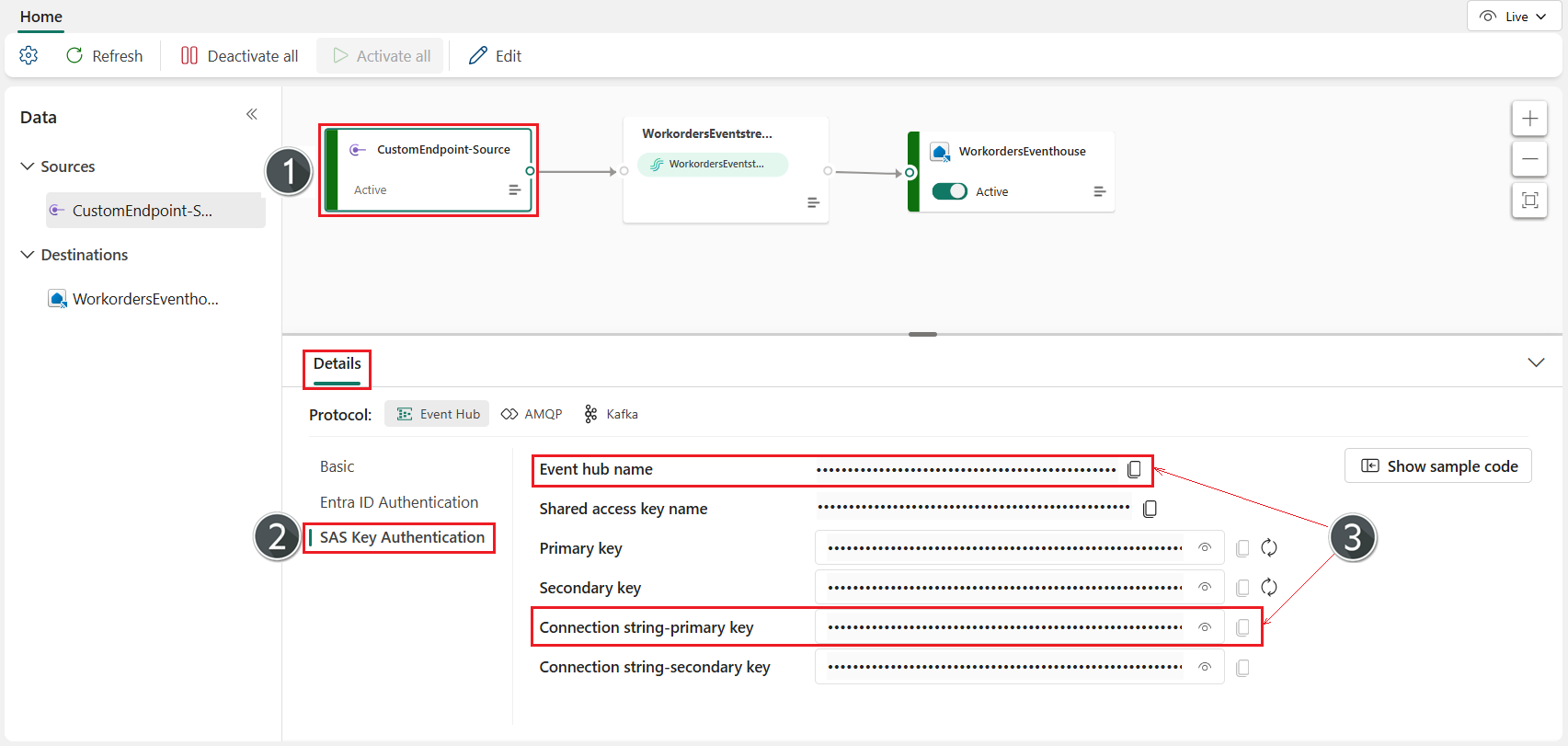

Få de nødvendige SAS-nøgle-autentificeringsnøgler

Du skal bruge Event Hub-navnet og Connection string-primærnøgleværdierne fra SAS Key autentificeringssektionen i din notesbogskode.

Vælg den brugerdefinerede endpoint-kildeflise, du lige har tilføjet.

I Details-panelet vælger du SAS Key Authentication.

Kopier følgende to værdier og gem dem til brug i din notesbogskode:

- Event hub-navn: Bruges til variablen EVENT_HUB_NAME.

- Forbindelsesstreng-primærnøgle: Bruges til CONNECTION_STR-variabelen .

Simulér realtidsindtagelse ved hjælp af en notesbog

I dette afsnit opretter du en notesbog, der er forbundet til det søhus, du oprettede tidligere, og bruger derefter den medfølgende kode til at læse CSV-dataene og sende begivenheder til eventstreamen. Dette simulerer realtids dataindlæsning; Til demoer kan du køre notesbogen manuelt eller planlægge den til at køre periodisk.

Opret en notesbog i dit Fabric-arbejdsområde

Opret en notesbog med kode til at importere opgaveplaceringsfilen fra dit lakehouse til den eventstream, du oprettede i forrige afsnit. Dette simulerer en realtids streamingkilde, som i et produktionsmiljø ville blive streamet i stedet for statisk.

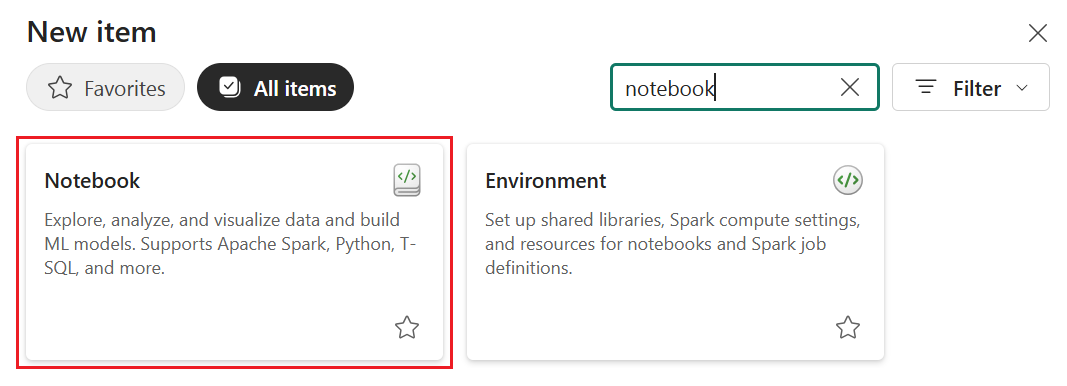

Fra dit arbejdsområde vælger du Nyt element, og indtast notesbog i søgefeltet.

Vælg Notesbog.

I dialogen Ny notesbog indtast WorkorderLocations i Navn-feltet , og vælg derefter Create.

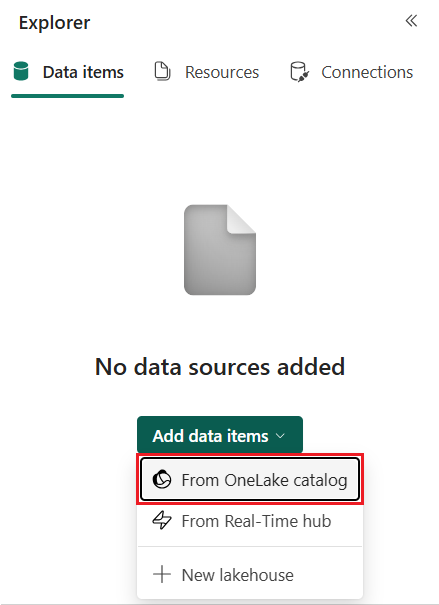

For at forbinde din notesbog til søhuset, vælg Fra OneLake-kataloget fra rullemenuen Tilføj dataelementer .

Vælg WorkorderLocationsLakehouse fra OneLake-kataloget og vælg Connect-knappen . Dette er søhuset, du tidligere har skabt.

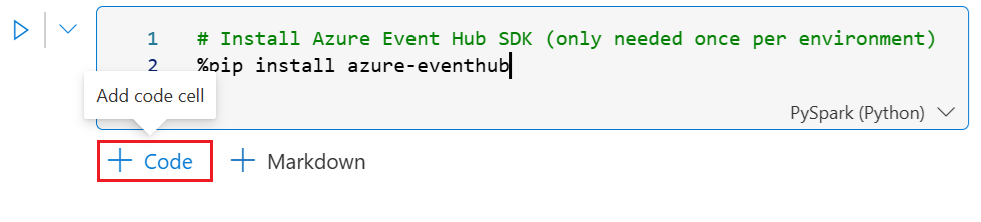

Efter at have oprettet notesbogen og forbundet den til dit lakehouse, indsæt følgende kode i den første celle og kør den for at installere Azure Event Hub SDK'en:

# Install Azure Event Hub SDK (only needed once per environment) %pip install azure-eventhubVælg + Kode for at oprette en ny celle i notesbogen.

Vælg den nye celle og indtast følgende kode i den:

from azure.eventhub import EventHubProducerClient, EventData import pandas as pd import json import time # Replace with your actual connection string and Event Hub name CONNECTION_STR = "" # Connection string-primary key EVENT_HUB_NAME = "" # Event hub name producer = EventHubProducerClient.from_connection_string(conn_str=CONNECTION_STR, eventhub_name=EVENT_HUB_NAME) df = spark.read.csv("Files/WorkorderLocations.csv", header=True, inferSchema=True) pdf = df.toPandas() total_records = len(pdf) for index, row in pdf.iterrows(): # Convert row to dictionary row_dict = row.to_dict() # Truncate coordinates to 5 decimal digits if 'lat' in row_dict: row_dict['Latitude'] = round(float(row_dict['Latitude']), 5) if 'lon' in row_dict: row_dict['Longitude'] = round(float(row_dict['Longitude']), 5) # Serialize to JSON payload = json.dumps(row_dict) # Send to Event Hub event_data = EventData(payload) with producer: producer.send_batch([event_data]) # Wait 100ms time.sleep(0.1)Tilføj værdierne for variablerne CONNECTION_STR og EVENT_HUB_NAME opnået i det foregående afsnit med titlen Get required SAS key authentication keys.

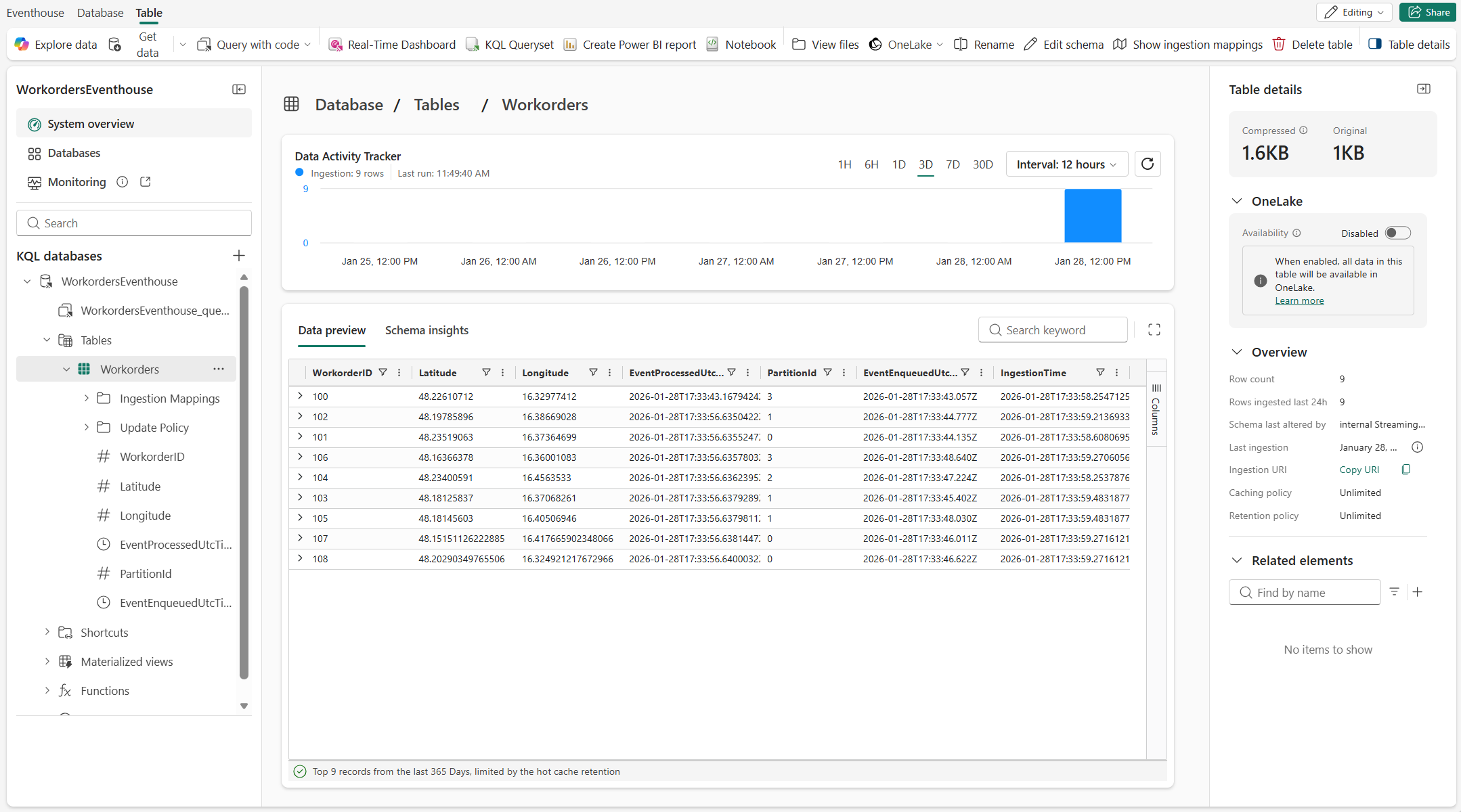

Kør notebook-koden. Dette skaber Workorder-tabellen i KQL-databasen i WorkordersEventhouse eventhouse.

Opret et KQL-forespørgselssæt og tilføj det som et kortlag

I dette afsnit opretter du et KQL-forespørgselssæt, der henter aktuelle data for arbejdsordreplacering fra arbejdsordretabellen i dit eventhouse, og derefter bruger dette forespørgselssæt som datakilde til et Fabric Maps-kort. Forespørgselssættet gør det muligt for kortet at vise aktive arbejdsordrer som et lag, hvilket giver et visuelt overblik over opgaver, der skal planlægges og tildeles felthold.

Opret et KQL-forespørgselssæt

Fra dit eventhouse (KQL-database):

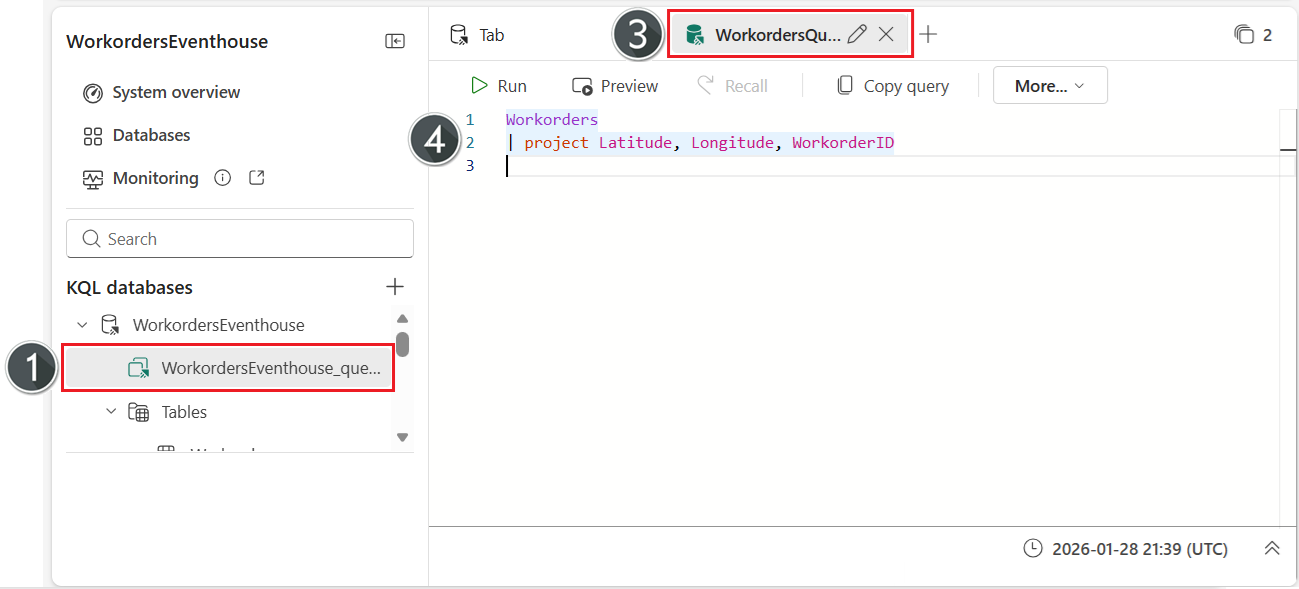

Vælg WorkordersEventhouse_queryset fra KQL-databasen.

Vælg + fra menulinjen for forespørgsler for at oprette en ny forespørgsel.

Når den nye forespørgsel oprettes, bliver den automatisk navngivet WorkordersEventhouse, vælg blyantikonet for at redigere navnet og omdøb det til WorkordersQuery.

Indsæt følgende KQL-forespørgsel i editoren.

Workorders | project Latitude, Longitude, WorkorderIDVælg pencil-redigeringsikonet i fanen med titlen Tab og omdøb det til WorkordersQuery.

Vælg Kør for at verificere, at forespørgslen returnerer arbejdsordredataene med lokationsfelter.

Dette forespørgselssæt fungerer som en genanvendelig datakilde for et Fabric Maps-kortdatalag, hvilket demonstreres i næste afsnit.

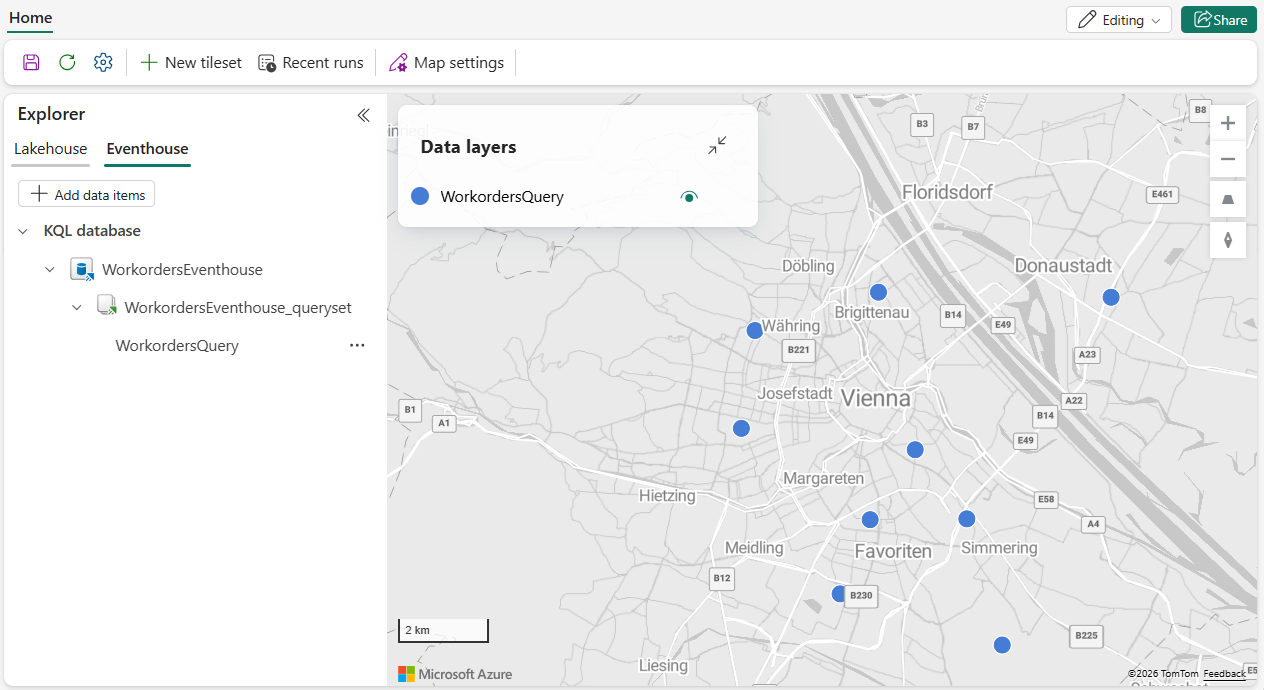

Opret et kort og tilføj forespørgselssættet som et lag

I dette afsnit opretter du et Fabric Maps-kort og bruger det tidligere oprettede KQL-forespørgselssæt som datalag. Kortet er konfigureret med et opdateringsinterval, så streamingdata fra arbejdsordrer automatisk opdateres og giver et næsten realtids rumligt overblik over aktive arbejdsordrer. Du omdøber derefter laget og justerer dets indstillinger for at styre, hvordan dataene vises på kortet. Denne live geospatiale kontekst hjælper dispatchere med at overvåge feltaktivitet, vurdere efterspørgslen på tværs af serviceområder og træffe mere informerede rute- og tildelingsbeslutninger.

Opret et nyt kort

- Fra dit arbejdsområde vælger du Nyt element.

- I panelet Nye genstande indtaster du kort i søgefeltet og vælger Kort.

- I dialogen Nyt Kort indtast WorkordersMap i Navn-feltet og vælg Create.

Tilføj eventhouse til kortet

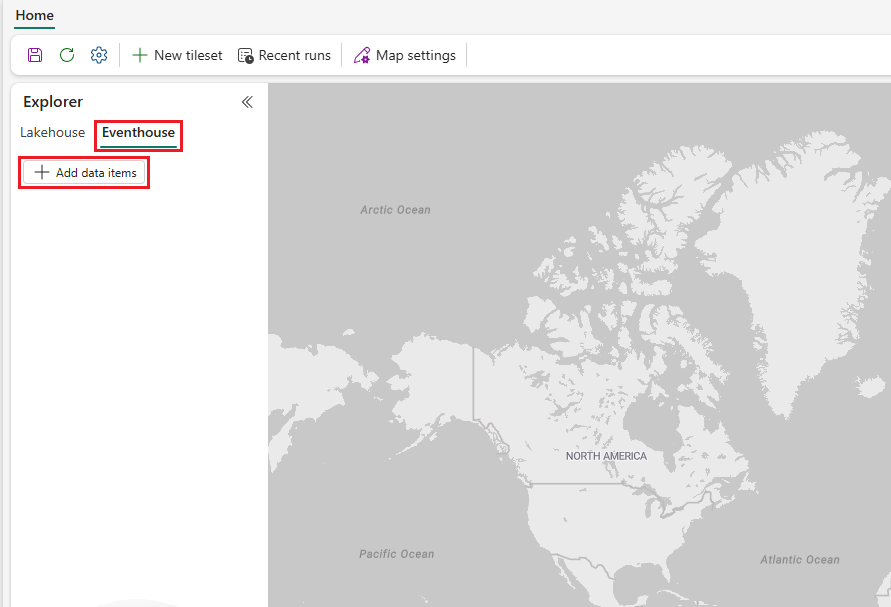

I Explorer-panelet vælger du Eventhouse og derefter knappen Tilføj dataelementer .

Fra OneLake-kataloget vælger du det eventhouse WorkordersEventhouse , du tidligere oprettede, og vælger derefter Connect.

Tips

Hvis du får en fejl som for eksempel KQL-databasen, har den en beskyttet etiket, der begrænser adgangen. Kontakt venligst din database-ejer for hjælp. Tjek følsomhedsetiketten på din KQL-database, da den kan begrænse adgangen. For mere information, se Påfør følsomhedsetiketter på tekstilvarer.

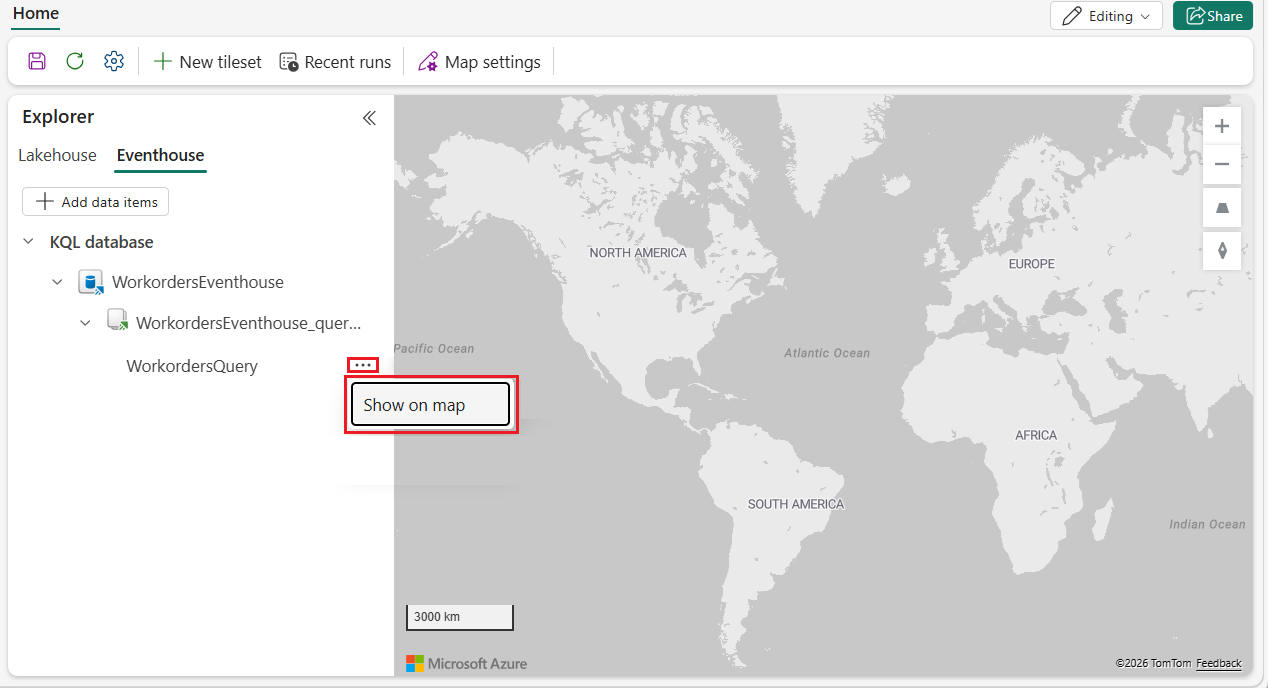

Vis forespørgselssæt på kortet

I Explorer-panelet på dit nye kort vælger du eventhouse WorkordersEventhouse , som du tilføjede i det forrige trin.

Navigér til KQL-forespørgslen WorkordersQuery, og vælg ellipsen (...) for at vise pop-up-menuen.

Vælg Vis på kort fra pop-up-menuen.

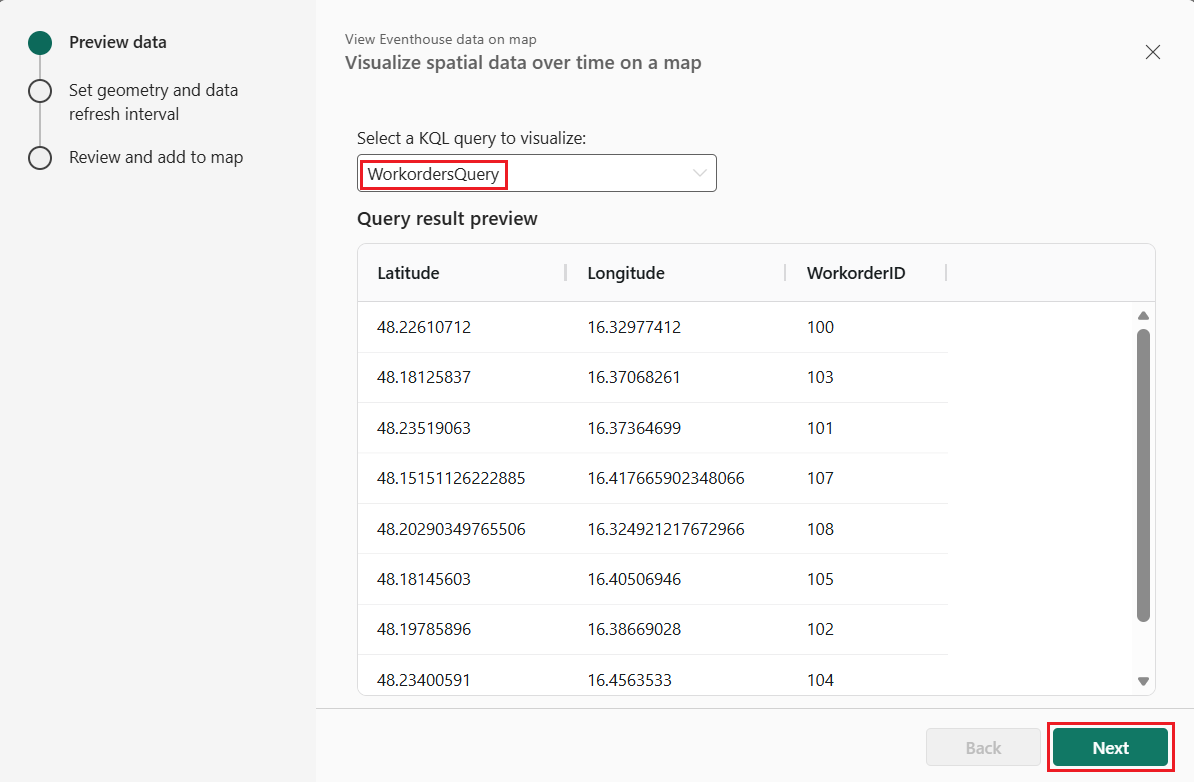

Visningen af Eventhouse-data i kortdialogen vises med Forhåndsvisningsdata valgt. Ingen ændringer er nødvendige. Sørg for, at det er korrekt, og vælg derefter Næste

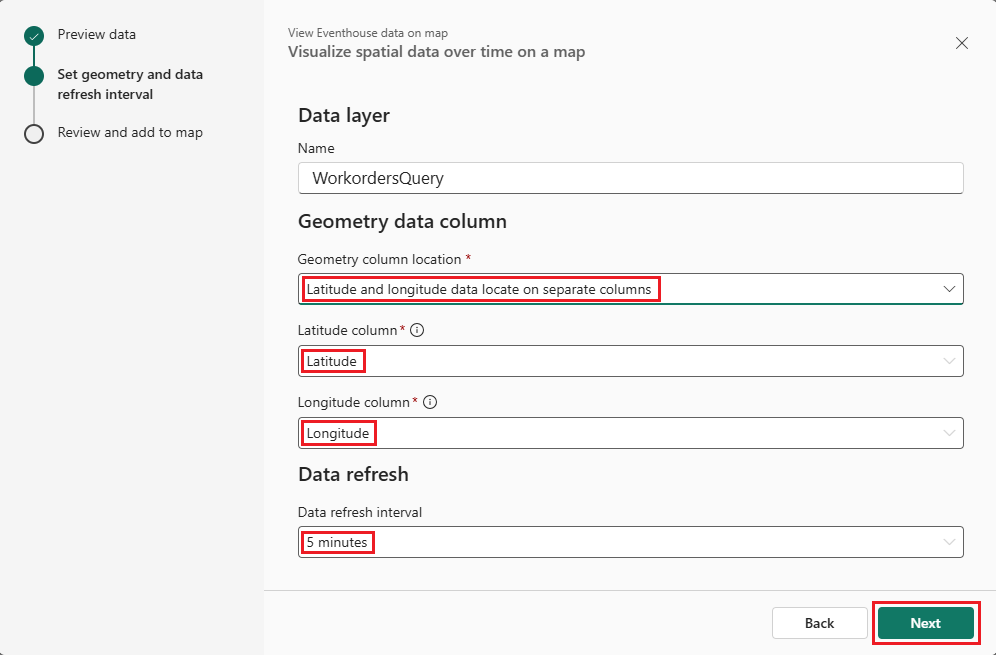

I trinnet Set geometri og dataopdateringsinterval skal du sætte felterne som følger, og derefter vælge Næste:

Datalagsnavn: WorkordersQuery

Geometri-kolonneplacering: Bredde- og længdegradsdata placeres i separate kolonner

Breddegradskolonne: Breddegrad

Længdegradskolonne: Længdegrad

Dataopdateringsinterval: 5 minutter

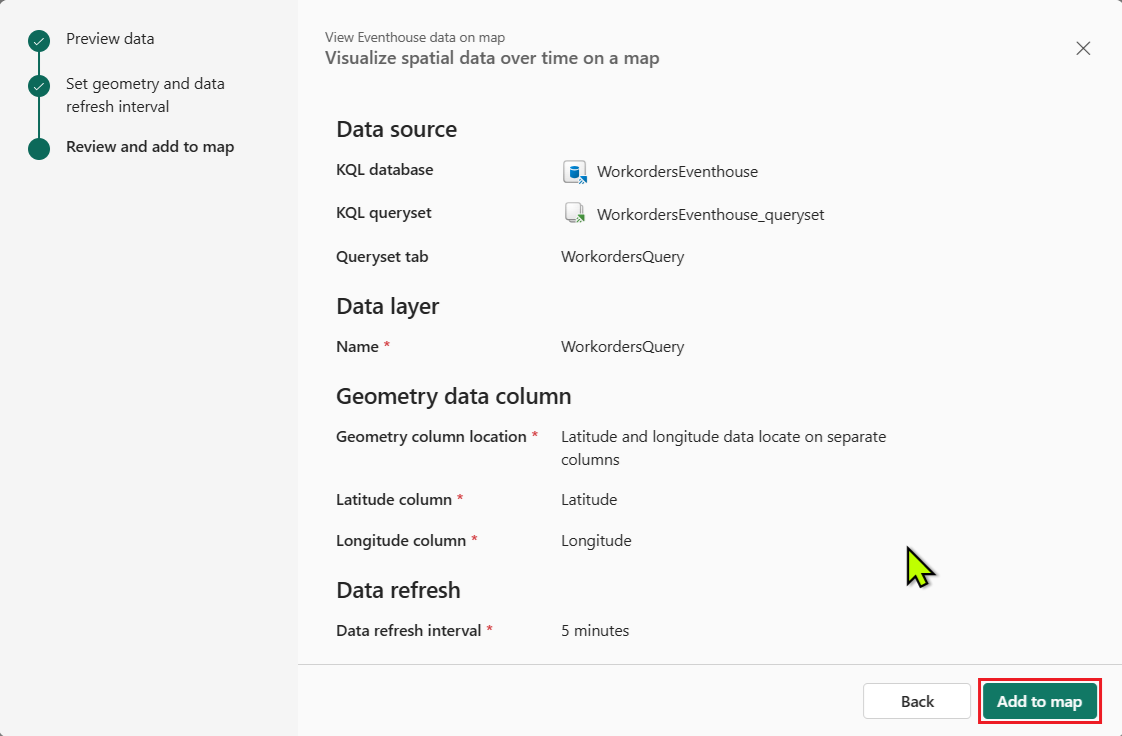

I trinnet Gennemgå og tilføj til kort, gennemgå indstillinger og vælg Tilføj til kort.

Resultaterne af forespørgselssættet vises nu på det opdaterede kort.

Generer en optimeret rute med flere stop med Azure Maps Route Directions API

I dette afsnit opretter du en ny notesbog, der henter koordinater til arbejdsordrer fra KQL-databasen og kalder Azure Maps Route Directions REST API. Du aktiverer tjenestens multistop-optimeringsfunktion for at bestemme den mest effektive rækkefølge for hvert besøg og returnerer rutegeometrien i den optimerede rækkefølge. Denne output bruges senere til at visualisere en anbefalet teknikerrute på kortet.

For at fuldføre denne sektion skal du have en Azure-konto med en Azure Maps-konto og abonnementsnøgle. Hvis du ikke har en Azure-konto, skal du oprette en gratis konto , før du begynder. For mere information om oprettelse af en Azure Maps-konto, se Opret en Azure Maps-konto. For mere information om at få en Azure Maps-abonnementsnøgle, se Få abonnementsnøglen til din konto i Azure Maps-quickstart.

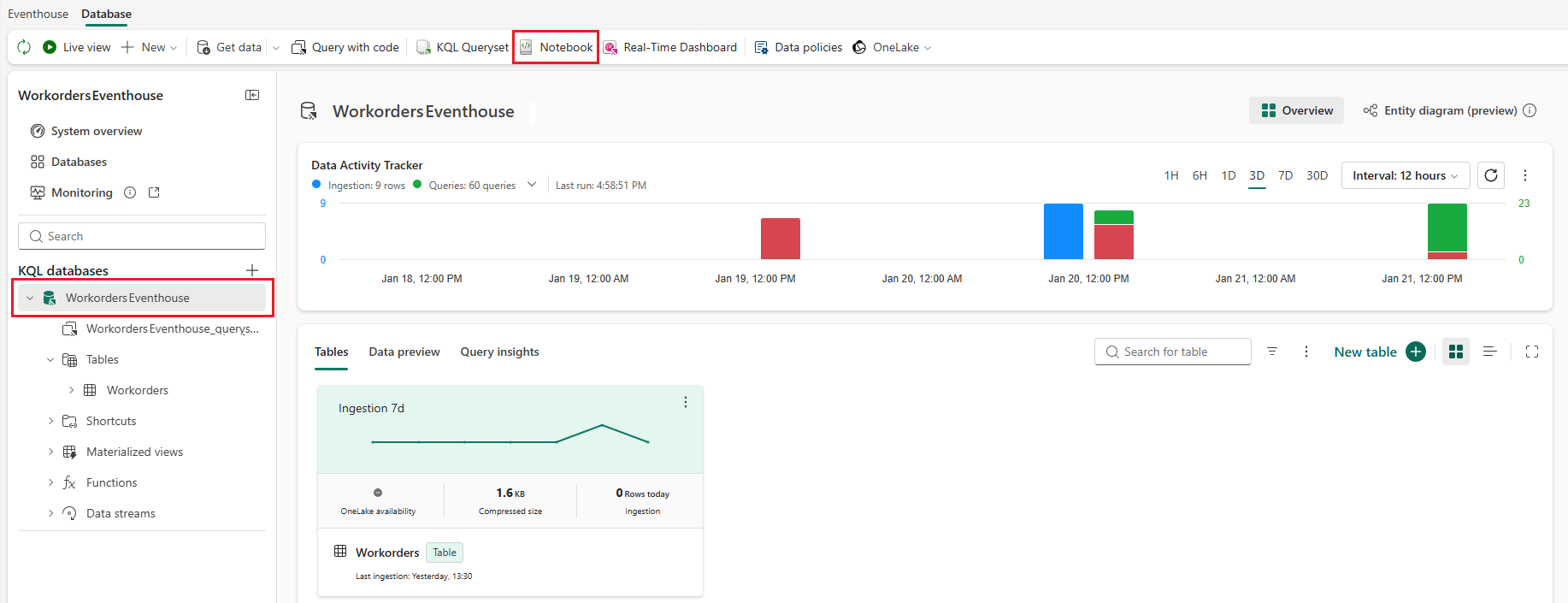

Opret en notesbog i dit Fabric-arbejdsområde, der henter den optimale rute

Fra dit arbejdsområde åbner du det eventhouse WorkordersEventhouse, som du tidligere har oprettet.

I venstre navigationspanel under KQL-databaser skal du vælge WorkordersEventhouse.

Den øverste menulinje burde nu vise en mulighed for Notebook. Vælg den for at oprette en ny notesbog.

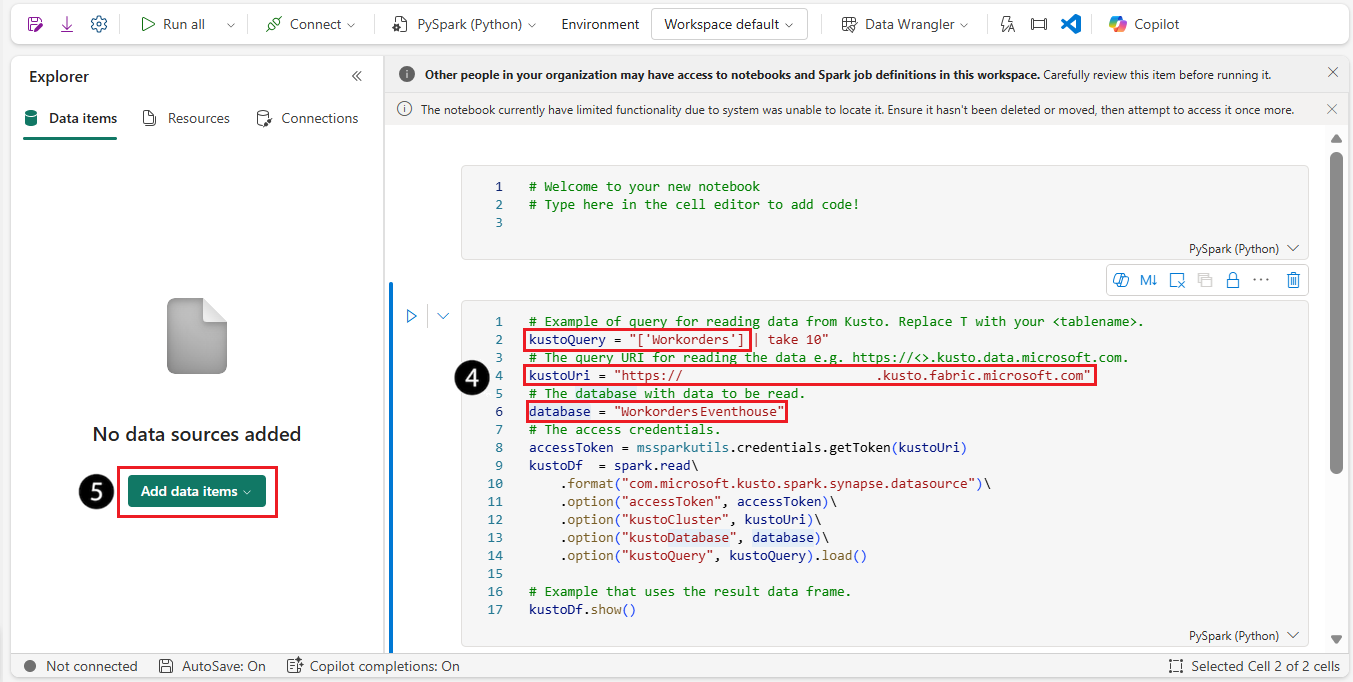

I den nye notesbog gemmer du værdierne for kustoQuery, kustoUri og databasevariabler . Du bruger disse værdier i den nye notesbogskode, du opretter i trin 6.

Forbind din notesbog til WorkorderLocationsLakehouse ved at vælge Fra OneLake-kataloget i dropdown-listen Tilføj dataelementer .

Når din nye notesbog er oprettet og forbundet til dit søhus, indtaster du følgende kode i den anden celle i din notesbog, erstatter standardkoden, og tilføjer derefter de variabelværdier, der er gemt i det foregående trin:

import os, json, requests from pyspark.sql import types as T from pyspark.sql.functions import col # ---- Configuration ---- AZMAPS_SUBSCRIPTION_KEY = os.environ.get( 'AZMAPS_SUBSCRIPTION_KEY', '<Your Azure Maps subscription key>' ) API_VERSION = '2025-01-01' BASE_URL = 'https://atlas.microsoft.com' kustoQuery = "['Workorders']" # Your Kusto query name kustoUri = "" # Your Kusto URI database = "WorkordersEventhouse" # Your KQL database name # The access credentials. accessToken = mssparkutils.credentials.getToken(kustoUri) kustoDf = spark.read\ .format("com.microsoft.kusto.spark.synapse.datasource")\ .option("accessToken", accessToken)\ .option("kustoCluster", kustoUri)\ .option("kustoDatabase", database)\ .option("kustoQuery", kustoQuery).load() # Write transformed response to a new file so the raw output is preserved OUTPUT_GEOJSON_PATH_TRANSFORMED = ( 'Files/OptimizedRoute.geojson' # GeoJSON output file ) # ---- Read Stores from KQL database table ---- stores_df = spark.read\ .format("com.microsoft.kusto.spark.synapse.datasource")\ .option("accessToken", accessToken)\ .option("kustoCluster", kustoUri)\ .option("kustoDatabase", database)\ .option("kustoQuery", kustoQuery).load()\ .select( col("WorkorderID").alias("workorder_id"), col("Latitude").alias("lat"), col("Longitude").alias("lon") ) # Ordered waypoints: origin first, then the rest by workorder_id # (API will re-order when optimizeWaypointOrder=True) stores_pd = stores_df.orderBy('workorder_id').toPandas() waypoints_lonlat = [[float(r['lon']), float(r['lat'])] for _, r in stores_pd.iterrows()] # ---- Build Directions request body (GeoJSON) ---- features = [] for idx, (lon, lat) in enumerate(waypoints_lonlat): features.append({ "type": "Feature", "geometry": {"type": "Point", "coordinates": [lon, lat]}, "properties": {"pointIndex": idx, "pointType": "waypoint"} }) dir_body = { "type": "FeatureCollection", "features": features, "optimizeRoute": "fastestWithTraffic", "routeOutputOptions": ["routePath"], # ensures route path geometry in response "travelMode": "truck", "optimizeWaypointOrder": True } # ---- Call Azure Maps Directions (POST) ---- url = f"{BASE_URL}/route/directions" params = {"api-version": API_VERSION} headers = { "Accept": "application/geo+json", "Content-Type": "application/geo+json", "subscription-key": AZMAPS_SUBSCRIPTION_KEY } resp = requests.post(url, params=params, data=json.dumps(dir_body), headers=headers) resp.raise_for_status() resp_json = resp.json() # exact payload as returned by the API # ---- Transform: move order.optimizedIndex -> properties.optimizedIndex for all Waypoint features to add as a data label in the map---- for feat in resp_json.get("features", []): props = feat.get("properties") or {} if props.get("type") == "Waypoint": order = props.get("order") or {} opt_idx = order.pop("optimizedIndex", None) if opt_idx is not None: props["optimizedIndex"] = opt_idx + 1 # reassign possibly-updated order (still contains inputIndex if present) props["order"] = order feat["properties"] = props # ---- Write transformed GeoJSON ---- from notebookutils import mssparkutils mssparkutils.fs.put(OUTPUT_GEOJSON_PATH_TRANSFORMED, json.dumps(resp_json), True) print(f"Transformed Directions GeoJSON (waypoints carry properties.optimizedIndex) written to {OUTPUT_GEOJSON_PATH_TRANSFORMED}")Indtast Din Azure Maps-abonnementsnøgle i notesbogskoden for den AZMAPS_SUBSCRIPTION_KEY variabel ved at erstatte "<Din Azure Maps-abonnementsnøgle>" med Din Azure Maps-abonnementsnøgle.

Vigtig

Dette eksempel hardkoder Azure Maps-abonnementsnøglen for enkelhedens skyld. Kod ikke hemmeligheder i produktionsmiljøer. Gem og administrer hemmeligheder sikkert ved at bruge Azure Key Vault og referer til dem under kørsel. For mere information, se Bedste praksis for beskyttelse af hemmeligheder.

Vælg knappen Gem som i menuen og gem notesbogen som OptimizeRoute.

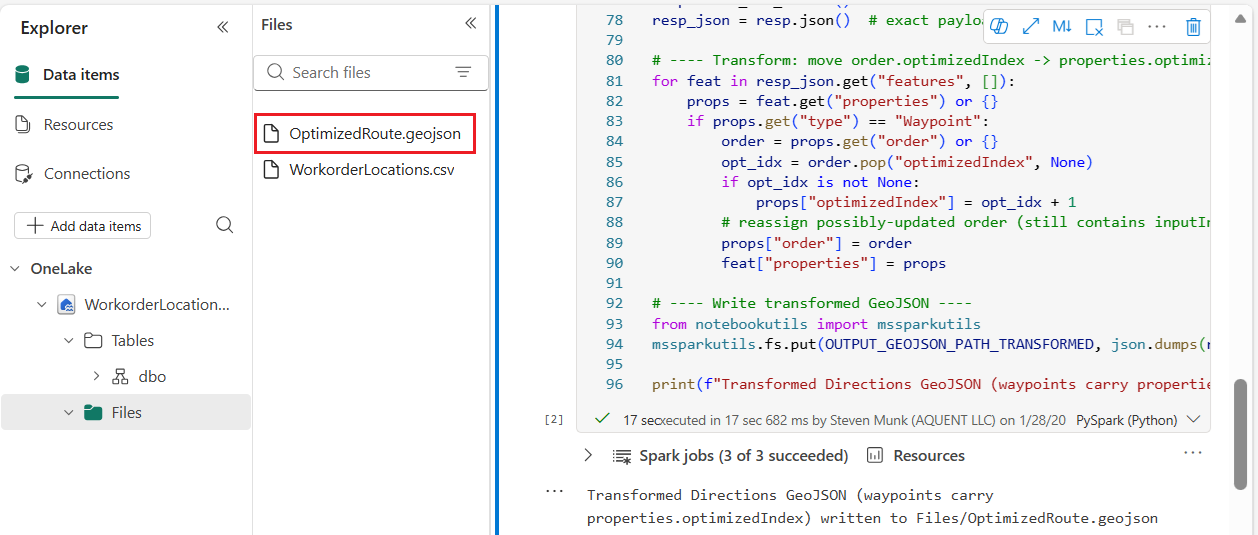

Kør notebooken for at oprette OptimizedRoute.geojson-filen i Files-mappen på dit lakehouse.

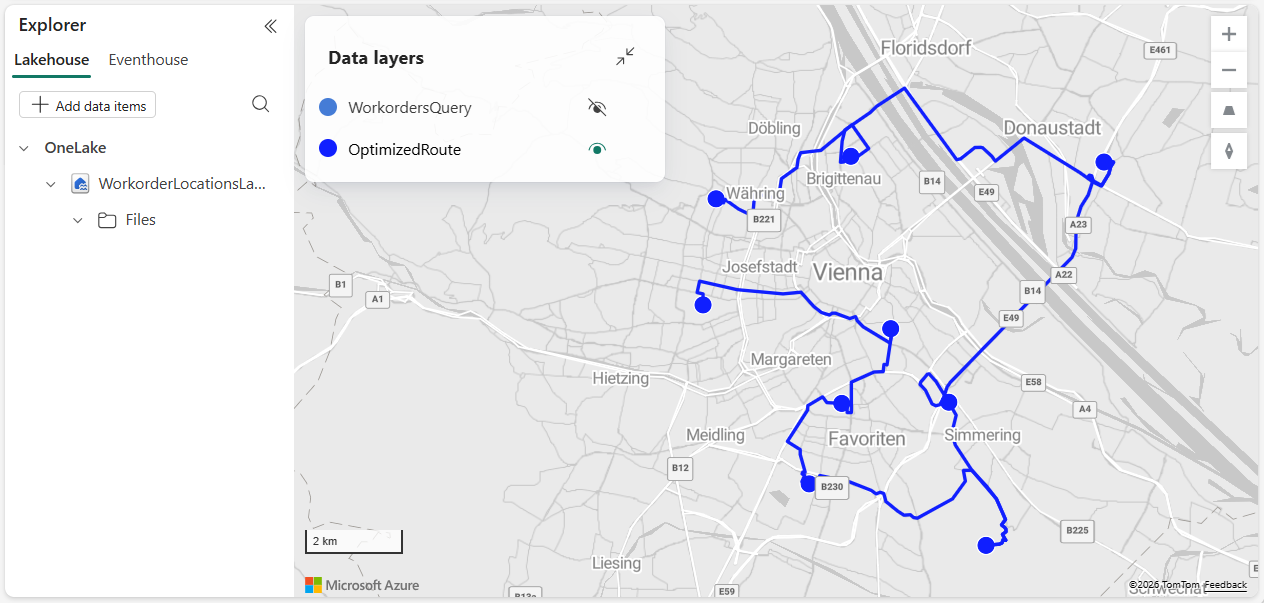

Tilføj lakehouse til kortet

- I Explorer-panelet på dit kort WorkordersMap, vælg Lakehouse og derefter knappen Tilføj dataelementer .

- Fra OneLake-kataloget vælger du lakehouse WorkorderLocationsLakehouse, som du tidligere oprettede, og vælger derefter Connect.

Vis den optimerede rute på kortet

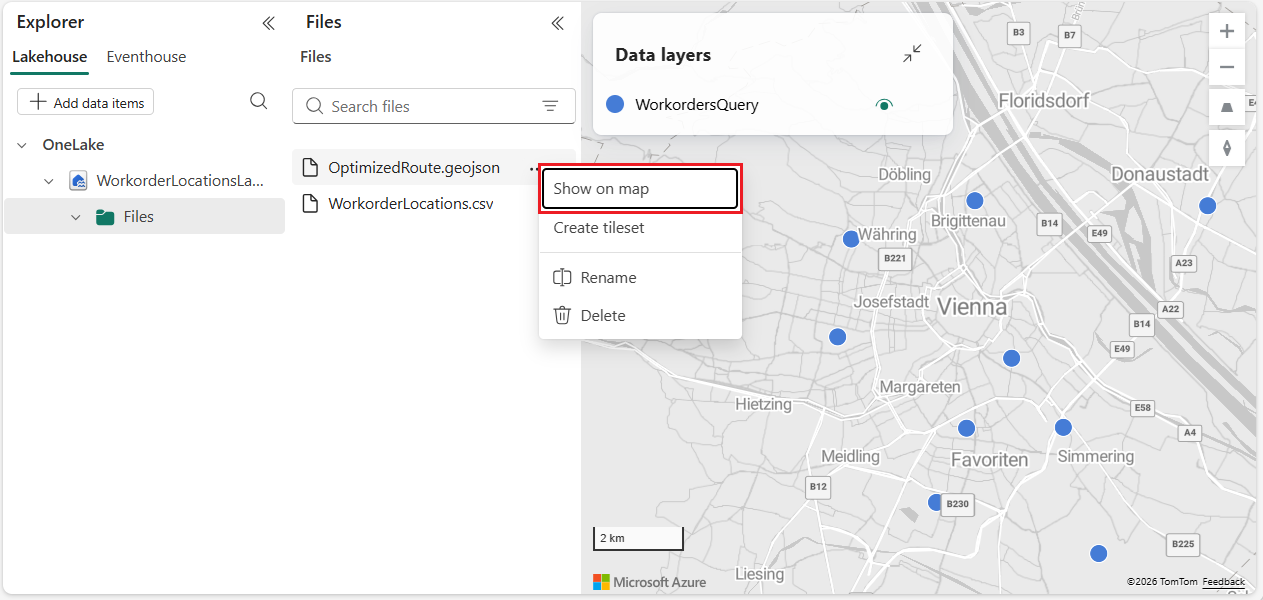

I Explorer-panelet på dit nye kort vælger du lakehouse WorkorderLocationsLakehouse, som du tilføjede i det forrige trin.

Gå til OptimizedRoute.geojson i mappen Filer i dit lakehouse og vælg ellipsen (...) for at vise pop-up-menuen.

Vælg Vis på kort fra pop-up-menuen.

I Datalagspaneletslår du synligheden fra for WorkordersQuery-laget .

Når det er færdigt, vises det nye kortlag på dit Fabric Maps-kort.

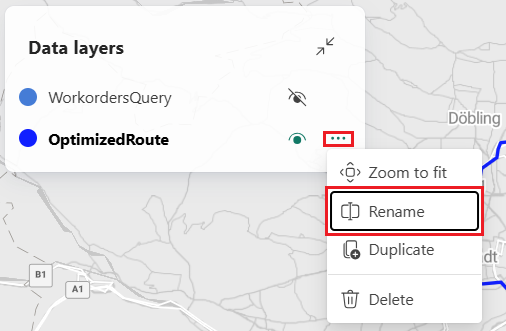

Indstillinger for kortlag

Fabric Maps tilbyder en række lagindstillinger, der lader dig kontrollere, hvordan data præsenteres på kortet. I dette afsnit tilpasser du laget, der er skabt fra ruteoptimeringsprocessen, ved at omdøbe laget, justere symbolstilen og konfigurere labels baseret på feltværdier. Disse indstillinger hjælper med at forbedre læsbarheden og gør det lettere at fortolke arbejdsordredata med et hurtigt blik.

Omdøb laget

I panelet Data layers åbner du menuen OptimizedRoute-indstillinger ved at vælge ellipsen (...).

Når du er i indstillingsmenuen, vælg Omdøb.

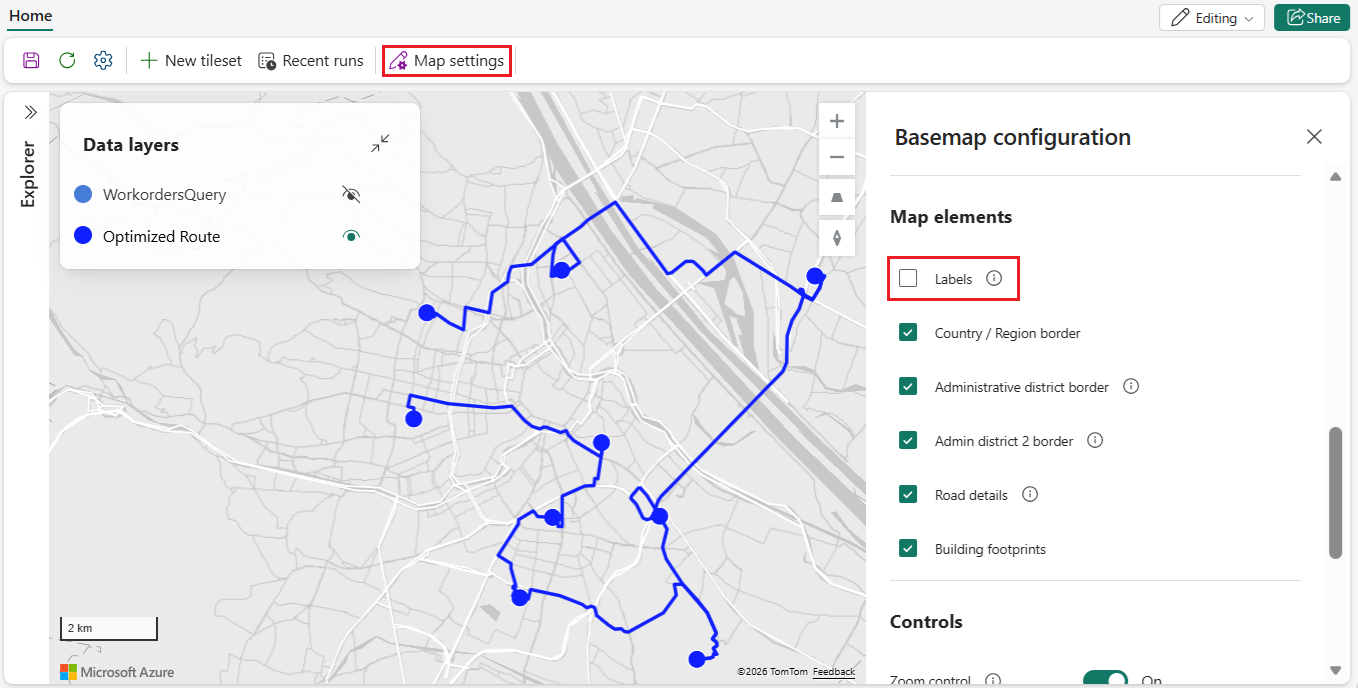

Fjern etiketter på kortniveauet

Når du slår Labels til eller fra på kortniveau, påvirker det basemap-tekstetiketter. Disse betegnelser stammer fra den underliggende kortstil og inkluderer:

- By- og bynavne

- Land- og regionsnavne

- Vej- og vejnavne

- Navne på vandfunktioner (floder, søer, oceaner)

- Andre administrative eller geografiske stednavne

Når Labels ikke vises, fremstår basemap'et "renere" og mere minimalistisk, uden stednavnstekst gengivet på basemappen.

For at slå basemap-etiketter fra:

Åbn dit kort i Fabric Maps.

Vælg Kortindstillinger i menulinjen.

Find afkrydsningsboksen Labels , og fjern markeringen.

For mere information om kortindstillinger i Fabric Maps, se Ædr kortindstillinger

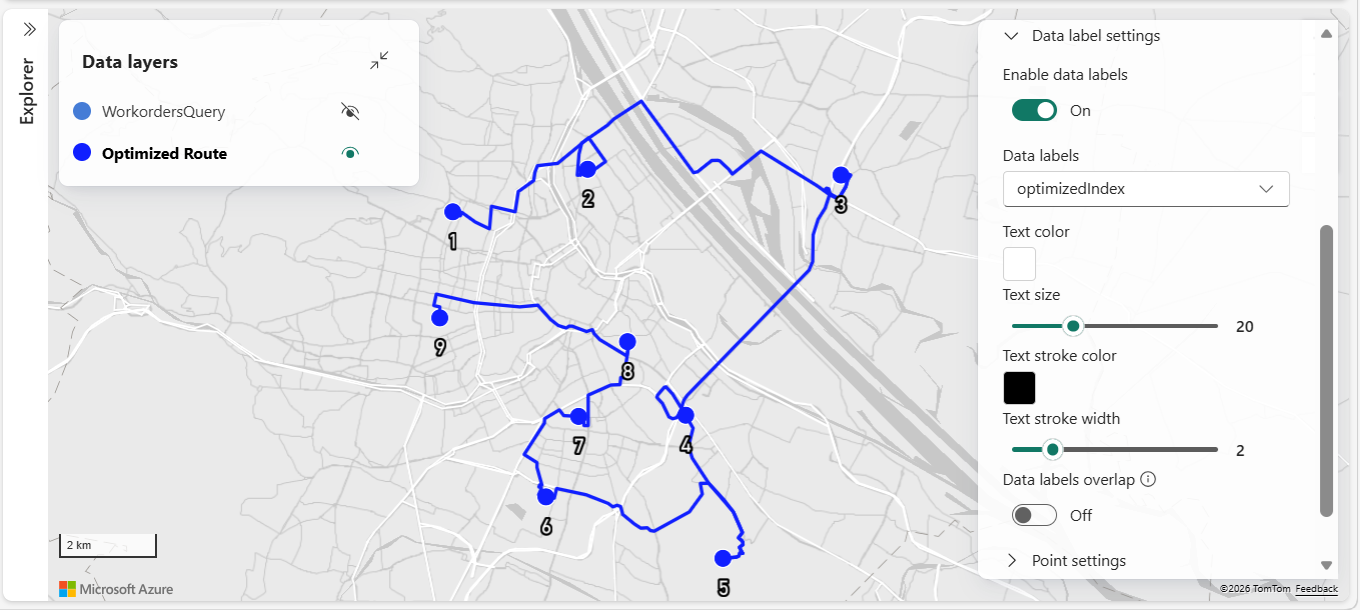

Tilføj datalabels til laget

Datalabels er datadrevne annoteringer, der stammer fra et eller flere felter i lagets datasæt. De er direkte knyttet til lagniveau-kortfunktioner, såsom punkterne på kortet, der repræsenterer arbejdsordreplaceringer. For mere information om Fabric Maps datalabels, se Data label-indstillinger.

Vælg Optimeret rute i Datalagspanelet . Indstillingspanelet Optimeret rute vises i højre side af skærmen.

I panelet Optimerede ruteindstillinger skal du vælge > Datalabel-indstillinger.

Vælg knappen Aktiver dataetiketter for at slå dataetiketter til. Dette viser flere dataetiketter.

Ændr følgende indstillinger for dataetiketter:

- Dataetiketter: optimizedIndex

- Tekstens farve: hvid

- Tekststørrelsesskyder sat til 20

- Tekststregfarve: Sort

- Tekststregbredde-skyderen sat til 2

Resumé

Denne vejledning demonstrerede, hvordan man bygger et end-to-end, realtids arbejdsordre-routingscenarie ved hjælp af Microsoft Fabric Real-Time Intelligence og Fabric Maps. Streaming af arbejdsordredata indlæses, transformeres og forespørges ved hjælp af KQL, hvorefter de visualiseres på et kort for at skabe et dynamisk, kontinuerligt opdaterende overblik over arbejdsordreplaceringer. Ved at integrere routinglogik og optimale stiberegninger viser løsningen, hvordan realtids geospatial analyse kan hjælpe dispatchere og feltdriftsteams med at træffe hurtigere og bedre informerede beslutninger.

Dette mønster kan udvides til andre lokationsbaserede scenarier såsom flådesporing, aktivovervågning og hændelsesrespons. Ved at kombinere hændelsesdrevne data, KQL-baseret analyse og kortbaseret visualisering muliggør Microsoft Fabric en overgang fra rå streamingdata til handlingsorienterede geografiske indsigter i næsten realtid.

Næste trin

For mere information om emner til stofkort dækket i denne vejledning: