Modèles d’application d’IA

Cette section de la documentation vous présente les modèles d’applications AI et les articles associés qui utilisent ces modèles pour démontrer comment effectuer des tâches clés de développement. Les modèles d’application IA vous fournissent des implémentations de référence bien gérées et faciles à déployer, qui constituent un point de départ de qualité pour vos applications IA.

Il existe deux catégories de modèles d’application IA, les blocs de construction et les solutions de bout en bout. Les sections suivantes présentent certains des principaux modèles dans chaque catégorie pour le langage de programmation que vous avez sélectionné en haut de cet article. Pour parcourir une liste plus complète incluant ces modèles et d’autres, veuillez consulter les modèles d’applications AI sur la galerie Azure Developer CLI.

Blocs de construction

Les blocs de construction sont des exemples à plus petite échelle qui se concentrent sur des scénarios et des tâches spécifiques. La plupart des blocs de construction démontrent des fonctionnalités qui tirent parti de la solution de bout en bout pour une application de chat utilisant vos propres données.

| Bloc de construction | Description |

|---|---|

| Équilibrer la charge avec Azure Container Apps | Découvrez comment ajouter l’équilibrage de charge à votre application pour étendre l’application de conversation au-delà des limites de quota relatives aux modèles et aux jetons Azure OpenAI. Cette approche utilise Azure Container Apps pour créer trois points de terminaison Azure OpenAI et un conteneur principal pour diriger le trafic entrant vers l’un de ces trois points de terminaison. |

| Bloc de construction | Description |

|---|---|

| Configurer la sécurité des documents pour l’application de chat | Lorsque vous créez une application de chat en utilisant le modèle RAG avec vos propres données, assurez-vous que chaque utilisateur reçoit une réponse basée sur ses autorisations. Un utilisateur autorisé doit avoir accès aux réponses contenues dans les documents de l’application de chat. Un utilisateur non autorisé ne devrait pas avoir accès aux réponses provenant de documents sécurisés qu’il n’est pas autorisé à voir. |

| Évaluer les réponses de l’application de chat | Apprenez comment évaluer les réponses d’une application de chat par rapport à un ensemble de réponses correctes ou idéales (connues sous le nom de vérité de base). Chaque fois que vous modifiez votre application de chat d’une manière qui affecte les réponses, exécutez une évaluation pour comparer les modifications. Cette application de démonstration offre des outils que vous pouvez utiliser dès aujourd’hui pour faciliter l’exécution des évaluations. |

| Équilibrer la charge avec Azure Container Apps | Découvrez comment ajouter l’équilibrage de charge à votre application pour étendre l’application de conversation au-delà des limites de quota relatives aux modèles et aux jetons Azure OpenAI. Cette approche utilise Azure Container Apps pour créer trois points de terminaison Azure OpenAI et un conteneur principal pour diriger le trafic entrant vers l’un de ces trois points de terminaison. |

| Équilibre de charge avec API Management | Découvrez comment ajouter l’équilibrage de charge à votre application pour étendre l’application de conversation au-delà des limites de quota relatives aux modèles et aux jetons Azure OpenAI. Cette approche utilise Azure API Management pour créer trois points de terminaison Azure OpenAI, ainsi qu’un conteneur principal pour diriger le trafic entrant vers l’un des trois points de terminaison. |

| Tester la charge de l’application de chat Python avec Locust | Découvrez le processus pour effectuer un test de charge sur une application de chat Python utilisant le modèle RAG avec Locust, un outil de test de charge open-source populaire. L’objectif principal du test de charge est de s’assurer que la charge attendue sur votre application de chat ne dépasse pas le quota actuel de Transactions Par Minute (TPM) d’Azure OpenAI. En simulant le comportement des utilisateurs sous une charge lourde, vous pouvez identifier les goulets d’étranglement potentiels et les problèmes de scalabilité dans votre application. |

| Bloc de construction | Description |

|---|---|

| Équilibrer la charge avec Azure Container Apps | Découvrez comment ajouter l’équilibrage de charge à votre application pour étendre l’application de conversation au-delà des limites de quota relatives aux modèles et aux jetons Azure OpenAI. Cette approche utilise Azure Container Apps pour créer trois points de terminaison Azure OpenAI et un conteneur principal pour diriger le trafic entrant vers l’un de ces trois points de terminaison. |

| Bloc de construction | Description |

|---|---|

| Évaluer les réponses de l’application de chat | Apprenez comment évaluer les réponses d’une application de chat par rapport à un ensemble de réponses correctes ou idéales (connues sous le nom de vérité de base). Chaque fois que vous modifiez votre application de chat d’une manière qui affecte les réponses, exécutez une évaluation pour comparer les modifications. Cette application de démonstration offre des outils que vous pouvez utiliser dès aujourd’hui pour faciliter l’exécution des évaluations. |

| Équilibrer la charge avec Azure Container Apps | Découvrez comment ajouter l’équilibrage de charge à votre application pour étendre l’application de conversation au-delà des limites de quota relatives aux modèles et aux jetons Azure OpenAI. Cette approche utilise Azure Container Apps pour créer trois points de terminaison Azure OpenAI et un conteneur principal pour diriger le trafic entrant vers l’un de ces trois points de terminaison. |

| Équilibre de charge avec API Management | Découvrez comment ajouter l’équilibrage de charge à votre application pour étendre l’application de conversation au-delà des limites de quota relatives aux modèles et aux jetons Azure OpenAI. Cette approche utilise Azure API Management pour créer trois points de terminaison Azure OpenAI, ainsi qu’un conteneur principal pour diriger le trafic entrant vers l’un des trois points de terminaison. |

Solutions de bout en bout

Les solutions de bout en bout sont des exemples de référence complets, comprenant la documentation, le code source et le déploiement que vous pouvez utiliser et étendre à vos propres fins.

Discutez avec vos données en utilisant Azure OpenAI et Azure AI Search avec .NET

Ce modèle est une solution complète de bout en bout démontrant le modèle de génération augmentée par récupération (RAG) fonctionnant dans Azure. Il utilise Azure AI Search pour la récupération et les grands modèles de langage Azure OpenAI pour alimenter des expériences de type ChatGPT et Questions & Réponses.

Pour commencer avec ce modèle, veuillez consulter la section Démarrer avec l’exemple de chat utilisant vos propres données pour .NET. Pour accéder au code source et lire des détails approfondis sur le modèle, veuillez consulter le référentiel GitHub azure-search-openai-demo-csharp.

Ce modèle démontre l’utilisation de ces fonctionnalités.

| Solution d’hébergement Azure | Technologies | Modèles IA |

|---|---|---|

| Azure Container Apps Azure Functions |

Azure OpenAI Vision par ordinateur Azure Azure Form Recognizer Recherche Azure AI Stockage Azure |

GPT 3.5 Turbo GPT 4.0 |

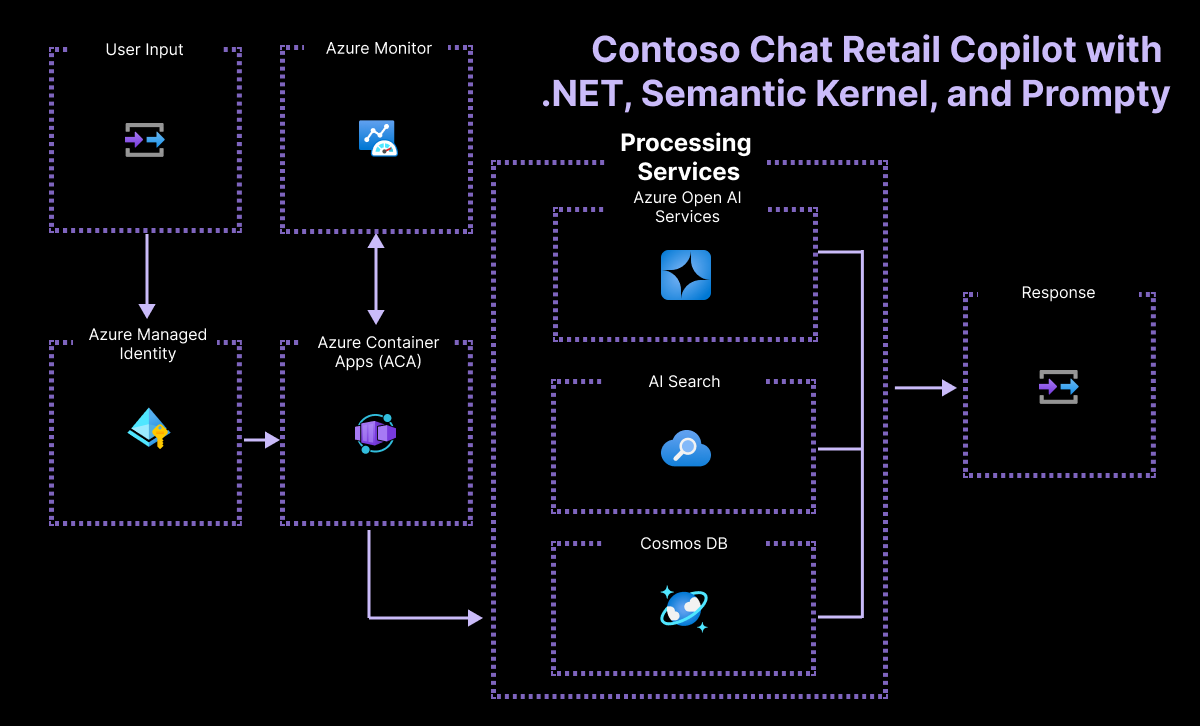

Contoso chat retail Copilot avec .NET et Semantic Kernel

Ce modèle implémente Contoso Outdoors, un magasin conceptuel spécialisé dans l’équipement de plein air pour les amateurs de randonnée et de camping. Ce magasin virtuel améliore l’engagement des clients et le soutien aux ventes grâce à un agent de chat intelligent. Cet agent est alimenté par le modèle de génération augmentée par récupération (RAG) dans la pile Microsoft Azure AI, enrichi avec Semantic Kernel et le support Prompty.

Pour accéder au code source et lire des détails approfondis sur le modèle, veuillez consulter le référentiel GitHub contoso-chat-csharp-prompty.

Ce modèle démontre l’utilisation de ces fonctionnalités.

| Solution d’hébergement Azure | Technologies | Modèles IA |

|---|---|---|

| Azure Container Apps |

Azure OpenAI Microsoft Entra ID Identité managée Azure Azure Monitor Recherche Azure AI Azure AI Studio Azure SQL Stockage Azure |

GPT 3.5 Turbo GPT 4.0 |

Automatisation des processus avec conversion de la parole en texte et résumé avec .NET et GPT 3.5 Turbo

Ce modèle est une solution d’automatisation des processus qui reçoit des problèmes signalés par les travailleurs de terrain et de l’atelier dans une entreprise appelée Contoso Manufacturing, une entreprise de fabrication de batteries de voiture. Les problèmes sont partagés par les travailleurs soit en direct via l’entrée du microphone, soit pré-enregistrés sous forme de fichiers audio. La solution traduit l’entrée audio de la parole en texte, puis utilise un LLM et Prompty ou Promptflow pour résumer le problème et renvoyer les résultats dans un format spécifié par la solution.

Pour accéder au code source et lire des détails approfondis sur le modèle, veuillez consulter le référentiel GitHub summarization-openai-csharp-prompty.

Ce modèle démontre l’utilisation de ces fonctionnalités.

| Solution d’hébergement Azure | Technologies | Modèles IA |

|---|---|---|

| Azure Container Apps | Reconnaissance vocale Résumé Azure OpenAI |

GPT 3.5 Turbo |

Discutez avec vos données en utilisant Azure OpenAI et Azure AI Search avec Python

Ce modèle est une solution complète de bout en bout démontrant le modèle de génération augmentée par récupération (RAG) fonctionnant dans Azure. Il utilise Azure AI Search pour la récupération et les grands modèles de langage Azure OpenAI pour alimenter des expériences de type ChatGPT et Questions & Réponses.

Pour commencer avec ce modèle, veuillez consulter la section Démarrer avec l’exemple de chat utilisant vos propres données pour Python. Pour accéder au code source et lire des détails approfondis sur le modèle, veuillez consulter le référentiel GitHub azure-search-openai-demo.

Ce modèle démontre l’utilisation de ces fonctionnalités.

| Solution d’hébergement Azure | Technologies | Modèles IA |

|---|---|---|

| Azure App Service | Azure OpenAI Recherche Bing Identité managée Azure Azure Monitor Recherche Azure AI Azure AI Studio |

GPT 3.5 Turbo GPT 4.0 DALL-E |

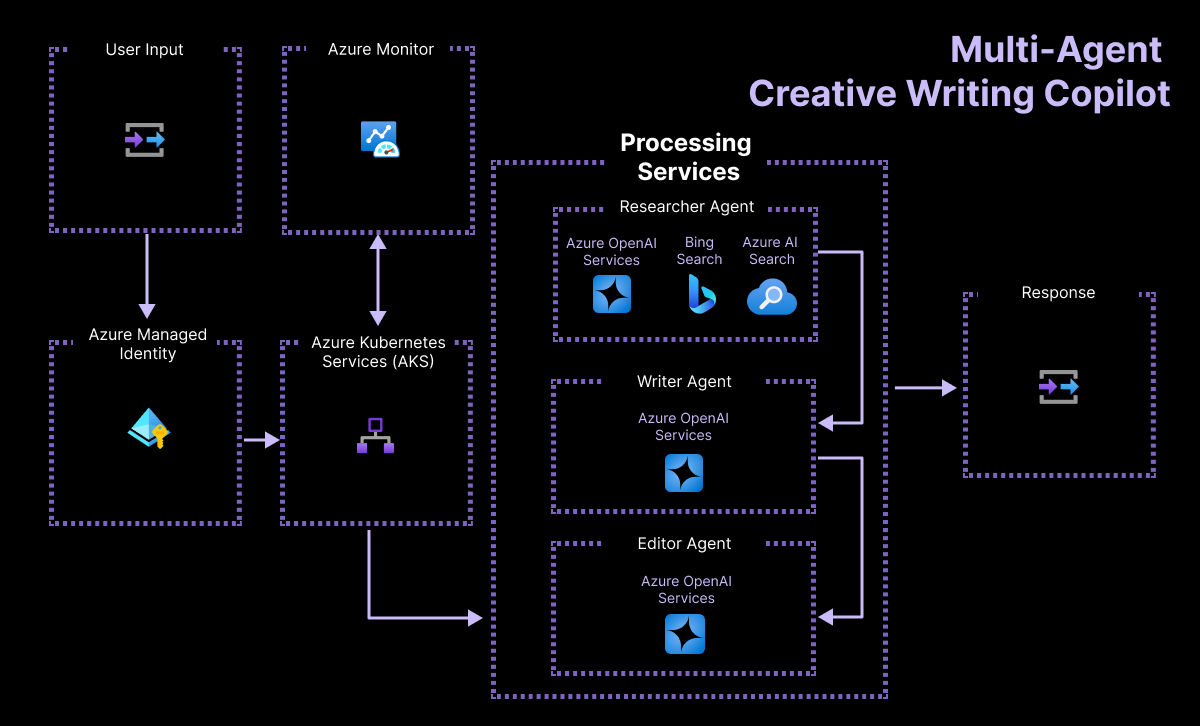

Copilote d’écriture créative multimodale avec DALL-E

Ce modèle est une solution d’écriture créative multi-agent pour aider les utilisateurs à rédiger des articles. Il démontre comment créer et travailler avec des agents AI pilotés par Azure OpenAI. Il inclut une application Flask qui prend un sujet et une instruction d’un utilisateur, puis appelle un agent de recherche qui utilise l’API Bing Search pour rechercher le sujet, un agent de produit qui utilise Azure AI Search pour effectuer une recherche de similarité sémantique pour des produits associés à partir d’un magasin vectoriel, un agent rédacteur pour combiner les informations de recherche et de produit dans un article utile, et un agent éditeur pour affiner l’article qui est finalement présenté à l’utilisateur.

Pour accéder au code source et lire des détails approfondis sur le modèle, veuillez consulter le référentiel GitHub agent-openai-python-prompty.

Ce modèle démontre l’utilisation de ces fonctionnalités.

| Solution d’hébergement Azure | Technologies | Modèles IA |

|---|---|---|

| Registre de conteneurs Azure Azure Kubernetes |

Azure OpenAI Recherche Bing Identité managée Azure Azure Monitor Recherche Azure AI Azure AI Studio |

GPT 3.5 Turbo GPT 4.0 DALL-E |

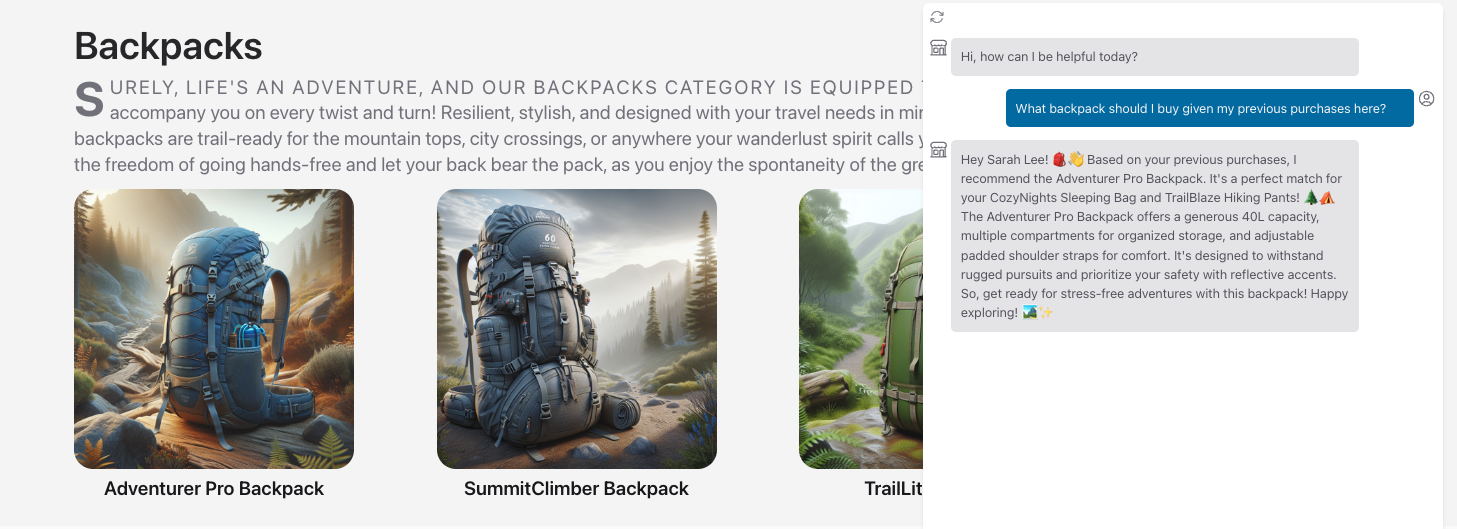

Contoso Chat Retail Copilot avec AI Studio

Ce modèle est une solution de chat pour les ventes et le support client. Il démontre comment construire une application de grand modèle de langage (LLM) avec une architecture RAG (Retrieval Augmented Generation) utilisant Azure AI Studio et Flux d’invite.

Pour accéder au code source et lire des détails approfondis sur le modèle, veuillez consulter le référentiel GitHub contoso-chat.

Ce modèle démontre l’utilisation de ces fonctionnalités.

| Solution d’hébergement Azure | Technologies | Modèles IA |

|---|---|---|

| Azure Container Apps |

Azure OpenAI Recherche Azure AI Azure AI Studio Azure Cosmos DB |

GPT 3.5 Turbo GPT 4.0 Runtime d’intégration géré (MIR) |

Automatisation des processus avec conversion de la parole en texte et résumé avec AI Studio

Ce modèle est une solution d’automatisation des processus qui reçoit des problèmes signalés par les travailleurs de terrain et de l’atelier dans une entreprise appelée Contoso Manufacturing, une entreprise de fabrication de batteries de voiture. Les problèmes sont partagés par les travailleurs soit en direct via l’entrée du microphone, préenregistrés sous forme de fichiers audio ou sous forme de texte. La solution traduit l’entrée audio de la parole en texte, puis utilise les rapports texte comme entrée pour un LLM et Prompty/Promptflow pour résumer le problème et renvoyer les résultats dans un format spécifié par la solution.

Pour accéder au code source et lire des détails approfondis sur le modèle, veuillez consulter le référentiel GitHub summarization-openai-python-prompflow.

Ce modèle démontre l’utilisation de ces fonctionnalités.

| Solution d’hébergement Azure | Technologies | Modèles IA |

|---|---|---|

| Azure Container Apps | Azure AI Studio Service de conversion de la parole en texte Flux d’invite Runtime d’intégration géré (MIR) |

GPT 3.5 Turbo |

Appel de fonction avec Prompty, LangChain et Elastic Search

Ce modèle est une application qui utilise Prompty, Langchain et Elasticsearch pour construire un agent de recherche de grand modèle de langage (LLM). Cet agent avec la technologie Retrieval Augmented Generation (RAG) est capable de répondre aux questions des utilisateurs sur la base des données fournies en intégrant la récupération d’informations en temps réel avec des réponses génératives.

Pour accéder au code source et lire des détails approfondis sur le modèle, veuillez consulter le référentiel GitHub agent-python-openai-prompty-langchain.

Ce modèle démontre l’utilisation de ces fonctionnalités.

| Solution d’hébergement Azure | Technologies | Modèles IA |

|---|---|---|

| Machine Learning Service | Azure AI Studio Recherche élastique Microsoft Entra ID Identité managée Azure Azure Monitor Stockage Azure Azure AI Studio Runtime d’intégration géré (MIR) |

GPT 3.5 Turbo |

Appel de fonction avec Prompty, LangChain et Pinecone

Ce modèle utilise le nouvel outil Prompty, Langchain et Pinecone pour construire un agent de recherche de grand modèle de langage (LLM). Cet agent avec la technologie Retrieval Augmented Generation (RAG) est capable de répondre aux questions des utilisateurs sur la base des données fournies en intégrant la récupération d’informations en temps réel avec des réponses génératives.

Pour accéder au code source et lire des détails approfondis sur le modèle, veuillez consulter le référentiel GitHub agent-openai-python-prompty-langchain-pinecone.

Ce modèle démontre l’utilisation de ces fonctionnalités.

| Solution d’hébergement Azure | Technologies | Modèles IA |

|---|---|---|

| Azure Container Apps | Pinecone Microsoft Entra ID Identité gérée par Microsoft Azure Monitor Stockage Azure |

GPT 3.5 Turbo |

Copilote analytique de l’API Assistant avec Python et Azure AI Studio

Ce modèle est une API d’assistant pour discuter avec des données tabulaires et effectuer des analyses en langage naturel. Pour accéder au code source et lire des détails approfondis sur le modèle, veuillez consulter le référentiel GitHub assistant-data-openai-python-promptflow.

Ce modèle démontre l’utilisation de ces fonctionnalités.

| Solution d’hébergement Azure | Technologies | Modèles IA |

|---|---|---|

| Machine Learning Service | Recherche Azure AI Azure AI Studio Runtime d’intégration géré (MIR) Azure OpenAI |

GPT 3.5 Turbo GPT 4 |

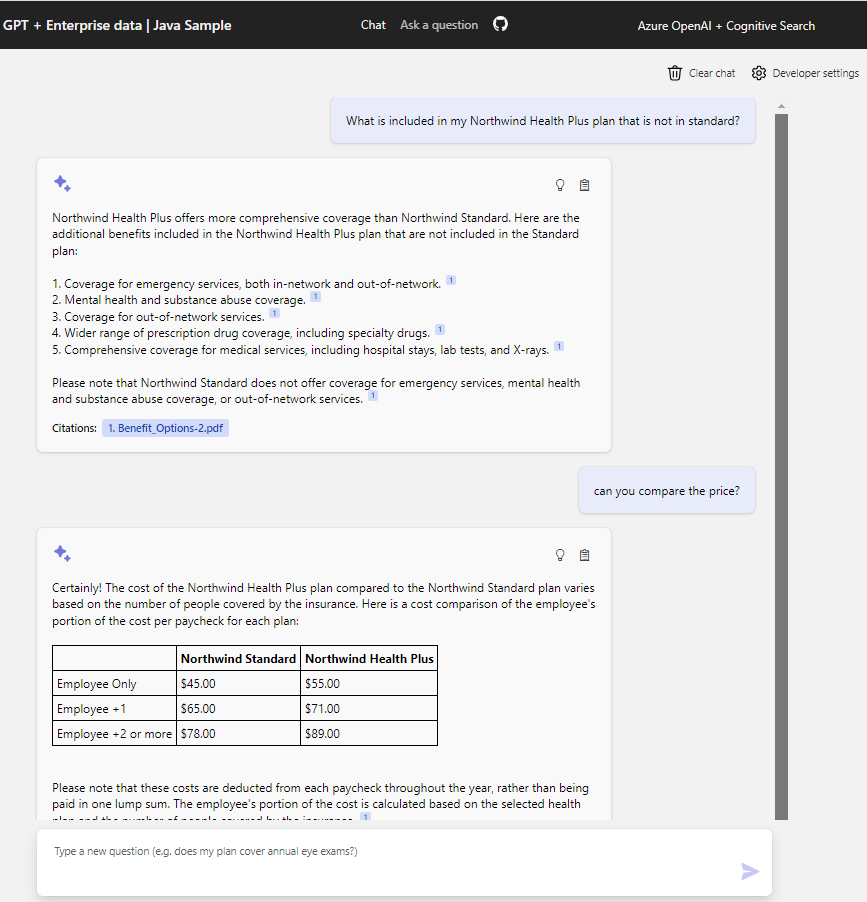

Discutez avec vos données en utilisant Azure OpenAI et Azure AI Search avec Java

Ce modèle est une solution complète de bout en bout qui démontre le modèle de génération augmentée par récupération (RAG) fonctionnant dans Azure. Il utilise Azure AI Search pour la récupération et les grands modèles de langage Azure OpenAI pour alimenter des expériences de type ChatGPT et Questions & Réponses.

Pour commencer avec ce modèle, veuillez consulter la section Démarrer avec l’exemple de chat utilisant vos propres données pour Java. Pour accéder au code source et lire des détails approfondis sur le modèle, veuillez consulter le référentiel GitHub azure-search-openai-demo-java.

Ce modèle démontre l’utilisation de ces fonctionnalités.

| Solution d’hébergement Azure | Technologies | Modèles IA |

|---|---|---|

| Azure App Service Azure Container Apps Azure Kubernetes Service |

Azure OpenAI Recherche Azure AI Stockage Azure Azure Monitor |

Discutez avec vos données en utilisant Azure OpenAI et Azure AI Search avec JavaScript

Ce modèle est une solution complète de bout en bout démontrant le modèle de génération augmentée par récupération (RAG) fonctionnant dans Azure. Il utilise Azure AI Search pour la récupération et les grands modèles de langage Azure OpenAI pour alimenter des expériences de type ChatGPT et Questions & Réponses.

Pour commencer avec ce modèle, veuillez consulter la section Démarrer avec l’exemple de chat utilisant vos propres données pour JavaScript. Pour accéder au code source et lire des détails approfondis sur le modèle, veuillez consulter le référentiel GitHub azure-search-openai-javascript.

Ce modèle démontre l’utilisation de ces fonctionnalités.

| Solution d’hébergement Azure | Technologies | Modèles IA |

|---|---|---|

| Azure Container Apps Azure Static Web Apps |

Azure OpenAI Recherche Azure AI Stockage Azure Azure Monitor |

text-embedding-ada-002 |

Frontend de chat Azure OpenAI

Ce modèle est un composant web de chat OpenAI minimal qui peut être connecté à n’importe quelle implémentation backend en tant que client.

Pour accéder au code source et lire des détails approfondis sur le modèle, veuillez consulter le référentiel GitHub azure-openai-chat-frontend.

Ce modèle démontre l’utilisation de ces fonctionnalités.

| Solution d’hébergement Azure | Technologies | Modèles IA |

|---|---|---|

| Azure Static Web Apps | Azure AI Search Azure OpenAI |

GPT 3.5 Turbo GPT4 |

Chat AI Serverless avec RAG utilisant LangChain.js

Le modèle est un chatbot AI serverless avec génération augmentée par récupération utilisant LangChain.js et Azure qui utilise un ensemble de documents d’entreprise pour générer des réponses aux requêtes des utilisateurs. Il utilise une entreprise fictive appelée Contoso Real Estate, et l’expérience permet à ses clients de poser des questions de support sur l’utilisation de ses produits. Les données d’exemple incluent un ensemble de documents qui décrit ses conditions d’utilisation, sa politique de confidentialité et un guide de support.

Pour apprendre comment déployer et exécuter ce modèle, veuillez consulter la section Démarrer avec le chat AI Serverless avec RAG utilisant LangChain.js. Pour accéder au code source et lire des détails approfondis sur le modèle, veuillez consulter le référentiel GitHub serverless-chat-langchainjs.

Apprenez comment déployer et exécuter ce modèle de référence JavaScript.

Ce modèle démontre l’utilisation de ces fonctionnalités.

| Solution d’hébergement Azure | Technologies | Modèles IA |

|---|---|---|

| Azure Static Web Apps Azure Functions |

Azure AI Search Azure OpenAI Azure Cosmos DB Stockage Azure Identité managée Azure |

GPT4 Mistral Ollama |