Catatan

Akses ke halaman ini memerlukan otorisasi. Anda dapat mencoba masuk atau mengubah direktori.

Akses ke halaman ini memerlukan otorisasi. Anda dapat mencoba mengubah direktori.

Editor tanpa kode memudahkan untuk mengembangkan tugas Stream Analytics untuk memproses data streaming real time Anda. Gunakan fungsi seret dan lepas tanpa menulis kode. Pengalaman ini menyediakan kanvas tempat Anda dapat terhubung ke sumber input untuk melihat data streaming Anda dengan cepat. Kemudian Anda dapat mengubahnya sebelum mengirimkan ke tujuan Anda.

Dengan menggunakan editor tanpa kode, Anda dapat dengan mudah:

- Ubah skema input.

- Lakukan operasi persiapan data seperti join dan filter.

- Pendekatan skenario lanjutan seperti agregasi jendela waktu (jendela tumbling, hopping, dan sesi) untuk operasi grup demi grup.

Setelah membuat dan menjalankan pekerjaan Analisis Aliran, Anda dapat mengoperasikan beban kerja produksi dengan mudah. Gunakan kumpulan metrik bawaan yang tepat untuk tujuan pemantauan dan pemecahan masalah. Pekerjaan Stream Analytics ditagih sesuai dengan model penetapan harga ketika sedang berjalan.

Prasyarat

Sebelum mengembangkan pekerjaan Azure Stream Analytics dengan menggunakan editor tanpa kode, pastikan Anda memenuhi persyaratan berikut:

- Sumber input streaming dan sumber daya tujuan target untuk pekerjaan Azure Stream Analytics harus dapat diakses secara publik dan tidak dapat berada di jaringan virtual Azure.

- Anda harus memiliki izin yang diperlukan untuk mengakses sumber daya input dan output streaming.

- Anda harus mempertahankan izin untuk membuat dan mengubah sumber daya Azure Stream Analytics.

Catatan

Editor tanpa kode saat ini tidak tersedia di wilayah Tiongkok.

Pekerjaan Azure Stream Analytics

Pekerjaan Analisis Aliran dibuat di atas tiga komponen utama: input streaming, transformasi, dan output. Anda dapat menyertakan komponen sebanyak yang Anda inginkan, seperti beberapa input, cabang paralel dengan beberapa transformasi, dan beberapa output. Untuk informasi selengkapnya, lihat Dokumentasi Azure Stream Analytics.

Catatan

Fungsionalitas dan jenis output berikut tidak tersedia saat Anda menggunakan editor tanpa kode:

- Fungsi yang ditentukan pengguna.

- Pengeditan kueri di halaman kueri Azure Stream Analytics. Namun, Anda bisa menampilkan kueri yang dihasilkan oleh editor tanpa kode di halaman kueri.

- Menambahkan input dan output di halaman input dan output Azure Stream Analytics. Namun, Anda dapat melihat input dan output yang dihasilkan oleh editor tanpa kode di halaman input dan output.

- Jenis output berikut tidak tersedia: Azure Function, Azure Data Lake Storage Gen1, PostgreSQL DB, Bus Layanan queue/topic, Table storage.

Untuk mengakses editor tanpa kode untuk membangun pekerjaan analisis aliran Anda, gunakan salah satu pendekatan berikut:

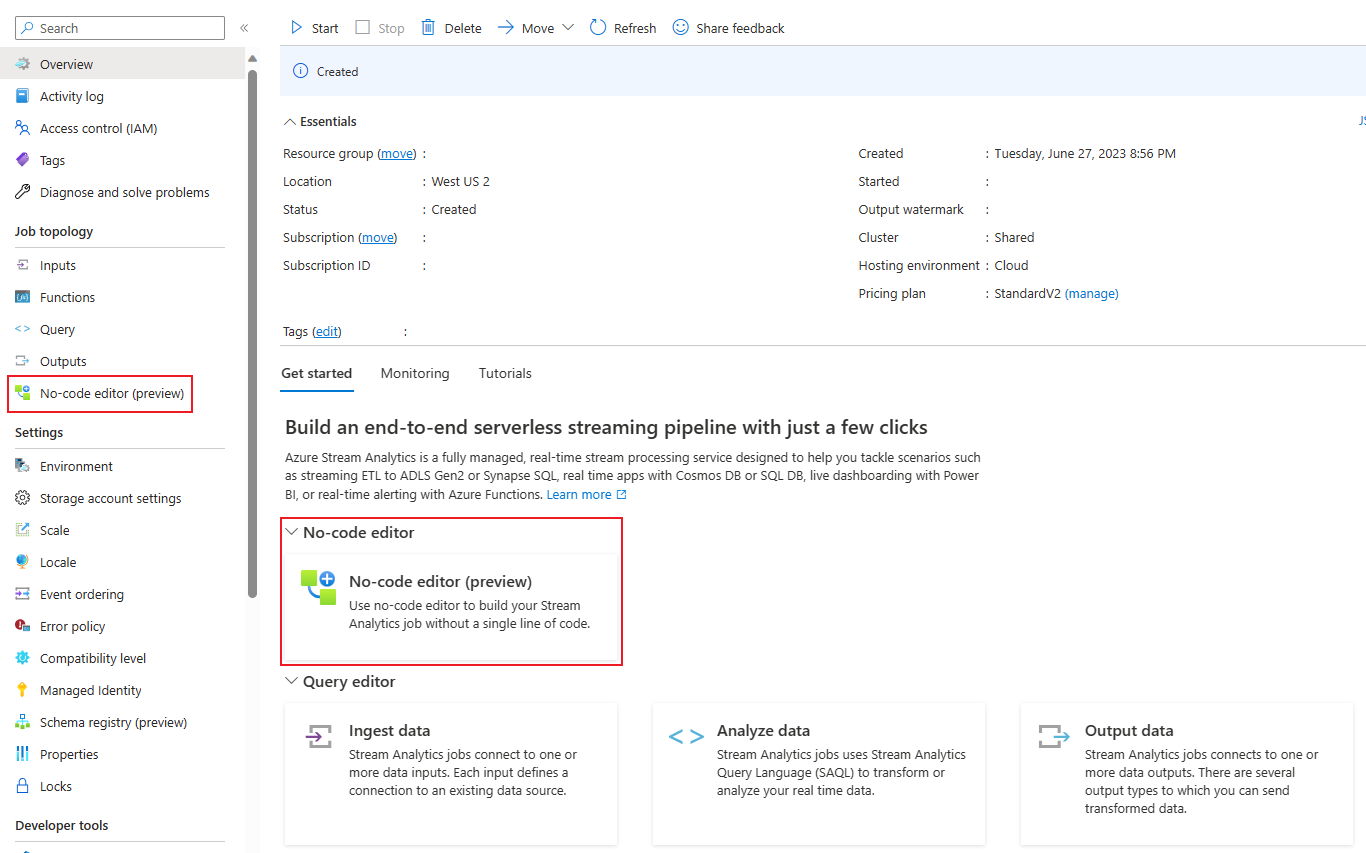

Melalui portal Azure Stream Analytics (pratinjau): Buat pekerjaan Azure Stream Analytics, lalu pilih editor tanpa kode di tab Mulai di halaman Gambaran Umum , atau pilih Editor tanpa kode di panel kiri.

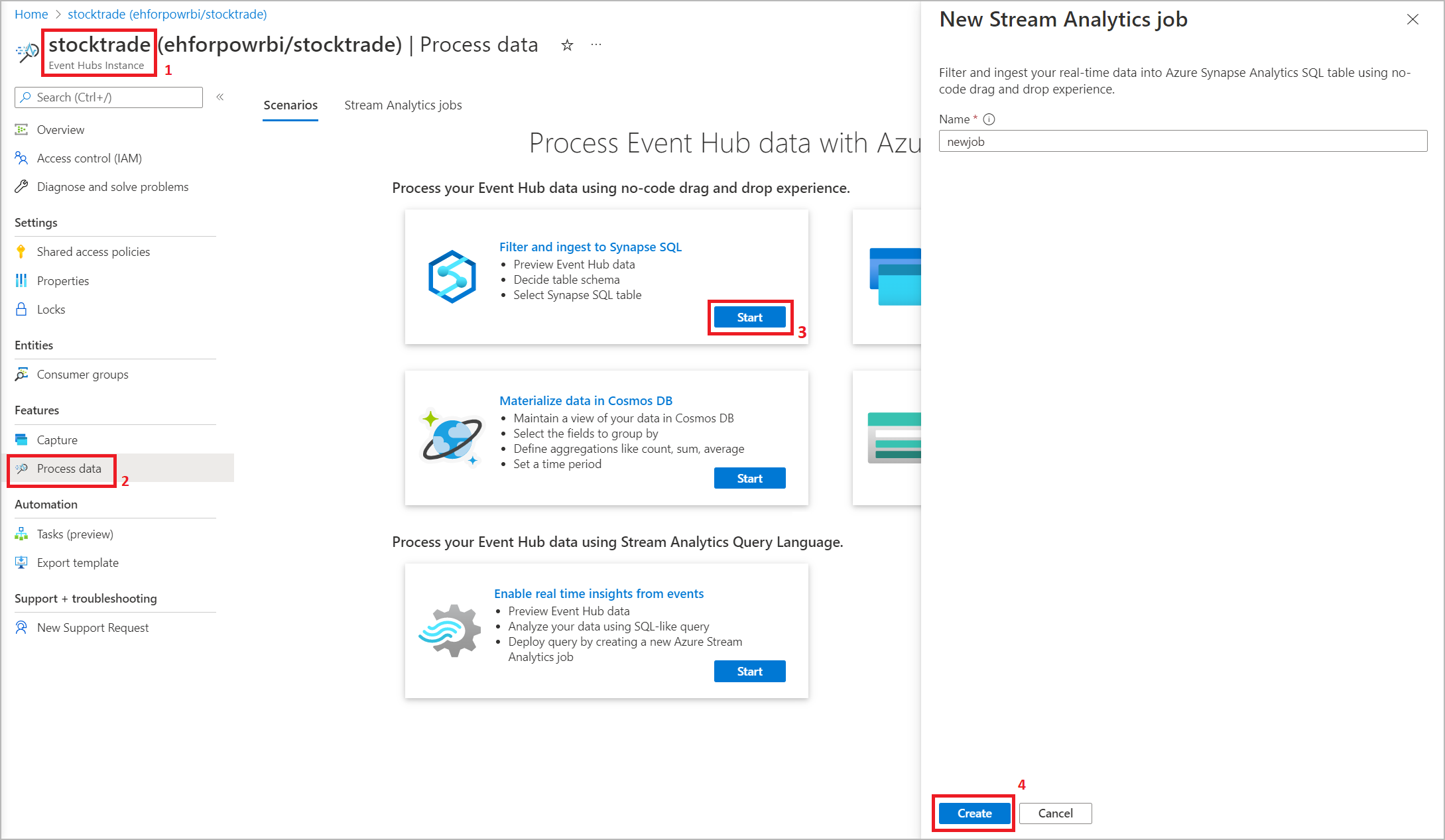

Melalui portal Azure Event Hubs: Buka instans Azure Event Hubs. Pilih Proses Data, lalu pilih templat yang telah ditentukan sebelumnya.

Templat yang telah ditentukan sebelumnya dapat membantu Anda mengembangkan dan menjalankan pekerjaan untuk mengatasi berbagai skenario, termasuk:

- Mengambil data dari Azure Event Hubs dalam format Delta Lake (pratinjau)

- Pemfilteran dan penyerapan ke Azure Synapse SQL

- Menangkap data Azure Event Hubs Anda dalam format Parquet di Azure Data Lake Storage Gen2

- Mewujudkan data di Azure Cosmos DB

- Memfilter dan menyerap ke Azure Data Lake Storage Gen2

- Memperkaya data dan memasukkan ke event hub

- Mengubah dan menyimpan data ke database Azure SQL

- Memfilter dan menyerap ke Azure Data Explorer

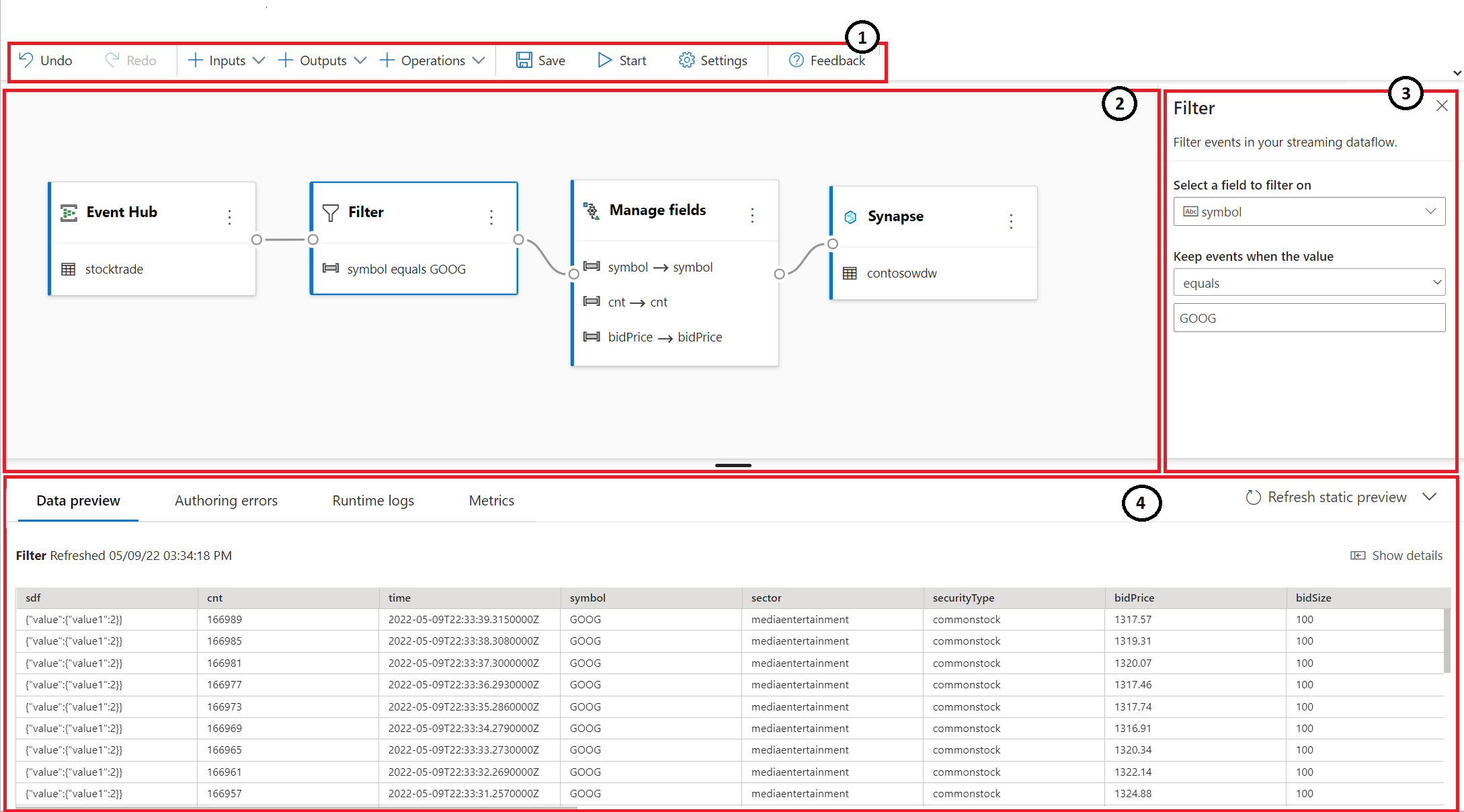

Cuplikan layar berikut menunjukkan pekerjaan Azure Stream Analytics yang telah selesai. Ini menyoroti semua bagian yang tersedia untuk Anda saat Anda menulis.

- Pita: Pada pita, bagian-bagian mengikuti urutan proses analitik klasik: event hub sebagai input (juga dikenal sebagai sumber data), transformasi (streaming Extract, Transform, dan Load), output, tombol untuk menyimpan kemajuan, dan tombol untuk memulai pekerjaan.

- Tampilan diagram: Tampilan ini adalah representasi grafis dari pekerjaan Azure Stream Analytics Anda, dari input hingga operasi hingga output.

- Panel samping: Bergantung pada komponen mana yang Anda pilih dalam tampilan diagram, Anda akan melihat pengaturan untuk mengubah input, transformasi, atau output.

- Tab untuk pratinjau data, kesalahan penulisan, log runtime, dan metrik: Untuk setiap bagian, pratinjau data menunjukkan hasil untuk langkah tersebut (secara real-time untuk input; transformasi dan output sesuai permintaan). Bagian ini juga merangkum kesalahan atau peringatan penulisan yang mungkin Anda dapatkan dalam pekerjaan Anda saat dikembangkan. Memilih setiap kesalahan atau peringatan akan memilih transformasi tersebut. Ini juga menyediakan metrik pekerjaan bagi Anda untuk memantau kesehatan pekerjaan yang sedang berjalan.

Masukan data streaming

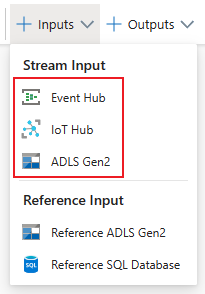

Editor tanpa kode mendukung input data streaming dari tiga jenis sumber daya:

- Azure Event Hubs

- Azure IoT Hub

- Azure Data Lake Storage Gen2

Untuk informasi selengkapnya tentang input data streaming, lihat Mengalirkan data sebagai input ke Azure Stream Analytics.

Catatan

Editor tanpa kode di portal Azure Event Hubs hanya memiliki Event Hub sebagai opsi input.

Azure Event Hubs sebagai input streaming

Azure Event Hubs adalah platform streaming big data dan layanan pencernaan peristiwa. Layanan ini dapat menerima dan memproses jutaan peristiwa per detik. Anda dapat mengubah dan menyimpan data yang dikirim ke pusat aktivitas melalui penyedia analitik real-time atau adaptor batching dan penyimpanan.

Untuk mengonfigurasi pusat aktivitas sebagai input untuk pekerjaan Anda, pilih ikon Pusat Aktivitas. Ubin muncul dalam tampilan diagram, termasuk panel samping untuk konfigurasi dan koneksinya.

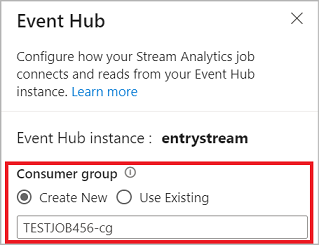

Saat Anda terhubung ke pusat acara di editor No-Code, buat grup konsumen baru (yang merupakan opsi default). Pendekatan ini membantu mencegah event hub mencapai batas pembaca secara bersamaan. Untuk memahami selengkapnya tentang grup konsumen dan apakah Anda harus memilih grup konsumen yang sudah ada atau membuat yang baru, lihat Grup konsumen.

Jika hub peristiwa Anda berada di tingkat Dasar, Anda hanya dapat menggunakan grup konsumen $Default yang ada. Jika pusat aktivitas Anda berada di tingkat Standar atau Premium, Anda dapat membuat grup konsumen baru.

Saat Anda tersambung ke Event Hub, jika Anda memilih Managed Identity sebagai mode autentikasi, peran Pemilik Data Azure Event Hubs diberikan ke identitas terkelola untuk job Stream Analytics. Untuk mempelajari selengkapnya tentang identitas terkelola untuk event hub, lihat Menggunakan identitas terkelola untuk mengakses event hub dari pekerjaan Azure Stream Analytics.

Identitas terkelola menghilangkan batasan metode autentikasi berbasis pengguna. Batasan ini termasuk kebutuhan untuk mengautentikasi ulang karena perubahan kata sandi atau kedaluwarsa token pengguna yang terjadi setiap 90 hari.

Setelah menyiapkan detail pusat aktivitas dan memilih Sambungkan, Anda bisa menambahkan bidang secara manual dengan menggunakan + Tambahkan bidang jika Anda mengetahui nama bidang. Untuk mendeteksi bidang dan jenis data secara otomatis berdasarkan sampel pesan masuk, pilih Bidang deteksi otomatis. Memilih simbol gear memungkinkan Anda mengedit kredensial jika diperlukan.

Saat pekerjaan Stream Analytics mendeteksi bidang, Anda akan melihatnya dalam daftar. Anda juga melihat pratinjau langsung pesan masuk dalam tabel Pratinjau Data di bawah tampilan diagram.

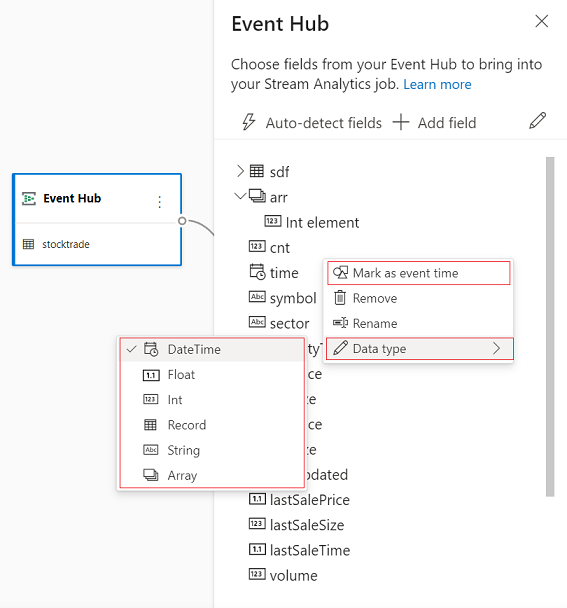

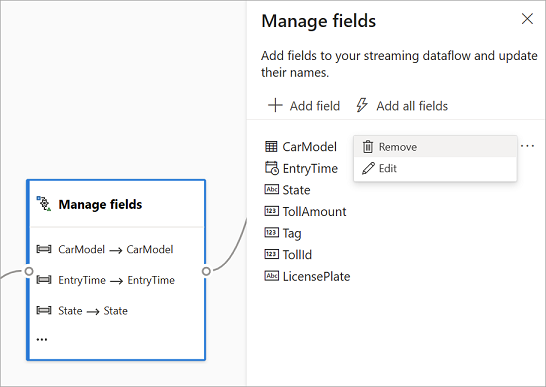

Mengubah data input

Anda dapat mengedit nama bidang, menghapus bidang, mengubah tipe data, atau mengubah waktu peristiwa (Tandai sebagai waktu peristiwa: klausa TIMESTAMP BY jika bidang jenis tanggalwaktu) dengan memilih simbol tiga titik di samping setiap bidang. Anda juga dapat memperluas, memilih, dan mengedit bidang berlapis apa pun dari pesan masuk, seperti yang ditunjukkan pada gambar berikut.

Petunjuk

Proses ini juga berlaku untuk data input dari Azure IoT Hub dan Azure Data Lake Storage Gen2.

Jenis data yang tersedia adalah:

- DateTime: Bidang tanggal dan waktu dalam format ISO.

- Float: Angka desimal.

- Int: Bilangan bulat.

- Rekaman: Objek berlapis dengan beberapa rekaman.

- String: Teks.

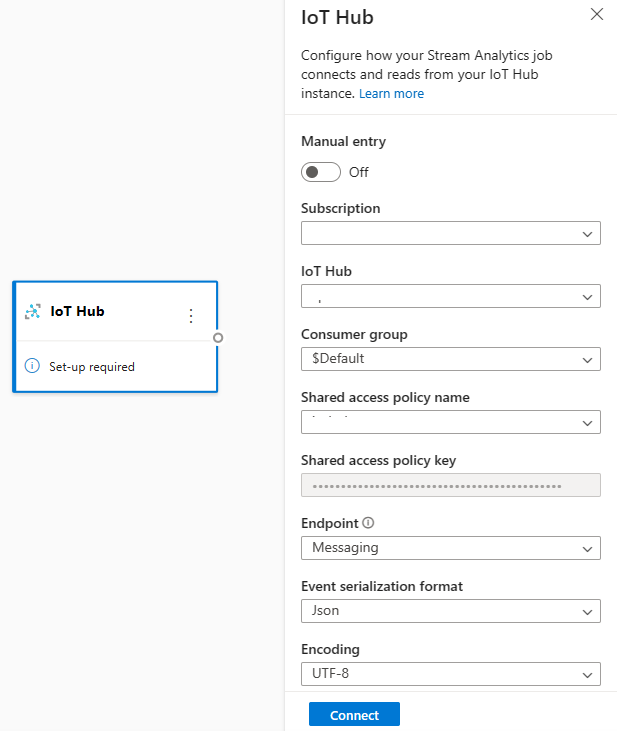

Azure IoT Hub sebagai input streaming

Azure IoT Hub adalah layanan terkelola yang di-hosting di cloud yang bertindak sebagai hub pesan utama untuk komunikasi antara aplikasi IoT dan perangkat yang terpasang. Anda dapat menggunakan data perangkat IoT yang dikirim ke hub IoT sebagai input untuk pekerjaan Azure Stream Analytics.

Catatan

Anda dapat menggunakan input Azure IoT Hub di editor tanpa kode di portal Azure Stream Analytics.

Untuk menambahkan hub IoT sebagai input streaming untuk pekerjaan Anda, pilih IoT Hub di bawah Input dari pita. Kemudian isi informasi yang diperlukan di panel kanan untuk menyambungkan IoT hub ke pekerjaan Anda. Untuk mempelajari selengkapnya tentang detail setiap bidang, lihat Mengalirkan data dari IoT Hub ke Azure Stream Analytics job.

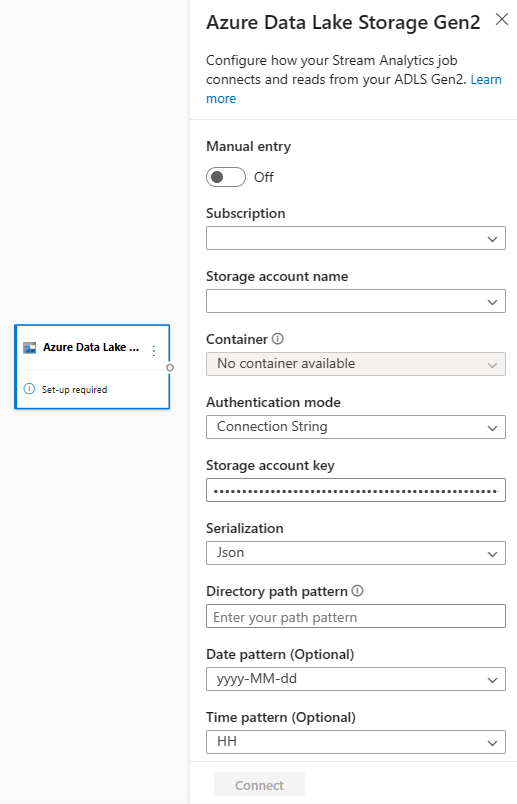

Azure Data Lake Storage Gen2 sebagai input streaming

Azure Data Lake Storage Gen2 (ADLS Gen2) adalah solusi data lake perusahaan berbasis cloud. Ini dirancang untuk menyimpan sejumlah besar data dalam format apa pun, dan untuk memfasilitasi beban kerja analitik big data. Azure Stream Analytics dapat memproses data yang disimpan di ADLS Gen2 sebagai aliran data. Untuk mempelajari selengkapnya tentang jenis input ini, lihat Mengalirkan data dari ADLS Gen2 ke pekerjaan Azure Stream Analytics.

Catatan

Anda dapat menggunakan input Azure Data Lake Storage Gen2 di editor tanpa kode di portal Azure Stream Analytics.

Untuk menambahkan ADLS Gen2 sebagai input streaming untuk pekerjaan Anda, pilih ADLS Gen2 di bawah Input dari pita. Kemudian isi informasi yang diperlukan di panel kanan untuk menyambungkan ADLS Gen2 ke pekerjaan Anda. Untuk mempelajari selengkapnya tentang detail setiap bidang, lihat Mengalirkan data dari ADLS Gen2 ke pekerjaan Azure Stream Analytics.

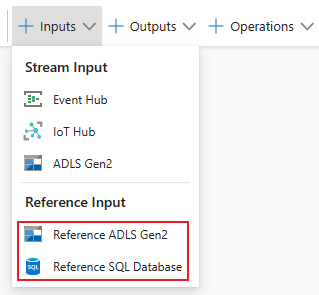

Input data referensi

Data referensi bersifat statis atau berubah lambat dari waktu ke waktu. Biasanya, Anda menggunakannya untuk memperkaya aliran masuk dan melakukan pencarian dalam pekerjaan Anda. Misalnya, Anda mungkin menggabungkan input aliran data untuk mereferensikan data, seperti halnya Anda akan melakukan gabungan SQL untuk mencari nilai statis. Untuk informasi selengkapnya tentang input data referensi, lihat Menggunakan data referensi untuk pencarian di Azure Stream Analytics.

Editor tanpa kode sekarang mendukung dua sumber data referensi:

- Azure Data Lake Storage Gen2

- Azure SQL Database

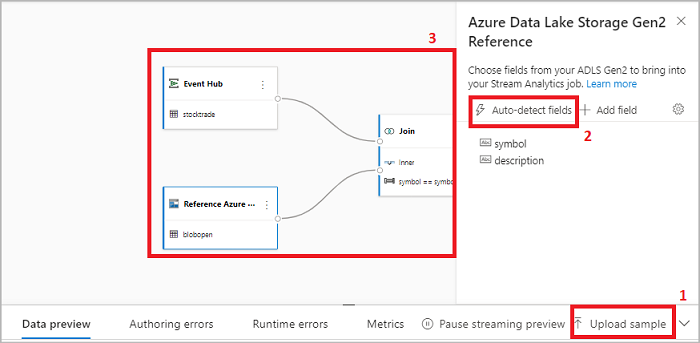

Azure Data Lake Storage Gen2 sebagai data referensi

Data referensi model sebagai urutan blob dalam urutan naik kombinasi tanggal dan waktu yang ditentukan dalam nama blob. Anda dapat menambahkan blob ke akhir urutan hanya dengan menggunakan tanggal dan waktu yang lebih besar dari blob terakhir yang ditentukan dalam urutan. Tentukan blob dalam konfigurasi input.

Pertama, di bawah bagian Input pada pita, pilih Referensi ADLS Gen2. Untuk melihat detail tentang setiap bidang, lihat bagian tentang Azure Blob Storage di Menggunakan data referensi untuk pencarian di Azure Stream Analytics.

Kemudian, unggah file array JSON. Sistem mendeteksi bidang. Gunakan data referensi ini untuk melakukan transformasi dengan data input streaming dari Azure Event Hubs.

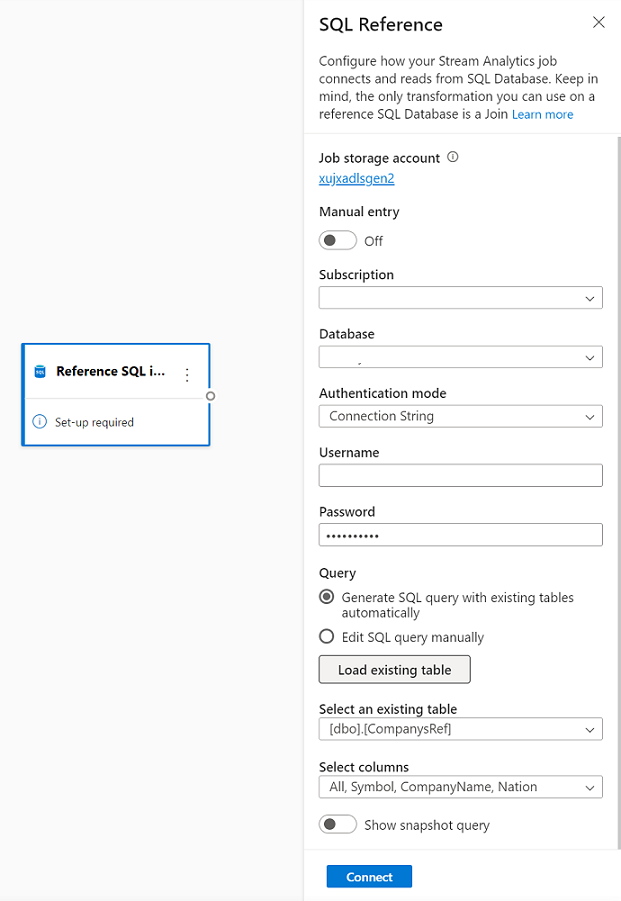

Azure SQL Database sebagai data referensi

Anda dapat menggunakan Azure SQL Database sebagai data referensi untuk pekerjaan Azure Stream Analytics Anda di editor tanpa kode. Untuk informasi selengkapnya, lihat bagian tentang SQL Database di Menggunakan data referensi untuk pencarian di Azure Stream Analytics.

Untuk mengonfigurasi SQL Database sebagai input data referensi, pilih Referensi SQL Database di bawah bagian Input pada pita. Lalu isi informasi untuk menyambungkan database referensi Anda dan pilih tabel dengan kolom yang Anda butuhkan. Anda juga dapat mengambil data referensi dari tabel Anda dengan mengedit kueri SQL secara manual.

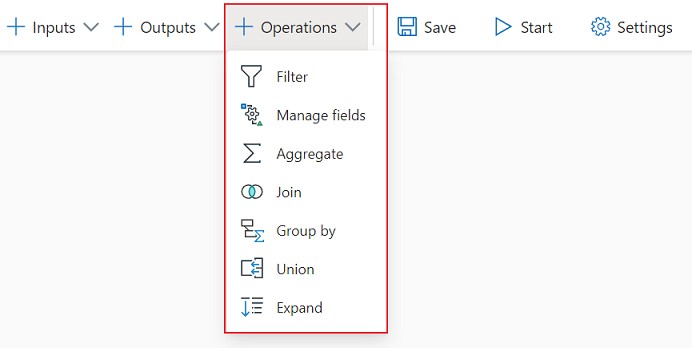

Transformasi

Transformasi data streaming secara inheren berbeda dari transformasi data batch. Hampir semua data streaming memiliki komponen waktu, yang memengaruhi tugas persiapan data apa pun yang terlibat.

Untuk menambahkan transformasi data streaming ke pekerjaan Anda, pilih simbol transformasi di bawah bagian Operasi pada pita untuk transformasi tersebut. Petak yang bersangkutan ditambahkan ke tampilan diagram. Setelah Anda memilihnya, Anda akan melihat panel samping untuk transformasi tersebut untuk mengonfigurasinya.

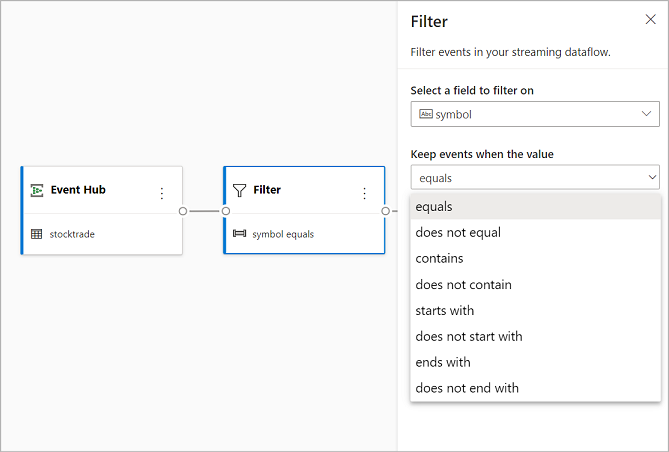

Filter

Gunakan transformasi Filter untuk memfilter peristiwa berdasarkan nilai bidang dalam input. Bergantung pada jenis data (angka atau teks), transformasi mempertahankan nilai yang cocok dengan kondisi yang dipilih.

Catatan

Di dalam setiap petak peta, Anda akan melihat informasi tentang apa lagi yang perlu disiapkan transformasinya. Misalnya, saat Anda menambahkan petak peta baru, Anda akan melihat pesan Penyiapan yang diperlukan . Jika Anda kehilangan konektor simpul, Anda akan melihat pesan Kesalahan atau pesan Peringatan .

Mengelola Bidang

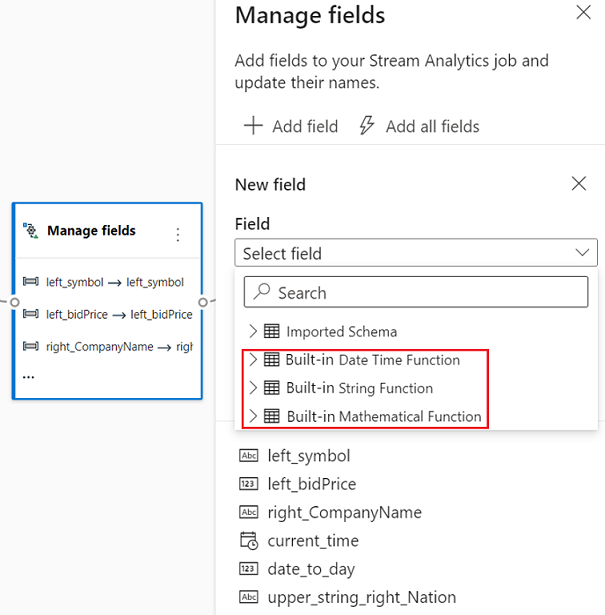

Transformasi Kelola bidang memungkinkan Anda menambahkan, menghapus, atau mengganti nama bidang yang masuk dari input atau transformasi lain. Pengaturan di panel samping memberi Anda opsi untuk menambahkan bidang baru dengan memilih Tambahkan bidang atau menambahkan semua bidang sekaligus.

Anda juga dapat menambahkan bidang baru dengan menggunakan Fungsi Bawaan untuk mengagregasi data dari hulu. Saat ini, fungsi bawaan yang didukung adalah beberapa fungsi dalam Fungsi String, Fungsi Tanggal dan Waktu, dan Fungsi Matematika. Untuk mempelajari selengkapnya tentang definisi fungsi ini, lihat Fungsi Bawaan (Azure Stream Analytics).

Petunjuk

Setelah Anda mengonfigurasi petak peta, tampilan diagram memberi Anda sekilas pengaturan dalam petak peta. Misalnya, di area Kelola bidang pada gambar sebelumnya, Anda dapat melihat tiga bidang pertama yang sedang dikelola dan nama baru ditetapkan untuk bidang-bidang tersebut. Setiap ubin memiliki informasi yang relevan dengannya.

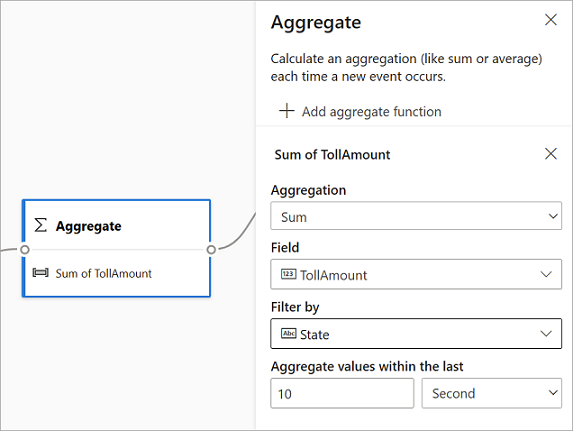

Agregat

Gunakan transformasi Agregat untuk menghitung agregasi (Jumlah, Minimum, Maksimum, atau Rata-Rata) setiap kali peristiwa baru terjadi selama periode waktu tertentu. Operasi ini juga memungkinkan Anda untuk memfilter atau memisahkan agregasi berdasarkan dimensi lain dalam data Anda. Anda dapat menyertakan satu atau beberapa agregasi dalam transformasi yang sama.

Untuk menambahkan agregasi, pilih simbol transformasi. Kemudian sambungkan input, pilih agregasi, tambahkan filter atau dimensi irisan apa pun, dan pilih periode waktu di mana agregasi dihitung. Dalam contoh ini, Anda menghitung jumlah nilai tol berdasarkan status tempat kendaraan berasal dari selama 10 detik terakhir.

Untuk menambahkan agregasi lain ke transformasi yang sama, pilih Tambahkan fungsi agregat. Filter atau ikatan berlaku untuk semua agregasi dalam transformasi.

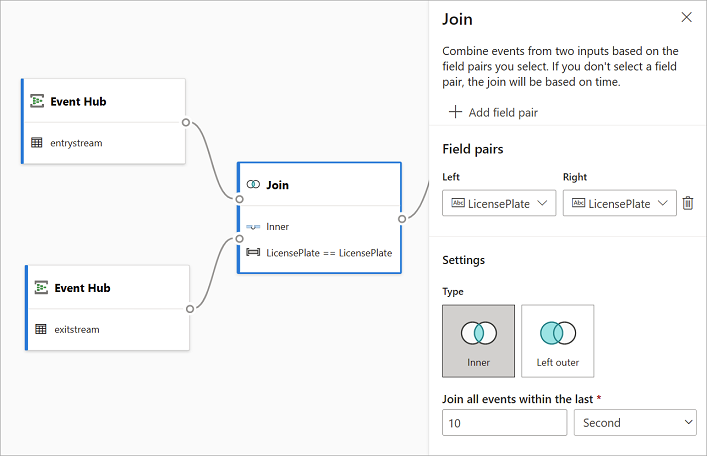

Bergabung

Gunakan transformasi Gabungan untuk menggabungkan peristiwa dari dua input berdasarkan pasangan bidang yang Anda pilih. Jika Anda tidak memilih pasangan bidang, gabungan didasarkan pada waktu secara default. Pengaturan bawaan membuat transformasi ini berbeda dari transaksi batch.

Seperti halnya gabungan reguler, Anda memiliki opsi untuk logika gabungan Anda:

- Inner join: Hanya sertakan rekaman dari kedua tabel di mana pasangan cocok. Dalam contoh ini, di situlah plat nomor cocok dengan kedua masukan.

- Left outer join: Sertakan semua rekaman dari tabel kiri (pertama) dan hanya rekaman dari tabel kedua yang cocok dengan pasangan kolom. Jika tidak ada kecocokan, bidang dari input kedua kosong.

Untuk memilih jenis sambungan, pilih simbol untuk tipe yang diinginkan di panel sisi.

Terakhir, pilih periode di mana Anda ingin gabungan dihitung. Dalam contoh ini, gabungan terlihat pada 10 detik terakhir. Semakin lama periodenya, semakin jarang outputnya, dan semakin banyak sumber daya pemrosesan yang Anda gunakan untuk transformasi.

Secara default, output menyertakan semua bidang dari kedua tabel. Awalan kiri (node pertama) dan kanan (node kedua) membantu Anda membedakan sumber.

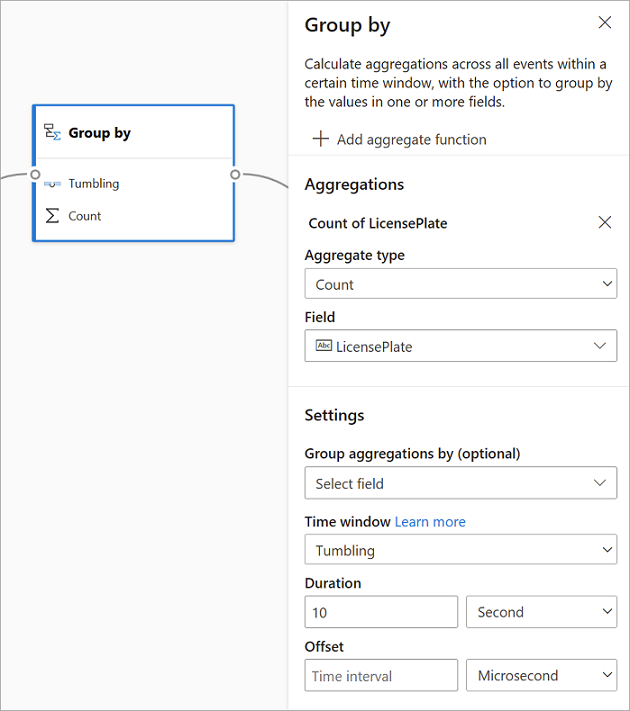

Kelompokkan berdasarkan

Gunakan transformasi Group by untuk menghitung agregasi di semua peristiwa dalam rentang waktu tertentu. Anda dapat mengelompokkan menurut nilai dalam satu atau beberapa bidang. Ini seperti transformasi Agregat tetapi memberikan lebih banyak opsi untuk agregasi. Ini juga mencakup opsi yang lebih kompleks untuk jendela waktu. Sama halnya dengan Agregat, Anda dapat menambahkan lebih dari satu agregasi per transformasi.

Agregasi yang tersedia di dalam transformasi adalah:

- Rata-rata

- Hitung

- Maksimum

- Minimum

- Percentile (berkelanjutan dan diskret)

- Simpangan Baku

- Jumlah

- Varians

Untuk mengonfigurasi transformasi:

- Pilih agregasi pilihan Anda.

- Pilih bidang yang ingin diagregatkan.

- Pilih bidang opsional berdasarkan grup jika Anda ingin mendapatkan penghitungan agregat berdasarkan suatu dimensi atau kategori lain. Misalnya: Status.

- Pilih fungsi Anda untuk jendela waktu.

Untuk menambahkan agregasi lain ke transformasi yang sama, pilih Tambahkan fungsi agregat. Perlu diingat bahwa bidang Kelompokkan menurut dan fungsi windowing berlaku untuk semua agregasi dalam transformasi.

Stempel waktu untuk akhir jendela waktu muncul sebagai bagian dari output transformasi untuk referensi. Untuk informasi selengkapnya tentang jendela waktu yang didukung oleh pekerjaan Stream Analytics, lihat Fungsi windowing (Azure Stream Analytics).

Union

Gunakan transformasi Union untuk menyambungkan dua input atau lebih. Tambahkan peristiwa yang memiliki bidang bersama (dengan nama dan jenis data yang sama) ke dalam satu tabel. Keluaran mengecualikan bidang yang tidak cocok.

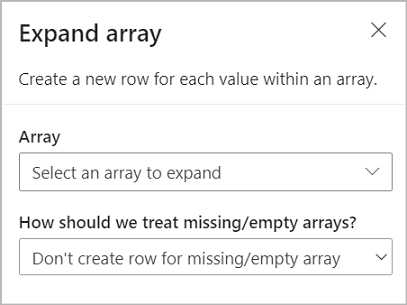

Perluas array

Gunakan transformasi Perluas array untuk membuat baris baru untuk setiap nilai dalam array.

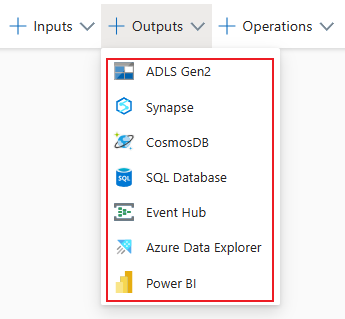

Keluaran streaming

Pengalaman tarik dan lepas tanpa kebutuhan kode saat ini mendukung beberapa sumber keluaran untuk menyimpan data real-time yang diproses.

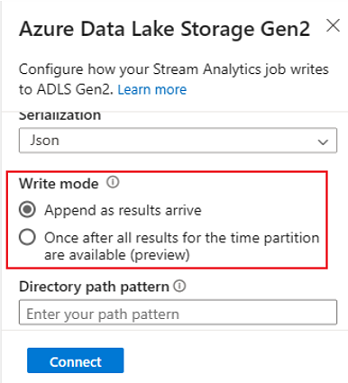

Azure Data Lake Storage Gen2

Data Lake Storage Gen2 menjadikan Azure Storage sebagai fondasi untuk membangun data lake perusahaan di Azure. Layanan ini dirancang untuk mengelola beberapa petabyte informasi sekaligus mempertahankan ratusan gigabit throughput. Memungkinkan Anda untuk mengelola sejumlah besar data dengan mudah. Azure Blob Storage menawarkan solusi hemat biaya dan dapat diskalakan untuk menyimpan sejumlah besar data yang tidak terstruktur di cloud.

Di bawah bagian Outputs pada toolbar, pilih ADLS Gen2 sebagai output untuk pekerjaan Stream Analytics Anda. Kemudian pilih kontainer tempat Anda ingin mengirim output pekerjaan. Untuk informasi selengkapnya tentang output Azure Data Lake Gen2 untuk pekerjaan Stream Analytics, bacalah Output Blob Storage dan Azure Data Lake Gen2 dari Azure Stream Analytics.

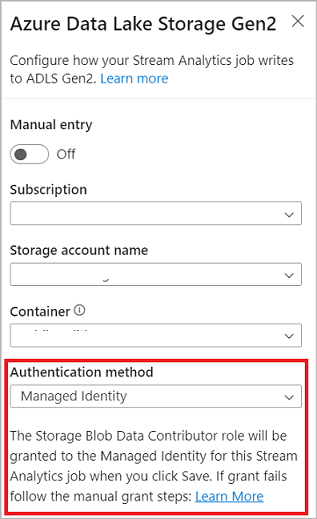

Saat Anda tersambung ke Azure Data Lake Storage Gen2, jika Anda memilih Managed Identity sebagai mode autentikasi, maka peran Kontributor Data Blob Penyimpanan diberikan ke identitas terkelola untuk tugas Stream Analytics. Untuk mempelajari selengkapnya tentang identitas terkelola untuk Azure Data Lake Storage Gen2, lihat Menggunakan identitas terkelola untuk mengautentikasi pekerjaan Azure Stream Analytics Anda ke Azure Blob Storage.

Identitas terkelola menghilangkan batasan metode autentikasi berbasis pengguna. Batasan ini termasuk kebutuhan untuk mengautentikasi ulang karena perubahan kata sandi atau kedaluwarsa token pengguna yang terjadi setiap 90 hari.

Tepat setelah pengiriman (pratinjau) didukung di ADLS Gen2 karena tidak ada output editor kode. Anda dapat mengaktifkannya di bagian Mode Menulis di konfigurasi ADLS Gen2. Untuk informasi selengkapnya tentang fitur ini, lihat Exactly setelah pengiriman (pratinjau) di Azure Data Lake Gen2.

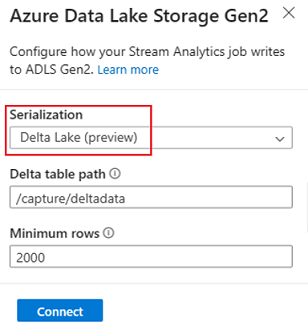

Tulis ke tabel Delta Lake (pratinjau) didukung di ADLS Gen2 tanpa output dari editor kode. Anda dapat mengakses opsi ini di bagian Serialisasi dalam konfigurasi ADLS Gen2. Untuk informasi selengkapnya tentang fitur ini, lihat Menulis ke tabel Delta Lake.

Azure Synapse Analytics

Pekerjaan Azure Stream Analytics dapat mengirim output ke tabel kumpulan SQL khusus di Azure Synapse Analytics dan dapat memproses tingkat throughput hingga 200 MB per detik. Azure Stream Analytics mendukung kebutuhan analitik real-time dan pemrosesan data jalur cepat yang paling menuntut untuk beban kerja seperti pelaporan dan penyajian dasbor.

Penting

Tabel kumpulan SQL khusus harus ada sebelum Anda dapat menambahkannya sebagai output ke pekerjaan Azure Stream Analytics. Skema tabel harus cocok dengan bidang dan jenisnya dalam output pekerjaan Anda.

Di bawah bagian Output pada menu pita, pilih Synapse sebagai output untuk pekerjaan Stream Analytics Anda. Kemudian pilih tabel kumpulan SQL tempat Anda ingin mengirim output pekerjaan. Untuk informasi selengkapnya tentang output Azure Synapse untuk pekerjaan Azure Stream Analytics, lihat Output Azure Synapse Analytics dari Azure Stream Analytics.

Azure Cosmos DB

Azure Cosmos DB adalah layanan database terdistribusi secara global yang menawarkan skala elastis tanpa batas di seluruh dunia. Ini juga menawarkan kueri yang kaya dan pengindeksan otomatis pada model data yang bebas skema.

Di bawah bagian Output pada pita, pilih CosmosDB sebagai keluaran untuk pekerjaan Azure Stream Analytics Anda. Untuk informasi selengkapnya tentang output Azure Cosmos DB untuk pekerjaan Azure Stream Analytics, lihat Output Azure Cosmos DB dari Azure Stream Analytics.

Saat Anda tersambung ke Azure Cosmos DB, jika Anda memilih Managed Identity sebagai mode autentikasi, peran Kontributor diberikan ke identitas terkelola untuk pekerjaan Stream Analytics. Untuk mempelajari selengkapnya tentang identitas terkelola untuk Azure Cosmos DB, lihat Menggunakan identitas terkelola untuk mengakses Azure Cosmos DB dari pekerjaan Azure Stream Analytics (pratinjau).

Output Azure Cosmos DB di editor tanpa kode juga mendukung metode autentikasi identitas terkelola. Metode ini memberikan manfaat yang sama seperti yang dilakukan dalam output ADLS Gen2.

Azure SQL Database

Azure SQL Database adalah mesin database platform as a service (PaaS) yang dikelola sepenuhnya yang membantu Anda membuat lapisan penyimpanan data dengan ketersediaan tinggi dan berkinerja tinggi untuk aplikasi dan solusi di Azure. Dengan menggunakan editor tanpa kode, Anda dapat mengonfigurasi pekerjaan Azure Stream Analytics untuk menulis data yang diproses ke tabel yang sudah ada di SQL Database.

Untuk mengonfigurasi Azure SQL Database sebagai output, pilih SQL Database di bawah bagian Output pada pita. Kemudian masukkan informasi yang diperlukan untuk menyambungkan ke database SQL Anda dan pilih tabel yang ingin Anda tulis datanya.

Penting

Tabel Azure SQL Database harus ada sebelum Anda dapat menambahkannya sebagai output ke pekerjaan Azure Stream Analytics Anda. Skema tabel harus cocok dengan bidang dan jenisnya dalam output pekerjaan Anda.

Untuk informasi selengkapnya tentang output Azure SQL Database untuk pekerjaan Azure Stream Analytics, lihat Output Azure SQL Database dari Azure Stream Analytics.

Pusat Aktivitas

Dengan data real time yang masuk ke ASA, editor tanpa kode dapat mengubah dan memperkaya data, lalu menghasilkan data ke pusat aktivitas lain. Anda dapat memilih Event Hubs sebagai output saat mengonfigurasi pekerjaan Azure Stream Analytics.

Untuk mengonfigurasi Event Hub sebagai output, pilih Event Hub di bawah bagian Output pada pita. Kemudian masukkan informasi yang diperlukan untuk menyambungkan ke pusat aktivitas yang ingin Anda tulis datanya.

Untuk informasi selengkapnya tentang output Azure Event Hubs untuk pekerjaan Azure Stream Analytics, lihat Output Azure Event Hubs dari Azure Stream Analytics.

Azure Data Explorer

Azure Data Explorer adalah platform analitik big data berkinerja tinggi yang dikelola sepenuhnya yang memudahkan analisis data dalam volume tinggi. Anda juga dapat menggunakan Azure Data Explorer sebagai output untuk pekerjaan Azure Stream Analytics Anda dengan menggunakan editor tanpa kode.

Untuk mengonfigurasi Azure Data Explorer sebagai output, pilih Azure Data Explorer di bawah bagian Outputs pada pita. Kemudian masukkan informasi yang diperlukan untuk menyambungkan ke database Azure Data Explorer Anda dan tentukan tabel yang ingin Anda tulis datanya.

Penting

Tabel harus ada di database yang Anda pilih dan skema tabel harus sama persis dengan bidang dan jenisnya dalam output pekerjaan Anda.

Untuk informasi selengkapnya tentang output Azure Data Explorer untuk pekerjaan Azure Stream Analytics, lihat Output Azure Data Explorer dari Azure Stream Analytics (Pratinjau).

Power BI

Power BI menawarkan pengalaman visualisasi yang komprehensif untuk hasil analisis data Anda. Dengan menggunakan output Power BI ke Azure Stream Analytics, data streaming yang diproses ditulis ke himpunan data streaming Power BI, lalu Anda dapat menggunakannya untuk membangun dasbor Power BI yang mendekati real-time.

Untuk mengonfigurasi Power BI sebagai output, pilih Power BI di bawah bagian Outputs pada pita. Kemudian masukkan informasi yang diperlukan untuk menyambungkan ke ruang kerja Power BI Anda dan berikan nama untuk himpunan data streaming dan tabel yang ingin Anda tulis datanya. Untuk mempelajari selengkapnya tentang detail setiap bidang, lihat Output Power BI dari Azure Stream Analytics.

Pratinjau data, kesalahan pengembangan, log pelaksanaan, dan metrik

Pengalaman seret dan letakkan tanpa kode menyediakan alat untuk membantu Anda menulis, memecahkan masalah, dan mengevaluasi performa alur analitik Anda untuk data streaming.

Pratinjau data langsung untuk masukan

Saat Anda menyambungkan ke sumber input, seperti hub acara, dan memilih petaknya dalam tampilan diagram (tab Pratinjau Data), Anda akan melihat pratinjau secara langsung dari data masuk jika semua kondisi berikut ini benar:

- Data sedang didorong.

- Input telah dikonfigurasi dengan benar.

- Bidang telah ditambahkan.

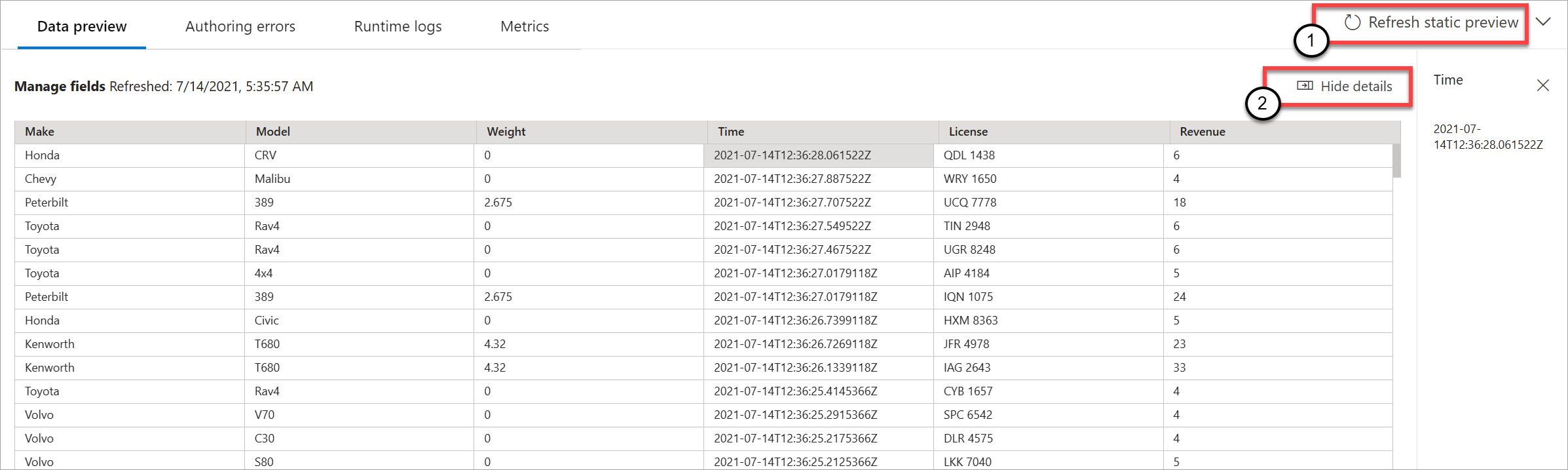

Seperti yang ditunjukkan pada cuplikan layar berikut, jika ingin melihat atau menelusuri sesuatu yang spesifik, Anda dapat menjeda pratinjau (1). Atau Anda dapat memulainya lagi jika sudah selesai.

Anda juga dapat melihat detail rekaman tertentu, sel dalam tabel, dengan memilihnya lalu memilih Tampilkan/Sembunyikan detail (2). Tangkapan layar menunjukkan detail tampilan dari objek berlapis dalam rekaman.

Pratinjau statik untuk transformasi dan output

Setelah menambahkan dan menyiapkan langkah dalam tampilan diagram, Anda dapat menguji perilakunya dengan memilih Dapatkan pratinjau statik.

Saat Anda memilih tombol , pekerjaan Azure Stream Analytics mengevaluasi semua transformasi dan output untuk memastikannya dikonfigurasi dengan benar. Analisis Aliran kemudian menampilkan hasilnya dalam pratinjau data statik, seperti yang ditunjukkan pada gambar berikut.

Anda dapat me-refresh pratinjau dengan memilih Refresh pratinjau statik (1). Saat Anda memperbarui pratinjau, Stream Analytics mengambil data baru dari masukan dan mengevaluasi semua transformasi. Kemudian mengirimkan output lagi dengan pembaruan apa pun yang mungkin telah Anda lakukan. Opsi Tampilkan/Sembunyikan detail juga tersedia (2).

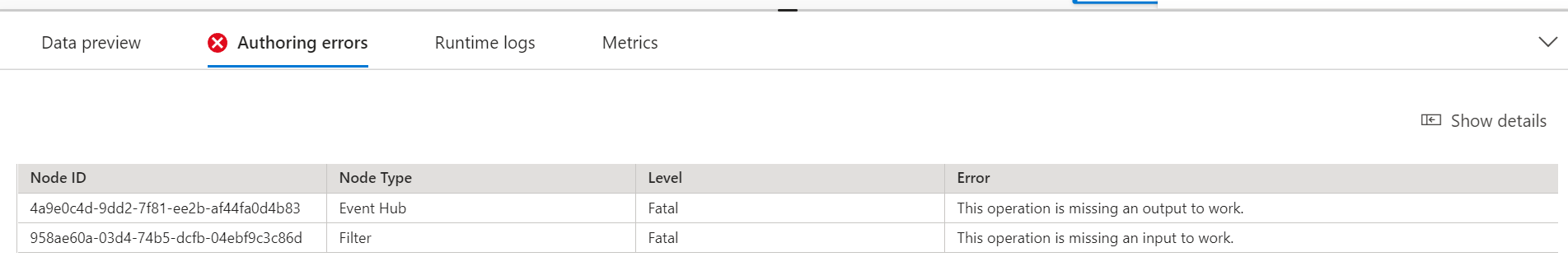

Kesalahan penulisan

Jika Anda memiliki kesalahan penulisan atau peringatan, tab Kesalahan penulisan mencantumkannya , seperti yang ditunjukkan pada cuplikan layar berikut. Daftar ini mencakup detail kesalahan atau peringatan, jenis kartu (input, transformasi, atau output), tingkat kesalahan, dan deskripsi kesalahan atau peringatan.

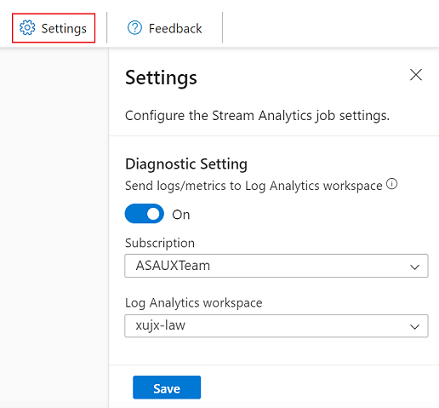

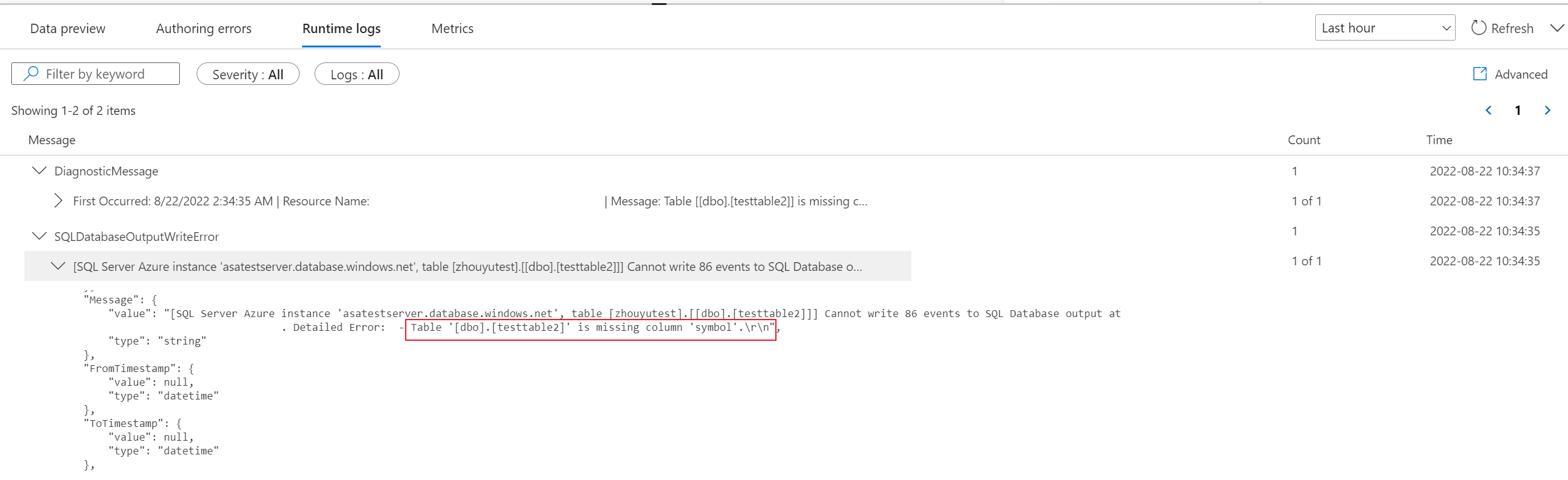

Log waktu proses

Log runtime muncul pada tingkat peringatan, kesalahan, atau informasi saat tugas berjalan. Log ini berguna saat Anda ingin mengedit topologi atau konfigurasi pekerjaan Azure Stream Analytics untuk pemecahan masalah. Nyalakan log diagnostik dan kirimkan ke workspace Log Analytics di Settings untuk mendapatkan lebih banyak wawasan tentang pekerjaan yang sedang berjalan untuk debugging.

Dalam contoh cuplikan layar berikut, pengguna mengonfigurasi output SQL Database dengan skema tabel yang tidak cocok dengan bidang output pekerjaan.

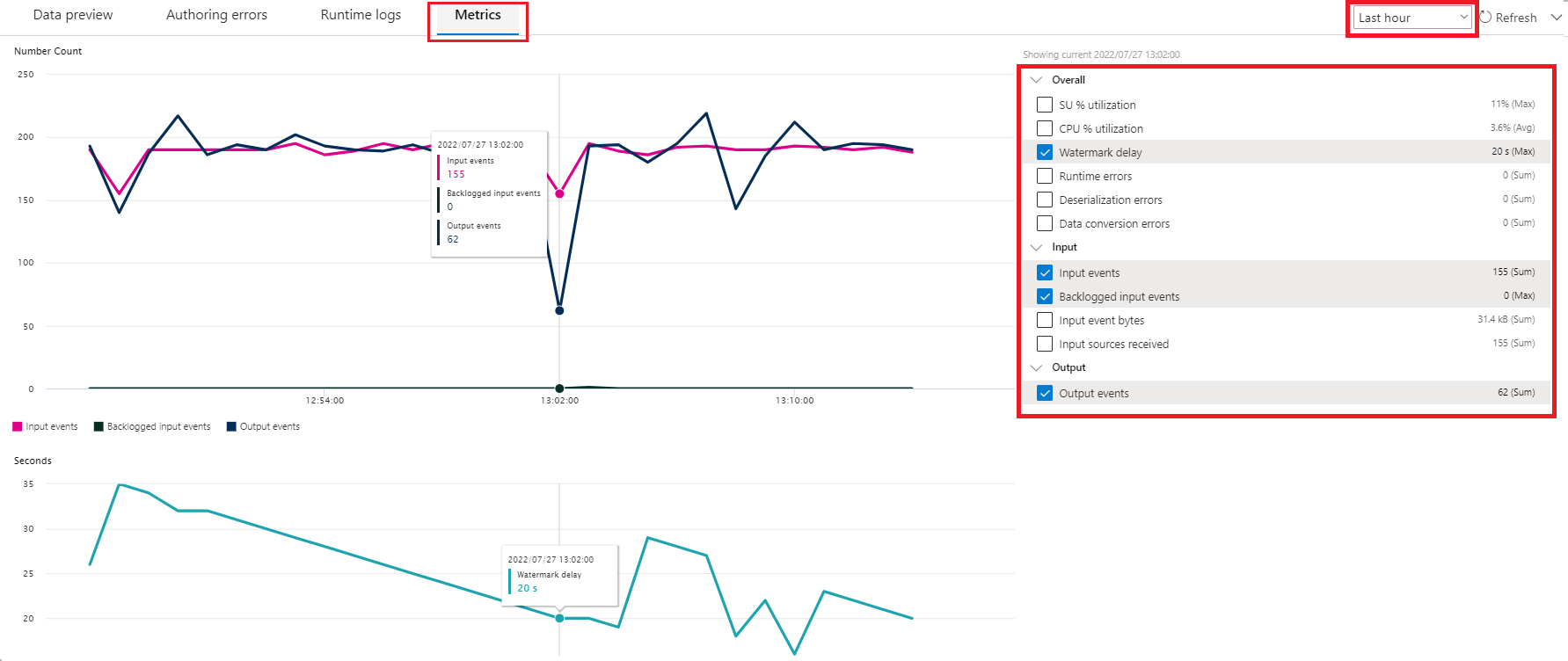

Metrik

Jika pekerjaan berjalan, Anda dapat memantau kesehatan pekerjaan Anda di tab Metrik. Empat metrik yang ditampilkan secara default adalah penundaan marka air, peristiwa input, peristiwa input tertunda, dan peristiwa keluaran. Gunakan metrik ini untuk memahami apakah peristiwa mengalir masuk dan keluar dari proses tanpa penundaan input.

Anda dapat memilih metrik lainnya dari daftar. Untuk memahami semua metrik secara rinci, lihat metrik pekerjaan Azure Stream Analytics.

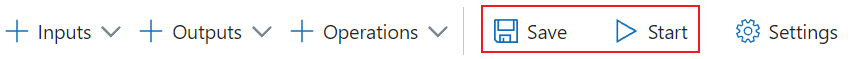

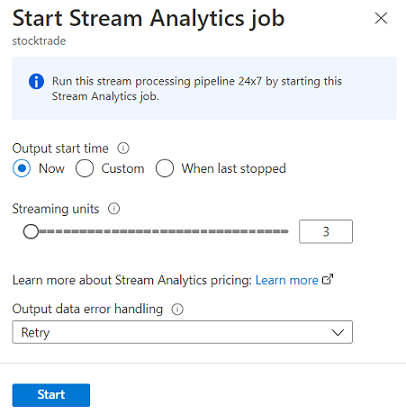

Memulai tugas Analisis Aliran

Anda dapat menyimpan tugas kapan saja sewaktu membuatnya. Setelah mengonfigurasi input streaming, transformasi, dan output streaming untuk pekerjaan tersebut, Anda dapat memulai pekerjaan.

Catatan

Meskipun editor tanpa kode di portal Azure Stream Analytics saat ini dalam pratinjau, layanan Azure Stream Analytics sudah tersedia secara umum.

Anda dapat mengonfigurasi opsi ini:

-

Waktu mulai output: Saat Anda memulai pekerjaan, pilih waktu untuk pekerjaan untuk mulai membuat output.

- Sekarang: Opsi ini membuat titik awal aliran peristiwa output sama seperti ketika pekerjaan dimulai.

- Kustom: Pilih titik awal output.

- Ketika terakhir dihentikan: Opsi ini tersedia ketika pekerjaan sebelumnya dimulai tetapi dihentikan secara manual atau gagal. Saat Anda memilih opsi ini, waktu output terakhir digunakan untuk memulai ulang pekerjaan, sehingga tidak ada data yang hilang.

- Unit streaming: Unit streaming (SU) mewakili jumlah sumber daya komputasi dan memori yang ditetapkan ke tugas saat sedang berjalan. Jika Anda tidak yakin berapa banyak SU yang akan dipilih, mulailah dengan tiga dan sesuaikan sesuai kebutuhan.

- Penanganan kesalahan data output: Kebijakan untuk penanganan kesalahan data output hanya berlaku ketika peristiwa output yang dihasilkan oleh tugas Azure Stream Analytics tidak sesuai dengan skema sink target. Konfigurasikan kebijakan dengan memilih Coba Lagi atau Hilangkan. Untuk informasi selengkapnya, lihat Kebijakan kesalahan output Azure Stream Analytics.

- Mulai: Tombol ini memulai pekerjaan Azure Stream Analytics.

Daftar pekerjaan Azure Stream Analytics di portal Azure Event Hubs

Untuk melihat daftar semua pekerjaan Azure Stream Analytics yang Anda buat dengan menggunakan pengalaman seret dan letakkan tanpa kode di portal Azure Event Hubs, pilih Proses data>pekerjaan Stream Analytics.

Berikut adalah elemen dari tab pekerjaan Stream Analytics:

- Filter: Memfilter daftar menurut nama pekerjaan.

- Refresh: Saat ini, daftar tidak di-refresh sendiri secara otomatis. Gunakan tombol Refresh untuk me-refresh daftar dan melihat status terbaru.

- Nama pekerjaan: Nama di area ini adalah nama yang Anda berikan di langkah pertama pembuatan pekerjaan. Anda tidak dapat mengeditnya. Pilih nama tugas untuk membuka tugas dalam antarmuka drag-and-drop tanpa kode, di mana Anda dapat menghentikan tugas, mengeditnya, dan memulainya lagi.

- Status: Area ini menunjukkan status pekerjaan. Pilih Refresh di bagian atas daftar untuk melihat status terbaru.

- Unit streaming: Area ini menampilkan jumlah unit streaming yang Anda pilih saat memulai pekerjaan.

- Watermark output: Area ini memberikan indikator keaktifan untuk data yang dihasilkan oleh job tersebut. Semua peristiwa sebelum stempel waktu sudah dihitung.

- Pemantauan pekerjaan: Pilih Buka metrik untuk melihat metrik yang terkait dengan pekerjaan Azure Stream Analytics ini. Untuk informasi selengkapnya tentang metrik yang dapat Anda gunakan untuk memantau pekerjaan Azure Stream Analytics, lihat Metrik pekerjaan Azure Stream Analytics.

- Operasi: Mulai, hentikan, atau hapus pekerjaan.

Langkah berikutnya

Pelajari cara menggunakan editor tanpa kode untuk mengatasi skenario umum dengan menggunakan templat yang telah ditentukan sebelumnya: