コードなしのエディターを使用すると、リアルタイム ストリーミング データを処理する Stream Analytics ジョブを簡単に開発できます。 コードを記述せずにドラッグ アンド ドロップ機能を使用します。 このエクスペリエンスでは、入力ソースに接続してストリーミング データをすばやく確認できるキャンバスが提供されます。 その後、宛先に書き込む前に変換できます。

コードなしのエディターを使用すると、次のことができます。

- 入力スキーマを変更する。

- 結合やフィルターなどのデータ準備操作を実行する。

- グループ化操作のためのタイム ウィンドウ集計 (タンブリング ウィンドウ、ホッピング ウィンドウ、セッション ウィンドウ) などの高度なシナリオに取り組む。

Stream Analytics ジョブを作成して実行すると、運用ワークロードを簡単に運用化できます。 監視とトラブルシューティングのために適切な組み込みメトリックのセットを使用します。 Stream Analytics ジョブは、実行中の価格モデルに従って課金されます。

前提条件

コードなしのエディターを使用して Stream Analytics ジョブを開発する前に、次の要件を満たしていることを確認してください。

- Stream Analytics ジョブのストリーミング入力ソースとターゲット宛先リソースは、パブリックにアクセスできる必要があり、Azure 仮想ネットワーク内にすることはできません。

- ストリーミング入力リソースおよび出力リソースにアクセスするには、必要なアクセス許可がなければなりません。

- Azure Stream Analytics リソースを作成および変更するには、アクセス許可を維持する必要があります。

注意

コードなしのエディターは現在、中国リージョンでは使用できません。

Azure Stream Analytics ジョブ

Stream Analytics ジョブは、ストリーミング入力、変換、出力の 3 つの主要コンポーネントに基づいて構築されています。 複数の入力、複数の変換を含む並列分岐、複数の出力など、必要な数のコンポーネントを含めることができます。 詳細については、Azure Stream Analytics のドキュメントを参照してください。

注意

コードなしのエディターを使用する場合、次の機能と出力の種類は使用できません。

- ユーザー定義関数。

- Azure Stream Analytics のクエリ ページでのクエリ編集。 ただし、コードなしのエディターによって生成されたクエリは、クエリ ページで表示できます。

- Azure Stream Analyticsの入力ページと出力ページで、入力と出力を追加する。 ただし、コードなしのエディターによって生成された入力と出力は、入力ページと出力ページで表示できます。

- 次の出力の種類は使用できません:Azure関数、Azure Data Lake Storage Gen1、PostgreSQL DB、Service Bus キュー/トピック、Table Storage。

ストリーム分析ジョブをビルドするためのコードなしのエディターにアクセスするには、次のいずれかの方法を使用します。

Azure Stream Analytics ポータル (プレビュー) を使用する: Stream Analytics ジョブを作成し、[概要] ページの [作業の開始] タブでノーコード エディターを選択するか、左側のパネルで [ノーコード エディター] を選択します。

Azure Event Hubs ポータルを使用する: Event Hubs インスタンスを開きます。 [データの処理] を選択してから、任意の定義済みテンプレートを選択します。

定義済みのテンプレートは、次のようなさまざまなシナリオに対処するジョブの開発と実行に役立ちます。

- Delta Lake 形式で Event Hubs からデータをキャプチャする (プレビュー)

- Azure Synapse SQL へのフィルター処理と取り込み

- Azure Data Lake Storage Gen2 での Parquet 形式での Event Hubs データのキャプチャ

- Azure Cosmos DB でのデータの具体化

- Azure Data Lake Storage Gen2 へのフィルター処理と取り込み

- データをエンリッチしてイベント ハブに取り込む

- データの変換および Azure SQL データベースへの保存

- フィルター処理して Azure Data Explorer に取り込む

次のスクリーンショットは、完了済みの Stream Analytics ジョブを示しています。 作成中に使用できるすべてのセクションが強調表示されます。

- リボン: リボンでは、セクションがクラシック分析プロセスの順序に従います (入力としてのイベント ハブ (データ ソースとも呼ばれる)、変換 (ストリーミングの抽出、変換、読み込み操作)、出力、進行状況を保存するためのボタン、およびジョブを開始するためのボタン)。

- ダイアグラム ビュー: このビューは、入力から操作、出力まで、Stream Analytics ジョブをグラフィカルに表現したものです。

- サイド ウィンドウ: ダイアグラム ビューで選択したコンポーネントに応じて、入力、変換、または出力を変更するための設定が表示されます。

- データ プレビュー、作成エラー、ランタイム ログ、およびメトリックに関するタブ: タイルごとに、データ プレビューに、そのステップの結果が表示されます (入力の場合はライブ、変換と出力の場合はオンデマンド)。 このセクションでは、開発中のジョブで発生するおそれのある作成エラーまたは警告の概要も表示されます。 各エラーまたは警告を選択すると、その変換が選択されます。 実行中のジョブの正常性を監視するためのジョブ メトリックスも提供されます。

ストリーミング データ入力

ノーコード エディターでは、次の 3 種類のリソースからのストリーミング データ入力がサポートされています。

- Azure Event Hubs

- Azure IoT Hub

- Azure Data Lake Storage Gen2

ストリーミング データ入力の詳細については、「Stream Analytics に入力としてデータをストリーム配信する」を参照してください

注意

Azure Event Hubs ポータルのノーコード エディターには、入力オプションとして Event Hub のみがあります。

ストリーミング入力としての Azure Event Hubs

Azure Event Hubs は、ビッグ データのストリーミング プラットフォームであり、イベント インジェスト サービスです。 1 秒間に何百万ものイベントを受信して処理することができます。 リアルタイム分析プロバイダーまたはバッチ処理およびストレージ アダプターを使用して、イベント ハブに送信されたデータを変換して格納できます。

イベント ハブをジョブの入力として構成するには、[イベント ハブ] アイコンを選択します。 [ダイアグラム] ビューでは、構成および接続のためのサイドパネルを含むタイルが表示されます。

コードなしのエディターでイベント ハブに接続する場合は、新しいコンシューマー グループ (既定のオプション) を作成します。 この方法は、イベント ハブが同時リーダーの制限に達するのを防ぐのに役立ちます。 コンシューマー グループの詳細と、既存のコンシューマー グループを選択すべきか、新しいコンシューマー グループを作成すべきかを理解するには、コンシューマー グループに関する記事を参照してください。

イベント ハブが Basic レベルの場合は、既存の $Default コンシューマー グループしか使用できません。 イベント ハブが Standard または Premium レベルの場合は、新しいコンシューマー グループを作成できます。

イベント ハブに接続するときに、認証モードとして Managed Identity を選択すると、Azure Event Hubs データ所有者ロールが Stream Analytics ジョブのマネージド ID に付与されます。 イベント ハブのマネージド ID の詳細については、「Azure Stream Analytics ジョブからマネージド ID を使用してイベント ハブにアクセスする」を参照してください。

マネージド ID では、ユーザーベースの認証方法の制限が排除されます。 このような制限には、90 日ごとに発生するパスワードの変更やユーザー トークンの期限切れによる再認証の必要性が含まれます。

イベント ハブの詳細を設定し、[接続] を選択した後、フィールド名がわかっていれば、[+ フィールドの追加] を使用することによって手動でフィールドを追加することができます。 代わりに受信メッセージのサンプルに基づいてフィールドとデータ型を自動的に検出するには、 [フィールドの自動検出] を選択します。 必要に応じて、歯車記号を選択して、資格情報を編集できます。

Stream Analytics ジョブでフィールドが検出されると、それらがリストに表示されます。 また、ダイアグラム ビューの下の [データ プレビュー] テーブルに受信メッセージのライブ プレビューが表示されます。

入力データを変更する

各フィールドの横にある 3 点記号を選択することで、フィールド名の編集、フィールドの削除、データ型の変更、イベント時間の変更 (イベント時間としてマーク: datetime 型フィールドの場合は TIMESTAMP BY 句) を変更できます。 さらに、次の図に示すように、受信メッセージから、入れ子になったフィールドを展開、選択、および編集することもできます。

ヒント

このプロセスは、Azure IoT HubおよびAzure Data Lake Storage Gen2からの入力データにも適用されます。

使用できるデータの種類は次のとおりです。

- DateTime: ISO 形式の日付と時刻フィールド。

- Float: 10 進数。

- Int: 整数。

- Record: 複数のレコードを含む入れ子になったオブジェクト。

- String: テキスト。

ストリーミング入力としての Azure IoT Hub

Azure IoT Hub は、クラウドでホストされる管理サービスです。IoT アプリケーションとそこに接続されたデバイスとの間における通信において、中央のメッセージ ハブとしての役割を担います。 Stream Analytics ジョブの入力として、IoT ハブに送信された IoT デバイス データを使用できます。

注意

Azure IoT Hub入力は、Azure Stream Analyticsポータルのコードなしのエディターで使用できます。

ジョブのストリーミング入力として IoT ハブを追加するには、リボンの [入力] の下にある [IoT Hub] を選択します。 次に、右側のパネルに必要な情報を入力して、IoT ハブをジョブに接続します。 各フィールドの詳細については、IoT Hub から Stream Analytics ジョブへのデータのストリーム配信に関する記事を参照してください。

ストリーミング入力としての Azure Data Lake Storage Gen2

Azure Data Lake Storage Gen2 (ADLS Gen2) は、クラウドベースのエンタープライズ データ レイク ソリューションです。 これは、任意の形式の大量のデータを保存し、ビッグ データ分析ワークロードに対応するように設計されています。 Stream Analytics では、ADLS Gen2 に格納されているデータをデータ ストリームとして処理できます。 この種類の入力の詳細については、「 ADLS Gen2 から Stream Analytics ジョブへのデータのストリーム配信」を参照してください。

注意

Azure Data Lake Storage Gen2入力は、Azure Stream Analyticsポータルのコードなしのエディターで使用できます。

ジョブのストリーミング入力として ADLS Gen2 を追加するには、リボンの [入力] の下にある [ADLS Gen2] を選択します。 次に、右側のパネルにある入力欄に必要な情報を入力して、Azure Data Lake Storage Gen2 をジョブに接続します。 各フィールドの詳細については、「 ADLS Gen2 から Stream Analytics ジョブへのデータのストリーム配信」を参照してください。

参照データ入力

参照データは、静的な場合と時間の経過とともにゆっくり変化する場合があります。 通常、これを使用して受信ストリームを強化し、ジョブで検索を実行します。 たとえば、SQL 結合を実行して静的な値を検索する場合と同様に、データ ストリーム入力を参照データのデータに結合できます。 参照データ入力の詳細については、「Stream Analytics での参照に参照データを使用する」を参照してください。

ノーコード エディターは、次の 2 つの参照データ ソースをサポートするようになりました。

- Azure Data Lake Storage Gen2

- Azure SQL Database

参照データとしての Azure Data Lake Storage Gen2

モデルは、BLOB 名に指定された日付と時刻の組み合わせの昇順で BLOB のシーケンスとしてデータを参照します。 シーケンスの末尾に BLOB を追加するには、シーケンスで最後に指定した BLOB よりも大きい日付と時刻を使用する必要があります。 入力構成で BLOB を定義します。

まず、リボンの [入力] セクションで、Reference ADLS Gen2 を選択します。 各フィールドの詳細については、「Stream Analytics での参照に参照データを使用する」の Azure Blob Storage に関するセクションを参照してください。

次に、JSON 配列ファイルをアップロードします。 システムがフィールドを検出します。 この参照データを使用して、Event Hubs からのストリーミング入力データを使用した変換を実行します。

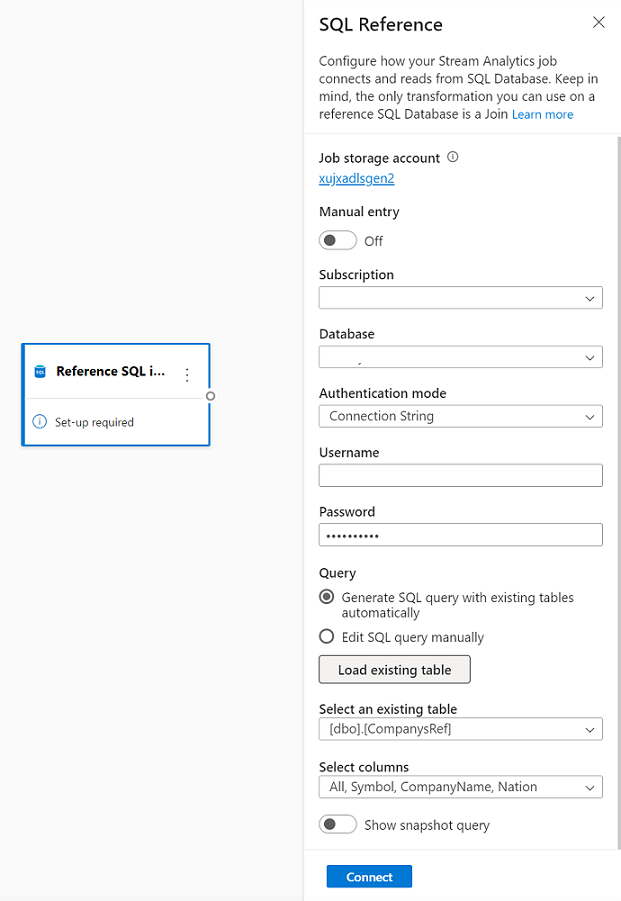

参照データとしての Azure SQL Database

ノーコード エディターでは、Stream Analytics ジョブ用の参照データとして Azure SQL Database を使用できます。 詳細については、「Stream Analytics での参照に参照データを使用する」の SQL Database に関するセクションを参照してください。

SQL Database を参照データ入力として構成するには、リボンの [入力] セクションで [Reference SQL Database](参照 SQL Database) を選択します。 次に、参照データベースを接続するための情報を入力し、必要な列を含むテーブルを選択します。 SQL クエリを手動で編集することによって、テーブルから参照データをフェッチすることもできます。

変換

ストリーミング データの変換はバッチ データの変換とは本質的に異なります。 ほとんどすべてのストリーミング データに、関連するデータ準備タスクに影響を与える時間コンポーネントが含まれています。

ストリーミング データ変換をジョブに追加するには、その変換用のリボンにある [操作] セクションで変換記号を選択します。 それぞれのタイルがダイアグラム ビューに追加されます。 選択すると、その変換のサイドペインが表示され、そこで構成できます。

フィルター

フィルター変換を使用して、入力のフィールドの値に基づいてイベントをフィルター処理します。 データ型 (数値またはテキスト) に応じて、変換では選択した条件に一致する値が保持されます。

注意

すべてのタイル内に、変換の準備が必要なその他の情報が表示されます。 たとえば、新しいタイルを追加すると、 セットアップが必要 なメッセージが表示されます。 ノード コネクタが見つからない場合は、 エラー メッセージまたは 警告 メッセージが表示されます。

フィールドの管理

フィールドの管理変換では、入力または別の変換から受信するフィールドの追加、削除、または名前の変更を行うことができます。 サイド ウィンドウの設定では、[フィールドの追加] を選択するか、すべてのフィールドを一度に追加することで、新しい フィールド を追加できます。

組み込み関数を使用してアップストリームのデータを集計することで、新しいフィールドを追加することもできます。 現在、サポートされている組み込み関数は、 文字列関数、 日付と時刻関数、 数学関数の一部の関数です。 これらの関数の定義の詳細については、「組み込み関数 (Azure Stream Analytics)」を参照してください。

ヒント

タイルを構成したら、ダイアグラム ビューで、タイル内の設定を簡単に確認できます。 たとえば、前の画像の [フィールドの管理] 領域では、最初の 3 つのフィールドが管理されており、それらに新しい名前が割り当てられているのがわかります。 各タイルには、それに関連する情報が含まれています。

集約

[集計] 変換を使用すると、一定期間内に新しいイベントが発生するたびに、集計 ([合計]、[最小]、[最大]、または [平均]) を計算できます。 この操作により、データ内の他のディメンションに基づいて集計のフィルター処理またはスライスを行うこともできます。 同じ変換に 1 つ以上の集計を含めることができます。

集計を追加するには、変換記号を選択します。 次に、入力を接続し、集計を選択し、フィルターまたはスライスディメンションを追加して、集計を計算する期間を選択します。 この例では、過去 10 秒間に車両がどこから来たかの状態で料金の合計を計算します。

同じ変換に別の集計を追加するには、 [集計関数の追加] を選択します。 フィルターまたはスライスは、変換内のすべての集計に適用されます。

参加する

結合変換を使用することにより、選択したフィールドのペアに基づいて、2 つの入力からのイベントを組み合わせます。 フィールドのペアを選択しない場合、結合は、既定で時間に基づきます。 この既定によって、この変換をバッチ変換とは異なるものにしています。

通常の結合と同様に、結合ロジック用のオプションがあります。

- 内部結合: ペアが一致する両方のテーブルからのレコードのみが含まれます。 この例では、それはライセンス プレートが両方の入力と一致している場所になります。

- 左外部結合: 左側 (最初) のテーブルからのすべてのレコードと、フィールドのペアと一致する、2 番目のテーブルからのレコードのみが含まれます。 一致するものがない場合、2 番目の入力からのフィールドは空白になります。

結合の種類を選択するには、サイド パネルで優先する種類の記号を選択します。

最後に、結合を計算する期間を選択します。 この例では、結合は、過去 10 秒間を対象とします。 期間が長いほど、出力の頻度が低くなり、変換に使用する処理リソースが多くなります。

既定では、出力には両方のテーブルのすべてのフィールドが含まれます。 左 (最初のノード) と右 (2 番目のノード) のプレフィックスは、ソースを区別するのに役立ちます。

グループ化

グループ化変換を使用して、特定の時間ウィンドウ内のすべてのイベントの集計を計算します。 1 つまたは複数のフィールドの値でグループ化することができます。 これは、集計変換に似ていますが、より多くの集計のためのオプションが用意されています。 また、時間ウィンドウ用のより複雑なオプションも含まれています。 さらに、集計と同様に、変換あたり複数の集計を追加できます。

変換で使用できる集計は次のとおりです。

- Average

- Count

- [最大]

- 最小

- パーセンタイル (連続および不連続)

- 標準偏差

- 合計

- Variance

この変換を構成するには:

- 優先する集計を選択します。

- 集計するフィールドを選択します。

- 別のディメンションまたはカテゴリに対する集計計算を取得する場合は、オプションのグループ化フィールドを選択します。 たとえば、[状態] です。

- 時間ウィンドウの関数を選択します。

同じ変換に別の集計を追加するには、 [集計関数の追加] を選択します。 Group byフィールドとウィンドウ関数は、変換内のすべての集計に適用されます。

時間ウィンドウの終了時点のタイム スタンプが、参考のために変換出力の一部として表示されます。 Stream Analytics ジョブでサポートされる時間ウィンドウの詳細については、「ウィンドウ関数 (Azure Stream Analytics)」を参照してください。

ユニオン

和集合変換を使用して、2 つ以上の入力を接続します。 (同じ名前とデータ型の) 共有フィールドを持つイベントを 1 つのテーブルに追加します。 出力では、一致しないフィールドが除外されます。

配列の拡張

配列の拡張変換は、配列内の値ごとに新しい行を作成する場合に使用します。

ストリーミング出力

現時点で、ノーコード ドラッグ アンド ドロップ エクスペリエンスは、処理されたリアルタイム データを格納するための出力シンクを複数サポートしています。

Azure Data Lake Storage Gen2

Data Lake Storage Gen2 によって、Azure Storage は、Azure 上にエンタープライズ データ レイクを構築するための基盤となります。 それは、数百ギガビットのスループットを維持しながら、数ペタバイトの情報を提供するように設計されています。 これにより、大量のデータを簡単に管理できます。 Azure Blob Storage は、大量の非構造化データをクラウドに保存するためのコスト効率の良いスケーラブルなソリューションを提供します。

リボン上の [出力] セクションで、Stream Analytics ジョブの出力として [ADLS Gen2] を選択します。 次に、ジョブの出力を送信するコンテナーを選択します。 Stream Analytics ジョブの Azure Data Lake Gen2 出力の詳細については、「Azure Stream Analytics からの Blob Storage と Azure Data Lake Gen2 出力」を参照してください。

Azure Data Lake Storage Gen2に接続するときに、認証モードとして Managed Identity を選択すると、Stream Analytics ジョブのマネージド ID にストレージ BLOB データ共同作成者ロールが付与されます。 Azure Data Lake Storage Gen2 のマネージド ID の詳細については、「マネージド ID を使用して、Azure Blob Storage に対して Azure Stream Analytics ジョブを認証する」を参照してください。

マネージド ID では、ユーザーベースの認証方法の制限が排除されます。 このような制限には、90 日ごとに発生するパスワードの変更やユーザー トークンの期限切れによる再認証の必要性が含まれます。

ADLS Gen2 では、ノー コード エディター出力として、厳密に 1 回の配信 (プレビュー) がサポートされています。 これは、ADLS Gen2 構成の [書き込みモード] セクションで有効にすることができます。 この機能の詳細については、Azure Data Lake Gen2 の厳密に 1 回限りの配信 (プレビュー)に関する記事を参照してください。

ADLS Gen2 では、ノー コード エディター出力として Delta Lake テーブルへの書き込み (プレビュー) がサポートされています。 このオプションは、ADLS Gen2 構成の [シリアル化] セクションにあります。 この機能の詳細については、Delta Lake テーブルへの書き込みに関する記事を参照してください。

Azure Synapse Analytics

Azure Stream Analytics ジョブは、Azure Synapse Analytics 内の専用 SQL プール テーブルに出力を送信し、1 秒あたり最大 200 MB のスループット レートを処理できます。 Stream Analytics は、レポートやダッシュボードなどのワークロードの最も要求の厳しいリアルタイム分析とホットパス データ処理のニーズをサポートします。

重要

Stream Analytics ジョブに出力として専用 SQL プール テーブルを追加するには、事前にそれが存在している必要があります。 テーブルのスキーマを、使用するジョブの出力内のフィールドとその型と一致させる必要があります。

リボン上の [出力] セクションで、Stream Analytics ジョブの出力として [Synapse] を選択します。 次に、ジョブの出力を送信する SQL プール テーブルを選択します。 Stream Analytics ジョブの Azure Synapse 出力の詳細については、「Azure Stream Analytics からの Azure Synapse Analytics 出力」を参照してください。

Azure Cosmos DB

Azure Cosmos DB は、世界中で弾力性のある無制限のスケーリングを提供するグローバル分散型データベース サービスです。 また、スキーマに依存しないデータ モデルを介して豊富なクエリと自動インデックス作成も提供します。

リボン上の [出力] セクションで、Stream Analytics ジョブの出力として [CosmosDB] を選択します。 Stream Analytics ジョブの Azure Cosmos DB 出力の詳細については、「Azure Stream Analytics からの Azure Cosmos DB 出力」を参照してください。

Azure Cosmos DBに接続するときに、認証モードとして Managed Identity を選択すると、Stream Analytics ジョブのマネージド ID に共同作成者ロールが付与されます。 Azure Cosmos DB のマネージド ID の詳細については、「マネージド ID を使用して Azure Stream Analytics ジョブから Cosmos DB にアクセスする (プレビュー)」を参照してください。

コードなしのエディターのAzure Cosmos DB出力では、マネージド ID 認証方法もサポートされています。 この方法には、ADLS Gen2 出力と同じ利点があります。

Azure SQL Database

Azure SQL Database は、サービスとしてのフル マネージド プラットフォーム (PaaS) データベース エンジンであり、Azureのアプリケーションとソリューションの高可用性と高パフォーマンスのデータ ストレージ 層を作成するのに役立ちます。 ノーコード エディターを使用すると、処理されたデータを SQL Database 内の既存のテーブルに書き込むよう Azure Stream Analytics ジョブを構成できます。

Azure SQL Database を出力として構成するには、リボン上の [出力] セクションで [SQL Database] を選択します。 次に、SQL データベースに接続するために必要な情報を入力し、データを書き込むテーブルを選択します。

重要

Azure SQL Database テーブルは、Stream Analytics ジョブに出力として追加する前に、存在している必要があります。 テーブルのスキーマを、使用するジョブの出力内のフィールドとその型と一致させる必要があります。

Stream Analytics ジョブの Azure SQL Database 出力の詳細については、「Azure Stream Analytics からの Azure SQL Database 出力」を参照してください。

Event Hubs

リアルタイム データが ASA に送信されると、コードなしのエディターでデータを変換してエンリッチし、データを別のイベント ハブに出力できます。 Azure Stream Analytics ジョブを構成するときに、[イベント ハブ] 出力を選択できます。

Event Hubs を出力として構成するには、リボンの [出力] セクションで [イベント ハブ] を選択します。 次に、データを書き込むイベント ハブに接続するために必要な情報を入力します。

Stream Analytics ジョブの Event Hubs 出力の詳細については、「Azure Stream Analytics からの Event Hubs 出力」を参照してください。

Azure Data Explorer

Azure Data Explorer は、大量のデータを簡単に分析できるようにする、フル マネージドで高性能なビッグ データ分析プラットフォームです。 Azure Data Explorer をコードなしのエディターを使用してAzure Stream Analytics ジョブの出力として使用することもできます。

Azure Data Explorerを出力として構成するには、リボンの

重要

テーブルは選択したデータベース内に存在する必要があり、テーブルのスキーマはジョブの出力内のフィールドおよびその型と正確に一致する必要があります。

Stream Analytics ジョブの Azure Data Explorer 出力の詳細については、「Azure Stream Analytics からの Azure Data Explorer 出力 (プレビュー)」を参照してください。

Power BI

Power BI では、データ分析結果に対する包括的な視覚化エクスペリエンスが提供されます。 Stream Analytics Power BI出力を使用すると、処理されたストリーミング データがPower BI ストリーミング データセットに書き込まれ、それを使用してほぼリアルタイムのPower BI ダッシュボードを構築できます。

Power BIを出力として構成するには、リボンの

データ プレビュー、作成エラー、ランタイム ログ、およびメトリック

ノーコード ドラッグ アンド ドロップ エクスペリエンスは、ストリーミング データの分析パイプラインの作成、トラブルシューティング、およびパフォーマンス評価を行うのに役立つツールを提供します。

入力のライブ データ プレビュー

イベント ハブなどの入力ソースに接続し、ダイアグラム ビュー ([ データ プレビュー ] タブ) でそのタイルを選択すると、次の条件がすべて満たされている場合、受信データのライブ プレビューが表示されます。

- データがプッシュされている。

- 入力が正しく構成されている。

- フィールドが追加されます。

次のスクリーンショットに示すように、特定のものを表示またはドリルダウンする場合は、プレビューを一時停止することができます (1)。 または、完了したら、再度開始できます。

また、特定のレコード (テーブル内の セル) の詳細を、それを選択し、[詳細の表示]/[詳細の非表示] を選択して表示することもできます (2)。 スクリーンショットに、レコードの入れ子になったオブジェクトの詳細ビューが示されています。

変換および出力の静的プレビュー

ダイアグラム ビューでステップを追加して設定したら、[静的プレビューの取得] を選択して、それらの動作をテストできます。

ボタンを選択すると、Stream Analytics ジョブはすべての変換と出力を評価して、正しく構成されていることを確認します。 次に、Stream Analytics により、次の図に示すように、結果が静的データ プレビューに表示されます。

プレビューを更新するには、 [静的プレビューの更新] を選択します (1)。 プレビューを更新すると、Stream Analytics ジョブは入力から新しいデータを受け取り、すべての変換を評価します。 その後で、実行された可能性のある更新を含む出力を再度送信します。 [詳細の表示]/[詳細の非表示] オプションも使用できます (2)。

作成エラー

作成エラーまたは警告がある場合は、次のスクリーンショットに示すように、[ 作成エラー ] タブに一覧表示されます。 この一覧には、エラーや警告の詳細、カードの種類 (入力、変換、または出力)、エラー レベル、エラーまたは警告の説明が含まれます。

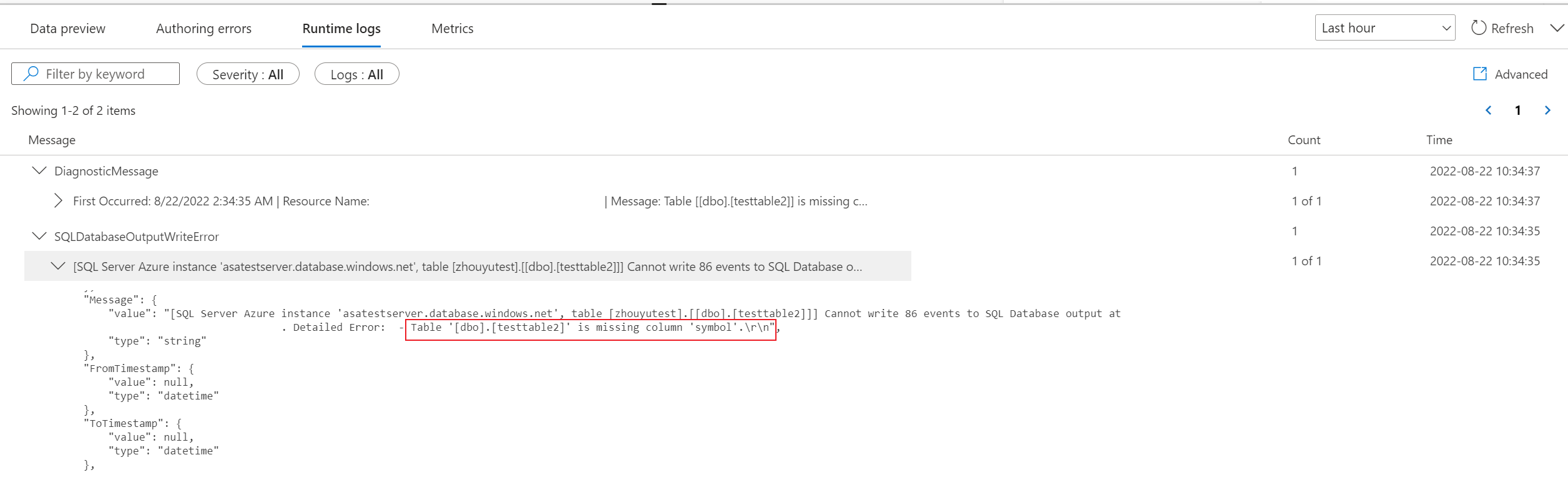

ランタイム ログ

ランタイム ログは、ジョブの実行中に警告、エラー、または情報レベルで表示されます。 このログは、トラブルシューティングのために Stream Analytics ジョブ トポロジまたは構成を編集するときに役立ちます。 診断ログを有効にし、Settings のLog Analytics ワークスペースに送信して、デバッグのために実行中のジョブに関する詳細情報を取得します。

次のスクリーンショットの例では、ユーザーはジョブ出力のフィールドと一致しないテーブル スキーマを使用して SQL Database の出力を構成します。

メトリック

ジョブが実行されている場合は、[メトリック] タブでジョブの正常性を監視できます。既定で表示される 4 つのメトリックは、ウォーターマークの遅延、入力イベント、バックログされた入力イベント、および出力イベントです。 これらのメトリックを使用して、イベントが入力バックログなしでジョブの送受信を行うかどうかを把握します。

リストからさらにメトリックを選択できます。 すべてのメトリックの詳細を理解するには、「Azure Stream Analytics のジョブ メトリック」を参照してください。

Stream Analytics ジョブの開始

ジョブの作成中はいつでもジョブを保存できます。 ジョブのストリーミング入力、変換、およびストリーミング出力を構成したら、ジョブを開始できます。

注意

Azure Stream Analytics ポータルのノーコード エディターはプレビュー段階ですが、Azure Stream Analytics サービスは一般提供されています。

以下のオプションを構成できます。

-

出力開始時刻: ジョブを開始するときに、ジョブが出力の作成を開始する時間を選択します。

- Now: このオプションにより、出力イベント ストリームの開始点がジョブの開始時と同じになります。

- カスタム: 出力の開始点を選択します。

- [最終停止時刻]: このオプションは、以前にジョブが開始されたが、手動で停止されたか失敗した場合に使用できます。 このオプションを選択すると、最後の出力時刻がジョブの再起動に使用されるため、データは失われません。

- [ストリーミング ユニット]: ストリーミング ユニット (SU) は、実行中にジョブに割り当てられたコンピューティングとメモリの量を表します。 選択する SU の数がわからない場合は、3 から始めて、必要に応じて調整します。

- [出力データ エラー処理]: 出力データ エラー処理に関するポリシーは、Stream Analytics ジョブで生成された出力イベントがターゲット シンクのスキーマに準拠していない場合にのみ適用されます。 [再試行] または [ドロップ] を選択して、ポリシーを構成します。 詳細については、「Azure Stream Analytics の出力エラー ポリシー」を参照してください。

- [スタート]: このボタンは Stream Analytics ジョブを開始します。

Azure Event Hubs ポータルの Stream Analytics ジョブ リスト

Azure Event Hubs ポータルのノーコード ドラッグ アンド ドロップ エクスペリエンスを使用して作成したすべての Stream Analytics ジョブの一覧を表示するには、[データの処理]>[Stream Analytics ジョブ] を選択します。

Stream Analytics ジョブ タブの要素を次に示します。

- フィルター: ジョブ名で一覧をフィルター処理します。

- [更新]: 現在、リスト自体は自動的に更新されません。 リストを更新して、最新の状態を表示する場合に、[更新] ボタンを使用します。

- ジョブ名: この領域の名前は、ジョブ作成の最初の手順で指定した名前です。 編集することはできません。 ジョブ名を選択して、ジョブをノーコード ドラッグ アンド ドロップ エクスペリエンスで開きます。このエクスペリエンスでは、ジョブを停止して、編集し、再開できます。

- [状態]: この領域にはジョブの状態が表示されます。 リストの上部にある [更新] を選択すると、最新の状態が表示されます。

- ストリーミング ユニット: この領域には、ジョブの開始時に選択したストリーミング ユニットの数が表示されます。

- 出力ウォーターマーク: この領域は、ジョブが生成するデータの鮮度を示すインジケーターを提供します。 タイムスタンプより前のすべてのイベントは既に計算されています。

- [ジョブの監視]: [オープン メトリック] を選択して、この Stream Analytics ジョブに関連するメトリックを表示します。 Stream Analytics ジョブの監視に使用できるメトリックの詳細については、「Azure Stream Analytics のジョブ メトリック」を参照してください。

- [操作]: ジョブを開始、停止、または削除します。

次の手順

事前定義されたテンプレートを使用することによって一般的なシナリオに対処するためにノーコード エディターを使用する方法について説明します。

![[データ プレビュー] タブが表示されたスクリーンショット。このタブでは、ストリーミング プレビューを一時停止し、詳細を表示または非表示にすることができます。](media/no-code-stream-processing/data-preview.png)

![静的プレビューを更新できる [データ プレビュー] タブが表示されたスクリーンショット。](media/no-code-stream-processing/refresh-static-preview.png)

![[保存] ボタンと [スタート] ボタンが表示されたスクリーンショット。](media/no-code-stream-processing/no-code-save-start.png)