Ai-beveiligingspostuurbeheer (preview)

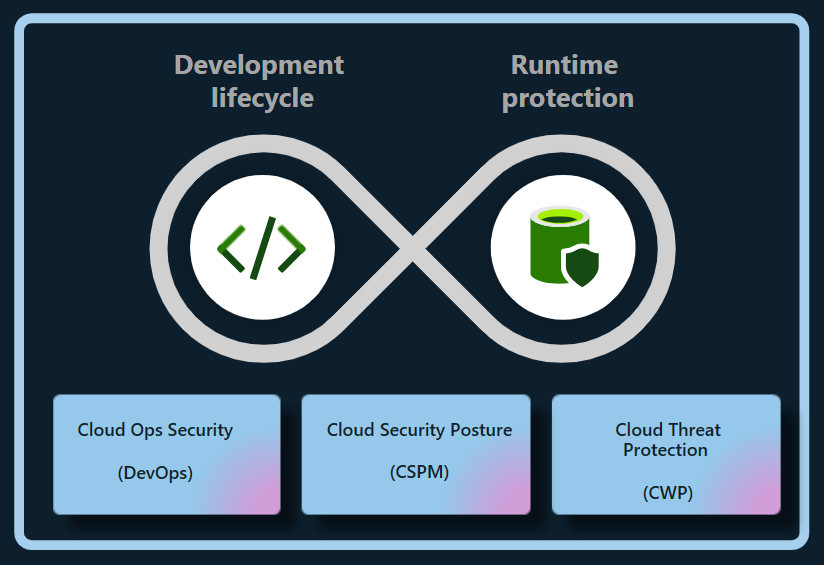

Het abonnement Defender Cloud Security Posture Management (CSPM) in Microsoft Defender voor Cloud biedt ai-beveiligingspostuurbeheermogelijkheden waarmee geavanceerde AI-toepassingen (momenteel Azure en AWS) in de hele levenscyclus van de toepassing worden beveiligd. Defender voor Cloud vermindert het risico voor AI-workloads in de cloud door:

- Detectie van generatieve AI Bill of Materials (AI BOM), waaronder toepassingsonderdelen, gegevens en AI-artefacten van code naar cloud.

- Versterking van de generatieve beveiligingsstatus van AI-toepassingen met ingebouwde aanbevelingen en door beveiligingsrisico's te verkennen en op te lossen.

- Gebruik de analyse van het aanvalspad om risico's te identificeren en op te lossen.

Belangrijk

De mogelijkheden van AI-beveiligingspostuurbeheer inschakelen voor een AWS-account dat al bestaat:

- Is verbonden met uw Azure-account.

- Defender CSPM is ingeschakeld.

- Heeft het machtigingstype ingesteld als Toegang tot minimale bevoegdheden.

U moet de machtigingen voor die connector opnieuw configureren om de relevante machtigingen in te schakelen met behulp van deze stappen:

- Ga in Azure Portal naar de pagina Omgevingsinstellingen en selecteer de juiste AWS-connector.

- Selecteer Toegang configureren.

- Zorg ervoor dat het machtigingstype is ingesteld op Toegang tot minimale bevoegdheden.

- Volg stap 5 tot en met 8 om de configuratie te voltooien.

Generatieve AI-apps detecteren

Defender voor Cloud AI-workloads detecteert en details van de AI-BOM van uw organisatie identificeert. Met deze zichtbaarheid kunt u beveiligingsproblemen identificeren en aanpakken en generatieve AI-toepassingen beschermen tegen mogelijke bedreigingen.

Defenders for Cloud detecteert automatisch en continu geïmplementeerde AI-workloads in de volgende services:

- Azure OpenAI Service

- Azure Machine Learning

- Amazon Bedrock

Defender voor Cloud kan ook beveiligingsproblemen detecteren binnen generatieve AI-bibliotheekafhankelijkheden, zoals TensorFlow, PyTorch en Langchain, door broncode te scannen op onjuiste configuraties van Infrastructure as Code (IaC) en containerinstallatiekopieën op beveiligingsproblemen. Het regelmatig bijwerken of patchen van de bibliotheken kan aanvallen voorkomen, generatieve AI-toepassingen beveiligen en hun integriteit behouden.

Met deze functies biedt Defender voor Cloud volledige zichtbaarheid van AI-workloads van code naar cloud.

Risico's verminderen voor generatieve AI-apps

Defender CSPM biedt contextuele inzichten in het AI-beveiligingspostuur van een organisatie. U kunt risico's binnen uw AI-workloads verminderen met behulp van aanbevelingen voor beveiliging en analyse van aanvalspaden.

Risico's verkennen met behulp van aanbevelingen

Defender voor Cloud evalueert AI-workloads en aanbevelingen voor problemen met betrekking tot identiteit, gegevensbeveiliging en internetblootstelling om kritieke beveiligingsproblemen in AI-workloads te identificeren en te prioriteren.

IaC-onjuiste configuraties detecteren

Met DevOps-beveiliging worden onjuiste configuraties van IaC gedetecteerd, waardoor generatieve AI-toepassingen kunnen worden blootgesteld aan beveiligingsproblemen, zoals overbelichte toegangsbeheer of onbedoeld openbaar blootgestelde services. Deze onjuiste configuraties kunnen leiden tot schendingen van gegevens, onbevoegde toegang en nalevingsproblemen, met name bij het afhandelen van strikte regelgeving voor gegevensprivacy.

Defender voor Cloud evalueert de configuratie van uw generatieve AI-apps en biedt beveiligingsaanaanveling om het AI-beveiligingspostuur te verbeteren.

Gedetecteerde onjuiste configuraties moeten vroeg in de ontwikkelingscyclus worden hersteld om later complexere problemen te voorkomen.

Huidige IaC AI-beveiligingscontroles zijn onder andere:

- Privé-eindpunten van Azure AI-service gebruiken

- Azure AI-service-eindpunten beperken

- Beheerde identiteit gebruiken voor Azure AI-serviceaccounts

- Verificatie op basis van identiteit gebruiken voor Azure AI-serviceaccounts

Risico's verkennen met analyse van aanvalspaden

Analyse van aanvalspaden detecteert en vermindert risico's voor AI-workloads, met name tijdens aarding (AI-modellen koppelen aan specifieke gegevens) en het afstemmen (aanpassen van een vooraf getraind model op een specifieke gegevensset om de prestaties van een gerelateerde taak te verbeteren) waarbij gegevens mogelijk worden weergegeven.

Door AI-workloads continu te bewaken, kan analyse van aanvalspaden zwakke punten en potentiële beveiligingsproblemen identificeren en aanbevelingen opvolgen. Daarnaast wordt het uitgebreid tot gevallen waarin de gegevens en rekenresources worden gedistribueerd over Azure, AWS en GCP.