AI-appmallar

I det här avsnittet av dokumentationen får du lära dig om AI-appmallar och relaterade artiklar som använder dessa mallar för att visa hur du utför viktiga uppgifter för utvecklare. Med AI-appmallar får du väl underhållna och enkla att distribuera referensimplementeringar som hjälper dig att säkerställa en högkvalitativ startpunkt för dina AI-appar.

Det finns två kategorier av AI-appmallar, byggstenar och lösningar från slutpunkt till slutpunkt. I följande avsnitt beskrivs några av de viktigaste mallarna i varje kategori för det programmeringsspråk som du har valt överst i den här artikeln. Om du vill bläddra i en mer omfattande lista med dessa och andra mallar kan du läsa AI-appmallarna i galleriet AI-appmallar.

Byggblocken

Byggstenar är mindre skalningsexempel som fokuserar på specifika scenarier och uppgifter. De flesta byggstenar visar funktioner som utnyttjar lösningen från slutpunkt till slutpunkt för en chattapp som använder dina egna data.

| Byggblock | beskrivning |

|---|---|

| Belastningsutjämning med Azure Container Apps | Lär dig hur du lägger till belastningsutjämning i ditt program för att utöka chattappen utöver gränserna för Azure OpenAI-token och modellkvoter. Den här metoden använder Azure Container Apps för att skapa tre Azure OpenAI-slutpunkter samt en primär container för att dirigera inkommande trafik till en av de tre slutpunkterna. |

| Byggblock | beskrivning |

|---|---|

| Konfigurera dokumentsäkerhet för chattappen | När du skapar ett chattprogram med HJÄLP av RAG-mönstret med dina egna data kontrollerar du att varje användare får ett svar baserat på deras behörigheter. En behörig användare bör ha åtkomst till svar som finns i chattappens dokument. En obehörig användare bör inte ha åtkomst till svar från skyddade dokument som de inte har behörighet att se. |

| Utvärdera chattappens svar | Lär dig hur du utvärderar en chattapps svar mot en uppsättning korrekta eller idealiska svar (kallas grundsanning). När du ändrar chattprogrammet på ett sätt som påverkar svaren kör du en utvärdering för att jämföra ändringarna. Det här demoprogrammet erbjuder verktyg som du kan använda i dag för att göra det enklare att köra utvärderingar. |

| Belastningsutjämning med Azure Container Apps | Lär dig hur du lägger till belastningsutjämning i ditt program för att utöka chattappen utöver gränserna för Azure OpenAI-token och modellkvoter. Den här metoden använder Azure Container Apps för att skapa tre Azure OpenAI-slutpunkter samt en primär container för att dirigera inkommande trafik till en av de tre slutpunkterna. |

| Belastningsutjämning med API Management | Lär dig hur du lägger till belastningsutjämning i ditt program för att utöka chattappen utöver gränserna för Azure OpenAI-token och modellkvoter. Den här metoden använder Azure API Management för att skapa tre Azure OpenAI-slutpunkter samt en primär container för att dirigera inkommande trafik till en av de tre slutpunkterna. |

| Läs in test av Python-chattappen med Locust | Lär dig hur du utför belastningstestning i ett Python-chattprogram med hjälp av RAG-mönstret med Locust, ett populärt verktyg för belastningstestning med öppen källkod. Det primära målet med belastningstestning är att säkerställa att den förväntade belastningen i chattprogrammet inte överskrider den aktuella TPM-kvoten (Azure OpenAI Transactions Per Minute). Genom att simulera användarbeteende under hög belastning kan du identifiera potentiella flaskhalsar och skalbarhetsproblem i ditt program. |

| Skydda din AI-app med nyckellös autentisering | Lär dig hur du skyddar ditt Python Azure OpenAI-chattprogram med nyckellös autentisering. Programbegäranden till de flesta Azure-tjänster ska autentiseras med nyckellösa eller lösenordslösa anslutningar. Nyckellös autentisering ger bättre hanterings- och säkerhetsfördelar jämfört med kontonyckeln eftersom det inte finns någon nyckel (eller anslutningssträng) att lagra. |

| Byggblock | beskrivning |

|---|---|

| Belastningsutjämning med Azure Container Apps | Lär dig hur du lägger till belastningsutjämning i ditt program för att utöka chattappen utöver gränserna för Azure OpenAI-token och modellkvoter. Den här metoden använder Azure Container Apps för att skapa tre Azure OpenAI-slutpunkter samt en primär container för att dirigera inkommande trafik till en av de tre slutpunkterna. |

| Byggblock | beskrivning |

|---|---|

| Utvärdera chattappens svar | Lär dig hur du utvärderar en chattapps svar mot en uppsättning korrekta eller idealiska svar (kallas grundsanning). När du ändrar chattprogrammet på ett sätt som påverkar svaren kör du en utvärdering för att jämföra ändringarna. Det här demoprogrammet erbjuder verktyg som du kan använda i dag för att göra det enklare att köra utvärderingar. |

| Belastningsutjämning med Azure Container Apps | Lär dig hur du lägger till belastningsutjämning i ditt program för att utöka chattappen utöver gränserna för Azure OpenAI-token och modellkvoter. Den här metoden använder Azure Container Apps för att skapa tre Azure OpenAI-slutpunkter samt en primär container för att dirigera inkommande trafik till en av de tre slutpunkterna. |

| Belastningsutjämning med API Management | Lär dig hur du lägger till belastningsutjämning i ditt program för att utöka chattappen utöver gränserna för Azure OpenAI-token och modellkvoter. Den här metoden använder Azure API Management för att skapa tre Azure OpenAI-slutpunkter samt en primär container för att dirigera inkommande trafik till en av de tre slutpunkterna. |

Lösningar från slutpunkt till slutpunkt

Lösningar från slutpunkt till slutpunkt är omfattande referensexempel, inklusive dokumentation, källkod och distribution så att du kan ta och utöka för dina egna syften.

Chatta med dina data med Hjälp av Azure OpenAI och Azure AI Search med .NET

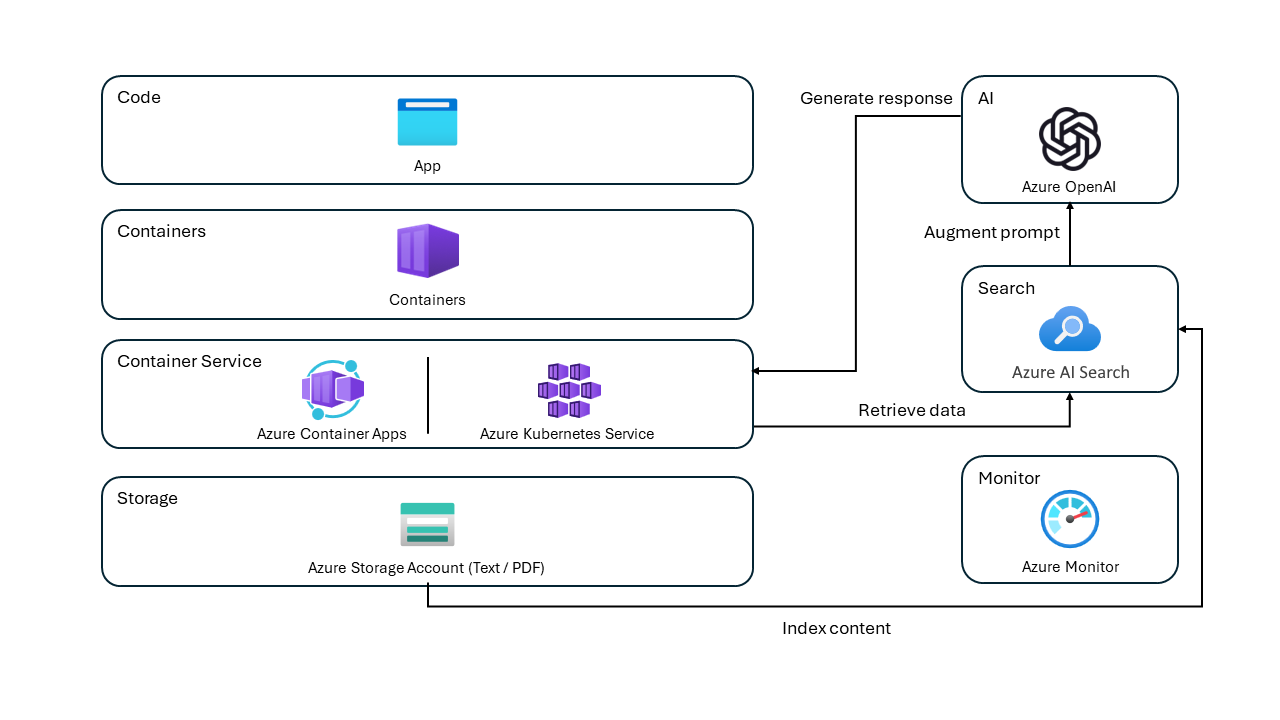

Den här mallen är en komplett lösning från slutpunkt till slutpunkt som visar RAG-mönstret (Retrieval-Augmented Generation) som körs i Azure. Den använder Azure AI Search för hämtning och stora språkmodeller i Azure OpenAI för att driva ChattGPT-stil och Q&A-upplevelser.

Om du vill komma igång med den här mallen kan du läsa Kom igång med chatten med ditt eget dataexempel för .NET. Om du vill komma åt källkoden och läsa detaljerad information om mallen kan du läsa GitHub-lagringsplatsen azure-search-openai-demo-csharp .

Den här mallen visar hur dessa funktioner används.

| Azure-värdlösning | Terknik | AI-modeller |

|---|---|---|

| Azure Container Apps Azure Functions |

Azure OpenAI Azure Computer Vision Formigenkänning i Azure Azure AI-sökning Azure Storage |

GPT 3.5 Turbo GPT 4.0 |

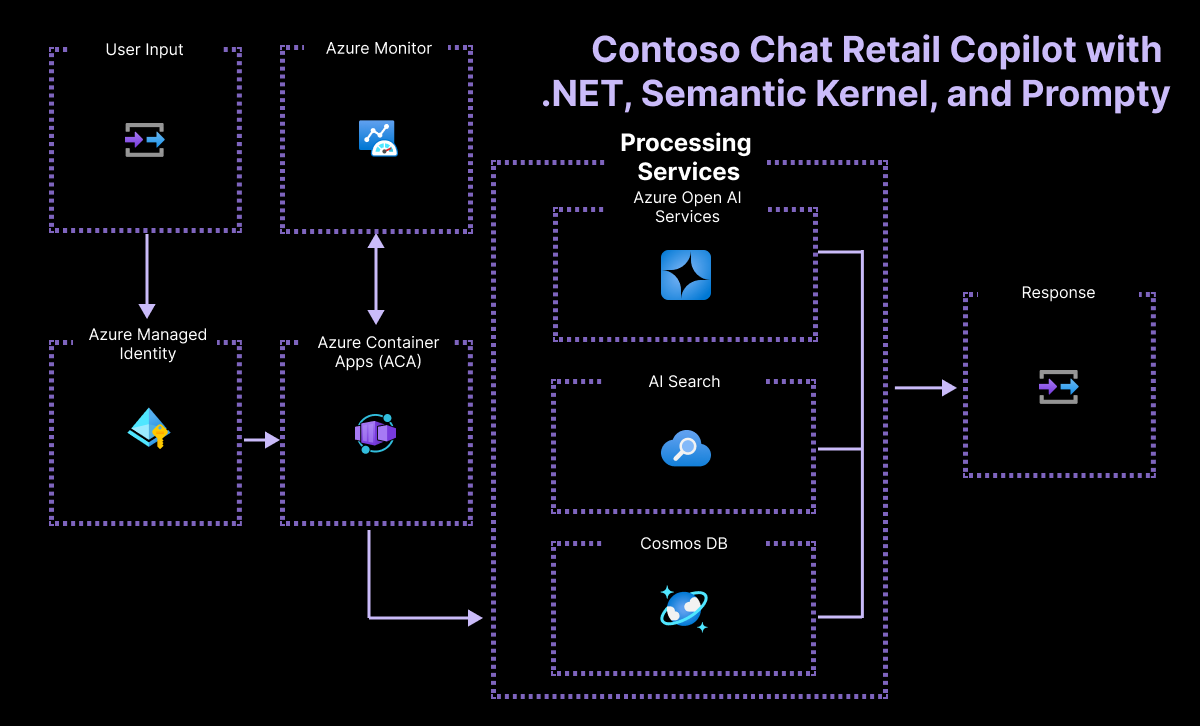

Contoso chattbutik copilot med .NET och semantisk kernel

Den här mallen implementerar Contoso Outdoors, en konceptbutik som specialiserat sig på utomhusutrustning för vandrings- och campingentusiaster. Den här virtuella butiken förbättrar kundengagemanget och säljsupporten via en intelligent chattagent. Den här agenten drivs av RAG-mönstret (Retrieval Augmented Generation) i Microsoft Azure AI Stack, berikad med stöd för semantisk kernel och prompty.

Information om mallen finns i GitHub-lagringsplatsen contoso-chat-csharp-prompty för att komma åt källkoden och läsa detaljerad information om mallen.

Den här mallen visar hur dessa funktioner används.

| Azure-värdlösning | Terknik | AI-modeller |

|---|---|---|

| Azure Container Apps |

Azure OpenAI Microsoft Entra ID Azure Managed Identity Azure Monitor Azure AI-sökning Azure AI Foundry Azure SQL Azure Storage |

GPT 3.5 Turbo GPT 4.0 |

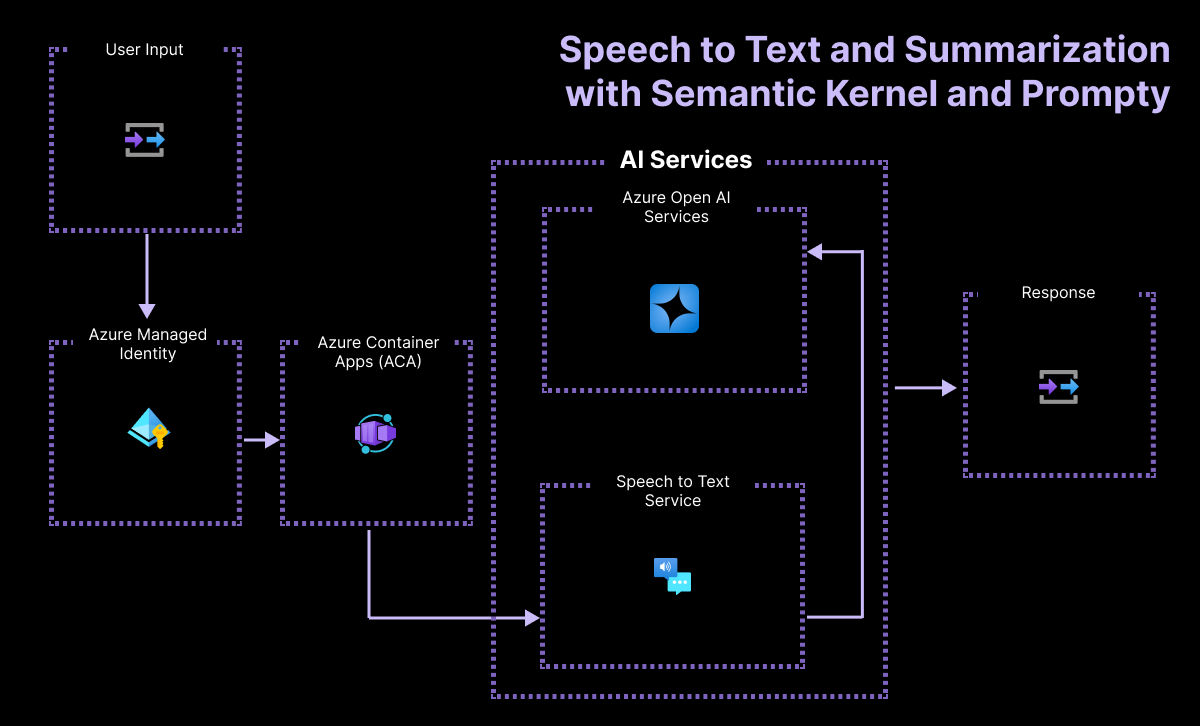

Processautomatisering med tal till text och sammanfattning med .NET och GPT 3.5 Turbo

Den här mallen är en processautomatiseringslösning som tar emot problem som rapporteras av fält- och verkstadsarbetare på ett företag som heter Contoso Manufacturing, ett tillverkningsföretag som tillverkar bilbatterier. Problemen delas av arbetarna antingen live via mikrofoninmatning eller förinspelade som ljudfiler. Lösningen översätter ljudindata från tal till text och använder sedan en LLM och Prompty eller Promptflow för att sammanfatta problemet och returnera resultatet i ett format som anges av lösningen.

Om du vill komma åt källkoden och läsa detaljerad information om mallen kan du läsa GitHub-lagringsplatsen summarization-openai-csharp-prompty .

Den här mallen visar hur dessa funktioner används.

| Azure-värdlösning | Terknik | AI-modeller |

|---|---|---|

| Azure Container Apps | Tal till text Summering Azure OpenAI |

GPT 3.5 Turbo |

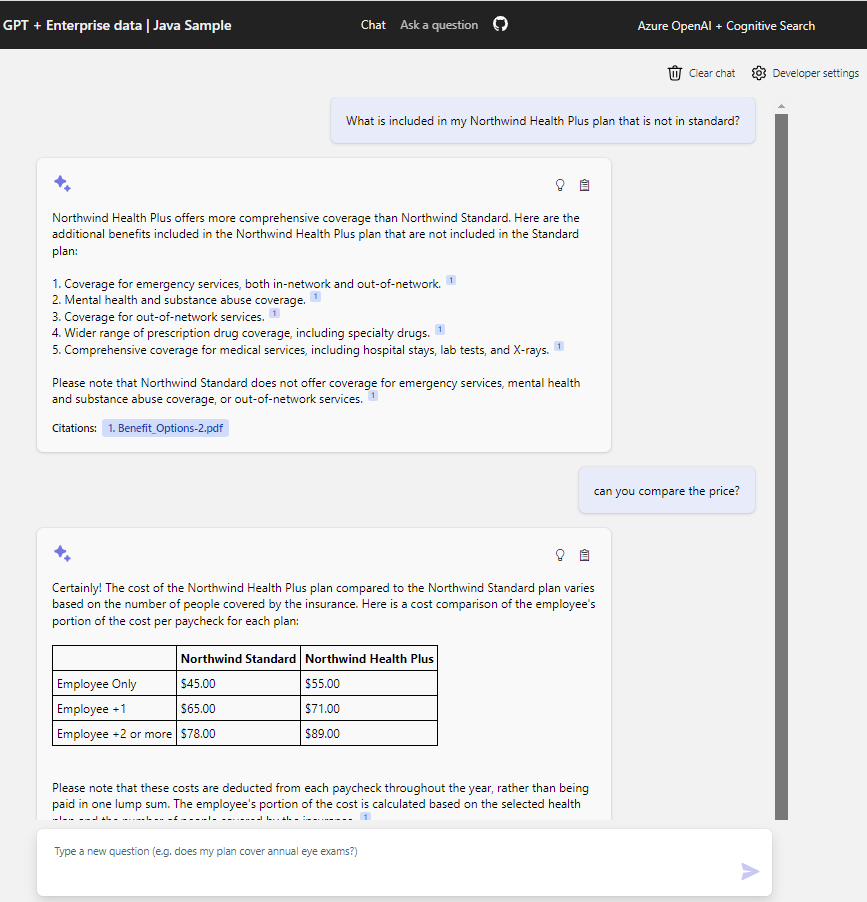

Chatta med dina data med Azure OpenAI och Azure AI Search med Python

Den här mallen är en komplett lösning från slutpunkt till slutpunkt som visar RAG-mönstret (Retrieval-Augmented Generation) som körs i Azure. Den använder Azure AI Search för hämtning och stora språkmodeller i Azure OpenAI för att ge funktioner i ChatGPT-stil och frågor och svar (Q&A).

Kom igång med den här mallen genom att läsa Kom igång med chatten med ditt eget dataexempel för Python. Information om mallen finns i GitHub-lagringsplatsen azure-search-openai-demo för att få åtkomst till källkoden och läsa detaljerad information om mallen.

Den här mallen visar hur dessa funktioner används.

| Azure-värdlösning | Terknik | AI-modeller |

|---|---|---|

| Azure Container Apps | Azure OpenAI Azure AI-sökning Azure Blob Storage Azure Monitor Azure Document Intelligence |

GPT 3.5 Turbo GPT-4 GPT 4o GPT 4o-mini |

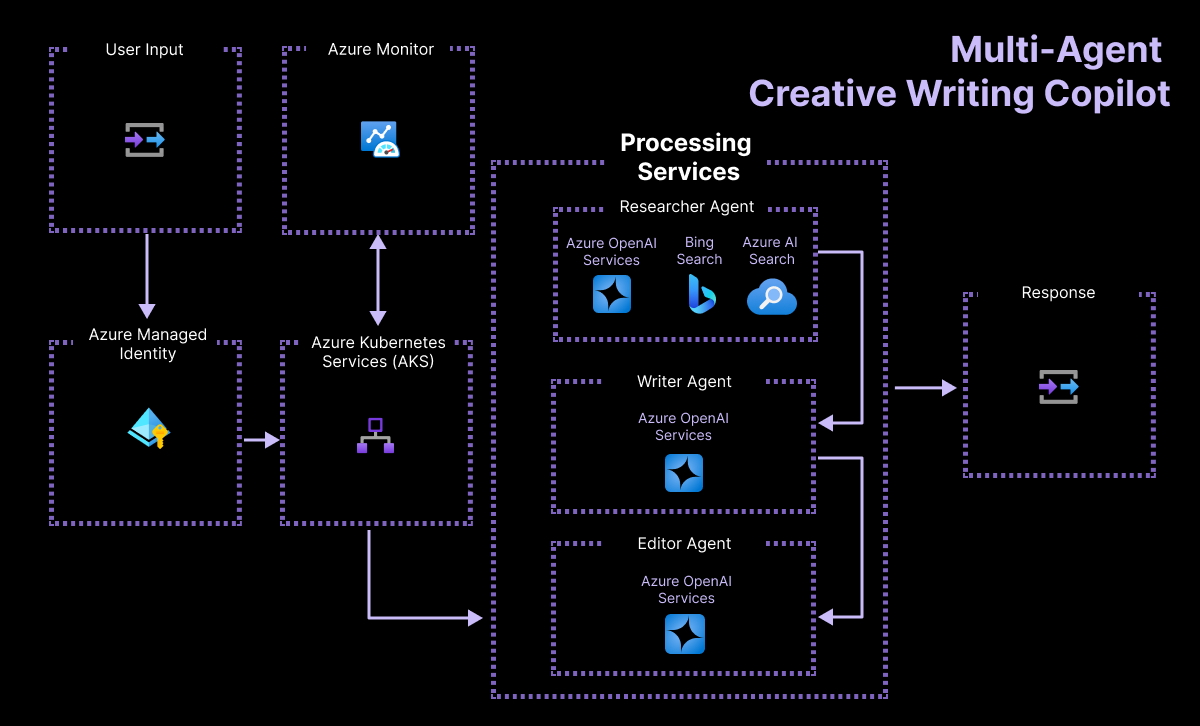

Multi-Modal Creative Writing Copilot med DALL-E

Den här mallen är en kreativ lösning för att skriva flera agenter som hjälper användarna att skriva artiklar. Den visar hur du skapar och arbetar med AI-agenter som drivs av Azure OpenAI.

Den innehåller:

- En Flask-app som tar en artikel och instruktioner från en användare.

- En forskningsagent som använder API:et för Bing-sökning för att undersöka artikeln.

- En produktagent som använder Azure AI Search för att göra en semantisk likhetssökning efter relaterade produkter från ett vektorlager.

- En skrivaragent som kombinerar forskning och produktinformation i en användbar artikel.

- En redigeraragent för att förfina artikeln som presenteras för användaren.

Information om mallen finns i GitHub-lagringsplatsen agent-openai-python-prompty för att komma åt källkoden och läsa detaljerad information om mallen.

Den här mallen visar hur dessa funktioner används.

| Azure-värdlösning | Terknik | AI-modeller |

|---|---|---|

| Azure Container Registry Azure Kubernetes |

Azure OpenAI Bing-sökning Azure Managed Identity Azure Monitor Azure AI-sökning Azure AI Foundry |

GPT 3.5 Turbo GPT 4.0 DALL-E |

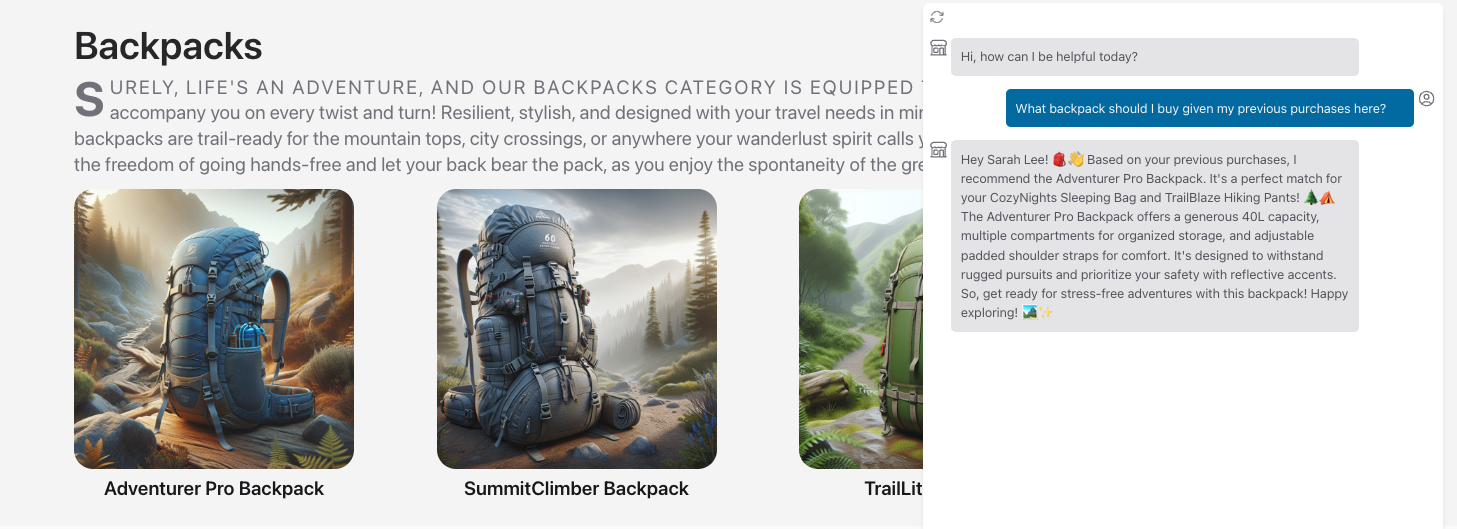

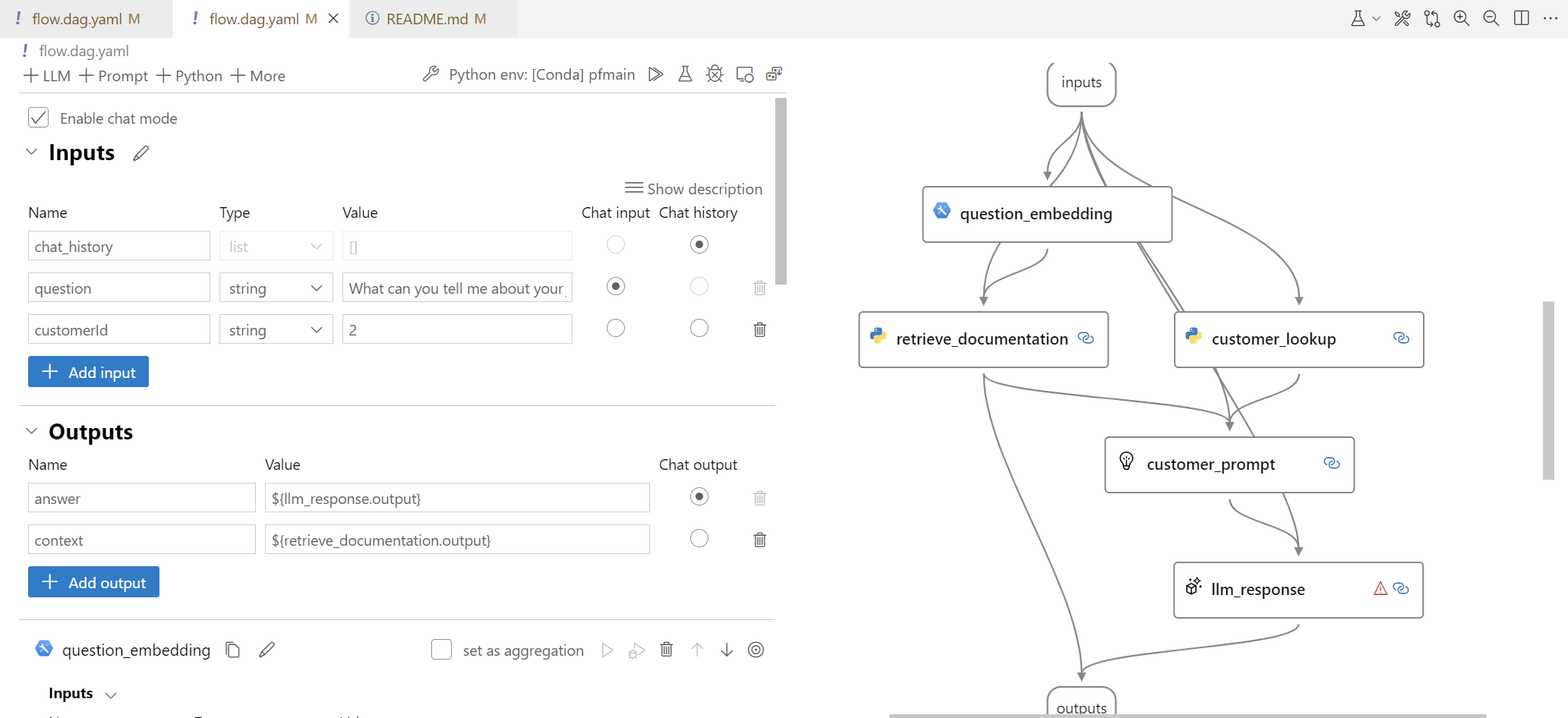

Contoso Chat Retail Copilot med Azure AI Foundry

Den här mallen implementerar Contoso Chat – en detaljhandelslösning för Contoso Outdoor som använder ett designmönster för hämtning av utökad generation för att slipa chattrobotsvar i återförsäljarens produkt- och kunddata. Kunder kan ställa frågor från webbplatsen på naturligt språk och få relevanta svar med potentiella rekommendationer baserat på deras inköpshistorik – med ansvarsfulla AI-metoder för att säkerställa svarskvalitet och säkerhet.

Den här mallen illustrerar arbetsflödet från slutpunkt till slutpunkt (GenAIOps) för att skapa en RAG-baserad copilot-kod först med Azure AI och Prompty. Genom att utforska och distribuera det här exemplet lär du dig att:

- Ideate och iterera snabbt på appprototyper med prompty

- Distribuera och använda Azure OpenAI-modeller för chatt, inbäddningar och utvärdering

- Använd Azure AI Search (index) och Azure Cosmos DB (databaser) för dina data

- Utvärdera chattsvar för kvalitet med hjälp av AI-assisterade utvärderingsflöden

- Vara värd för programmet som en FastAPI-slutpunkt som distribuerats till Azure Container Apps

- Etablera och distribuera lösningen med hjälp av Azure Developer CLI

- Stödja ansvarsfulla AI-metoder med innehållssäkerhet och utvärderingar

Information om mallen finns i GitHub-lagringsplatsen contoso-chat för att få åtkomst till källkoden och läsa detaljerad information om mallen.

Den här mallen visar hur dessa funktioner används.

| Azure-värdlösning | Terknik | AI-modeller |

|---|---|---|

| Azure Container Apps |

Azure OpenAI Azure AI-sökning Azure AI Foundry Fråga Azure Cosmos DB |

GPT 3.5 Turbo GPT 4.0 Managed Integration Runtime (MIR) |

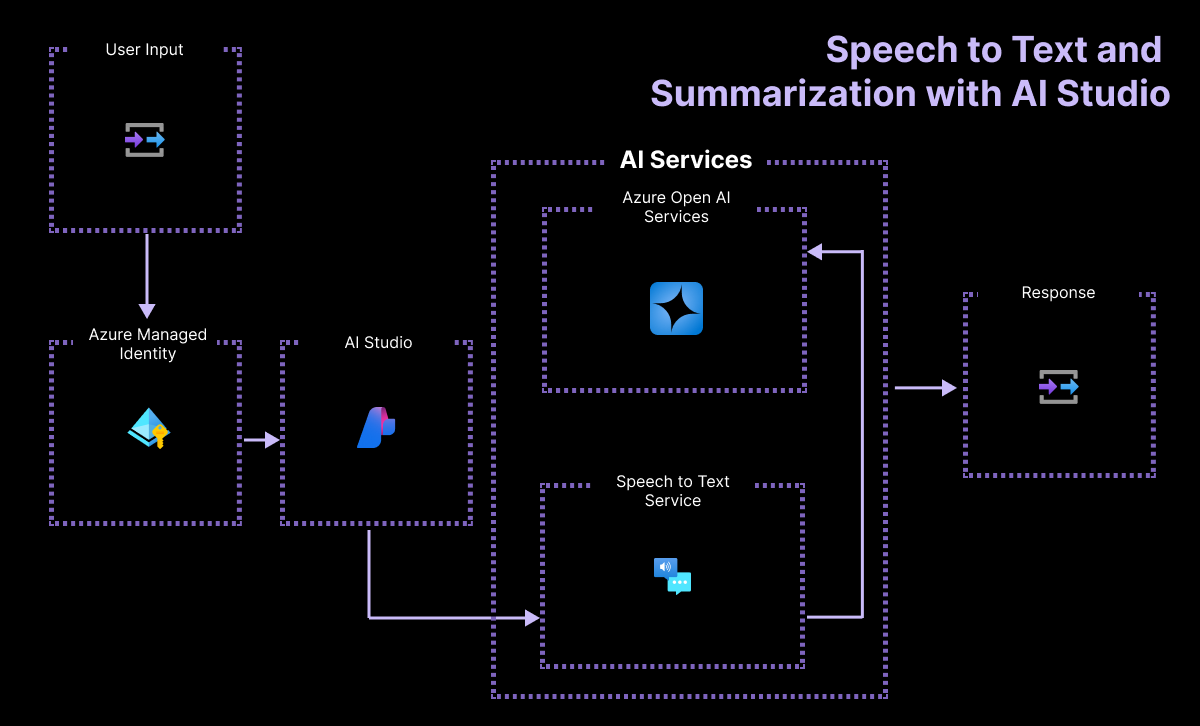

Processautomatisering med tal till text och sammanfattning med Azure AI Foundry

Den här mallen skapar en webbaserad app som gör att arbetare på ett företag som heter Contoso Manufacturing kan rapportera problem via text eller tal. Ljudindata översätts till text och sammanfattas sedan för att markera viktig information och rapporten skickas till lämplig avdelning.

Information om mallen finns i GitHub-lagringsplatsen summarization-openai-python-promptflow för att få åtkomst till källkoden och läsa detaljerad information om mallen.

Den här mallen visar hur dessa funktioner används.

| Azure-värdlösning | Terknik | AI-modeller |

|---|---|---|

| Azure Container Apps | Azure AI Foundry Tal till text-tjänsten Fråga Managed Integration Runtime (MIR) |

GPT 3.5 Turbo |

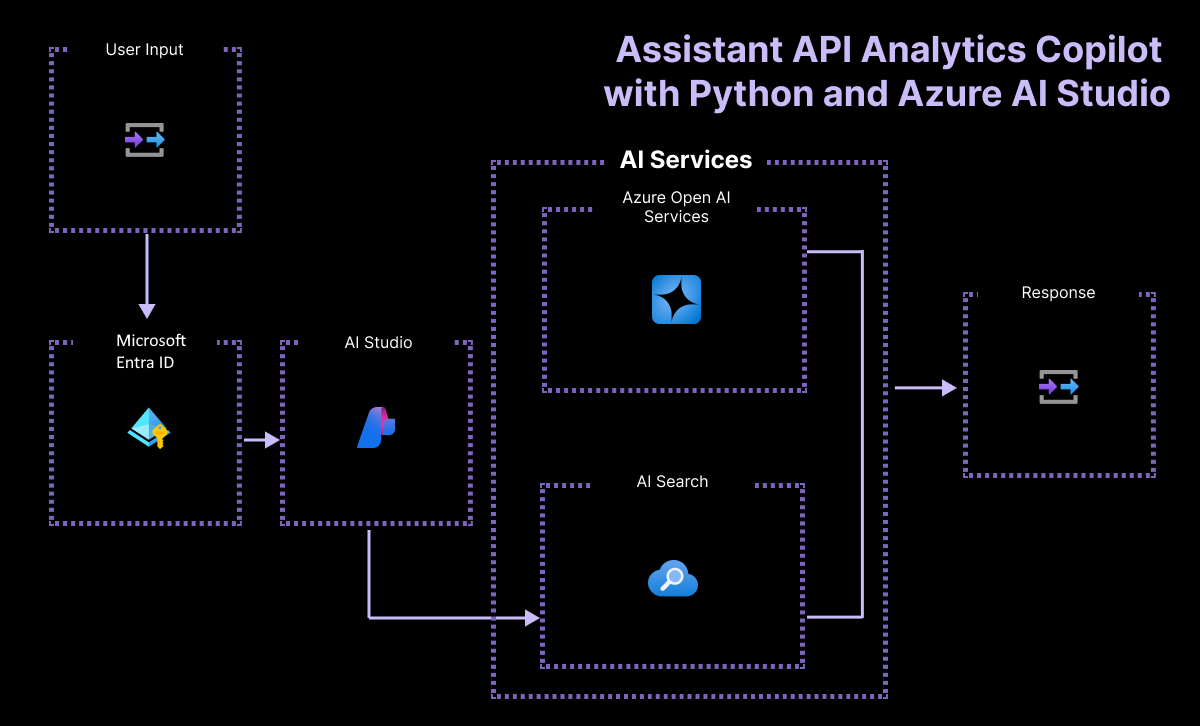

Assistant API Analytics Copilot med Python och Azure AI Foundry

Den här mallen är ett assistent-API för att chatta med tabelldata och utföra analyser på naturligt språk.

Information om mallen finns i GitHub-lagringsplatsen assistant-data-openai-python-promptflow för att få åtkomst till källkoden och läsa detaljerad information om mallen.

Den här mallen visar hur dessa funktioner används.

| Azure-värdlösning | Terknik | AI-modeller |

|---|---|---|

| Machine Learning Service | Azure AI-sökning Azure AI Foundry Managed Integration Runtime (MIR) Azure OpenAI |

GPT 3.5 Turbo GPT-4 |

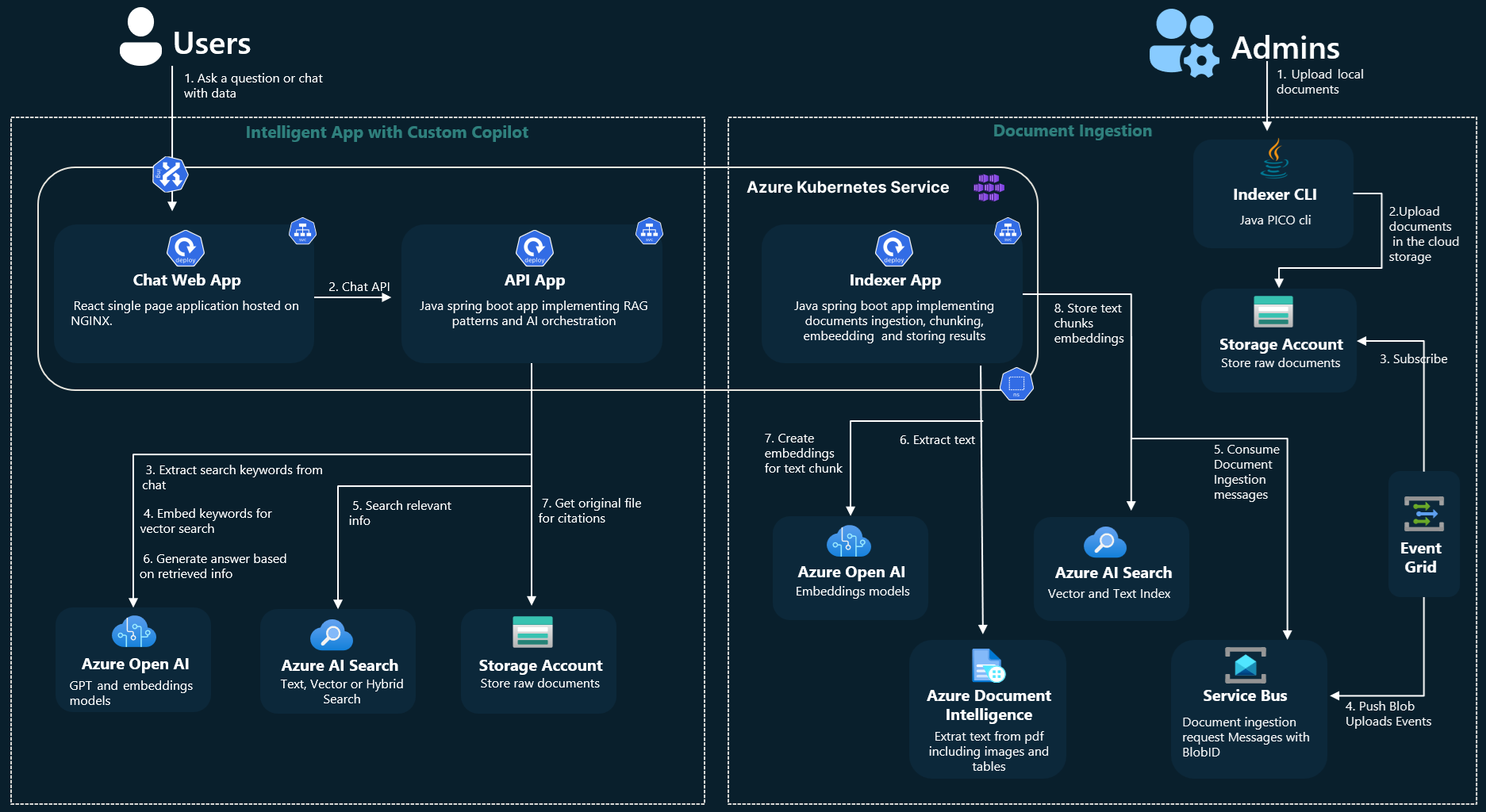

Chatta med dina data med Hjälp av Azure OpenAI och Azure AI Search med Java

Den här mallen är en komplett lösning från slutpunkt till slutpunkt som visar RAG-mönstret (Retrieval-Augmented Generation) som körs i Azure. Den använder Azure AI Search för hämtning och stora språkmodeller i Azure OpenAI för att driva ChattGPT-stil och Q&A-upplevelser.

Om du vill komma igång med den här mallen kan du läsa Kom igång med chatten med ditt eget dataexempel för Java. Information om mallen finns i GitHub-lagringsplatsen azure-search-openai-demo-java för att få åtkomst till källkoden och läsa detaljerad information om mallen.

Den här mallen visar hur dessa funktioner används.

| Azure-värdlösning | Terknik | AI-modeller |

|---|---|---|

| Azure App Service Azure Container Apps Azure Kubernetes Service |

Azure OpenAI Azure AI-sökning Azure Document Intelligence Azure Storage Azure App Insights Azure Service Bus Azure Event Grid |

gpt-35-turbo |

Flera agenters bankassistent med Java och Semantisk Kernel

Det här projektet är utformat som ett konceptbevis (PoC) för att utforska den innovativa sfären av generativ AI inom ramen för arkitekturer med flera agenter. Genom att använda Java och Microsoft Semantic Kernel AI-orkestreringsramverk är vårt mål att skapa en chattwebbapp för att visa genomförbarheten och tillförlitligheten med generativa AI-agenter för att omvandla användarupplevelsen från webbklick till konversationer på naturligt språk samtidigt som återanvändning av befintliga arbetsbelastningsdata och API:er maximeras.

Det grundläggande användningsfallet kretsar kring en personlig bankassistent som är utformad för att revolutionera hur användare interagerar med sin bankkontoinformation, transaktionshistorik och betalningsfunktioner. Den här assistenten använder kraften i generativ AI inom en arkitektur med flera agenter och syftar till att tillhandahålla ett sömlöst konversationsgränssnitt genom vilket användarna enkelt kan komma åt och hantera sina finansiella data.

Exempel på fakturor ingår i datamappen för att göra det enkelt att utforska betalningsfunktionen. Betalningsagenten som är utrustad med ocr-verktyg (optisk teckenigenkänning) (Azure Document Intelligence) leder konversationen med användaren för att extrahera fakturadata och initiera betalningsprocessen. Andra falska kontodata – till exempel transaktioner, betalningsmetoder och kontosaldo – är också tillgängliga för frågor från användaren. Alla data och tjänster exponeras som externa REST-API:er och används av agenterna för att ge användaren den begärda informationen.

Om du vill komma åt källkoden och läsa detaljerad information om mallen kan du läsa agent-openai-java-banking-assistant GitHub-lagringsplats.

Den här mallen visar hur dessa funktioner används.

| Azure-värdlösning | Terknik | AI-modeller |

|---|---|---|

| Azure Container Apps | Azure OpenAI Azure Document Intelligence Azure Storage Azure Monitor |

gpt-4o gpt-4o-mini |

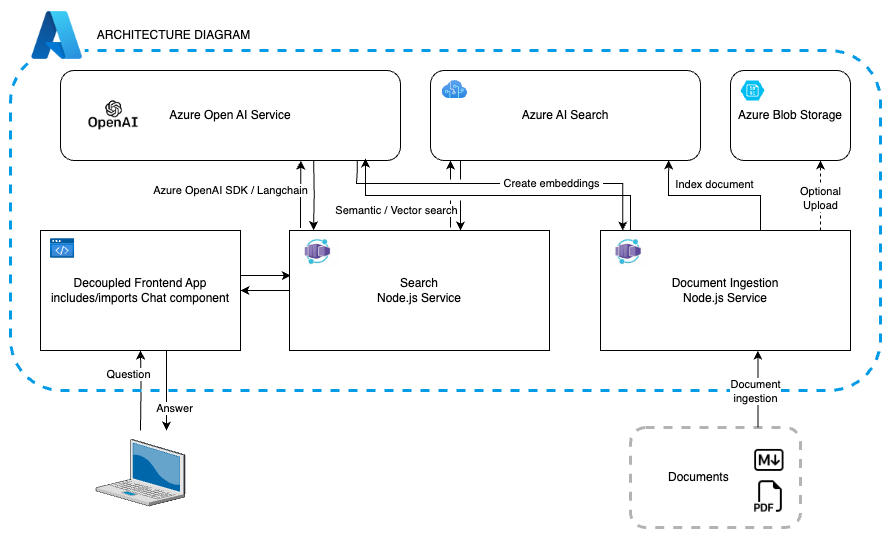

Chatta med dina data med Hjälp av Azure OpenAI och Azure AI Search med JavaScript

Den här mallen är en komplett lösning från slutpunkt till slutpunkt som visar RAG-mönstret (Retrieval-Augmented Generation) som körs i Azure. Den använder Azure AI Search för hämtning och stora språkmodeller i Azure OpenAI för att driva ChattGPT-stil och Q&A-upplevelser.

Om du vill komma igång med den här mallen kan du läsa Kom igång med chatten med ditt eget dataexempel för JavaScript. Information om mallen finns i GitHub-lagringsplatsen azure-search-openai-javascript för att komma åt källkoden och läsa detaljerad information om mallen.

Den här mallen visar hur dessa funktioner används.

| Azure-värdlösning | Terknik | AI-modeller |

|---|---|---|

| Azure Container Apps Azure Static Web Apps |

Azure OpenAI Azure AI-sökning Azure Storage Azure Monitor |

text-embedding-ada-002 |

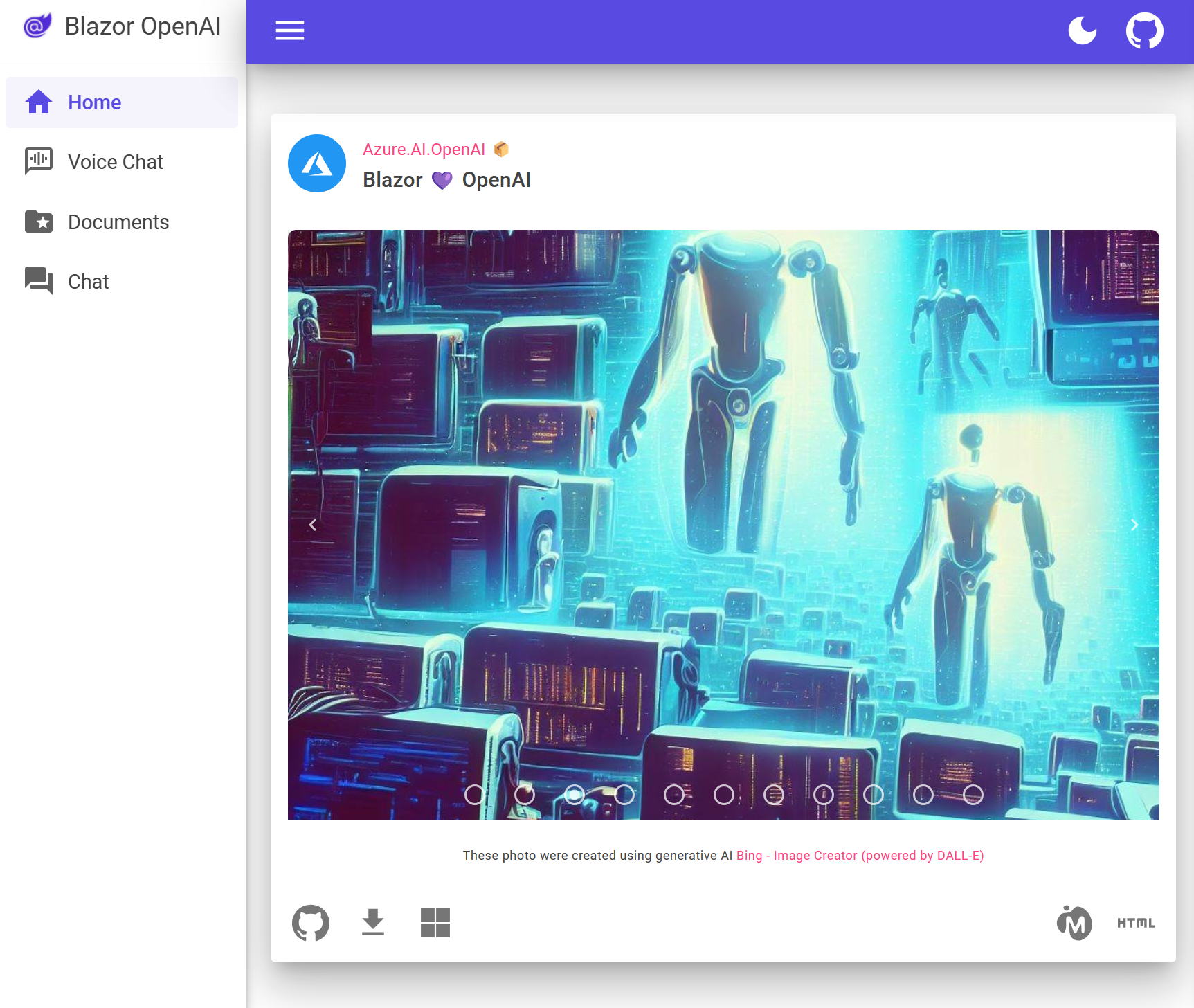

Azure OpenAI-chattklientdel

Den här mallen är en minimal OpenAI-chattwebbkomponent som kan kopplas till alla serverdelsimplementeringar som en klient.

Information om mallen finns i GitHub-lagringsplatsen azure-openai-chat-frontend för att få åtkomst till källkoden och läsa detaljerad information om mallen.

Den här mallen visar hur dessa funktioner används.

| Azure-värdlösning | Terknik | AI-modeller |

|---|---|---|

| Azure Static Web Apps | Azure AI-sökning Azure OpenAI |

GPT 3.5 Turbo GPT4 |

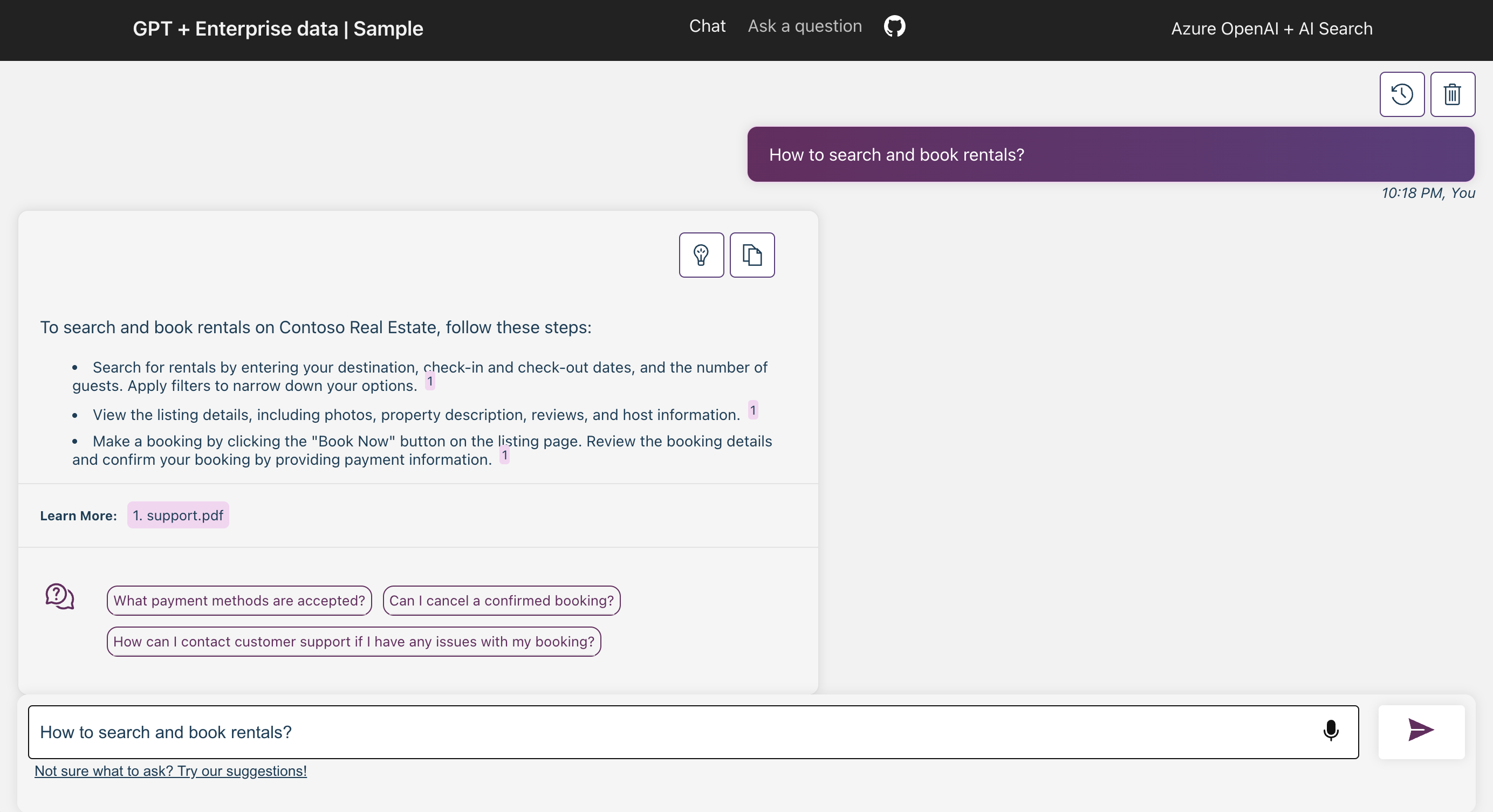

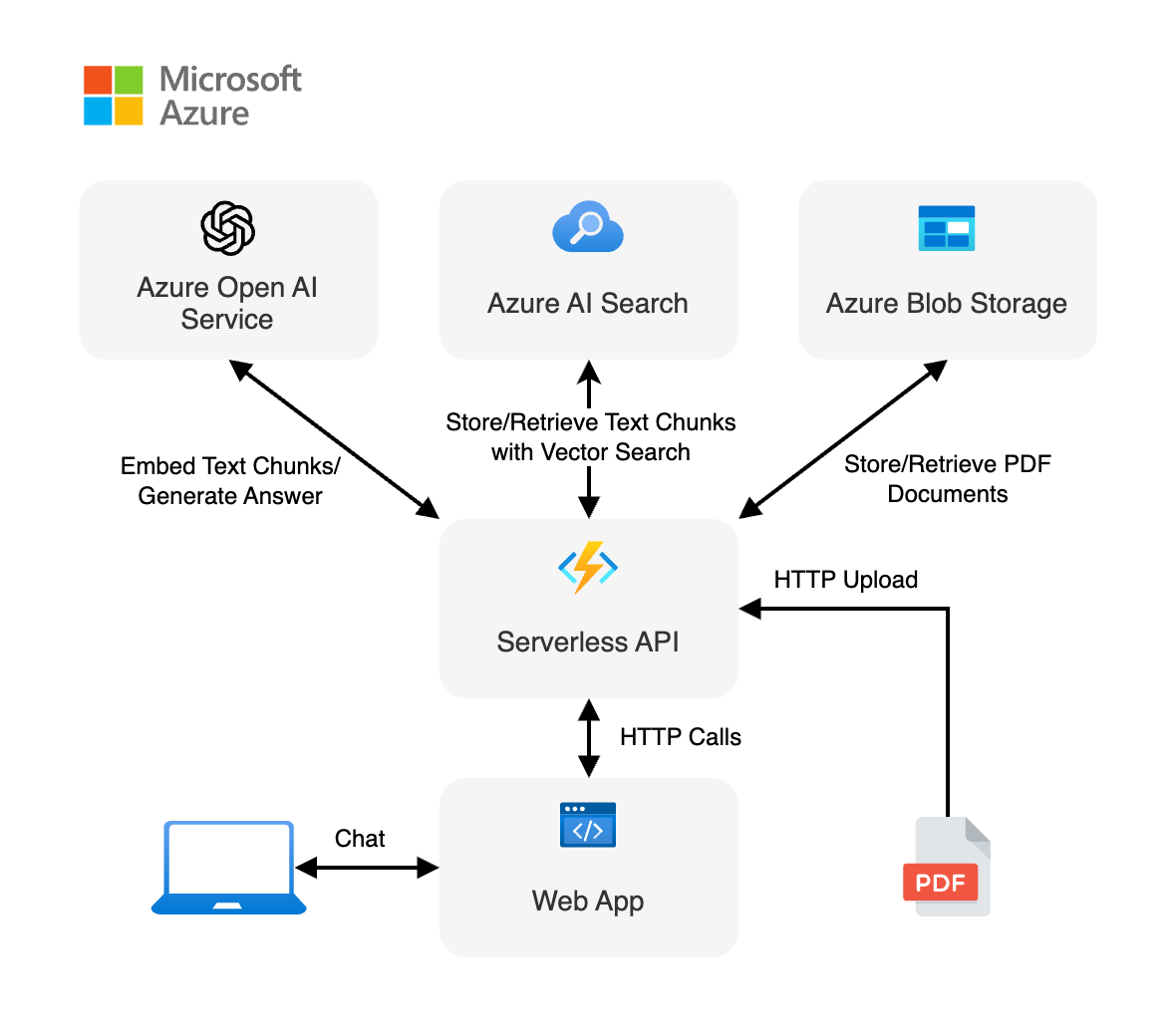

Serverlös AI-chatt med RAG med hjälp av LangChain.js

Mallen är en serverlös AI-chattrobot med hämtningsförhöjd generation med hjälp av LangChain.js och Azure som använder en uppsättning företagsdokument för att generera svar på användarfrågor. Det använder ett fiktivt företag som heter Contoso Real Estate, och upplevelsen gör det möjligt för kunderna att ställa supportfrågor om användningen av sina produkter. Exempeldata innehåller en uppsättning dokument som beskriver dess användarvillkor, sekretesspolicy och en supportguide.

Information om hur du distribuerar och kör den här mallen finns i Kom igång med serverlös AI-chatt med RAG med hjälp av LangChain.js. Om du vill komma åt källkoden och läsa detaljerad information om mallen kan du läsa GitHub-lagringsplatsen serverless-chat-langchainjs .

Lär dig hur du distribuerar och kör den här JavaScript-referensmallen.

Den här mallen visar hur dessa funktioner används.

| Azure-värdlösning | Terknik | AI-modeller |

|---|---|---|

| Azure Static Web Apps Azure Functions |

Azure AI-sökning Azure OpenAI Azure Cosmos DB Azure Storage Azure Managed Identity |

GPT4 Mistral Ollama |