Kommentar

Åtkomst till den här sidan kräver auktorisering. Du kan prova att logga in eller ändra kataloger.

Åtkomst till den här sidan kräver auktorisering. Du kan prova att ändra kataloger.

En Microsoft Fabric-miljö är ett arbetsyteobjekt som definierar Spark-sessionskonfiguration för notebook-filer och Spark-jobbdefinitioner. Använd en miljö för att välja en Spark-körningsmiljö, konfigurera beräkningsinställningar, hantera bibliotek och hantera små resursfiler som notebooks kan få åtkomst till.

Den här artikeln visar en översikt över hur du skapar, konfigurerar och använder en miljö.

Varför ska du använda ett miljöobjekt?

Du kan köra notebook-filer och Spark-jobbdefinitioner med Workspace default utan att bifoga ett miljöobjekt. I så fall använder du Spark-inställningar på arbetsytenivå.

Använd ett miljöobjekt när du behöver återanvändbara, reglerade standardinställningar för team:

- Definiera Spark-beräkning och -bibliotek en gång och tillämpa dem konsekvent i notebook-filer och Spark-jobbdefinitioner.

- Ange en miljö som standard för arbetsytan så att användarna ärver delad konfiguration via standardinställningen Arbetsyta.

- Versions- och driftmiljöinställningar som en enda artefakt.

Miljöer på arbetsytenivå

Använd det här arbetsflödet när du vill ange standardvärden för hela arbetsytan för notebook-filer och Spark-jobbdefinitioner.

Ett miljöobjekt skapas på en specifik arbetsyta och är associerat med den arbetsytan. Du kan också använda den miljön på andra arbetsytor där du har åtkomst, om kompatibilitetskraven för delning och arbetsytor uppfylls.

Skapa en miljö från en arbetsyta

I webbläsaren går du till din Fabric-arbetsyta i Fabric-portalen.

Välj +Nytt objekt.

Sök efter "miljö" i sökfältet och välj panelen Miljö .

Namnge din miljö och välj Skapa.

Bifoga en miljö som standard för arbetsyta

Viktigt!

När en miljö har valts som standard för arbetsytan kan endast arbetsyteadministratörer uppdatera innehållet i standardmiljön.

Arbetsyteadministratörer kan definiera standardarbetsbelastningen för hela arbetsytor. Värdena som konfigureras här gäller för notebook-filer och Spark-jobbdefinitioner som kopplas till Arbetsyteinställningar.

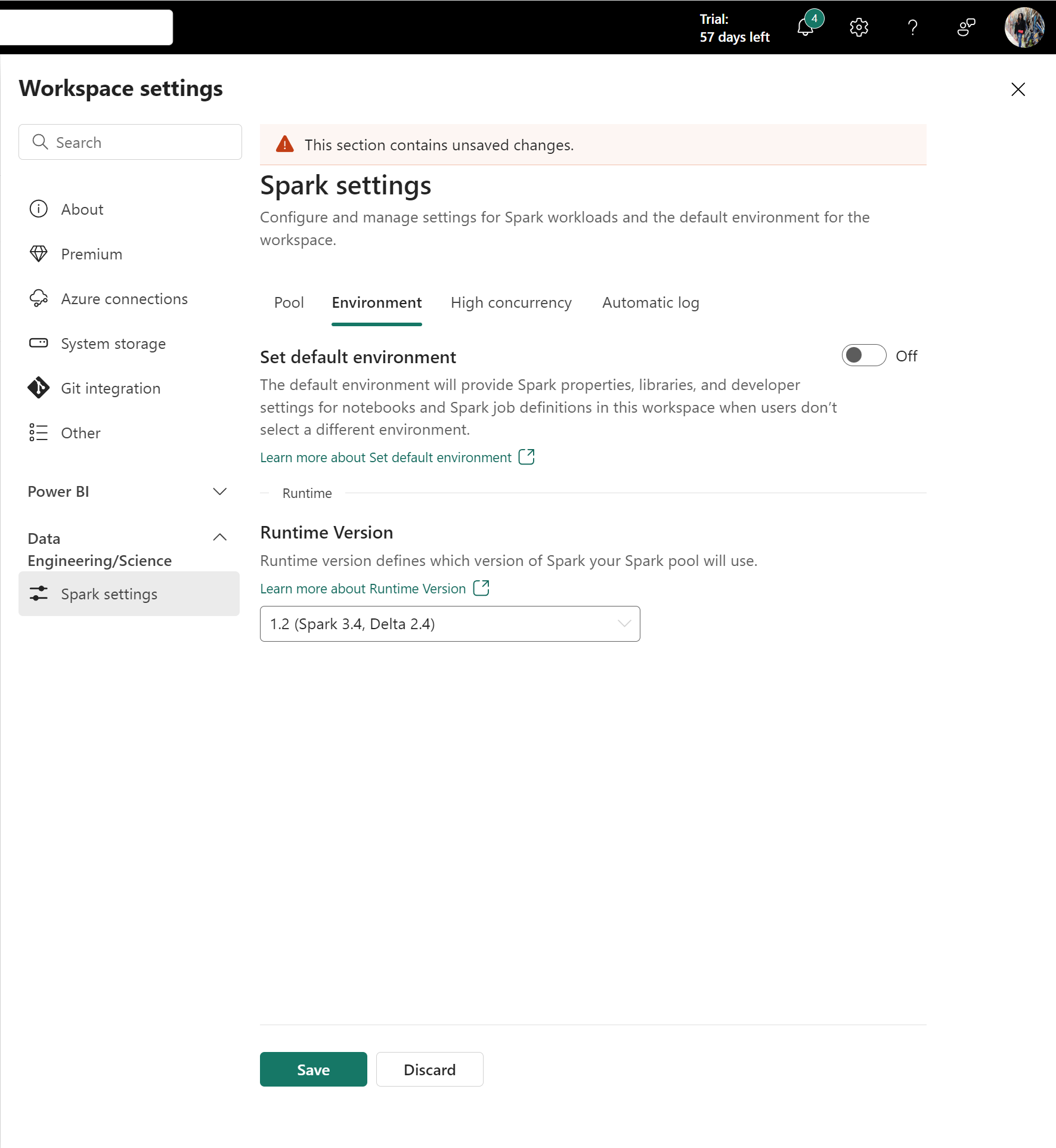

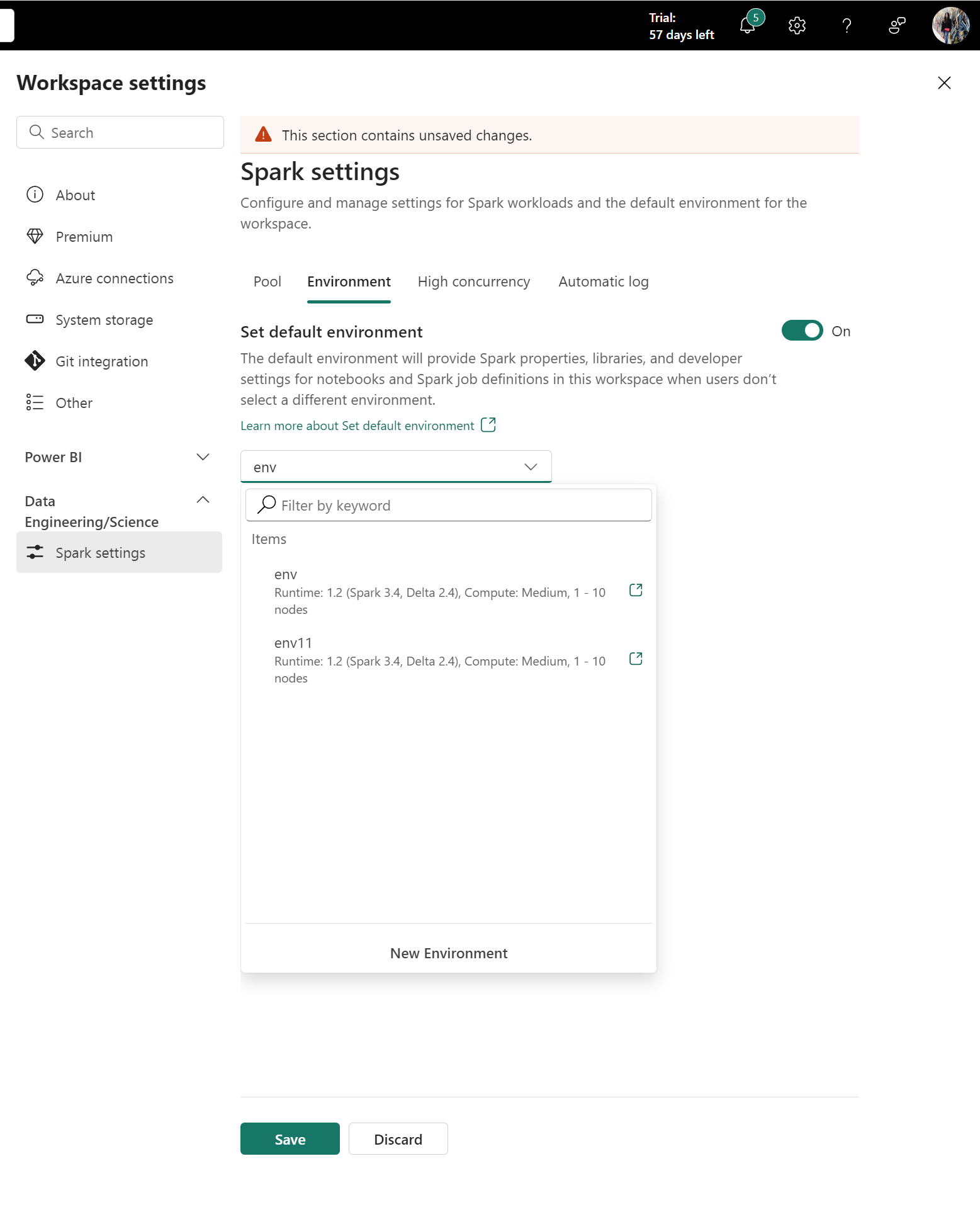

Växlingsknappen Ange standardmiljö styr om standardvärdet för arbetsytan backas upp av ett miljöobjekt.

I webbläsaren går du till din Fabric-arbetsyta i Fabric-portalen.

Välj Inställningar för arbetsyta.

Välj Datateknik/Vetenskap och välj sedan Spark-inställningar.

Välj fliken Miljö.

Om du vill använda en miljöbaserad arbetsyta som standard aktiverar du Ange standardmiljö till På, väljer det miljöobjekt som du vill använda och sparar sedan ändringarna.

- När den här växlingsknappen är Av (standard) ser användarna fortfarande Standard för arbetsyta i notebook-filer och Spark-jobbdefinitioner. I det här tillståndet använder Arbetsytans standard Spark-inställningar på arbetsytenivå.

- När den här växlingsknappen är På väljer du ett miljöobjekt som standard för arbetsytan. Notebook-filer och Spark-jobbdefinitioner som använder arbetsytans standardinställning ärver miljöns Spark-beräknings- och bibliotekskonfigurationer.

Miljöer på definitionsnivå för notebook- och Spark-jobb

Använd det här arbetsflödet när du vill skapa, välja eller ändra miljöer direkt från en notebook- eller Spark-jobbdefinition.

Skapa eller ändra en miljö från definitionen av en anteckningsbok eller ett Spark-jobb

I webbläsaren går du till din Fabric-arbetsyta i Fabric-portalen.

Öppna en anteckningsbok eller Spark-jobbdefinition.

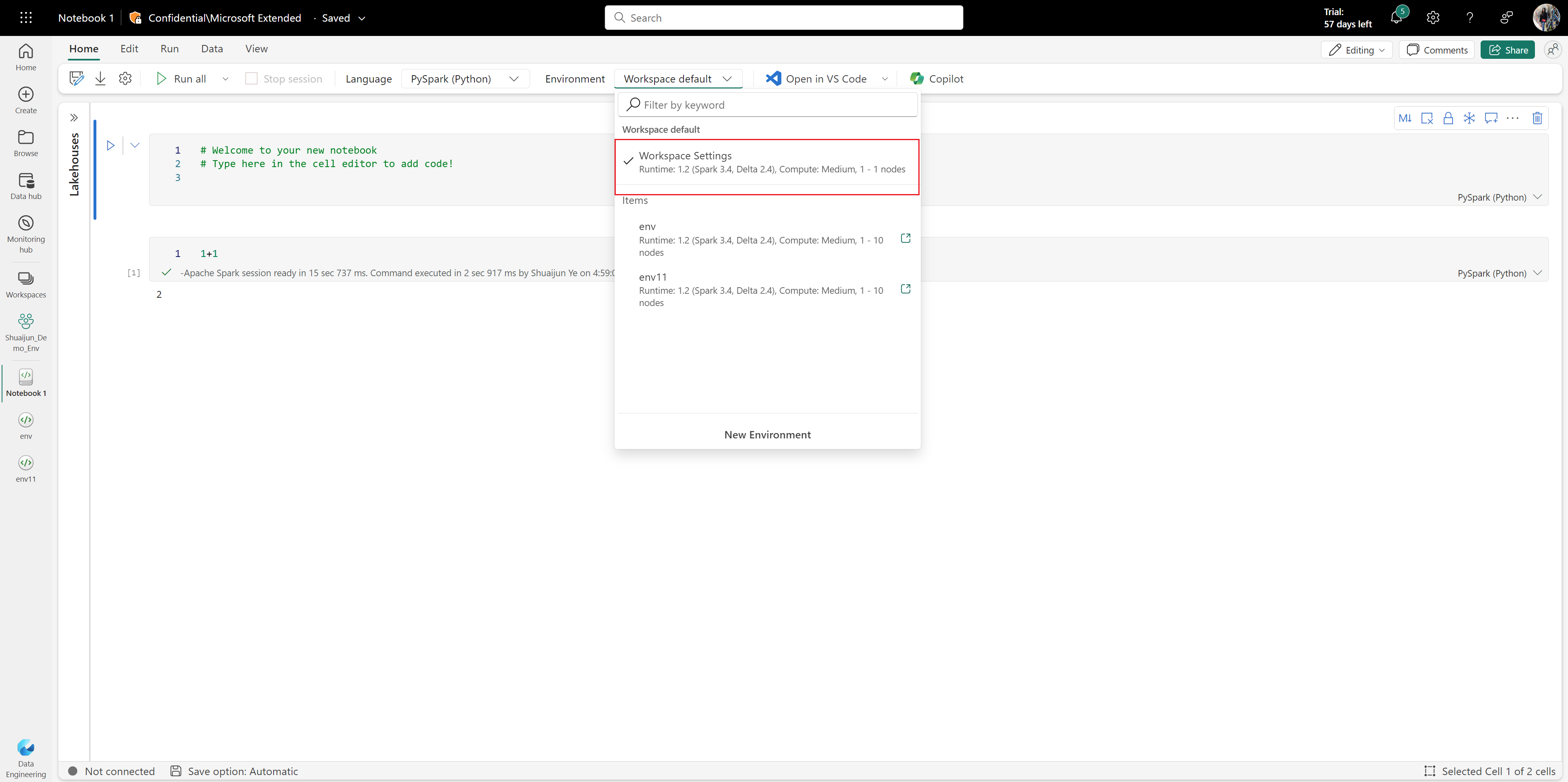

Välj listrutan Miljö och välj sedan Ny miljö.

Anmärkning

Om du vill ändra miljön utan att skapa en ny kan du också välja Ändra miljö på den nedrullningsbara menyn. Du kan välja en befintlig miljö och sedan välja Bekräfta för att koppla den till notebook-filen eller Spark-jobbdefinitionen.

Namnge din miljö och välj Skapa.

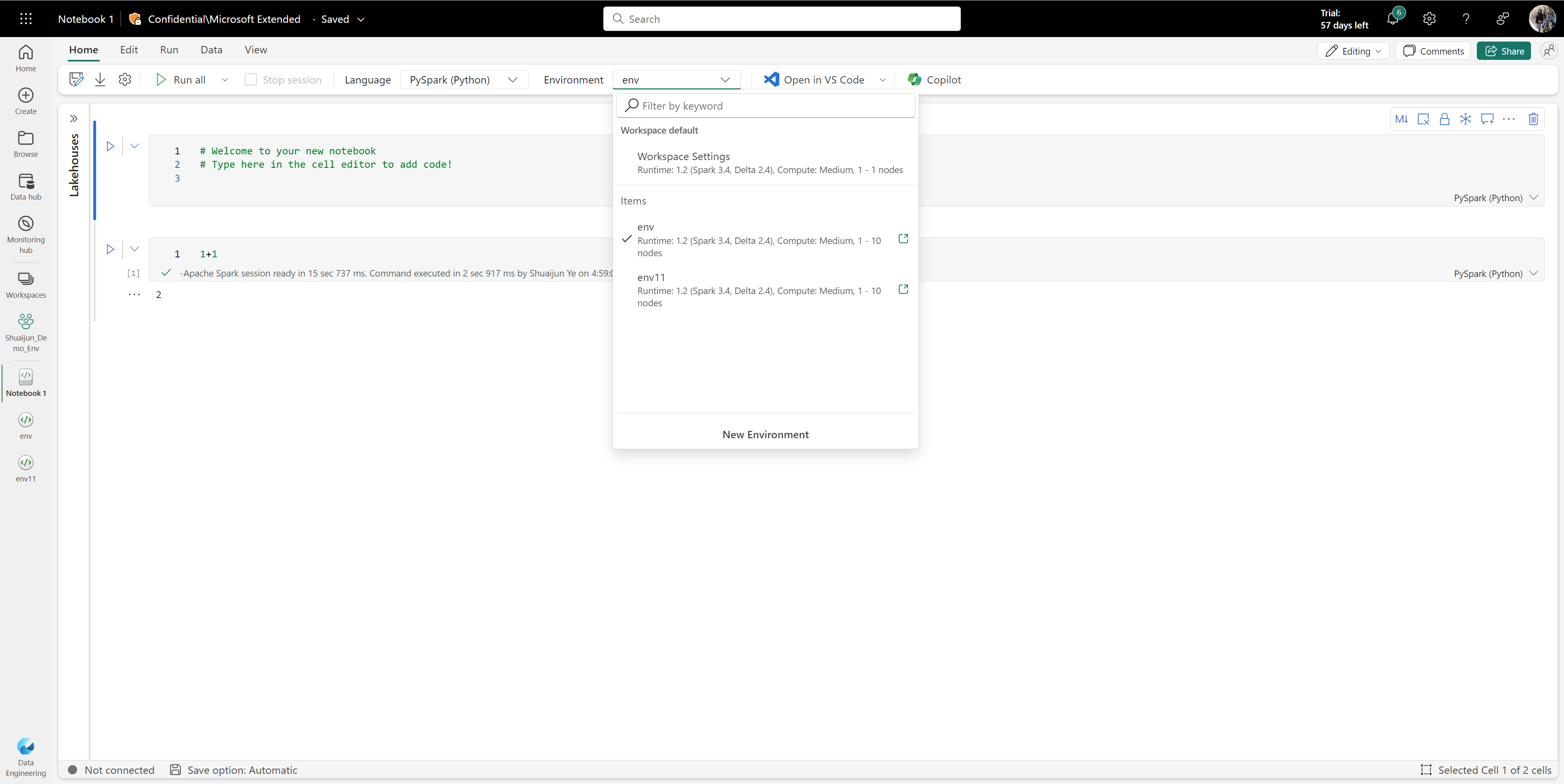

Koppla en miljö till en notebook-fil eller en Spark-jobbdefinition

Miljön är tillgänglig på flikarna Notebook och Spark Job Definition. När notebook-filer och Spark-jobbdefinitioner är kopplade till en miljö kan de komma åt dess bibliotek, beräkningskonfigurationer och resurser. Utforskaren visar alla tillgängliga miljöer som delas med dig, kommer från den aktuella arbetsytan och kommer från andra arbetsytor som du har åtkomst till.

Om du växlar till en annan miljö under en aktiv session börjar den nyligen valda miljön inte gälla förrän nästa session.

När du kopplar en miljö från en annan arbetsyta måste båda arbetsytorna ha samma kapacitet och nätverkssäkerhetsinställningar. Även om du kan välja miljöer från arbetsytor med olika kapaciteter eller nätverkssäkerhetsinställningar kan sessionen inte starta.

När du kopplar en miljö från en annan arbetsyta ignoreras beräkningskonfigurationen i den miljön. I stället är pool- och beräkningskonfigurationerna standardinställningen för den aktuella arbetsytan.

Konfigurera en miljövariabel

En miljö har tre huvudkomponenter:

- Spark-beräkningstjänster, som inkluderar Spark-körtid.

- Bibliotek.

- Resurser.

Spark-beräknings- och bibliotekskonfigurationerna krävs för att publiceringen ska vara effektiv. Resurser är delad lagring som kan ändras i realtid. Mer information finns i Spara och publicera ändringar.

Konfigurera Spark-beräkning

Konfigurera Spark-beräkning i en miljö genom att välja en körning och ange beräkningsegenskaper på sessionsnivå.

Detaljerade steg, inklusive körningsval och beräkningsanpassning, finns i Konfigurationsinställningar för Spark-beräkning i Infrastrukturmiljöer.

Om du ändrar körnings- eller beräkningsinställningarna ska du spara och publicera miljön så att ändringarna börjar gälla. Mer information finns i Spara och publicera ändringar.

Hantera bibliotek

Varje Spark-körning innehåller inbyggda bibliotek. Med infrastrukturmiljön kan du även installera bibliotek från offentliga källor eller ladda upp anpassade bibliotek som du eller din organisation har skapat. När du har installerat biblioteken är de tillgängliga i dina Spark-sessioner. För mer information, se Bibliotekshantering i Fabric-miljöer. För bästa praxis för att hantera bibliotek i Fabric, se Hantera Apache Spark-bibliotek i Fabric.

När du lägger till bibliotek i en miljö väljer du ett publiceringsläge:

- Snabbläget publiceras om cirka 5 sekunder. Bibliotek installeras när en notebook-session startar. Använd snabbläge för snabb iteration under utveckling.

- Fullständigt läge skapar en stabil, reproducerbar ögonblicksbild av biblioteket. Publiceringen tar vanligtvis 3 till 6 minuter, och sessionsstart tar ytterligare 1 till 3 minuter för beroendeutplacering. Använd fullständigt läge för pipelines, schemalagda körningar och delade arbetsbelastningar. För att uppnå en starttid på cirka 5 sekunder för sessioner i Full-läge konfigurerar du en anpassad livepool som ansluter till den aktuella miljön.

Mer information om varje läge finns i Välj publiceringsläge för bibliotek.

Använda resurser

Avsnittet Resurser i en miljö underlättar möjligheten att hantera små resurser under utvecklingsfasen. Filer som laddas upp till miljön är tillgängliga i notebookar när de har bifogats. För mer information, se Hantera resurserna i en fabricmiljö.

Anmärkning

Filer i avsnittet Resurser påverkas inte av miljöpublicering. Resursändringar är i realtid och tillgängliga omedelbart utan ett publiceringssteg.

Spara och publicera ändringar

Använd Spara och publicera för att styra när miljökonfigurationsändringar börjar gälla.

- Spara lagrar dina väntande ändringar.

- Publish tillämpar väntande ändringar på bibliotek och Spark-beräkning.

- Ändringar i resurser är i realtid och kräver inte publicering.

När du publicerar beror tiden på det bibliotekspubliceringsläge som du har valt. Snabbläget publiceras på cirka 5 sekunder, medan fullständigt läge vanligtvis tar 3 till 6 minuter att lösa beroenden och skapa en stabil ögonblicksbild. Mer information finns i Välj publiceringsläge för bibliotek.

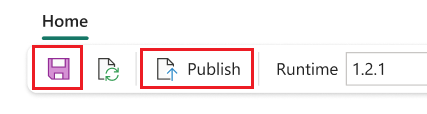

På fliken Start aktiveras Spara och Publicera när det finns väntande ändringar i bibliotek eller Spark-beräkning.

Viktigt!

Om Private Link är aktiverat måste det första Spark-jobbet på arbetsytan utlösa VNet-etablering, vilket kan ta cirka 10–15 minuter. Eftersom miljöpublicering också körs som ett Spark-jobb kan det uppstå ytterligare en fördröjning om det råkar vara det första Spark-jobbet som körs efter att Private Link har aktiverats.

När väntande ändringar finns innehåller en banderoll även åtgärder för att spara och publicera .

Använd det här arbetsflödet:

- Gör ändringar i bibliotek eller Spark-beräkning.

- Välj Spara för att behålla dina redigeringar. Sparade ändringar mellanlagras och gäller inte ännu.

- Välj Publicera, och sedan Publicera alla för att göra förberedda ändringar gällande.

Under publiceringen:

- Om du vill avbryta en publiceringsprocess väljer du Visa förlopp i banderollen och avbryter åtgärden.

- Ett meddelande visas när publiceringen är klar. Ett felmeddelande inträffar om det finns några problem under processen.

En miljö accepterar bara en Publiceringsåtgärd i taget. Du kan inte göra ändringar i avsnitten Bibliotek eller Spark-beräkning under en pågående publiceringsåtgärd .

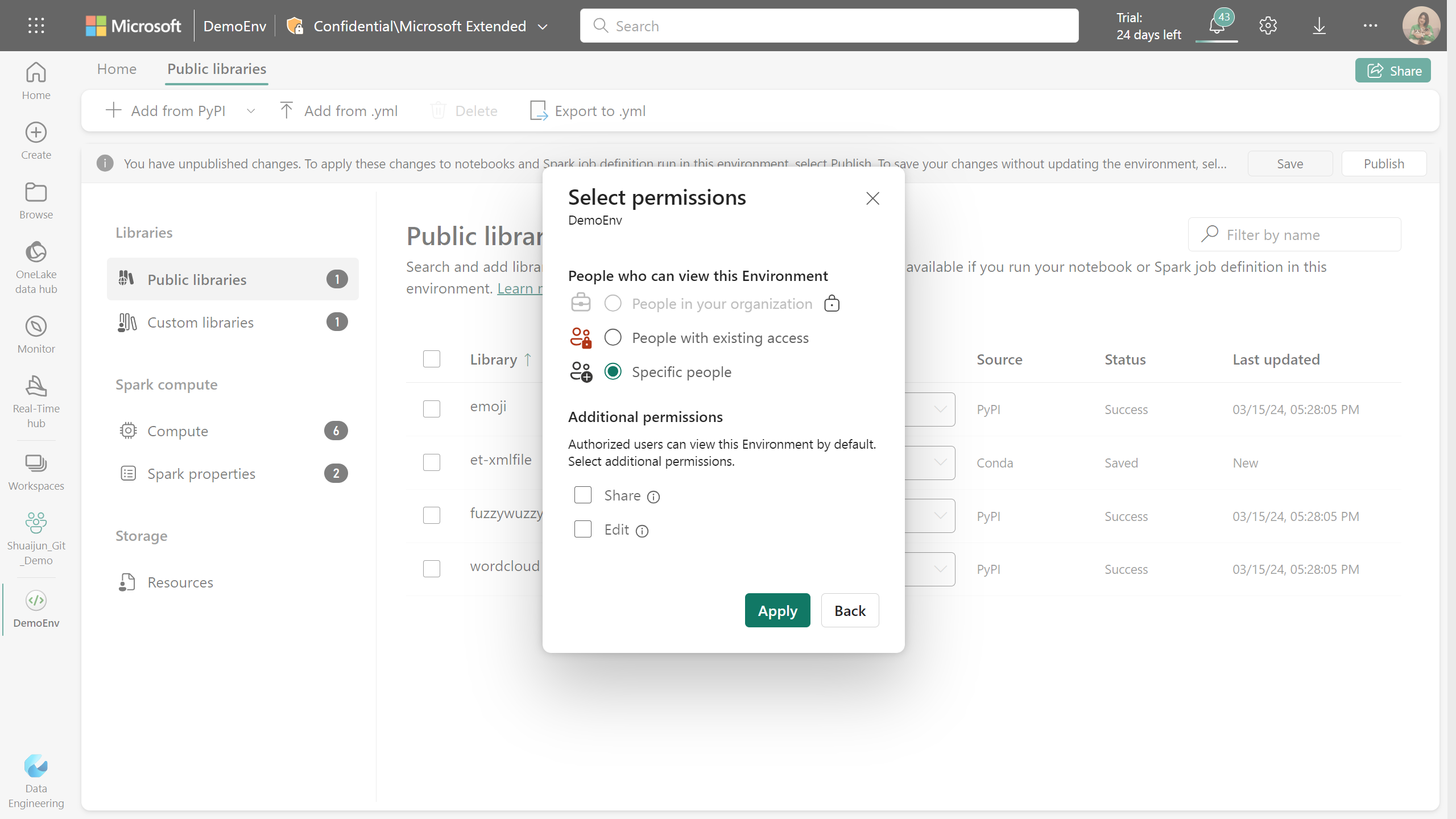

Dela en befintlig miljö

Stofthantering stöder delning av ett objekt med olika behörighetsnivåer.

När du delar ett miljöobjekt får mottagarna automatiskt läsbehörighet. Med den här behörigheten kan de utforska miljöns konfigurationer och koppla den till notebook-filer eller Spark-jobb. För smidig kodkörning måste du bevilja Läs-behörigheter för anslutna miljöer när du delar notebook-filer och Spark-jobbdefinitioner.

Du kan också dela miljön med behörigheterna Dela och Redigera. Användare med behörighet att dela kan fortsätta dela miljön med andra. Under tiden kan mottagare med redigeringsbehörighet uppdatera miljöns innehåll.

Ta bort en miljö

Du kan ta bort en miljö när den inte längre behövs. Tänk på följande innan du tar bort en miljö:

Viktigt!

- Att ta bort en miljö är permanent och kan inte ångras.

- Alla notebook-filer eller Spark-jobbdefinitioner som för närvarande är kopplade till miljön måste konfigureras om för att använda en annan miljö eller arbetsyteinställningar.

- Om miljön anges som standard för arbetsytan måste du först ändra standardinställningen för arbetsytan innan du tar bort den.

Ta bort en miljö med hjälp av REST API

Du kan ta bort en miljö programmatiskt med hjälp av REST-API:et för infrastrukturresurser:

Slutpunkt:DELETE https://api.fabric.microsoft.com/v1/workspaces/{workspaceId}/environments/{environmentId}

Nödvändiga behörigheter: Environment.ReadWrite.All eller Item.ReadWrite.All

Mer information om REST-API:et finns i Ta bort miljö.