Not

Bu sayfaya erişim yetkilendirme gerektiriyor. Oturum açmayı veya dizinleri değiştirmeyi deneyebilirsiniz.

Bu sayfaya erişim yetkilendirme gerektiriyor. Dizinleri değiştirmeyi deneyebilirsiniz.

Şunlar için geçerlidir:✅ Doku Veri Mühendisliği ve Veri Bilimi

Microsoft Fabric'da bir çalışma alanı oluşturduğunuzda, bu çalışma alanıyla ilişkili bir starter havuzu otomatik olarak oluşturulur. Microsoft Fabric'daki basitleştirilmiş kurulum sayesinde, düğüm veya makine boyutlarını seçmeniz gerekmez; bu seçenekler sizin için arka planda halledilir. Bu yapılandırma, kullanıcıların işlem ayarlama konusunda endişelenmenize gerek kalmadan birçok yaygın senaryoda Apache Spark işlerinizi kullanmaya başlamaları ve çalıştırmaları için daha hızlı (5-10 saniye) bir Apache Spark oturumu başlatma deneyimi sağlar. Belirli işlem gereksinimleri olan gelişmiş senaryolar için kullanıcılar özel bir Apache Spark havuzu oluşturabilir ve düğümleri performans gereksinimlerine göre boyutlandırabilir.

Çalışma alanında Apache Spark ayarlarında değişiklik yapmak için bu çalışma alanının yönetici rolüne sahip olmanız gerekir. Daha fazla bilgi için bkz. Çalışma alanlarındaki roller.

Çalışma alanınızla ilişkili havuzun Spark ayarlarını yönetmek için:

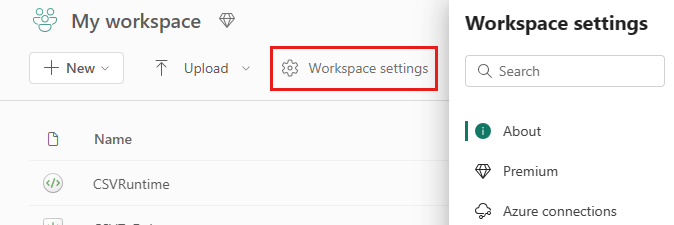

Çalışma alanınızdaki Çalışma Alanı ayarlarına gidin ve menüyü genişletmek için Veri Madenciliği/Bilim seçeneğini belirleyin:

Sol taraftaki menüde Spark İşlem seçeneğini görürsünüz:

Not

Varsayılan havuzu Başlangıç Havuzu'ndan Özel Spark havuzuna değiştirirseniz daha uzun oturum başlangıcı (yaklaşık 3 dakika) görebilirsiniz.

Havuz

Çalışma alanı için varsayılan havuz

Otomatik olarak oluşturulan başlangıç havuzunu kullanabilir veya çalışma alanı için özel havuzlar oluşturabilirsiniz.

Başlangıç Havuzu: Daha hızlı bir deneyim için önceden doldurulan canlı havuzlar otomatik olarak oluşturulur. Bu kümeler orta büyüklüktedir. Başlangıç havuzu, satın alınan Fabric kapasitesi SKU'su temelinde varsayılan yapılandırmaya ayarlanır. Yöneticiler, Spark iş yükü ölçek gereksinimlerine göre maksimum düğümleri ve yürütücüleri özelleştirebilir. Daha fazla bilgi edinmek için bkz . Başlangıç Havuzlarını Yapılandırma

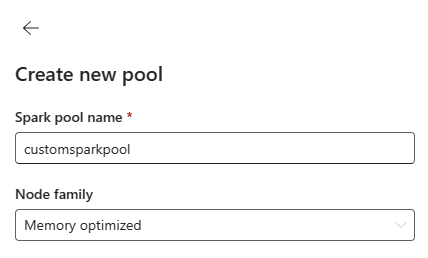

Özel Spark Havuzu: Spark iş gereksinimlerinize göre düğümleri boyutlandırabilir, otomatik ölçekleyebilir ve yürütücüleri dinamik olarak ayırabilirsiniz. Özel spark havuzu oluşturmak için kapasite yöneticisinin Kapasite Yöneticisi ayarlarının Spark İşlem bölümünde Özelleştirilmiş çalışma alanı havuzları seçeneğini etkinleştirmesi gerekir.

Not

Özelleştirilmiş çalışma alanı havuzları için kapasite düzeyi denetimi varsayılan olarak etkindir. Daha fazla bilgi edinmek için Doku kapasiteleri için veri mühendisliği ve veri bilimi ayarlarını yapılandırma ve yönetme konusuna bakın.

Yöneticiler, Yeni Havuz seçeneğini belirleyerek işlem gereksinimlerine göre özel Spark havuzları oluşturabilir.

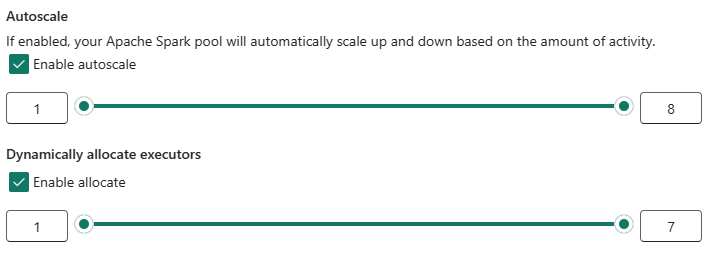

Microsoft Fabric için Apache Spark, kullanıcıların en az 1 düğüm yapılandırmasını seçmesine olanak tanıyan tek düğümlü kümeleri destekler. Bu durumda sürücü ve yürütücü tek bir düğümde çalışır. Bu tek düğümlü kümeler, düğüm hataları sırasında geri yüklenebilen yüksek kullanılabilirlik ve daha küçük işlem gereksinimleri olan iş yükleri için daha iyi iş güvenilirliği sunar. Ayrıca, özel Spark havuzlarınız için otomatik ölçeklendirme seçeneğini etkinleştirebilir veya devre dışı bırakabilirsiniz. Otomatik ölçeklendirme ile etkinleştirildiğinde, havuz kullanıcı tarafından belirtilen en yüksek düğüm sınırı içinde yeni düğümler alır ve daha iyi performans için iş yürütmeden sonra bunları devre dışı bırakabilirsiniz.

Veri hacmine göre belirtilen maksimum sınır içinde, havuza otomatik olarak en uygun sayıda yürütücü ayırmak için dinamik bir seçeneği belirleyebilirsiniz; bu, daha iyi performans sağlar.

Fabric için Apache Spark işlem hakkında daha fazla bilgi edinin.

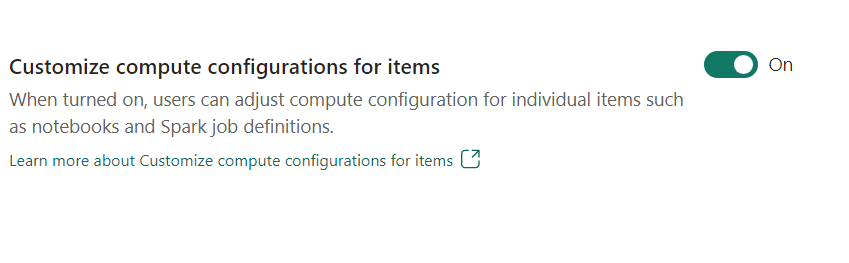

- Öğeler için işlem yapılandırmasını özelleştirme: Çalışma alanı yöneticisi olarak, kullanıcıların ortam kullanarak not defterleri, Spark iş tanımları gibi tek tek öğeler için işlem yapılandırmalarını (Sürücü/Yürütücü Çekirdeği, Sürücü/Yürütücü Belleği içeren oturum düzeyi özellikleri) ayarlamasına izin vekleyebilirsiniz.

Ayar çalışma alanı yöneticisi tarafından kapalıysa, çalışma alanı içindeki tüm ortamlar için Varsayılan havuz ve işlem yapılandırmaları kullanılır.

Ortam

Ortam, Spark işlerinizi (not defterleri, Spark iş tanımları) çalıştırmak için esnek yapılandırmalar sağlar. Bir Ortamda işlem özelliklerini yapılandırabilir, farklı çalışma zamanı seçebilir, iş yükü gereksinimlerinize göre kitaplık paketi bağımlılıklarını ayarlayabilirsiniz.

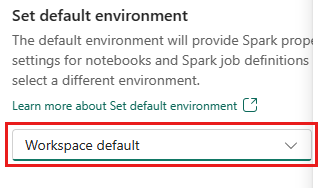

Ortam sekmesinde, varsayılan ortamı ayarlama seçeneğiniz vardır. Çalışma alanı için hangi Spark sürümünü kullanmak istediğinizi seçebilirsiniz.

Doku çalışma alanı yöneticisi olarak, çalışma alanının varsayılan Ortamı olarak bir Ortam seçebilirsiniz.

Ortam açılan listesinden de yeni bir tane oluşturabilirsiniz.

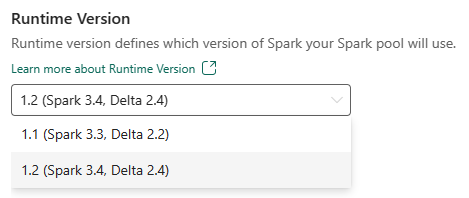

Varsayılan bir ortam seçeneğini devre dışı bırakırsanız, açılan listede bulunan kullanılabilir çalışma zamanı sürümlerinden Fabric çalışma zamanı sürümünü seçme seçeneğiniz vardır.

Apache Spark çalışma zamanları hakkında daha fazla bilgi edinin.

İşler

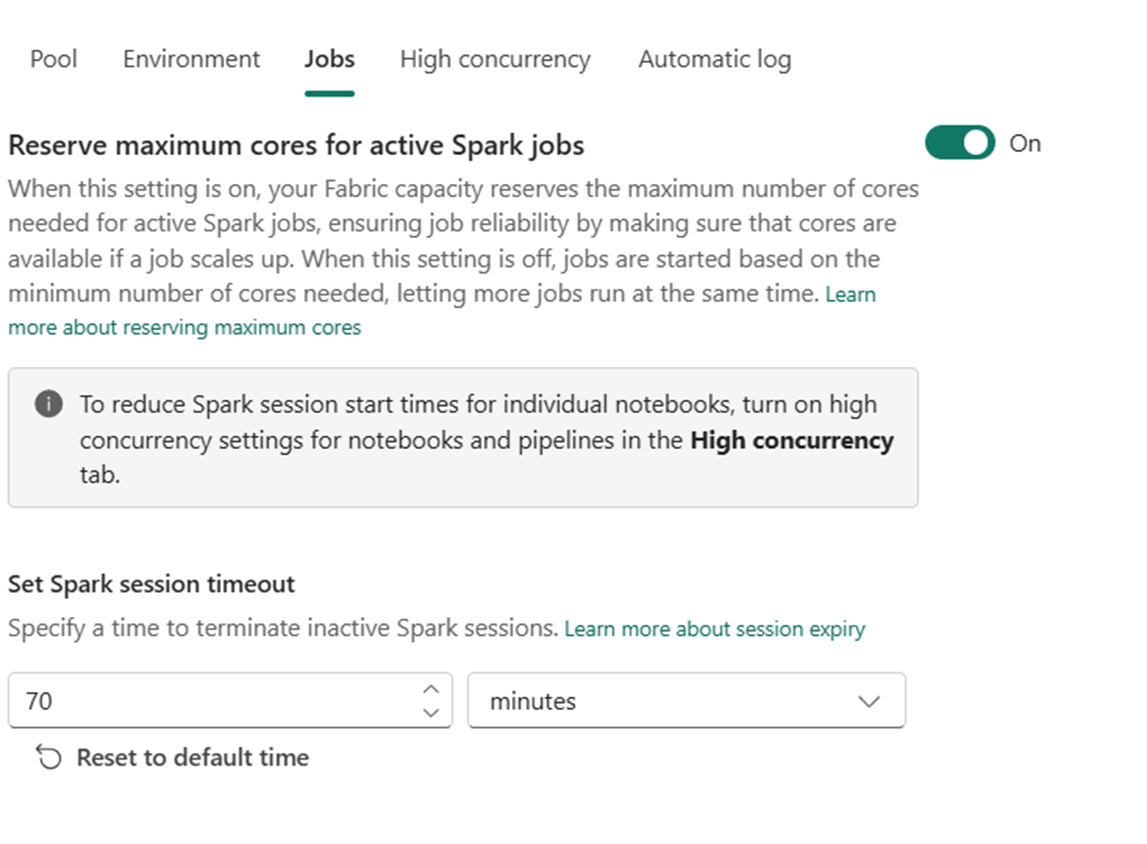

İşler ayarları, yöneticilerin çalışma alanı içindeki tüm Spark işleri için iş kabul mantığını denetlemesine olanak tanır.

Varsayılan olarak tüm çalışma alanları İyimser İş Kabulü ile etkinleştirilir. Microsoft Fabric'de Spark için İş kabulü hakkında daha fazla bilgi edinin.

Spark işleri için maksimum çekirdek ayır seçeneğini etkinleştirerek İyimser iş kabulü tabanlı yaklaşımı kapatabilir ve görevleriniz için çekirdeklerin maksimumunu ayırabilirsiniz.

Spark oturumu zaman aşımını ayarlayarak not defteri etkileşimli oturumları için oturum süresini özelleştirebilirsiniz.

Not

Etkileşimli Spark oturumları için varsayılan oturum süre sonu 20 dakika olarak ayarlanır.

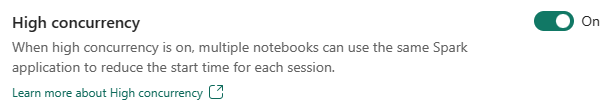

Yüksek eşzamanlılık

Yüksek eşzamanlılık modu, kullanıcıların Apache Spark for Fabric veri mühendisliği ve veri bilimi iş yüklerinde aynı Spark oturumlarını paylaşmasına olanak tanır. Not defteri gibi bir öğe, yürütülmesi için bir Spark oturumu kullanır ve etkinleştirildiğinde kullanıcıların tek bir Spark oturumunu birden çok not defteri arasında paylaşmasına izin verir.

Apache Spark ve Fabric'te Yüksek Eşzamanlılık hakkında daha fazla bilgi edinin.

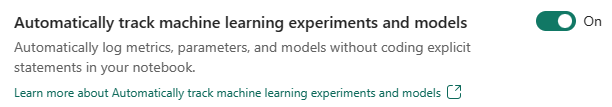

Makine Öğrenmesi modelleri ve deneyleri için otomatik günlük kaydı

Yöneticiler artık makine öğrenmesi modelleri ve denemeleri için otomatik kaydetmeyi etkinleştirebilir. Bu seçenek, eğitilirken bir makine öğrenmesi modelinin giriş parametrelerinin, çıkış ölçümlerinin ve çıkış öğelerinin değerlerini otomatik olarak yakalar. Otomatik kaydetme hakkında daha fazla bilgi edinin.

İlgili içerik

- Apache Spark Çalışma Süreçleri - Genel Bakış, Sürümleme, Birden Çok Çalışma Süreci Desteği ve Delta Lake Protokolü Yükseltme hakkında dokuda bilgi edinin.

- Apache Spark kamu belgelerinden daha fazla bilgi edinin.

- Sık sorulan soruların yanıtlarını bulun: Apache Spark çalışma alanı yönetimi ayarları hakkında SSS.