Připojení Databricks pro Python

Poznámka:

Tento článek se zabývá Připojení Databricks pro Databricks Runtime 13.0 a vyšší.

Tento článek ukazuje, jak rychle začít s Připojení Databricks pomocí Pythonu a PyCharmu.

- Verzi jazyka R tohoto článku najdete v tématu Databricks Připojení pro R.

- Informace o verzi Scala tohoto článku najdete v tématu Databricks Připojení pro Scala.

Databricks Připojení umožňuje připojit k clusterům Azure Databricks oblíbená prostředí ID, jako jsou PyCharm, servery poznámkových bloků a další vlastní aplikace. Podívejte se, co je Databricks Připojení?.

Kurz

Pokud chcete tento kurz přeskočit a místo toho použít jiné integrované vývojové prostředí (IDE), přečtěte si další kroky.

Požadavky

K dokončení tohoto kurzu musíte splnit následující požadavky:

Váš cílový pracovní prostor a cluster Azure Databricks musí splňovat požadavky na konfiguraci clusteru pro Připojení Databricks.

Musíte mít k dispozici ID clusteru. Pokud chcete získat ID clusteru, klikněte v pracovním prostoru na bočním panelu na Compute a potom na název clusteru. V adresní řádku webového prohlížeče zkopírujte řetězec znaků mezi

clustersadresou URL aconfigurationdo adresy URL.Máte nainstalovaný PyCharm . Tento kurz byl testován s PyCharm Community Edition 2023.3.5. Pokud používáte jinou verzi nebo edici PyCharm, můžou se následující pokyny lišit.

Na vývojovém počítači máte nainstalovaný Python 3 a podverze klientské instalace Pythonu je stejná jako podverze pythonové verze vašeho clusteru Azure Databricks. Následující tabulka uvádí verzi Pythonu nainstalovanou s jednotlivými moduly Databricks Runtime.

Verze modulu Databricks Runtime Verze Pythonu 15.0 ML,

15.03.11 13.0 ML - 14.3 ML,

13.0 - 14.33,10

Krok 1: Konfigurace ověřování Azure Databricks

V tomto kurzu se k ověřování v pracovním prostoru Azure Databricks používá ověřování uživatele na počítač (U2M) Azure Databricks a konfigurační profil Azure Databricks. Pokud chcete místo toho použít jiný typ ověřování, přečtěte si téma Konfigurace vlastností připojení.

Konfigurace ověřování OAuth U2M vyžaduje rozhraní příkazového řádku Databricks následujícím způsobem:

Pokud ještě není nainstalovaný, nainstalujte rozhraní příkazového řádku Databricks následujícím způsobem:

Linux, macos

Pomocí Homebrew nainstalujte Rozhraní příkazového řádku Databricks spuštěním následujících dvou příkazů:

brew tap databricks/tap brew install databricksWindows

K instalaci rozhraní příkazového řádku Databricks můžete použít winget, Chocolatey nebo Subsystém Windows pro Linux (WSL). Pokud nemůžete použít

winget, Chocolatey nebo WSL, měli byste tento postup přeskočit a místo toho použít příkazový řádek nebo PowerShell k instalaci rozhraní příkazového řádku Databricks ze zdroje .Poznámka:

Instalace Rozhraní příkazového řádku Databricks s Chocolatey je experimentální.

Pokud chcete použít

wingetk instalaci rozhraní příkazového řádku Databricks, spusťte následující dva příkazy a restartujte příkazový řádek:winget search databricks winget install Databricks.DatabricksCLIPokud chcete k instalaci rozhraní příkazového řádku Databricks použít Chocolatey, spusťte následující příkaz:

choco install databricks-cliPoužití WSL k instalaci rozhraní příkazového řádku Databricks:

Nainstalujte

curlazipprostřednictvím WSL. Další informace najdete v dokumentaci k operačnímu systému.Pomocí WSL nainstalujte rozhraní příkazového řádku Databricks spuštěním následujícího příkazu:

curl -fsSL https://raw.githubusercontent.com/databricks/setup-cli/main/install.sh | sh

Spuštěním následujícího příkazu ověřte, že je nainstalované rozhraní příkazového řádku Databricks, které zobrazuje aktuální verzi nainstalovaného rozhraní příkazového řádku Databricks. Tato verze by měla být 0.205.0 nebo vyšší:

databricks -vPoznámka:

Pokud spustíte

databricks, ale zobrazí se chyba, napříkladcommand not found: databricksnebo pokud spustítedatabricks -va zobrazí se číslo verze 0.18 nebo nižší, znamená to, že váš počítač nemůže najít správnou verzi spustitelného souboru rozhraní příkazového řádku Databricks. Pokud chcete tento problém vyřešit, přečtěte si téma Ověření instalace rozhraní příkazového řádku.

Následujícím způsobem zahajte ověřování OAuth U2M:

Pomocí rozhraní příkazového řádku Databricks zahajte správu tokenů OAuth místně spuštěním následujícího příkazu pro každý cílový pracovní prostor.

V následujícím příkazu nahraďte

<workspace-url>adresou URL služby Azure Databricks pro jednotlivé pracovní prostory, napříkladhttps://adb-1234567890123456.7.azuredatabricks.net.databricks auth login --configure-cluster --host <workspace-url>Rozhraní příkazového řádku Databricks vás vyzve k uložení informací, které jste zadali jako konfigurační profil Azure Databricks. Stisknutím klávesy

Enterpotvrďte navrhovaný název profilu nebo zadejte název nového nebo existujícího profilu. Všechny existující profily se stejným názvem se přepíšou informacemi, které jste zadali. Profily můžete použít k rychlému přepnutí kontextu ověřování napříč několika pracovními prostory.Pokud chcete získat seznam všech existujících profilů, v samostatném terminálu nebo příkazovém řádku spusťte příkaz

databricks auth profilespomocí rozhraní příkazového řádku Databricks . Pokud chcete zobrazit existující nastavení konkrétního profilu, spusťte příkazdatabricks auth env --profile <profile-name>.Ve webovém prohlížeči dokončete pokyny na obrazovce, abyste se přihlásili k pracovnímu prostoru Azure Databricks.

V seznamu dostupných clusterů, které se zobrazí v terminálu nebo příkazovém řádku, vyberte cílový cluster Azure Databricks v pracovním prostoru pomocí šipky nahoru a šipky dolů a stiskněte

Enter. Pokud chcete filtrovat seznam dostupných clusterů, můžete také zadat libovolnou část zobrazovaného názvu clusteru.Pokud chcete zobrazit aktuální hodnotu tokenu OAuth profilu a nadcházející časové razítko vypršení platnosti tokenu, spusťte jeden z následujících příkazů:

databricks auth token --host <workspace-url>databricks auth token -p <profile-name>databricks auth token --host <workspace-url> -p <profile-name>

Pokud máte více profilů se stejnou

--hosthodnotou, možná budete muset zadat--hostspolečně možnosti a-ppomoct rozhraní příkazového řádku Databricks najít správné odpovídající informace o tokenu OAuth.

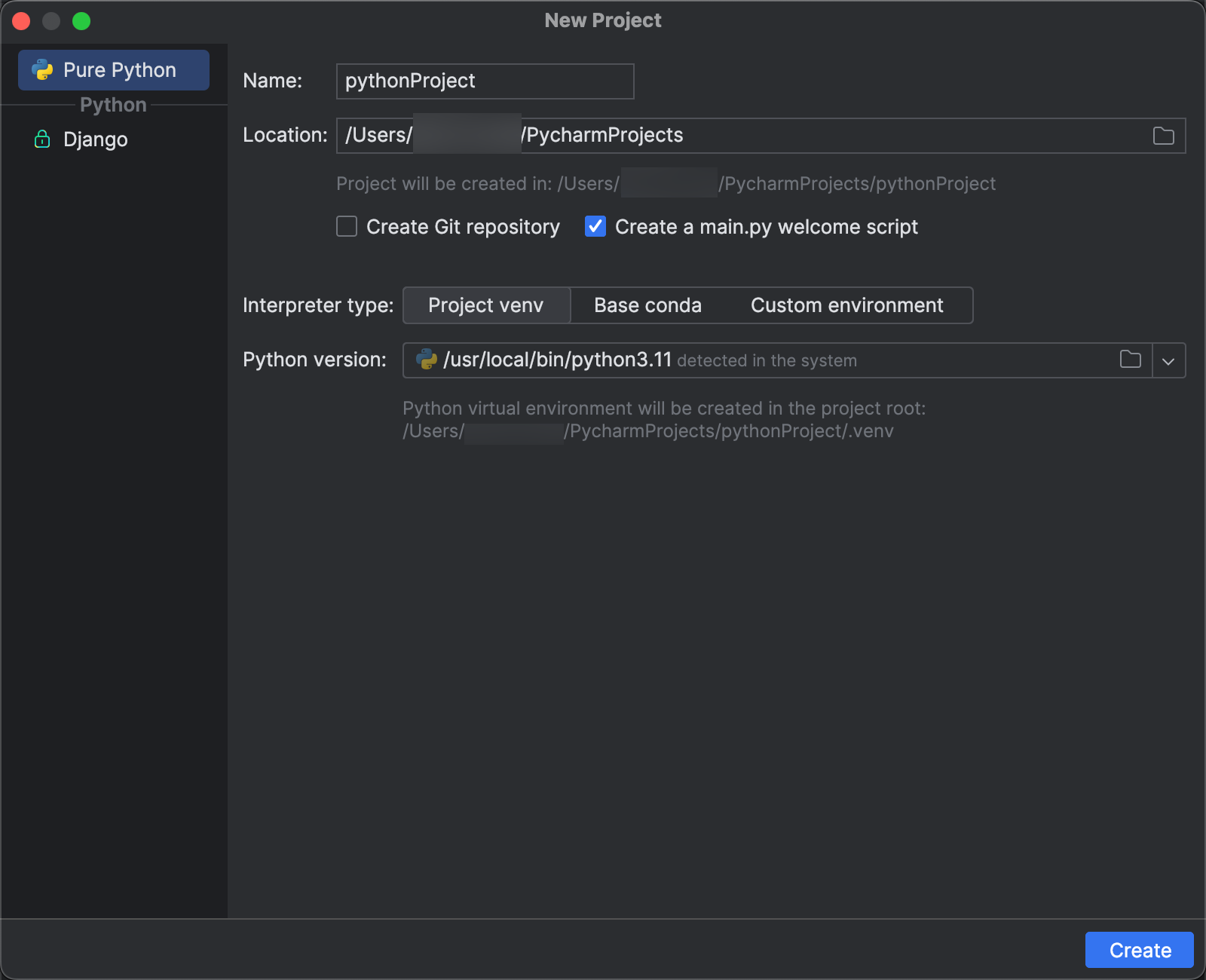

Krok 2: Vytvoření projektu

- Spusťte PyCharm.

- V hlavní nabídce klikněte na Soubor > nový projekt.

- V dialogovém okně Nový projekt klikněte na Pure Python.

- V části Umístění klikněte na ikonu složky a podle pokynů na obrazovce zadejte cestu k novému projektu Pythonu.

- Ponechte vybranou možnost Vytvořit main.py uvítací skript .

- Pro typ interpreta klikněte na Project venv.

- Rozbalte verzi Pythonu a pomocí ikony složky nebo rozevíracího seznamu určete cestu k interpretu Pythonu z předchozích požadavků.

- Klikněte na Vytvořit.

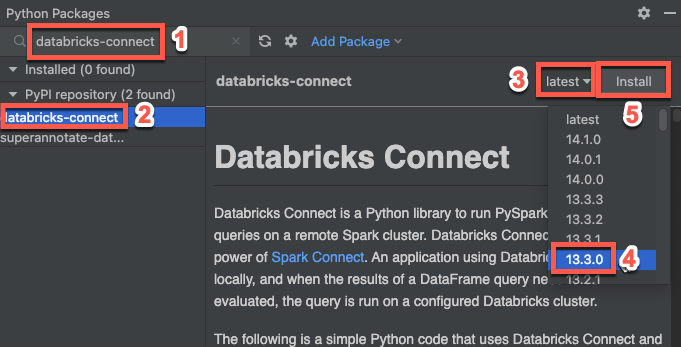

Krok 3: Přidání balíčku Připojení Databricks

- V hlavní nabídce PyCharm klepněte na příkaz Zobrazit nástroj Windows > Python Packages>.

- Do vyhledávacího pole zadejte

databricks-connect. - V seznamu úložišť PyPI klikněte na databricks-connect.

- V nejnovějším rozevíracím seznamu podokna výsledků vyberte verzi, která odpovídá verzi Databricks Runtime vašeho clusteru. Pokud má váš cluster například nainstalovaný Databricks Runtime 14.3, vyberte 14.3.1.

- Klikněte na Instalovat balíček.

- Po instalaci balíčku můžete okno Balíčky Pythonu zavřít.

Krok 4: Přidání kódu

V okně nástroje Project klikněte pravým tlačítkem na kořenovou složku projektu a klikněte na Nový > soubor Pythonu.

Zadejte

main.pya poklikejte na soubor Pythonu.Do souboru zadejte následující kód a v závislosti na názvu konfiguračního profilu ho uložte.

Pokud má váš konfigurační profil z kroku 1 název

DEFAULT, zadejte do souboru následující kód a pak soubor uložte:from databricks.connect import DatabricksSession spark = DatabricksSession.builder.getOrCreate() df = spark.read.table("samples.nyctaxi.trips") df.show(5)Pokud váš konfigurační profil z kroku 1 není pojmenovaný

DEFAULT, zadejte do souboru následující kód. Zástupný symbol<profile-name>nahraďte názvem konfiguračního profilu z kroku 1 a pak soubor uložte:from databricks.connect import DatabricksSession spark = DatabricksSession.builder.profile("<profile-name>").getOrCreate() df = spark.read.table("samples.nyctaxi.trips") df.show(5)

Krok 5: Spuštění kódu

- Spusťte cílový cluster ve vzdáleném pracovním prostoru Azure Databricks.

- Po spuštění clusteru v hlavní nabídce klikněte na Spustit " > main".

- V okně nástroje Spustit (Zobrazit > nástroj Windows > Spustit) v hlavním podokně karty Spustit se zobrazí prvních 5 řádků

samples.nyctaxi.trips.

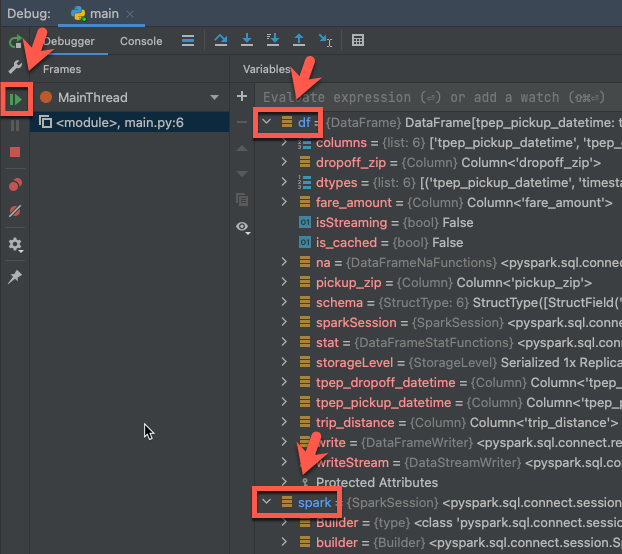

Krok 6: Ladění kódu

- Když je cluster stále spuštěný, klikněte v předchozím kódu na hřbet vedle

df.show(5)a nastavte zarážku. - V hlavní nabídce klikněte na Spustit > ladění main.

- V okně Nástroje ladění (Zobrazit > nástroj Windows > Ladění) v podokně Proměnné ladicího programu rozbalte uzly proměnných df a Spark a procházejte informace o kódech

dfasparkproměnných. - Na bočním panelu okna nástroje Ladění klikněte na zelenou šipku (Resume Program).

- V podokně Konzola na kartě Ladicí program se zobrazí prvních 5 řádků

samples.nyctaxi.trips.

Další kroky

Další informace o službě Databricks Připojení najdete v článcích, jako jsou následující:

Pokud chcete použít jiné typy ověřování Azure Databricks než osobní přístupový token Azure Databricks, přečtěte si téma Konfigurace vlastností připojení.

Pokud chcete použít jiné prostředí IDEs, servery poznámkových bloků a prostředí Spark, přečtěte si následující informace:

Pokud chcete zobrazit další jednoduché příklady kódu, podívejte se na příklady kódu pro Databricks Připojení pro Python.

Pokud chcete zobrazit složitější příklady kódu, podívejte se na ukázkové aplikace pro úložiště Databricks Připojení v GitHubu, konkrétně:

Pokud chcete s Připojení Databricks používat nástroje Databricks, přečtěte si téma Nástroje Databricks s Připojení Databricks pro Python.

Pokud chcete migrovat z Databricks Připojení pro Databricks Runtime 12.2 LTS a novější na Databricks Připojení pro Databricks Runtime 13.0 a novější, přečtěte si téma Migrace do Databricks Připojení pro Python.

Viz také informace o řešení potíží a omezeních.

Váš názor

Připravujeme: V průběhu roku 2024 budeme postupně vyřazovat problémy z GitHub coby mechanismus zpětné vazby pro obsah a nahrazovat ho novým systémem zpětné vazby. Další informace naleznete v tématu: https://aka.ms/ContentUserFeedback.

Odeslat a zobrazit názory pro