Hinweis

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, sich anzumelden oder das Verzeichnis zu wechseln.

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, das Verzeichnis zu wechseln.

Das Umwandeln von Rohdaten in umsetzbare Erkenntnisse ist ein wichtiger Schritt im Datenlebenszyklus. Microsoft Fabric kombiniert Power BI, Real-Time Intelligence und Fabric IQ, um Geschäftsanalysten bei der Erkundung, Visualisierung und Reaktion auf Daten in nahezu Echtzeit zu unterstützen. Mithilfe von semantischen Modellen, Streamingdaten und KI-erweiterten Analysen können Sie gesteuerte Berichte, Dashboards und betriebliche Warnungen erstellen, die fundierte Entscheidungsfindung fördern.

In diesem Artikel erfahren Sie mehr über die folgenden Themen:

- Erstellen von Power BI-Berichten und translytischen Taskflows für interaktive Analysen

- Verwenden von Real-Time Intelligence zum Überwachen und Reagieren auf Streamingdaten

- Anwenden von Fabric IQ-Geschäftssemantik, Ontologien und Graphmodellen zum Vereinheitlichen von Unternehmensdaten

Erkunden und Teilen von Erkenntnissen mit Power BI

Power BI-Berichte verwenden semantische Modelle als analytisches Rückgrat. Diese Modelle zentralisieren Geschäftslogik, Berechnungen und Governance und sorgen für Konsistenz in Berichten und Teams. Business Analysts können interaktive Dashboards erstellen, Metriken auflisten und Einblicke sicher in der gesamten Organisation teilen. Verwenden Sie Power BI, wenn Sie strukturierte, wiederverwendbare und regulierte Analysen benötigen, die auf semantischen Modellen basieren, die in OneLake gespeichert sind.

Sie können Power BI-Berichte in Microsoft 365-Anwendungen verteilen und einbetten:

- Das Anheften von Berichten in Microsoft Teams-Kanälen oder -Chats für die gemeinsame Analyse.

- Einbetten von Berichten in SharePoint-Seiten mithilfe des Power BI-Webparts.

- Fügen Sie Liveberichte in PowerPoint-Präsentationen ein.

- Stellen Sie eine Verbindung mit Power BI-Datasets aus Excel her, um PivotTables und Diagramme über semantische Modelle zu erstellen.

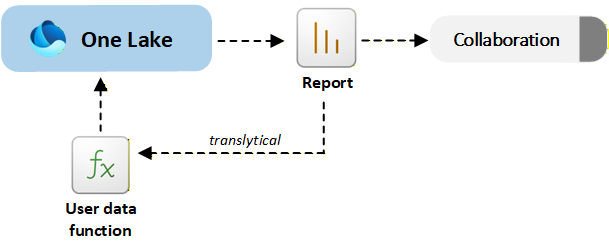

Ergreifen von Maßnahmen aus Berichten mit translytischen Taskflows

Translytische Taskflows ermöglichen es Ihnen, von Einblicken zu Aktionen direkt in einem Power BI-Bericht zu wechseln. Sie können Benutzerdatenfunktionen aufrufen, um Datensätze zu aktualisieren, Workflows auszulösen oder in OneLake zurückzugeben, ohne die Berichtsoberfläche verlassen zu müssen. Verwenden Sie translytische Taskflows, wenn Erkenntnisse und operative Aktualisierungen zusammen auftreten müssen, z. B. das Anpassen des Lagerbestands, das Aktualisieren von Verkaufsprognosen oder das Auflösen von Supportfällen.

Das folgende Diagramm zeigt, wie Power BI-Berichte und translytische Taskflows Analysen und Aktionen in einer einzigen, geregelten Erfahrung kombinieren:

Überwachen und Analysieren von Echtzeitdaten

Mit der Real-Time Intelligence-Workload in Microsoft Fabric können Sie Streaming-Daten mit minimaler Latenz aufnehmen, verarbeiten, analysieren und darauf reagieren. Es kombiniert Funktionen aus den folgenden Diensten:

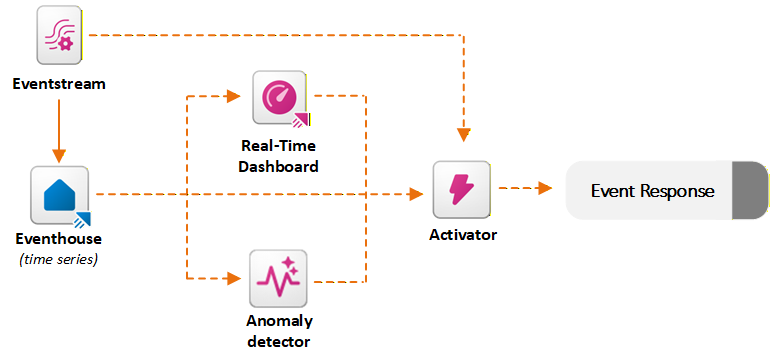

Erfassen von Streamingdaten mit Eventstream

Eventstream erfasst Streamingdaten aus Quellen wie Azure Event Hubs, Kafka, IoT-Geräten oder REST-APIs. Sie wendet Echtzeittransformationen an und leitet Daten in Dienste wie Eventhouse oder Lakehouse weiter.

Eventstream unterstützt Routing- und Schemaausrichtung, Zeitstempelnormalisierung, Partitionierung und Integration mit Aktivator. Da Eventstreams Hochgeschwindigkeitsdaten in Fabric einspeist, überwacht Aktivator diese Streamingereignisse kontinuierlich anhand definierter Regeln in Nahezu-Echtzeit.

Analysieren von Ereignissen mit Eventhouse

Eventhouse ist für Ereignis- und Zeitreihenanalysen mit hohem Volumen optimiert. Sie indiziert und partitioniert Daten automatisch und verwendet Kusto Query Language für schnelle Filterung, Aggregation, Verknüpfungen und Anomalieuntersuchungen. Verwenden Sie Eventhouse, wenn Sie eine skalierbare Analyse von Telemetrie, Betriebsmetriken oder Protokolldaten benötigen.

Die Integration mit Aktivator erfolgt über KQL-Abfragesets, mit denen Sie wiederverwendbare Abfragen definieren können, die kontinuierlich Bedingungen für Eventhouse-Daten auswerten. Der Aktivator kann diese Abfrageausgabe abonnieren und Regeln basierend auf den Abfrageergebnissen anwenden. Wenn eine KQL-Abfrage eine Bedingung erkennt (z. B. überschreitet die CPU-Auslastung 90% oder ein Trend zeigt Fehlerrisiko), löst Aktivierer automatisierte Aktionen wie das Senden von Warnungen, das Starten von Power Automate-Flüssen oder das Ausführen von Fabric-Pipelines aus. Diese Kombination der analytischen Leistungsfähigkeit von KQL mit der Orchestrierung von Aktivator ermöglicht datengesteuerte Automatisierung in Echtzeit in Geschäftsszenarien.

Visualisieren von Livemetriken mit Echtzeit-Dashboards

Echtzeitdashboards bieten live und interaktive Visualisierungen von Streamingdaten, sodass Sie wichtige Metriken und Betriebssignale überwachen können, sobald sie geschehen. Basierend auf Eventhouse (KQL-Datenbanken) können Sie mit diesen Dashboards Zeitreihendaten mit minimaler Latenz abfragen und anzeigen, die Einblicke in die Systemleistung, das Kundenverhalten oder die Sensoraktivität in Echtzeit bieten. Sie unterstützen dynamische Filter-, Automatische Aktualisierungs- und Warnungsfunktionen, sodass sie ideal für Anwendungsfälle wie IT-Überwachung, Fertigungstelemetrie, Finanztransaktionsnachverfolgung und Kundensupportanalysen geeignet sind. Echtzeitdashboards sind auch in Aktivator integriert, sodass Sie nicht nur kritische Ereignisse direkt über die Dashboardoberfläche beobachten, sondern auch direkt auf kritische Ereignisse reagieren können, sodass Einblicke ohne Verzögerung in Aktion umgewandelt werden.

Echtzeit-Dashboards unterscheiden sich in erster Linie von regulären Power BI-Berichten in ihrer Fähigkeit, Livestreamingdaten mit minimaler Latenz zu visualisieren und darauf zu reagieren. Power BI-Berichte basieren in der Regel auf importierten Datasets, die nach einem Zeitplan aktualisiert werden, und eignen sich am besten für historische Analysen und interaktive Erkundungen. Echtzeit-Dashboards hingegen sind für die operative Überwachung und sofortige Einblicke konzipiert.

Anomalieerkennung

Der Anomaliedetektor identifiziert automatisch ungewöhnliche Muster oder Ausreißer in Streaming- oder Zeitreihendaten. Es funktioniert, indem Daten analysiert werden, die in Eventhouse (KQL-Datenbanken) aufgenommen wurden, und das Anwenden statistischer Modelle oder maschineller Lerntechniken , um Abweichungen von erwartetem Verhalten zu erkennen. Diese Anomalien können Systemfehler, Betrug, Leistungsbeeinträchtigung oder andere kritische Ereignisse darstellen, die Aufmerksamkeit erfordern. Im Gegensatz zu statischen schwellenwertbasierten Warnungen passt sich der Anomaliedetektor an die historischen Trends und Saisonalität der Daten an und macht es effektiver, subtile oder kontextabhängige Probleme zu identifizieren.

Wenn eine Anomalie erkannt wird, kann sie nachgeschaltete Aktionen über Aktivierer auslösen, z. B. Senden von Warnungen, Aktualisieren von Dashboards oder Starten automatisierter Workflows. Diese Funktion unterstützt Betriebsszenarien, in denen frühzeitige Erkennung von Anomalien Ausfallzeiten, finanzieller Verlust oder Unzufriedenheit durch Kunden verhindern kann. Es ermöglicht Es Ihnen, von der reaktiven Überwachung zu proaktiven Interventionen über Geschäftsprozesse hinweg zu wechseln.

Verwenden Sie die Anomalieerkennung, wenn statische Schwellenwerte nicht ausreichen und Muster dynamisch ausgewertet werden müssen.

Automatisieren von Antworten mit Aktivator

Aktivator überwacht kontinuierlich Streaming- oder Ereignisdaten und wertet regeln aus, die Sie definieren. Sie unterstützt einfache Schwellenwertregeln und zustandsbehaftete Mustererkennung. Beispielsweise, wenn eine Metrik im Laufe der Zeit kritisch wird oder verringert wird. Mit dieser Funktion können Sie Entscheidungen und operative Aufgaben nahezu in Echtzeit automatisieren und Einblicke in Echtzeitdaten zu sofortigen Handlungen führen. Nutzen Sie Activator, um Echtzeiteinblicke in automatisierte operationale Reaktionen zu verknüpfen.

Wenn Bedingungen erfüllt sind, kann aktivator:

- Senden von Benachrichtigungen an Microsoft Teams oder E-Mails

- Auslösen von Power Automate-Flüssen

- Starten von Fabric-Pipelines oder anderen Fabric-Elementen

Das folgende Diagramm zeigt, wie Real-Time Intelligence in Fabric Streamingdaten erfasst, Ereignisse analysiert und Aktionen mit geringer Latenz auslöst:

Anwenden von Geschäftssemantik mit Fabric IQ

Fabric IQ bietet eine gemeinsame Geschäftskontextebene für Ihren gesamten Datenbestand. Sie ordnet Daten in Lakehouses, Warehouses, Eventhouses und semantischen Modellen einer einheitlichen Ontologie zu.

Fabric Ontology ist ein freigegebenes, maschinenverständliches Vokabular Ihres Unternehmens, das die wichtigsten Entitäten definiert (z. B. Kunde, Produkt oder Ebene), ihre Beziehungen, Eigenschaften, Geschäftsregeln und mögliche Aktionen, während alle Begriffe in der Sprache des Unternehmens beibehalten werden. Es vereint eine live-, verbundene Darstellung der Funktionsweise Ihres Unternehmens, die direkt den zugrunde liegenden Daten in OneLake zugeordnet ist. Mit diesem Modell können Benutzer und Agenten nicht nur Tabellen sehen, sondern auch Beziehungen wie "Kunden geben Bestellungen für Produkte auf", "Flüge haben Segmente und Crews" und "Verzögerte Lieferungen beeinträchtigen den Umsatz." Dieser datenorientierte Kontext ist für jede KI von entscheidender Bedeutung, die Entscheidungen treffen oder Analysen über das Unternehmen erstellen soll.

Wenn Sie ein Ontology-Element (z. B. eine Entität "Flight" mit Eigenschaften wie Status oder Delay) definieren, ordnen Sie es der Tabelle und den Feldern in einem Eventhouse-, Lakehouse- oder Warehouse-Element zu, das diese Informationen enthält, ohne die Daten zu kopieren oder zu verschieben. Nachdem die Daten in OneLake landen, wird sie Teil der Live-Ontologie.

Über Geschäftsentitäten und Beziehungen hinaus können Ontologien auch Aktionen erfordernde Regeln definieren, z. B. "Wenn Bestandsschwellenwert < , Auffüllen auslösen". Operations Agents verwenden diese Regeln, um Workflows im Aktivierer auszulösen. Wenn ein Operations Agent Aktivator aufruft, um einen Power Automate-Fluss auszuführen, werden Parameter übergeben, die von Ontology-Eigenschaften wie CustomerID und OrderStatus abgeleitet sind. Mit diesem Ansatz wird sichergestellt, dass Automatisierungsflüsse mit vollständigem Geschäftskontext funktionieren, nicht nur rohe IDs.

Diese semantische Ebene ermöglicht konsistente Analysen, KI-gestützte Schlussfolgerungen und Automatisierung.

Erkunden von verbundenen Daten mit Diagrammmodellen

Graph-Modelle stellen ein verbundenes Netzwerk von ontologiedefinierte Entitäten und Beziehungen bereit. Sie ermöglichen Multi-Hop-Schlussfolgerung, Einflussanalyse und fortgeschrittene Algorithmen wie kürzeste Pfad- und Gemeinschaftserkennung. Mit dieser Integration können KI-Agents und Analysetools komplexe Beziehungen effizient abfragen. Es bietet Echtzeit-Einblicke in Abhängigkeiten und kaskadierende Effekte, die herkömmliche relationale Modelle schwer zu bewältigen haben. Sie können Diagrammmodelle mithilfe von GraphQL-Abfragen über Fabric-APIs abfragen.