Hinweis

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, sich anzumelden oder das Verzeichnis zu wechseln.

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, das Verzeichnis zu wechseln.

Das Verständnis natürlicher Sprachen (Natural Language Understanding, NLU) ist der Kern, wie Copilot Studio-Agents Benutzerabfragen sinnvoll machen und relevante kontextbezogene Antworten bereitstellen. Ein klar definierter Ansatz zur Absichtserkennung, Entitätenextraktion und Fallback-Handling stellt sicher, dass Agenten effiziente, natürliche Gespräche führen, die mit den Geschäftsbedürfnissen übereinstimmen.

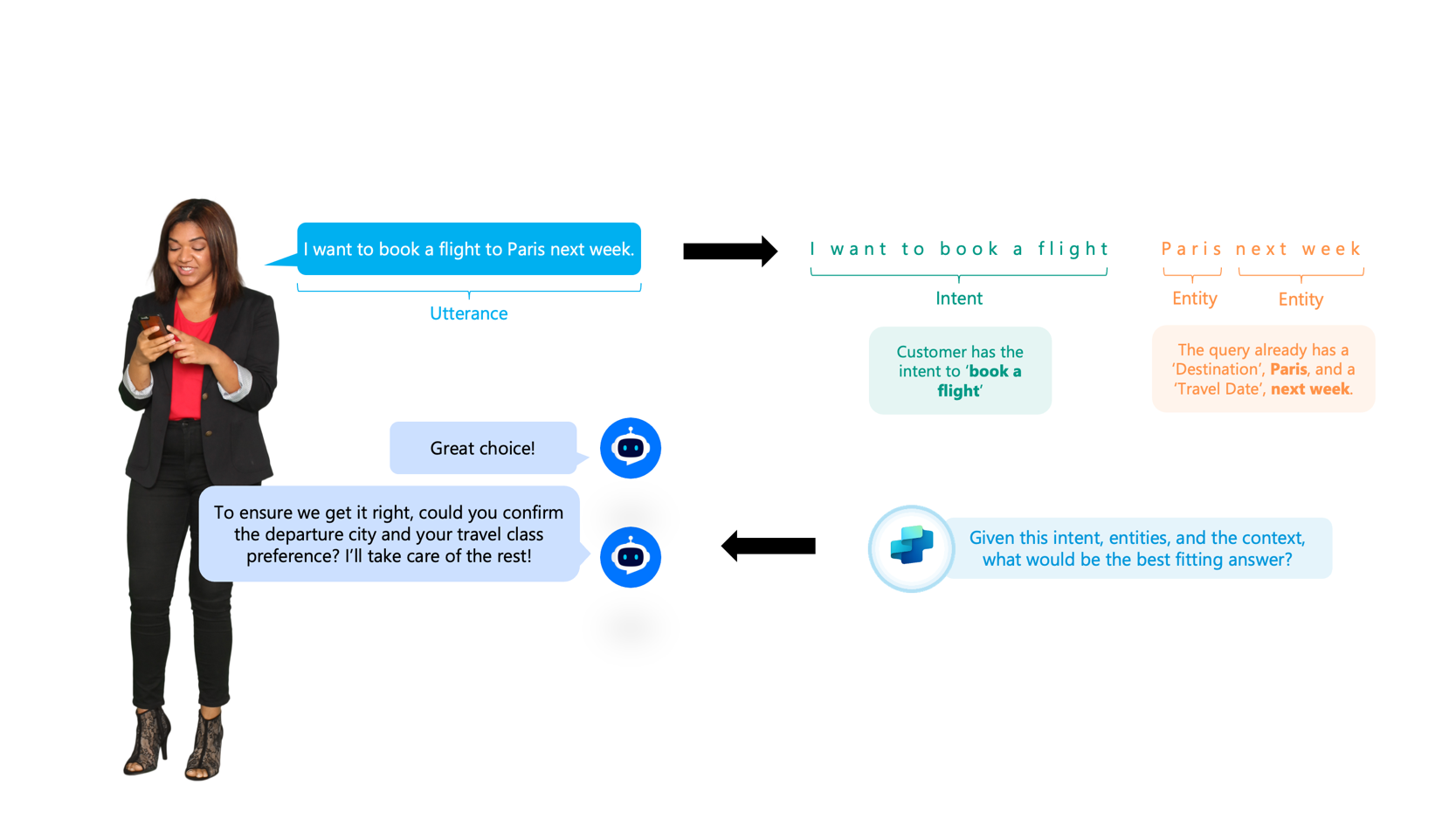

Wenn ein Nutzer etwas an einen Agenten eingibt, spricht man von einer Äußerung. Der Agent muss diese Äußerung in Absicht und Entitäten unterteilen, sodass die Reaktion des Agenten sowohl natürlich als auch effizient wirkt.

Was ist Sprachverständnis?

Sprachverständnis (LU) ist ein Teilgebiet der natürlichen Sprachverarbeitung (NLP), das darauf abzielt, Maschinen zu ermöglichen, die Bedeutung, Absicht und den Kontext hinter menschlicher Sprache zu verstehen.

Diagramm, das zeigt, wie die Nachricht eines Nutzers in Absicht und Entitäten unterteilt ist. Eine Person tippt: "Ich möchte nächste Woche einen Flug nach Paris buchen." Die Nachricht ist als Äußerung gekennzeichnet. Der Satz "Ich möchte einen Flug buchen" wird als Absicht angegeben, und "Paris" und "nächste Woche" werden als Entitäten identifiziert. Das System fragt dann nach weiteren Details wie Abflugstadt und Reiseklasse. Das Diagramm zeigt, wie der Akteur Absicht, Entitäten und Kontext nutzt, um die beste Reaktion zu bestimmen.

Sprachverständnis umfasst:

- Absichtserkennung: Identifikation dessen, was der Nutzer erreichen möchte (zum Beispiel "Einen Flug nach Paris nächste Woche buchen" entspricht der Absicht, einen Flug zu buchen).

- Entitätsextraktion: Extraktion wichtiger Details wie Daten, Orte oder Namen (zum Beispiel "Paris" als Ziel, "nächste Woche" als Reisedatum).

- Kontextbewusstsein: Kontinuität aufrechterhalten und Mehrdeutigkeiten im Gespräch lösen (zum Beispiel das Verstehen von Pronomen oder Anspielungen).

- Umgang mit Mehrdeutigkeiten: Kontext nutzen, um Wörter mit mehreren Bedeutungen zu lösen (zum Beispiel "Bank" als Finanzinstitut oder Flussufer).

Sprachverständnis in Copilot Studio

Copilot Studio verfügt über ein flexibles Modell für das Sprachverständnis mit mehreren Konfigurationsoptionen.

Generative Orchestrierung

Generative Orchestrierung nutzt Sprachmodelle, um Themen, Aktionen und Wissen intelligent miteinander zu verknüpfen. Diese Funktion ermöglicht Multi-Intent-Erkennung, fortschrittliche Entitätsextraktion und dynamische Plangenerierung für komplexe Abfragen.

Diese Methode ist die Standardmethode für Copilot Studio. Dieser Ansatz erkennt mehrere Absichten oder Themen in einer einzigen Äußerung, verknüpft automatisch Aktionen und Wissensquellen und erzeugt einheitliche Antworten. Es ist besonders nützlich, um komplexe Gespräche zu bewältigen, die mehrere Geschäftsbereiche abdecken. Generative Orchestrierung hat Grenzen, etwa fünf Nachrichten pro Thema oder Aktionskette und 128 Themen oder Aktionen pro Orchestrierung, bietet aber eine kraftvolle Möglichkeit, die Breite der Konversation zu skalieren.

Mehr erfahren Sie unter Generative Orchestrierungsfähigkeiten anwenden.

Klassische Orchestrierung

Klassische Orchestrierung verwendet Triggerphrasen und deterministisches Themenrouting. Wenn die Äußerung eines Nutzers mit einer Auslöserphrase übereinstimmt, läuft das entsprechende Thema. Wenn kein Match besteht, suchen Rückfallmechanismen nach Wissensquellen oder fordern den Nutzer zur Klarstellung auf.

Integrierte NLU

Dieser Ansatz war der Standard, ist jetzt aber der Fallback-Ansatz. Copilot Studio stellt ein sofort einsatzbereites NLU-Modell bereit, das Triggerausdrücke, vordefinierte Entitäten und benutzerdefinierte Entitäten unterstützt. Dieses Modell ermöglicht es Agenten, Benutzerabsicht zu identifizieren und wichtige Details wie Daten, Ziele oder Mengen direkt aus einer Abfrage zu extrahieren.

NLU+

Für hohe Genauigkeit verwenden Sie die NLU+-Option. Die NLU+-Option eignet sich ideal für große Anwendungen auf Unternehmensniveau. Diese Arten von Anwendungen bestehen in der Regel aus einer großen Anzahl von Themen und Entitäten und verwenden eine große Anzahl von Schulungsbeispielen. Wenn Sie über einen sprachfähigen Agent verfügen, werden Ihre NLU+-Schulungsdaten auch verwendet, um Ihre Spracherkennungsfunktionen zu optimieren.

Azure CLU-Integration

Für komplexere Szenarien, in denen Sie die standardmäßige generative Orchestrierung nicht verwenden können, können Sie Azure Conversational Language Understanding (CLU) integrieren. CLU bietet größere Individualisierung, mehrsprachige Unterstützung und komplexe Entitätsextraktion (zum Beispiel mehrere "von"-Entitäten). Sie müssen CLU-Absichten Copilot Studio-Themen zuordnen, um sie synchron zu halten. Diese Option ist besonders nützlich für branchenspezifische Vokabular, nicht englische Sprachen oder Szenarien, die eine höhere Genauigkeit erfordern.

Schlüsselmerkmale und Einschränkungen

In dieser Tabelle werden die drei Sprachverständnisansätze in Copilot Studio verglichen. Es hebt ihre wichtigsten Merkmale und Einschränkungen hervor, um Ihnen zu helfen, das richtige Modell für die Anforderungen Ihres Maklers an Komplexität, Skalierung und Genauigkeit auszuwählen.

| Funktionen und Einschränkungen | Generative Orchestrierung | Eingebautes NLU-Modell | Benutzerdefiniertes Azure CLU-Modell |

|---|---|---|---|

| Wichtige Features |

|

|

|

| Einschränkungen |

|

|

|

Erfahren Sie mehr in Überblick über das Verständnis natürlicher Sprache (NLU).

Themenstruktur und Fallback

Die Themen haben sich von einem starren, intentionsbasierten Weg hin zu einem flexibleren, orchestrierenden Ansatz verschoben. Anstatt sich ausschließlich auf vordefinierte Auslöser und Pfade zu verlassen, fungieren Themen nun als modulare Anweisungen, auf die der Agent beim Orchestrieren eines Gesprächs zurückgreifen kann. Generative Orchestrierung übernimmt den Großteil des Routings, indem sie Benutzereingaben dynamisch interpretiert, und Themen bieten strukturierte Rückfallbacks, wenn Präzision erforderlich ist.

Das traditionellere strukturierte Themendesign lässt Gespräche natürlich und effizient wirken. Themen können Einstiegspunkte sein, die durch Nutzeräußerungen ausgelöst werden, oder wiederverwendbare Unterthemen, die durch Weiterleitungen oder Systemereignisse aufgerufen werden. Begriffsklärungsthemen helfen Verwirrung zu vermeiden, wenn mehrere Themen ausgelöst werden könnten, während Rückfall- und Unterhaltungsverbesserungsthemen Sicherheitsnetze bieten, wenn der Agent die Absicht nicht sicher abgleichen kann. Sie können auch generative Antworten ergänzen, die aus externen Wissensquellen stammen, sodass Nutzer selten ohne Antwort bleiben.

Erfahren Sie mehr in Best Practices zur Erstellung von Themen anwenden.

Lokalisierung und Sprachen

Die von einem Copilot Studio-Agent verwendete Sprache wird durch den Wert der Systemvariablen bestimmt: System.User.Language.

Diese Variable fungiert als zentraler Kontrollpunkt für alle sprachbezogenen Verhaltensweisen des Agenten. Man kann seinen Wert manuell, programmatisch oder automatisch erkennen.

Wie funktioniert es?

Suchwissen in der Sprache des Benutzers: Copilot Studio verwendet den Wert

System.User.Language, um Wissensquellen in der angegebenen Sprache zu durchsuchen. Dieser Ansatz bedeutet, dass selbst wenn ein Nutzer eine Frage in einer Sprache stellt, der Agent die Suchanfrage in die inSystem.User.Languagefestgelegte Sprache übersetzt (automatische Übersetzung für Suchanfragen).Antworten Sie in der Sprache des Benutzers: Der Agent erzeugt Antworten in der von der Sprache angegebenen

System.User.LanguageSprache, unabhängig davon, welche Sprache in der Frage oder in den Originaldokumenten verwendet wird (automatische Übersetzung für die Antwortgenerierung).Manuelles Überschreiben: Du kannst den Wert von

System.User.Languagemanuell einstellen, um den Agenten dazu zu zwingen, in einer bestimmten Sprache zu arbeiten. Diese Funktion ist nützlich für Tests oder Szenarien, in denen man die Sprache explizit steuern muss. Weitere Informationen finden Sie unter Konfigurieren und Erstellen mehrsprachiger Agents.

Automatische Erkennung gesprochener Sprache

Sie können Copilot Studio so konfigurieren, dass die gesprochene oder geschriebene Sprache des Benutzers automatisch erkannt und die variable System.User.Language entsprechend festgelegt wird. Diese Funktion ermöglicht nahtlose mehrsprachige Erlebnisse, ohne dass die Nutzer ihre Sprachpräferenz angeben müssen.

Wie die automatische Erkennung funktioniert

- Triggerbasierte Erkennung: Wenn der Bot eine Nachricht erhält, startet ein Trigger einen Spracherkennungsfluss.

-

Systemvariable setzen: Der Bot weist die erkannte Sprache an

System.User.Language. - Dynamische Antwort: Der Agent führt das Gespräch in der erkannten Sprache fort, sucht sowohl Wissen als auch generiert entsprechende Antworten.

Vorteile

- Personalisiertes Erlebnis: Nutzer interagieren in ihrer bevorzugten Sprache ohne manuelle Konfiguration.

- Konsistente Erfahrung: Alle Antworten und Wissensabrufe stimmen mit der erkannten oder festgelegten Sprache überein.

- Skalierbare Lösung: Unterstützt globale Bereitstellungen mit minimaler Konfiguration.

Tipp

Überprüfen Sie die Beispiellösung, die veranschaulicht, wie Copilot Studio-Agents die gesprochene Sprache eines Benutzers automatisch erkennen und zu einer der vom Hersteller genehmigten Sprachen für den Agent bei der Automatischen Erkennungssprache für generative Antworten wechseln können.

Best Practices für Lokalisierung

- Unterstützte Sprachen konfigurieren: Definiere primäre und sekundäre Sprachen für deinen Agenten. Verwenden Sie Lokalisierungsdateien (JSON oder ResX), um Übersetzungen für Prompts, Nachrichten und Themen bereitzustellen.

- Testen Sie mehrsprachige Szenarien: Simulieren Sie Benutzerinteraktionen in verschiedenen Sprachen, um reibungslose Übergänge und präzise Antworten zu gewährleisten.

- Use auto-translation: Verlassen Sie sich auf die integrierte Übersetzung von Copilot Studio für die Wissenssuche und Antwortgenerierung, stellen aber benutzerdefinierte Übersetzungen für kritische oder differenzierte Inhalte bereit.

- Überwachen und verfeinern: Nutzen Sie Analysen, um den Sprachgebrauch zu verfolgen und die Lokalisierungsabdeckung im Laufe der Zeit zu verbessern.

Copilot Studio: Ansätze zur Agentensprache

- Getrennte Agenten pro Sprache.

- Einzelne mehrsprachige Agenten mit vorgefertigten Übersetzungen.

- Echtzeit-mehrsprachige Agenten, die Übersetzungsdienste zwischen Nutzer und Agent nutzen.

Der richtige Ansatz hängt von der Nutzung, Trennungsfragen, Skalierung, Aktualisierungsrhythmus und verfügbaren Ressourcen ab.

Identifizierte technische Herausforderungen

Typische Herausforderungen sind die Sicherstellung, dass Azure CLU- und Copilot Studio-Themen synchronisiert bleiben, mehrdeutige Äußerungen behandeln und mehrsprachige Bereitstellungen skalieren. Die frühzeitige Identifikation dieser Hindernisse ermöglicht es Ihnen, Minderungsstrategien zu planen, wie Fallback-Konfigurationen, Massentests von Triggerphrasen oder relaisbasierte Übersetzungsdienste.

Das Ziel des Sprachverständnisses ist es, sicherzustellen, dass jeder Agent Nutzeranfragen genau interpretieren, sich an verschiedene Sprachen und Szenarien anpassen und das Unerwartete elegant bewältigen kann. Dieses Ziel bildet eine starke Grundlage für die Erstellung zuverlässiger, effizienter und ansprechender Unterhaltungen in Copilot Studio.