Nota

L'accesso a questa pagina richiede l'autorizzazione. È possibile provare ad accedere o modificare le directory.

L'accesso a questa pagina richiede l'autorizzazione. È possibile provare a modificare le directory.

Si applica a:✅ endpoint di analisi SQL e Warehouse in Microsoft Fabric

Fabric Data Warehouse è un data warehouse relazionale su scala aziendale costruito su una base di data lake.

- I casi d'uso ideali per Fabric Data Warehouse sono schemi star o snowflake, data mart aziendali curati, modelli semantici regolati per business intelligence.

- I dati del data warehouse di Fabric, come tutti i dati di Fabric, vengono archiviati in tabelle Delta, ovvero file di dati Parquet con un log delle transazioni basato su file. Basato sul formato open data di Fabric, un warehouse consente la condivisione e la collaborazione tra data engineer e utenti aziendali senza compromettere la sicurezza o la governance.

- Fabric Data Warehouse viene sviluppato principalmente con T-SQL e condivide un'ampia superficie basata sul motore di database SQL, con supporto completo delle transazioni ACID a più tabelle, viste materializzate, funzioni e stored procedure.

- Il caricamento bulk di Fabric Data Warehouse può essere eseguito tramite connessioni T-SQL e TDS oppure tramite Spark, con dati scritti in blocco direttamente nelle tabelle Delta.

- L'esperienza SaaS facile da usare è anche strettamente integrata con Power BI per semplificare l'analisi e la creazione di report.

I clienti del data warehouse traggono i seguenti vantaggi:

- Le query tra database possono usare più origini dati per ottenere rapidamente informazioni dettagliate senza duplicare i dati.

-

Inserire, caricare e trasformare facilmente i dati su larga scala tramite pipeline, flussi di dati, query tra database o il

COPY INTOcomando T-SQL. - La gestione autonoma dei carichi di lavoro con il motore di elaborazione delle query distribuite leader del settore significa che non c'è alcuna manopola da azionare per ottenere le prestazioni milgiori della categoria.

- Ridimensionare quasi istantaneamente per soddisfare le esigenze aziendali. Archiviazione e calcolo sono separati.

- I dati vengono replicati automaticamente in OneLake Files per l'accesso esterno.

- Creato per qualsiasi livello di competenza, dal citizen developer all'amministratore del database o all'ingegnere dei dati.

Oggetti del magazzino dati

Fabric Data Warehouse non è un data warehouse aziendale tradizionale, si tratta di un lake warehouse che supporta due elementi distinti di warehousing: l'elemento fabric warehouse e l'elemento dell'endpoint di analisi SQL. Entrambi sono appositamente creati per soddisfare le esigenze aziendali dei clienti, offrendo le migliori prestazioni della categoria, riducendo al minimo i costi e il sovraccarico amministrativo.

Data warehouse dell'architettura

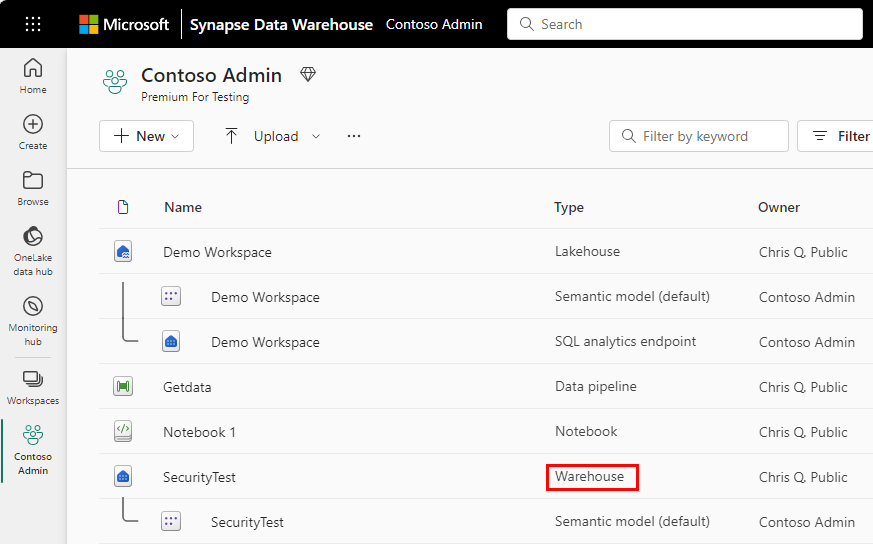

In un'area di lavoro di Microsoft Fabric, un magazzino Fabric viene etichettato come Warehouse nella colonna Tipo. Quando sono necessarie le funzionalità di piena potenza e transazionale (supporto di query DDL e DML) di un data warehouse, questa è la soluzione più rapida e semplice.

Il warehouse può essere popolato con uno dei metodi di inserimento dati supportati, come COPY INTO, Pipeline, Flussi di dati, od opzioni di inserimento tra database, come CREATE TABLE AS SELECT (CTAS), INSERT..SELECT o SELECT INTO.

Per iniziare a usare il Warehouse, consultare:

Endpoint di analisi SQL del Lakehouse

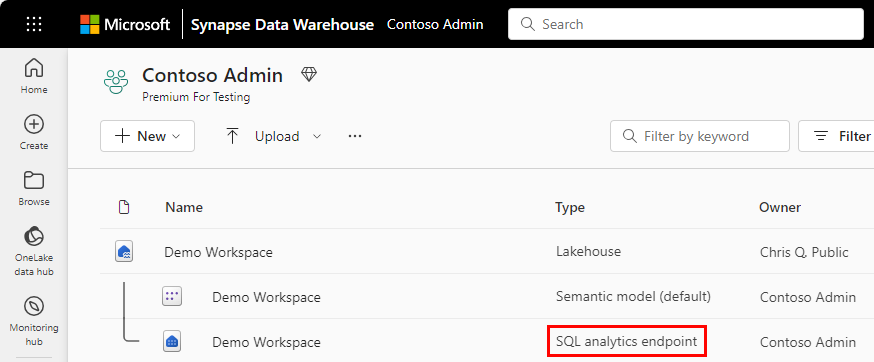

In un'area di lavoro di Microsoft Fabric, ogni Lakehouse ha un "endpoint di analisi SQL" generato automaticamente che può essere usato per passare dalla vista "Lake" del Lakehouse (che supporta l'ingegneria dei dati e Apache Spark) alla vista "SQL" dello stesso Lakehouse per creare viste, funzioni, stored procedure e applicare la sicurezza SQL.

Usando tecnologie simili, un warehouse, un database SQL e Fabric OneLake eseguono automaticamente il provisioning di un endpoint di analisi SQL al momento della creazione.

Con l'endpoint di analisi SQL, i comandi T-SQL possono definire ed eseguire query su oggetti di dati, ma non manipolare o modificare i dati. Nell'endpoint di analisi SQL è possibile effettuare le seguenti azioni:

- Interroga le tabelle che fanno riferimento ai dati nelle tue cartelle Delta Lake nel lago.

- Creare viste, funzioni con valori di tabella in linea e procedure per incapsulare la semantica e la logica aziendale in T-SQL.

- Gestire le autorizzazioni per gli oggetti. Per altre informazioni sulla sicurezza nell'endpoint di analisi SQL, vedere Sicurezza di OneLake per gli endpoint di analisi SQL.

Per iniziare a usare l'endpoint di analisi SQL, consulta:

- Meglio insieme: il lakehouse e il warehouse in Microsoft Fabric

- Considerazioni sulle prestazioni degli endpoint di SQL analitica

- Eseguire query sull'endpoint di analisi SQL o sul data warehouse in Microsoft Fabric

Magazzino o lakehouse

Quando si decide di usare un warehouse o un lakehouse, è importante considerare le esigenze specifiche e il contesto dei requisiti di gestione e analisi dei dati.

Scegliere un data warehouse quando è necessaria una soluzione su scala aziendale con formato standard aperto, senza il ricorso a manopole e con una configurazione minima. Ideale per formati di dati semistrutturati e strutturati, il data warehouse è adatto per professionisti dei dati sia principianti che esperti, offrendo esperienze semplici e intuitive.

Scegliere un lakehouse quando è necessario un archivio di grandi dimensioni di dati altamente non strutturati da origini eterogenee e si vuole usare Spark come strumento di sviluppo principale. Fungendo da data warehouse "leggero", è sempre possibile usare l'endpoint di analisi SQL e gli strumenti T-SQL per distribuire scenari di creazione di report e intelligence dei dati nel lakehouse.

È sempre possibile aggiungere l'uno o l'altro in un secondo momento, in caso di cambiamento delle esigenze aziendali e indipendentemente dalla posizione iniziale, poiché il warehouse e il lakehouse usano lo stesso potente motore SQL per tutte le query T-SQL.

Per indicazioni più dettagliate sulla decisione migliore, consultare la Guida alle decisioni di Microsoft Fabric: Scegliere tra Warehouse e Lakehouse.

Analizzare dati in Lakehouse, Warehouse o Eventhouse

Microsoft Fabric offre un menu unificato Analizza dati con che fornisce un modo coerente per passare dai dati all'analisi in Lakehouse, Warehouse e Eventhouse. Anziché spostarsi in menu diversi per ogni carico di lavoro, è possibile avviare l'analisi da un singolo punto di ingresso prevedibile.

Dal Lakehouse o Warehouse, l'azione Analizza i dati con permette di:

- Analizzare i dati usando l'endpoint di analisi SQL, quando la disponibilità e la sincronizzazione di OneLake sono abilitate.

- Analizzare i dati usando l'endpoint Eventhouse, direttamente dall'ambiente dei dati di origine, senza spostarsi a un carico di lavoro separato.

- Avviare azioni di analisi da un'unica posizione, senza cambiare contesto o riconfigurare l'accesso.

Questa integrazione offre un'esperienza coerente indipendentemente dalla posizione in cui si trovano i dati. Lo stesso menu Analizza dati con è disponibile in Lakehouse, Warehouse e Eventhouse, quindi il modo in cui si analizzano i dati ha lo stesso aspetto e la stessa sensazione in tutti i carichi di lavoro. Indipendentemente dal fatto di eseguire analisi esplorative, trasformazioni avanzate o sperimentazione, è possibile iniziare rapidamente da un punto di partenza familiare.

Migration

Usare Fabric Migration Assistant per Data Warehouse per eseguire la migrazione da Azure Synapse Analytics, SQL Server e altre piattaforme del motore di database SQL. Vedere Pianificazione della migrazione e metodi di migrazione per i pool SQL dedicati di Azure Synapse Analytics in Fabric Data Warehouse.

Per indicazioni sulla migrazione in Microsoft Fabric, vedere gli strumenti e i collegamenti in Panoramica della migrazione di Microsoft Fabric.