Notatka

Dostęp do tej strony wymaga autoryzacji. Może spróbować zalogować się lub zmienić katalogi.

Dostęp do tej strony wymaga autoryzacji. Możesz spróbować zmienić katalogi.

DOTYCZY: Azure Data Factory

Azure Data Factory  Azure Synapse Analytics

Azure Synapse Analytics

Wskazówka

Data Factory w usłudze Microsoft Fabric jest następną generacją Azure Data Factory z prostszą architekturą, wbudowaną sztuczną inteligencją i nowymi funkcjami. Jeśli dopiero zaczynasz integrować dane, zacznij od Fabric Data Factory. Istniejące obciążenia ADF można zaktualizować do Fabric, aby uzyskać dostęp do nowych możliwości w zakresie nauki o danych, analiz w czasie rzeczywistym oraz raportowania.

W tym artykule opisano sposób używania działania kopiowania w potokach Azure Data Factory lub Azure Synapse do kopiowania danych z i do Azure SQL Database oraz używania Data Flow do przekształcania danych w Azure SQL Database. Aby dowiedzieć się więcej, przeczytaj artykuł wprowadzający Azure Data Factory lub Azure Synapse Analytics.

Obsługiwane możliwości

Ten łącznik Azure SQL Database jest obsługiwany w następujących możliwościach:

| Obsługiwane możliwości | środowisko IR | Zarządzany prywatny punkt końcowy |

|---|---|---|

| Copy activity (źródło/ujście) | (1) (2) | ✓ |

| Mapowanie przepływu danych (źródło/ujście) | (1) | ✓ |

| Działanie Lookup | (1) (2) | ✓ |

| Działanie GetMetadata | (1) (2) | ✓ |

| Działanie skryptu | (1) (2) | ✓ |

| Działanie procedury składowanej | (1) (2) | ✓ |

(1) Środowisko uruchomieniowe Azure (2) Środowisko uruchomieniowe lokalnie hostowane

W przypadku Copy activity ten łącznik Azure SQL Database obsługuje następujące funkcje:

- Kopiowanie danych przy użyciu uwierzytelniania SQL oraz uwierzytelniania za pomocą tokenu aplikacji Microsoft Entra, z użyciem jednostki usługi lub tożsamości zarządzanej dla zasobów Azure.

- Jako źródło pobieranie danych przy użyciu zapytania SQL lub procedury składowanej. Możesz również zdecydować się na równoległe kopiowanie ze źródła Azure SQL Database, zobacz sekcję Równoległe kopiowanie z bazy danych SQL dla szczegółowych informacji.

- Jako ujście automatycznie tworzy tabelę docelową, jeśli nie istnieje na podstawie schematu źródłowego; dołączanie danych do tabeli lub wywoływanie procedury składowanej za pomocą logiki niestandardowej podczas kopiowania.

Jeśli używasz warstwy bezserwerowej Azure SQL Database serverless tier, pamiętaj, że po wstrzymaniu serwera działanie kończy się niepowodzeniem, a nie oczekiwaniem na gotowość automatycznego wznawiania. Możesz dodać ponawianie próby działania lub łańcuch dodatkowych działań, aby upewnić się, że serwer jest na żywo podczas rzeczywistego wykonywania.

Ważne

Jeśli dane są kopiowane przy użyciu środowiska Integration Runtime Azure, skonfiguruj regułę zapory na poziomie serwera aby usługi Azure mogły uzyskiwać dostęp do serwera. Jeśli skopiujesz dane przy użyciu własnego środowiska Integration Runtime, skonfiguruj zaporę tak, aby zezwalała na odpowiedni zakres adresów IP. Ten zakres obejmuje adres IP maszyny używany do nawiązywania połączenia z Azure SQL Database.

Wprowadzenie

Aby wykonać działanie kopiowania za pomocą potoku, możesz użyć jednego z następujących narzędzi lub zestawów SDK:

- Narzędzie do kopiowania danych

- Portal Azure

- .NET SDK

- Python SDK

- Azure PowerShell

- API REST

- Szablon menedżera zasobów Azure

Tworzenie połączonej usługi Azure SQL Database przy użyciu interfejsu użytkownika

Wykonaj poniższe kroki, aby utworzyć połączoną usługę Azure SQL Database w interfejsie użytkownika portalu Azure.

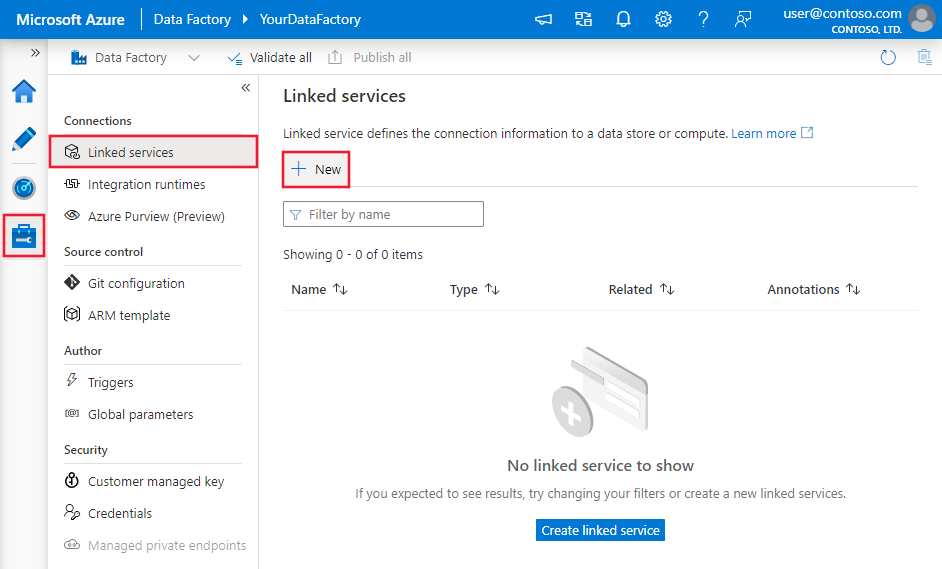

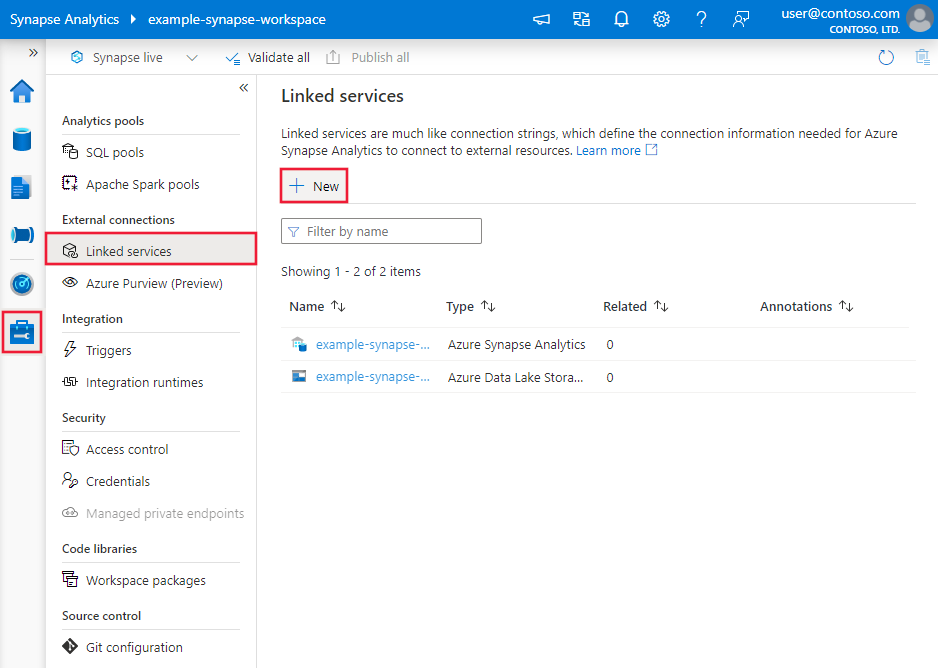

Przejdź do karty Zarządzanie w obszarze roboczym Azure Data Factory lub Synapse i wybierz pozycję Połączone usługi, a następnie kliknij pozycję Nowy:

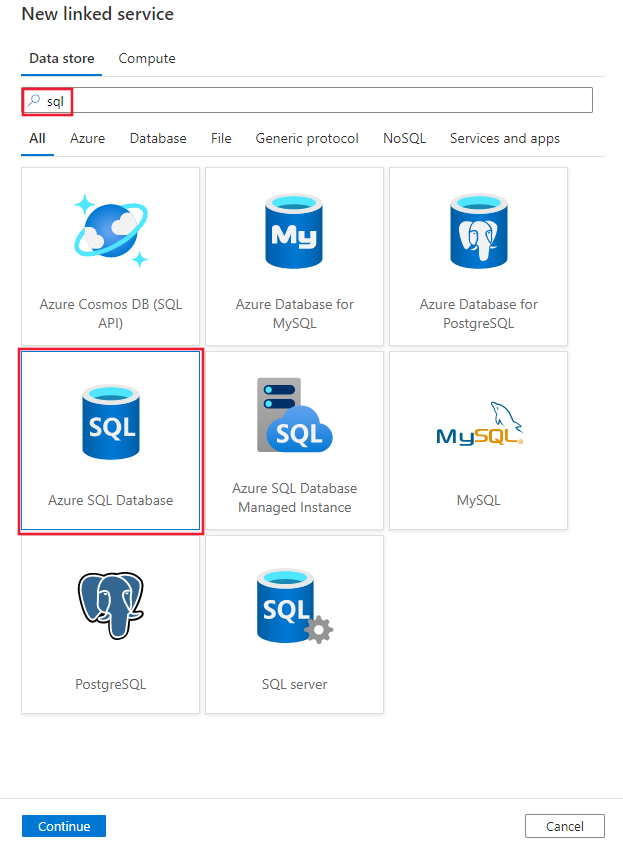

Wyszukaj SQL i wybierz łącznik Azure SQL Database.

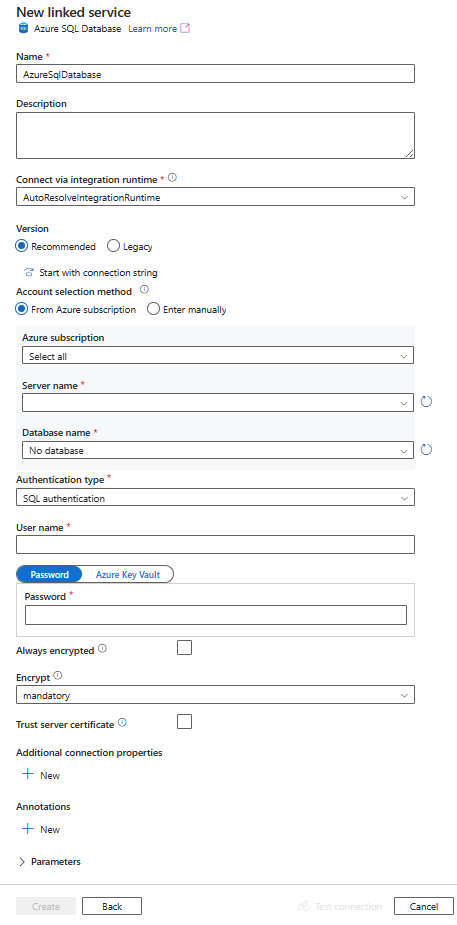

Skonfiguruj szczegóły usługi, przetestuj połączenie i utwórz nową połączoną usługę.

Szczegóły konfiguracji łącznika

Poniższe sekcje zawierają szczegółowe informacje o właściwościach używanych do definiowania jednostek potoku Azure Data Factory lub Synapse specyficznych dla łącznika Azure SQL Database.

Właściwości połączonej usługi

Łącznik Azure SQL Database Recommended obsługuje protokół TLS 1.3. Odwołaj się do tej sekcji, aby uaktualnić wersję łącznika Azure SQL Database z wersji Legacy. Aby uzyskać szczegółowe informacje o właściwościach, należy odnieść się do odpowiednich sekcji.

Wskazówka

Jeśli wystąpi błąd z kodem błędu "UserErrorFailedToConnectToSqlServer", a komunikat taki jak "Limit sesji dla bazy danych to XXX i został osiągnięty", dodaj Pooling=false do connection string i spróbuj ponownie.

Pooling=false zaleca się również w przypadku konfiguracji powiązanej usługi typu SHIR(Self Hosted Integration Runtime). Buforowanie i inne parametry połączenia można dodać jako nowe nazwy parametrów i wartości w sekcji Dodatkowe właściwości połączenia formularza tworzenia połączonej usługi.

Rekomendowana wersja

Te właściwości ogólne są obsługiwane w przypadku usługi połączonej Azure SQL Database w momencie stosowania wersji Recommended:

| Właściwości | Opis | Wymagane |

|---|---|---|

| typ | Właściwość type musi być ustawiona na AzureSqlDatabase. | Tak |

| serwer | Nazwa lub adres sieciowy wystąpienia programu SQL Server, z którym chcesz nawiązać połączenie. | Tak |

| baza danych | Nazwa bazy danych. | Tak |

| typ uwierzytelniania | Typ używany do uwierzytelniania. Dozwolone wartości to SQL (wartość domyślna), ServicePrincipal, SystemAssignedManagedIdentity, UserAssignedManagedIdentity. Przejdź do odpowiedniej sekcji uwierzytelniania dotyczącej określonych właściwości i wymagań wstępnych. | Tak |

| alwaysEncryptedSettings | Określ informacje, które są potrzebne do włączenia funkcji Always Encrypted, w celu ochrony poufnych danych przechowywanych na serwerze SQL przy użyciu tożsamości zarządzanej lub poświadczenia usługi. Aby uzyskać więcej informacji, zobacz przykład JSON w poniższej tabeli i sekcję Using Always Encrypted (Używanie funkcji Always Encrypted ). Jeśli nie zostanie określone, domyślnie ustawienie "zawsze szyfrowane" jest wyłączone. | Nie. |

| szyfrować | Określ, czy szyfrowanie TLS jest wymagane dla wszystkich danych wysyłanych między klientem a serwerem. Opcje: obowiązkowe (dla wartości true, domyślnie)/opcjonalne (dla wartości false)/ścisłe. | Nie. |

| ZaufajCertyfikatowiSerwera | Określ, czy kanał zostanie zaszyfrowany podczas pomijania łańcucha certyfikatów w celu zweryfikowania zaufania. | Nie. |

| hostNameInCertificate | Nazwa hosta do użycia podczas weryfikowania certyfikatu serwera dla połączenia. Jeśli nie zostanie określona, nazwa serwera jest używana do weryfikacji certyfikatu. | Nie. |

| connectVia | To środowisko uruchomieniowe integracji służy do połączenia z magazynem danych. Jeśli magazyn danych znajduje się w sieci prywatnej, możesz użyć środowiska Integration Runtime Azure lub własnego środowiska Integration Runtime. Jeśli nie jest określone, używane jest domyślne Azure Integration Runtime. | Nie. |

Aby uzyskać dodatkowe właściwości połączenia, zobacz poniższą tabelę:

| Właściwości | Opis | Wymagane |

|---|---|---|

| zamiar aplikacji | Typ obciążenia aplikacji podczas nawiązywania połączenia z serwerem. Dozwolone wartości to ReadOnly i ReadWrite. |

Nie. |

| connectTimeout | Czas oczekiwania na połączenie z serwerem (w sekundach) przed zakończeniem próby i wygenerowaniem błędu. | Nie. |

| connectRetryCount | Liczba ponownych połączeń podjęta po zidentyfikowaniu błędu bezczynności połączenia. Wartość powinna być liczbą całkowitą z zakresu od 0 do 255. | Nie. |

| connectRetryInterval | Czas (w sekundach) między każdą ponowną próbą nawiązania połączenia po zidentyfikowaniu błędu bezczynności połączenia. Wartość powinna być liczbą całkowitą z zakresu od 1 do 60. | Nie. |

| loadBalanceTimeout | Minimalny czas (w sekundach), przez jaki połączenie może istnieć w puli połączeń przed jego zamknięciem. | Nie. |

| commandTimeout | Domyślny czas oczekiwania (w sekundach) przed zakończeniem próby wykonania polecenia i wygenerowaniem błędu. | Nie. |

| zintegrowaneBezpieczeństwo | Dozwolone wartości to true lub false. Podczas określania false parametru określ, czy nazwa użytkownika i hasło są określone w połączeniu. Podczas określania true wskazuje, czy bieżące poświadczenia konta Windows są używane do uwierzytelniania. |

Nie. |

| failoverPartner | Nazwa lub adres serwera partnerskiego do nawiązania połączenia, jeśli serwer podstawowy nie działa. | Nie. |

| maksymalnyRozmiarPuli | Maksymalna liczba połączeń dozwolonych w puli połączeń dla określonego połączenia. | Nie. |

| minPoolSize (Minimalny rozmiar puli) | Minimalna liczba połączeń dozwolonych w puli połączeń dla określonego połączenia. | Nie. |

| multipleActiveResultSets | Dozwolone wartości to true lub false. Po określeniu trueparametru aplikacja może obsługiwać wiele aktywnych zestawów wyników (MARS). Po określeniu falseparametru aplikacja musi przetworzyć lub anulować wszystkie zestawy wyników z jednej partii, zanim będzie mogła wykonać inne partie w tym połączeniu. |

Nie. |

| multiSubnetFailover | Dozwolone wartości to true lub false. Jeśli Twoja aplikacja łączy się z AlwaysOn availability group (AG) znajdującą się w różnych podsieciach, ustawienie tej właściwości na true pozwala na szybsze wykrywanie i nawiązywanie połączenia z aktualnie aktywnym serwerem. |

Nie. |

| rozmiar pakietu | Rozmiar pakietów sieciowych w bajtach używanych do komunikacji z instancją serwera. | Nie. |

| Buforowanie | Dozwolone wartości to true lub false. Po określeniu parametru true, połączenie zostanie włączone do puli. Po określeniu falseparametru połączenie zostanie jawnie otwarte przy każdym żądaniu połączenia. |

Nie. |

Uwierzytelnianie SQL

Aby użyć uwierzytelniania SQL, oprócz właściwości ogólnych opisanych w poprzedniej sekcji, określ następujące właściwości:

| Właściwości | Opis | Wymagane |

|---|---|---|

| userName | Nazwa użytkownika używana do nawiązywania połączenia z serwerem. | Tak |

| hasło | Hasło dla nazwy użytkownika. Oznacz to pole jako SecureString , aby bezpiecznie je przechowywać. Możesz też odwołać się do tajemnicy przechowywanej w Azure Key Vault. | Tak |

Przykład: używanie uwierzytelniania SQL

{

"name": "AzureSqlDbLinkedService",

"properties": {

"type": "AzureSqlDatabase",

"typeProperties": {

"server": "<name or network address of the SQL server instance>",

"database": "<database name>",

"encrypt": "<encrypt>",

"trustServerCertificate": false,

"authenticationType": "SQL",

"userName": "<user name>",

"password": {

"type": "SecureString",

"value": "<password>"

}

},

"connectVia": {

"referenceName": "<name of Integration Runtime>",

"type": "IntegrationRuntimeReference"

}

}

}

Example: hasło w Azure Key Vault

{

"name": "AzureSqlDbLinkedService",

"properties": {

"type": "AzureSqlDatabase",

"typeProperties": {

"server": "<name or network address of the SQL server instance>",

"database": "<database name>",

"encrypt": "<encrypt>",

"trustServerCertificate": false,

"authenticationType": "SQL",

"userName": "<user name>",

"password": {

"type": "AzureKeyVaultSecret",

"store": {

"referenceName": "<Azure Key Vault linked service name>",

"type": "LinkedServiceReference"

},

"secretName": "<secretName>"

}

},

"connectVia": {

"referenceName": "<name of Integration Runtime>",

"type": "IntegrationRuntimeReference"

}

}

}

Przykład: Używanie funkcji Always Encrypted

{

"name": "AzureSqlDbLinkedService",

"properties": {

"type": "AzureSqlDatabase",

"typeProperties": {

"server": "<name or network address of the SQL server instance>",

"database": "<database name>",

"encrypt": "<encrypt>",

"trustServerCertificate": false,

"authenticationType": "SQL",

"userName": "<user name>",

"password": {

"type": "SecureString",

"value": "<password>"

},

"alwaysEncryptedSettings": {

"alwaysEncryptedAkvAuthType": "ServicePrincipal",

"servicePrincipalId": "<service principal id>",

"servicePrincipalKey": {

"type": "SecureString",

"value": "<service principal key>"

}

}

},

"connectVia": {

"referenceName": "<name of Integration Runtime>",

"type": "IntegrationRuntimeReference"

}

}

}

Uwierzytelnianie głównego elementu usługi

Aby użyć uwierzytelniania podmiotu usługi, oprócz właściwości ogólnych opisanych w poprzedniej sekcji, określ następujące właściwości:

| Właściwości | Opis | Wymagane |

|---|---|---|

| IdentyfikatorPodmiotuUsługowego | Określ identyfikator klienta aplikacji. | Tak |

| servicePrincipalCredential | Poświadczenie jednostki usługi. Określ klucz aplikacji. Oznacz to pole jako SecureString do bezpiecznego przechowywania lub aby odwołać się do tajnego wpisu przechowywanego w Azure Key Vault. | Tak |

| dzierżawa | Określ informacje o dzierżawie, takie jak nazwa domeny lub identyfikator dzierżawy, w którym znajduje się aplikacja. Pobierz go, umieszczając wskaźnik myszy w prawym górnym rogu portalu Azure. | Tak |

| azureCloudType | W przypadku uwierzytelniania za pomocą jednostki usługi określ typ środowiska chmury Azure, w którym zarejestrowano aplikację Microsoft Entra. Dozwolone wartości to AzurePublic, AzureChina, AzureUsGovernment i AzureGermany. Domyślnie używane jest środowisko chmury obliczeniowej fabryki danych lub potoku Synapse. |

Nie. |

Należy również wykonać poniższe kroki:

Tworzenie aplikacji Microsoft Entra z portalu Azure. Zanotuj nazwę aplikacji i następujące wartości, które definiują połączoną usługę:

- Identyfikator aplikacji

- Klucz aplikacji

- Identyfikator dzierżawy

Przygotuj administratora Microsoft Entra dla swojego serwera w portalu Azure, jeśli jeszcze tego nie zrobiłeś. Administrator Microsoft Entra musi być użytkownikiem Microsoft Entra lub grupą Microsoft Entra, ale nie może być jednostką usługi. Ten krok jest wykonywany po to, aby w następnym kroku można było użyć tożsamości Microsoft Entra do utworzenia użytkownika zawartej bazy danych dla głównego użytkownika usługi.

Utwórz użytkowników kontenerowej bazy danych dla podmiotu usługi. Nawiąż połączenie z bazą danych, do lub z której chcesz skopiować dane, używając takich narzędzi jak SQL Server Management Studio, z tożsamością Microsoft Entra posiadającą co najmniej uprawnienie ALTER ANY USER. Uruchom następujący kod T-SQL:

CREATE USER [your application name] FROM EXTERNAL PROVIDER;Przyznaj głównej jednostce usługi wymagane uprawnienia, tak jak zwykle robisz to w przypadku użytkowników SQL lub innych użytkowników. Uruchom następujący kod. Aby uzyskać więcej opcji, zobacz ten dokument.

ALTER ROLE [role name] ADD MEMBER [your application name];Skonfiguruj połączoną usługę Azure SQL Database w obszarze roboczym Azure Data Factory lub Synapse.

Przykład połączonej usługi korzystającej z uwierzytelniania jednostki usługi

{

"name": "AzureSqlDbLinkedService",

"properties": {

"type": "AzureSqlDatabase",

"typeProperties": {

"server": "<name or network address of the SQL server instance>",

"database": "<database name>",

"encrypt": "<encrypt>",

"trustServerCertificate": false,

"hostNameInCertificate": "<host name>",

"authenticationType": "ServicePrincipal",

"servicePrincipalId": "<service principal id>",

"servicePrincipalCredential": {

"type": "SecureString",

"value": "<application key>"

},

"tenant": "<tenant info, e.g. microsoft.onmicrosoft.com>"

},

"connectVia": {

"referenceName": "<name of Integration Runtime>",

"type": "IntegrationRuntimeReference"

}

}

}

Uwierzytelnianie zarządzanej tożsamości przypisanej przez system

Obszar roboczy fabryki danych lub usługi Synapse może być skojarzony z tożsamością zarządzaną przypisaną przez system dla zasobów Azure która reprezentuje usługę podczas uwierzytelniania w innych zasobach w Azure. Tej tożsamości zarządzanej można użyć do uwierzytelniania Azure SQL Database. Wyznaczona fabryka lub obszar roboczy usługi Synapse mogą uzyskiwać dostęp do danych z lub do Twojej bazy danych oraz kopiować je przy użyciu tej tożsamości.

Aby użyć uwierzytelniania za pomocą tożsamości zarządzanej przez system, określ właściwości ogólne opisane w poprzedniej sekcji i wykonaj następujące kroki.

Przygotuj administratora Microsoft Entra dla swojego serwera w portalu Azure, jeśli jeszcze tego nie zrobiłeś. Administrator Microsoft Entra może być użytkownikiem Microsoft Entra lub grupą Microsoft Entra. Jeśli przyznasz grupie rolę administratora tożsamości zarządzanej, pomiń kroki 3 i 4. Administrator ma pełny dostęp do bazy danych.

Utwórz użytkowników bazy danych w trybie ograniczonym dla tożsamości zarządzanej. Nawiąż połączenie z bazą danych, do lub z której chcesz skopiować dane, używając takich narzędzi jak SQL Server Management Studio, z tożsamością Microsoft Entra posiadającą co najmniej uprawnienie ALTER ANY USER. Uruchom następujący kod T-SQL:

CREATE USER [your_resource_name] FROM EXTERNAL PROVIDER;Udziel tożsamości zarządzanej wymaganych uprawnień, jak to zazwyczaj robi się dla użytkowników SQL i innych. Uruchom następujący kod. Aby uzyskać więcej opcji, zobacz ten dokument.

ALTER ROLE [role name] ADD MEMBER [your_resource_name];Skonfiguruj połączoną usługę Azure SQL Database.

Przykład

{

"name": "AzureSqlDbLinkedService",

"properties": {

"type": "AzureSqlDatabase",

"typeProperties": {

"server": "<name or network address of the SQL server instance>",

"database": "<database name>",

"encrypt": "<encrypt>",

"trustServerCertificate": false,

"authenticationType": "SystemAssignedManagedIdentity"

},

"connectVia": {

"referenceName": "<name of Integration Runtime>",

"type": "IntegrationRuntimeReference"

}

}

}

Uwierzytelnianie przypisanej przez użytkownika tożsamości zarządzanej

Obszar roboczy fabryki danych lub usługi Synapse może być skojarzony z tożsamością zarządzaną przypisaną przez użytkownika, która reprezentuje usługę podczas uwierzytelniania do innych zasobów w Azure. Tej tożsamości zarządzanej można użyć do uwierzytelniania Azure SQL Database. Wyznaczona fabryka lub obszar roboczy usługi Synapse mogą uzyskiwać dostęp do danych z lub do Twojej bazy danych oraz kopiować je przy użyciu tej tożsamości.

Aby użyć uwierzytelniania przy użyciu zarządzanej tożsamości przypisanej przez użytkownika, oprócz opisanych w poprzedniej sekcji właściwości ogólnych, określ następujące właściwości:

| Właściwości | Opis | Wymagane |

|---|---|---|

| dane logowania | Określ tożsamość zarządzaną przypisaną przez użytkownika jako obiekt poświadczeń. | Tak |

Należy również wykonać poniższe kroki:

Przygotuj administratora Microsoft Entra dla swojego serwera w portalu Azure, jeśli jeszcze tego nie zrobiłeś. Administrator Microsoft Entra może być użytkownikiem Microsoft Entra lub grupą Microsoft Entra. Jeśli przyznasz grupie rolę administratora dla tożsamości zarządzanej przypisanej przez użytkownika, pomiń ten krok 3. Administrator ma pełny dostęp do bazy danych.

Utwórz użytkowników bazy danych w trybie izolowanym dla zarządzanej tożsamości przypisanej użytkownikowi. Nawiąż połączenie z bazą danych, do lub z której chcesz skopiować dane, używając takich narzędzi jak SQL Server Management Studio, z tożsamością Microsoft Entra posiadającą co najmniej uprawnienie ALTER ANY USER. Uruchom następujący kod T-SQL:

CREATE USER [your_resource_name] FROM EXTERNAL PROVIDER;Utwórz jedną lub wiele tożsamości zarządzanych przypisanych przez użytkownika i przyznaj tożsamości zarządzanej przypisanej przez użytkownika wymagane uprawnienia, tak jak zwykle dla użytkowników SQL i innych. Uruchom następujący kod. Aby uzyskać więcej opcji, zobacz ten dokument.

ALTER ROLE [role name] ADD MEMBER [your_resource_name];Przypisz jedną lub wiele tożsamości zarządzanych przez użytkownika do fabryki danych i utwórz poświadczenia dla każdej z tych tożsamości.

Skonfiguruj połączoną usługę Azure SQL Database.

Przykład

{

"name": "AzureSqlDbLinkedService",

"properties": {

"type": "AzureSqlDatabase",

"typeProperties": {

"server": "<name or network address of the SQL server instance>",

"database": "<database name>",

"encrypt": "<encrypt>",

"trustServerCertificate": false,

"authenticationType": "UserAssignedManagedIdentity",

"credential": {

"referenceName": "credential1",

"type": "CredentialReference"

}

},

"connectVia": {

"referenceName": "<name of Integration Runtime>",

"type": "IntegrationRuntimeReference"

}

}

}

Starsza wersja

Ogólne właściwości są obsługiwane dla usługi powiązanej Azure SQL Database przy stosowaniu wersji Legacy.

| Właściwości | Opis | Wymagane |

|---|---|---|

| typ | Właściwość type musi być ustawiona na AzureSqlDatabase. | Tak |

| Parametry połączenia | Określ informacje potrzebne do nawiązania połączenia z wystąpieniem Azure SQL Database dla właściwości connectionString. Możesz również umieścić hasło lub klucz główny usługi w Azure Key Vault. Jeśli jest to uwierzytelnianie SQL, pobierz konfigurację password z łańcucha połączenia. Aby uzyskać więcej informacji, zobacz Przechowywanie poświadczeń w Azure Key Vault. |

Tak |

| alwaysEncryptedSettings | Określ informacje, które są potrzebne do włączenia funkcji Always Encrypted, w celu ochrony poufnych danych przechowywanych na serwerze SQL przy użyciu tożsamości zarządzanej lub poświadczenia usługi. Aby uzyskać więcej informacji, zobacz sekcję Using Always Encrypted (Używanie funkcji Always Encrypted ). Jeśli nie zostanie określone, domyślnie ustawienie "zawsze szyfrowane" jest wyłączone. | Nie. |

| connectVia | To środowisko uruchomieniowe integracji służy do połączenia z magazynem danych. Jeśli magazyn danych znajduje się w sieci prywatnej, możesz użyć środowiska Integration Runtime Azure lub własnego środowiska Integration Runtime. Jeśli nie jest określone, używane jest domyślne Azure Integration Runtime. | Nie. |

W przypadku różnych typów uwierzytelniania zapoznaj się z następującymi sekcjami dotyczącymi odpowiednio określonych właściwości i wymagań wstępnych:

- Uwierzytelnianie SQL dla starszej wersji

- Uwierzytelnianie głównej jednostki usługi dla starszej wersji

- Uwierzytelnianie zarządzanej tożsamości przypisanej systemowo dla starszej wersji

- Uwierzytelnianie tożsamości zarządzanej przez użytkownika dla wersji starszej

Uwierzytelnianie SQL dla starszej wersji

Aby użyć uwierzytelniania SQL, określ właściwości ogólne opisane w poprzedniej sekcji.

Uwierzytelnianie podmiotu usługi dla starszej wersji

Aby użyć uwierzytelniania podmiotu usługi, oprócz właściwości ogólnych opisanych w poprzedniej sekcji, określ następujące właściwości:

| Właściwości | Opis | Wymagane |

|---|---|---|

| IdentyfikatorPodmiotuUsługowego | Określ identyfikator klienta aplikacji. | Tak |

| servicePrincipalKey | Określ klucz aplikacji. Oznacz to pole jako SecureString, aby przechowywać je bezpiecznie, lub odwołaj się do tajemnicy przechowywanej w Azure Key Vault. | Tak |

| dzierżawa | Określ informacje o dzierżawie, takie jak nazwa domeny lub identyfikator dzierżawy, w którym znajduje się aplikacja. Pobierz go, umieszczając wskaźnik myszy w prawym górnym rogu portalu Azure. | Tak |

| azureCloudType | W przypadku uwierzytelniania za pomocą jednostki usługi określ typ środowiska chmury Azure, w którym zarejestrowano aplikację Microsoft Entra. Dozwolone wartości to AzurePublic, AzureChina, AzureUsGovernment i AzureGermany. Domyślnie używane jest środowisko chmury obliczeniowej fabryki danych lub potoku Synapse. |

Nie. |

Należy również wykonać kroki opisane w temacie Uwierzytelnianie jednostki usługi, aby udzielić odpowiedniego uprawnienia.

Uwierzytelnianie zarządzanej tożsamości przypisanej przez system dla wersji starszej

Aby użyć uwierzytelniania tożsamości zarządzanej przypisanej przez system, wykonaj ten sam krok, który zaleca się w sekcji Uwierzytelnianie tożsamości zarządzanej przypisanej przez system.

Uwierzytelnianie zarządzanej tożsamości przez użytkownika dla starszej wersji

Aby użyć uwierzytelniania tożsamości zarządzanej przypisanej przez użytkownika, wykonaj ten sam krok co dla zalecanej wersji w sekcji Uwierzytelnianie tożsamości zarządzanej przypisanej przez użytkownika.

Właściwości zestawu danych

Aby uzyskać pełną listę sekcji i właściwości dostępnych do definiowania zestawów danych, zobacz Zestawy danych.

Następujące właściwości są obsługiwane w przypadku zestawu danych Azure SQL Database:

| Właściwości | Opis | Wymagane |

|---|---|---|

| typ | Właściwość type zestawu danych musi być ustawiona na AzureSqlTable. | Tak |

| schemat | Nazwa schematu. | Nie dla źródła, Tak dla ujścia |

| tabela | Nazwa tabeli/widoku. | Nie dla źródła, Tak dla ujścia |

| tableName | Nazwa tabeli/widoku z schematem bazy danych. Ta właściwość jest obsługiwana w celu zapewnienia kompatybilności z poprzednimi wersjami. W przypadku nowego obciążenia roboczego użyj elementów schema i table. |

Nie dla źródła, Tak dla ujścia |

Przykład właściwości zestawu danych

{

"name": "AzureSQLDbDataset",

"properties":

{

"type": "AzureSqlTable",

"linkedServiceName": {

"referenceName": "<Azure SQL Database linked service name>",

"type": "LinkedServiceReference"

},

"schema": [ < physical schema, optional, retrievable during authoring > ],

"typeProperties": {

"schema": "<schema_name>",

"table": "<table_name>"

}

}

}

Właściwości aktywności kopiowania

Aby uzyskać pełną listę sekcji i właściwości dostępnych do definiowania działań, zobacz Pipelines. Ta sekcja zawiera listę właściwości obsługiwanych przez źródło i ujście Azure SQL Database.

Azure SQL Database jako źródło

Wskazówka

Aby wydajnie ładować dane z Azure SQL Database za pomocą partycjonowania danych, dowiedz się więcej z Równoległe kopiowanie z bazy danych SQL.

Aby skopiować dane z Azure SQL Database, w działaniu kopiowania obsługiwane są następujące atrybuty w sekcji source:

| Właściwości | Opis | Wymagane |

|---|---|---|

| typ | Właściwość type źródła działania kopiowania musi być ustawiona na AzureSqlSource. Typ "SqlSource" jest nadal obsługiwany w celu zapewnienia zgodności z poprzednimi wersjami. | Tak |

| sqlReaderQuery | Ta właściwość używa niestandardowego zapytania SQL do odczytywania danych. Może to być na przykład select * from MyTable. |

Nie. |

| sqlReaderStoredProcedureName | Nazwa procedury składowanej, która odczytuje dane z tabeli źródłowej. Ostatnia instrukcja SQL musi być instrukcją SELECT w procedurze składowanej. | Nie. |

| parametryProcedurySkładowanej | Parametry procedury składowanej. Dozwolone wartości to pary nazw lub wartości. Nazwy i wielkość liter parametrów muszą być zgodne z nazwami i wielkością liter parametrów procedury składowanej. |

Nie. |

| poziom izolacji | Określa zachowanie blokowania transakcji dla źródła SQL. Dozwolone wartości to: ReadCommitted, ReadUncommitted, RepeatableRead, Serializable, Snapshot. Jeśli nie zostanie określony, zostanie użyty domyślny poziom izolacji bazy danych. Aby uzyskać więcej informacji, zapoznaj się z tym dokumentem . | Nie. |

| opcjePodziału | Określa opcje partycjonowania danych używane do ładowania danych z Azure SQL Database. Dozwolone wartości to: Brak (wartość domyślna), PhysicalPartitionsOfTable i DynamicRange. Po włączeniu opcji partycji (czyli nie None), stopień równoległości równoczesnego ładowania danych z Azure SQL Database jest kontrolowany przez ustawienie parallelCopies w działaniu kopiowania. |

Nie. |

| ustawienia partycji | Określ grupę ustawień partycjonowania danych. Zastosuj, gdy opcja partycji nie jest None. |

Nie. |

W obszarze partitionSettings: |

||

| partitionColumnName | Określ nazwę kolumny źródłowej o typie liczby całkowitej lub daty/czasu (int, smallint, bigint, date, smalldatetime, datetime, datetime2, lub datetimeoffset), która będzie używana do partycjonowania zakresu dla kopiowania równoległego. Jeśli nie zostanie określony, indeks lub klucz podstawowy tabeli jest automatycznie wykrywany i używany jako kolumna partycji.Zastosuj, gdy opcja partycji to DynamicRange. Jeśli używasz zapytania do pobierania danych źródłowych, ustaw ?DfDynamicRangePartitionCondition w klauzuli WHERE. Aby zapoznać się z przykładem, zobacz sekcję Kopiowanie równoległe z bazy danych SQL. |

Nie. |

| partitionUpperBound | Maksymalna wartość kolumny partycji dla podziału zakresu partycji. Ta wartość służy do decydowania o kroku partycji, a nie do filtrowania wierszy w tabeli. Wszystkie wiersze w tabeli lub wyniku zapytania zostaną częściowo podzielone i skopiowane. Jeśli wartość nie zostanie określona, działanie kopiowania automatycznie ją wykryje. Zastosuj, gdy opcja partycji to DynamicRange. Aby zapoznać się z przykładem, zobacz sekcję Kopiowanie równoległe z bazy danych SQL. |

Nie. |

| dolna granica partycji | Minimalna wartość kolumny partycji dla podziału zakresu partycji. Ta wartość służy do decydowania o kroku partycji, a nie do filtrowania wierszy w tabeli. Wszystkie wiersze w tabeli lub wyniku zapytania zostaną częściowo podzielone i skopiowane. Jeśli wartość nie zostanie określona, działanie kopiowania automatycznie ją wykryje. Zastosuj, gdy opcja partycji to DynamicRange. Aby zapoznać się z przykładem, zobacz sekcję Kopiowanie równoległe z bazy danych SQL. |

Nie. |

Pamiętaj o następujących kwestiach:

- Jeśli sqlReaderQuery jest określony dla AzureSqlSource działanie kopiowania uruchamia to zapytanie względem źródła Azure SQL Database w celu pobrania danych. Można również określić procedurę składowaną, podając sqlReaderStoredProcedureName i storedProcedureParameters, jeśli procedura składowana przyjmuje parametry.

- W przypadku używania procedury składowanej w źródle do pobierania danych należy pamiętać, że procedura składowana jest zaprojektowana jako zwracanie innego schematu po przekazaniu innej wartości parametru, może wystąpić błąd lub nieoczekiwany wynik podczas importowania schematu z interfejsu użytkownika lub kopiowania danych do bazy danych SQL z automatycznym tworzeniem tabeli.

Przykład zapytania SQL

"activities":[

{

"name": "CopyFromAzureSQLDatabase",

"type": "Copy",

"inputs": [

{

"referenceName": "<Azure SQL Database input dataset name>",

"type": "DatasetReference"

}

],

"outputs": [

{

"referenceName": "<output dataset name>",

"type": "DatasetReference"

}

],

"typeProperties": {

"source": {

"type": "AzureSqlSource",

"sqlReaderQuery": "SELECT * FROM MyTable"

},

"sink": {

"type": "<sink type>"

}

}

}

]

Przykład procedury przechowywanej

"activities":[

{

"name": "CopyFromAzureSQLDatabase",

"type": "Copy",

"inputs": [

{

"referenceName": "<Azure SQL Database input dataset name>",

"type": "DatasetReference"

}

],

"outputs": [

{

"referenceName": "<output dataset name>",

"type": "DatasetReference"

}

],

"typeProperties": {

"source": {

"type": "AzureSqlSource",

"sqlReaderStoredProcedureName": "CopyTestSrcStoredProcedureWithParameters",

"storedProcedureParameters": {

"stringData": { "value": "str3" },

"identifier": { "value": "$$Text.Format('{0:yyyy}', <datetime parameter>)", "type": "Int"}

}

},

"sink": {

"type": "<sink type>"

}

}

}

]

Definicja procedury składowanej

CREATE PROCEDURE CopyTestSrcStoredProcedureWithParameters

(

@stringData varchar(20),

@identifier int

)

AS

SET NOCOUNT ON;

BEGIN

select *

from dbo.UnitTestSrcTable

where dbo.UnitTestSrcTable.stringData != stringData

and dbo.UnitTestSrcTable.identifier != identifier

END

GO

Azure SQL Database jako odbiornik

Wskazówka

Dowiedz się więcej o obsługiwanych zachowaniach zapisu, konfiguracjach i najlepszych praktykach z Najlepsze praktyki wczytywania danych do Azure SQL Database.

Aby skopiować dane do Azure SQL Database, następujące właściwości są obsługiwane w sekcji sink:

| Właściwości | Opis | Wymagane |

|---|---|---|

| typ | Właściwość type ujścia działania kopiowania musi być ustawiona na AzureSqlSink. Typ "SqlSink" jest nadal obsługiwany w celu zapewnienia wstecznej zgodności. | Tak |

| preCopyScript | Określ zapytanie SQL dla działania kopiowania, które ma zostać uruchomione przed zapisaniem danych w Azure SQL Database. Jest wywoływany tylko raz na przebieg kopiowania. Użyj tej właściwości, aby wyczyścić wstępnie załadowane dane. | Nie. |

| opcjaTabeli | Określa, czy automatycznie utworzyć tabelę ujścia, jeśli nie istnieje na podstawie schematu źródłowego. Automatyczne tworzenie tabeli nie jest obsługiwane, gdy ujście określa procedurę składowaną. Dozwolone wartości to: none (wartość domyślna), autoCreate. |

Nie. |

| sqlWriterStoredProcedureName (nazwa procedury składowanej sqlWriter) | Nazwa procedury składowanej, która definiuje sposób stosowania danych źródłowych do tabeli docelowej. Ta procedura składowana jest wywoływana na partię. W przypadku operacji uruchamianych tylko raz, które nie mają nic wspólnego z danymi źródłowymi, na przykład usuń lub skróć, użyj właściwości preCopyScript.Zobacz przykład z wywołania procedury składowanej z ujścia SQL. |

Nie. |

| nazwaParametruTypuTabeliProcedurySkładowanej | Nazwa parametru typu tabeli określona w procedurze składowanej. | Nie. |

| sqlWriterTableType | Nazwa typu tabeli, która ma być używana w procedurze składowanej. Działanie kopiowania danych sprawia, że dane są dostępne w tabeli tymczasowej o tym typie tabeli. Kod procedury składowanej może następnie scalić dane kopiowane z istniejącymi danymi. | Nie. |

| parametryProcedurySkładowanej | Parametry procedury składowanej. Dozwolone wartości to pary nazw i wartości. Nazwy parametrów i wielkość liter w ich nazwach muszą być zgodne z nazwami i wielkością liter parametrów procedury składowanej. |

Nie. |

| writeBatchSize | Liczba wierszy do wstawienia do tabeli SQL na partię. Dozwolona wartość to liczba całkowita (liczba wierszy). Domyślnie usługa dynamicznie określa odpowiedni rozmiar partii na podstawie rozmiaru wiersza. |

Nie. |

| writeBatchTimeout | Czas oczekiwania na ukończenie operacji wstawiania, operacji upsert i procedury składowanej przed przekroczeniem limitu czasu. Dozwolone wartości są dla przedziału czasu. Przykładem jest "00:30:00" przez 30 minut. Jeśli żadna wartość nie zostanie określona, limit czasu zostanie domyślnie określony na "00:30:00". |

Nie. |

| wyłączZbieranieMetryk | Usługa zbiera metryki, takie jak jednostki DTU Azure SQL Database na potrzeby optymalizacji wydajności kopiowania i rekomendacji, co skutkuje dodatkowym dostępem do głównej bazy danych. Jeśli interesuje Cię to zachowanie, określ true , aby go wyłączyć. |

Nie (wartość domyślna to false) |

| maksymalnaLiczbaJednoczesnychPołączeń | Górny limit połączeń współbieżnych nawiązanych z magazynem danych podczas przebiegu działania. Określ wartość tylko wtedy, gdy chcesz ograniczyć połączenia współbieżne. | Nie. |

| WriteBehavior | Określ zachowanie zapisu dla działania kopiowania w celu załadowania danych do Azure SQL Database. Dozwolona wartość to Insert i Upsert. Domyślnie usługa używa wstawiania do ładowania danych. |

Nie. |

| upsertSettings | Określ grupę ustawień zachowania zapisu. Zastosuj, gdy opcja WriteBehavior ma wartość Upsert. |

Nie. |

W obszarze upsertSettings: |

||

| useTempDB | Określ, czy chcesz użyć globalnej tabeli tymczasowej, czy tabeli fizycznej jako tabeli tymczasowej dla operacji upsert. Domyślnie usługa używa globalnej tabeli tymczasowej jako tabeli przejściowej. wartość to true. |

Nie. |

| interimSchemaName | Określ schemat tymczasowy do tworzenia tabeli tymczasowej, jeśli jest używana tabela fizyczna. Uwaga: użytkownik musi mieć uprawnienia do tworzenia i usuwania tabeli. Domyślnie tabela tymczasowa będzie współdzielić ten sam schemat co tabela ujścia. Zastosuj, gdy opcja useTempDB to False. |

Nie. |

| klucze | Określ nazwy kolumn dla unikalnej identyfikacji wierszy. Można użyć pojedynczego klucza lub serii kluczy. Jeśli nie zostanie określony, używany jest klucz podstawowy. | Nie. |

Przykład 1. Dołączanie danych

"activities":[

{

"name": "CopyToAzureSQLDatabase",

"type": "Copy",

"inputs": [

{

"referenceName": "<input dataset name>",

"type": "DatasetReference"

}

],

"outputs": [

{

"referenceName": "<Azure SQL Database output dataset name>",

"type": "DatasetReference"

}

],

"typeProperties": {

"source": {

"type": "<source type>"

},

"sink": {

"type": "AzureSqlSink",

"tableOption": "autoCreate",

"writeBatchSize": 100000

}

}

}

]

Przykład 2: Wywoływanie procedury składowanej podczas kopiowania

Dowiedz się więcej na stronie Wywoływanie procedury składowanej z ujścia SQL.

"activities":[

{

"name": "CopyToAzureSQLDatabase",

"type": "Copy",

"inputs": [

{

"referenceName": "<input dataset name>",

"type": "DatasetReference"

}

],

"outputs": [

{

"referenceName": "<Azure SQL Database output dataset name>",

"type": "DatasetReference"

}

],

"typeProperties": {

"source": {

"type": "<source type>"

},

"sink": {

"type": "AzureSqlSink",

"sqlWriterStoredProcedureName": "CopyTestStoredProcedureWithParameters",

"storedProcedureTableTypeParameterName": "MyTable",

"sqlWriterTableType": "MyTableType",

"storedProcedureParameters": {

"identifier": { "value": "1", "type": "Int" },

"stringData": { "value": "str1" }

}

}

}

}

]

Przykład 3: Wstawianie lub aktualizowanie danych

"activities":[

{

"name": "CopyToAzureSQLDatabase",

"type": "Copy",

"inputs": [

{

"referenceName": "<input dataset name>",

"type": "DatasetReference"

}

],

"outputs": [

{

"referenceName": "<Azure SQL Database output dataset name>",

"type": "DatasetReference"

}

],

"typeProperties": {

"source": {

"type": "<source type>"

},

"sink": {

"type": "AzureSqlSink",

"tableOption": "autoCreate",

"writeBehavior": "upsert",

"upsertSettings": {

"useTempDB": true,

"keys": [

"<column name>"

]

},

}

}

}

]

Równoległa kopia z bazy danych SQL

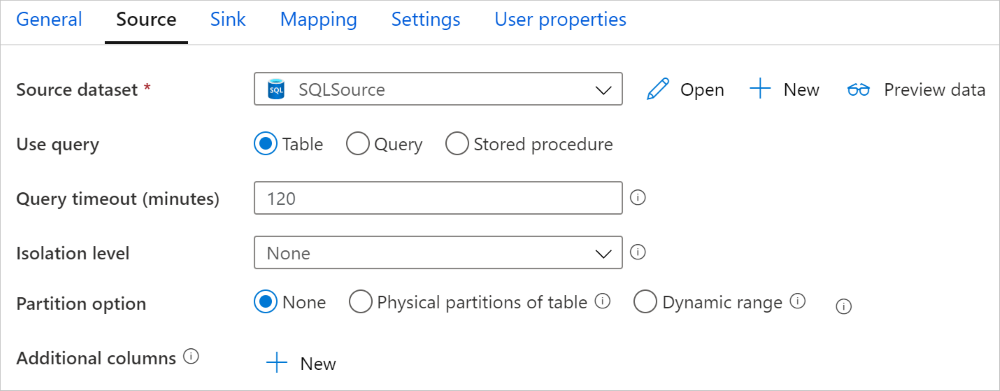

Łącznik Azure SQL Database w działaniu kopiowania zapewnia wbudowane partycjonowanie danych w celu równoległego kopiowania danych. Opcje partycjonowania danych można znaleźć na karcie Źródło działania kopiowania.

Po włączeniu kopii partycjonowanej działanie kopiowania uruchamia zapytania równoległe względem źródła Azure SQL Database w celu załadowania danych według partycji. Stopień przetwarzania równoległego jest kontrolowany przez ustawienie w ramach działania kopiowania parallelCopies. Jeśli na przykład ustawisz parallelCopies na cztery, usługa jednocześnie generuje i uruchamia cztery zapytania na podstawie określonej opcji partycji i ustawień, a każde zapytanie pobiera część danych z Azure SQL Database.

Zaleca się włączenie kopiowania równoległego przy użyciu partycjonowania danych, szczególnie w przypadku ładowania dużej ilości danych z Azure SQL Database. Poniżej przedstawiono sugerowane konfiguracje dla różnych scenariuszy. Podczas kopiowania danych do magazynu danych opartego na plikach zaleca się zapisywanie w folderze jako wielu plików (tylko określ nazwę folderu), w tym przypadku wydajność jest lepsza niż zapisywanie w jednym pliku.

| Scenariusz | Sugerowane ustawienia |

|---|---|

| Pełne ładowanie z dużej tabeli z fizycznymi partycjami. |

Opcja partycji: Fizyczne podziały tabeli. Podczas wykonywania usługa automatycznie wykrywa partycje fizyczne i kopiuje dane według partycji. Aby sprawdzić, czy tabela ma partycję fizyczną, czy nie, możesz odwołać się do tego zapytania. |

| Pełne ładowanie z dużej tabeli, bez partycji fizycznych, z zastosowaniem kolumny liczbowej całkowitej lub datetime do partycjonowania danych. |

Opcje partycji: dynamiczne partycjonowanie zakresu. Kolumna partycji (opcjonalnie): określ kolumnę używaną do partycjonowania danych. Jeśli nie określono, zostanie użyta kolumna indeksu lub kolumna klucza podstawowego. Górna granica partycji i dolna granica partycji (opcjonalnie): Określ, czy chcesz ustalić krok partycji. Nie dotyczy to filtrowania wierszy w tabeli. Wszystkie wiersze w tabeli zostaną podzielone na partycje i skopiowane. Jeśli nie zostaną określone, działanie kopiowania automatycznie wykryje wartości. Jeśli na przykład kolumna partycji "ID" zawiera wartości z zakresu od 1 do 100, a dolna granica zostanie ustawiona na wartość 20, a górna granica to 80, z kopią równoległą jako 4, usługa pobiera dane według 4 partycji — identyfikatory w zakresie <=20, [21, 50], [51, 80] i >=81. |

| Załaduj dużą ilość danych przy użyciu zapytania niestandardowego, bez partycji fizycznych, natomiast z liczbą całkowitą lub kolumną date/datetime na potrzeby partycjonowania danych. |

Opcje partycji: dynamiczne partycjonowanie zakresu. Zapytanie: SELECT * FROM <TableName> WHERE ?DfDynamicRangePartitionCondition AND <your_additional_where_clause>.Kolumna partycji: określ kolumnę używaną do partycjonowania danych. Górna granica partycji i dolna granica partycji (opcjonalnie): Określ, czy chcesz ustalić krok partycji. Nie jest to przeznaczone do filtrowania wierszy w tabeli, wszystkie wiersze w wyniku zapytania zostaną partycjonowane i skopiowane. Jeśli wartość nie zostanie określona, działanie kopiowania automatycznie ją wykryje. Jeśli na przykład kolumna partycji "ID" zawiera wartości z zakresu od 1 do 100, a dolna granica zostanie ustawiona jako 20 i górna granica jako 80, z kopią równoległą jako 4, usługa pobiera dane według 4 partycji — identyfikatory w zakresie <=20, [21, 50], [51, 80] i >=81. Poniżej przedstawiono więcej przykładowych zapytań dla różnych scenariuszy: 1. Wykonaj zapytanie względem całej tabeli: SELECT * FROM <TableName> WHERE ?DfDynamicRangePartitionCondition2. Kwerenda z tabeli z zaznaczeniem kolumny i dodatkowymi filtrami klauzuli where: SELECT <column_list> FROM <TableName> WHERE ?DfDynamicRangePartitionCondition AND <your_additional_where_clause>3. Kwerenda z podzapytaniami: SELECT <column_list> FROM (<your_sub_query>) AS T WHERE ?DfDynamicRangePartitionCondition AND <your_additional_where_clause>4. Kwerenda z partycją w zapytaniu podrzędnym: SELECT <column_list> FROM (SELECT <your_sub_query_column_list> FROM <TableName> WHERE ?DfDynamicRangePartitionCondition) AS T |

Najlepsze rozwiązania dotyczące ładowania danych z opcją partycji:

- Wybierz charakterystyczną kolumnę jako kolumnę partycji (np. klucz podstawowy lub unikatowy klucz), aby uniknąć niesymetryczności danych.

- Jeśli tabela ma wbudowaną partycję, użyj opcji partycji "Partycje fizyczne tabeli", aby uzyskać lepszą wydajność.

- Jeśli używasz Azure Integration Runtime do kopiowania danych, możesz ustawić większe "Data Integration Units (DIU)" (>4), aby wykorzystać więcej zasobów obliczeniowych. Sprawdź odpowiednie scenariusze tam.

- "Stopień równoległości kopiowania" określa liczby partycji; ustawienie tej liczby zbyt wysoko może czasami obniżyć wydajność. Zaleca się ustawienie tej liczby jako (DIU lub liczba węzłów IR hostowanych lokalnie) * (od 2 do 4)."

Przykład: pełne ładowanie z dużej tabeli z partycjami fizycznymi

"source": {

"type": "AzureSqlSource",

"partitionOption": "PhysicalPartitionsOfTable"

}

Przykład: zapytanie z dynamicznym podziałem na zakresy

"source": {

"type": "AzureSqlSource",

"query": "SELECT * FROM <TableName> WHERE ?DfDynamicRangePartitionCondition AND <your_additional_where_clause>",

"partitionOption": "DynamicRange",

"partitionSettings": {

"partitionColumnName": "<partition_column_name>",

"partitionUpperBound": "<upper_value_of_partition_column (optional) to decide the partition stride, not as data filter>",

"partitionLowerBound": "<lower_value_of_partition_column (optional) to decide the partition stride, not as data filter>"

}

}

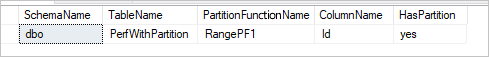

Przykładowe zapytanie do sprawdzania partycji fizycznej

SELECT DISTINCT s.name AS SchemaName, t.name AS TableName, pf.name AS PartitionFunctionName, c.name AS ColumnName, iif(pf.name is null, 'no', 'yes') AS HasPartition

FROM sys.tables AS t

LEFT JOIN sys.objects AS o ON t.object_id = o.object_id

LEFT JOIN sys.schemas AS s ON o.schema_id = s.schema_id

LEFT JOIN sys.indexes AS i ON t.object_id = i.object_id

LEFT JOIN sys.index_columns AS ic ON ic.partition_ordinal > 0 AND ic.index_id = i.index_id AND ic.object_id = t.object_id

LEFT JOIN sys.columns AS c ON c.object_id = ic.object_id AND c.column_id = ic.column_id

LEFT JOIN sys.partition_schemes ps ON i.data_space_id = ps.data_space_id

LEFT JOIN sys.partition_functions pf ON pf.function_id = ps.function_id

WHERE s.name='[your schema]' AND t.name = '[your table name]'

Jeśli tabela ma partycję fizyczną, zostanie wyświetlona wartość "HasPartition" jako "tak", jak pokazano poniżej.

Najlepsze rozwiązanie dotyczące ładowania danych do Azure SQL Database

Podczas kopiowania danych do Azure SQL Database może być wymagane inne zachowanie zapisu:

- Dołącz: Moje dane źródłowe mają tylko nowe rekordy.

- Upsert: Moje dane źródłowe mają zarówno wstawki, jak i aktualizacje.

- Zastąp: Chcę ponownie załadować całą tabelę wymiarów za każdym razem.

- Pisanie za pomocą logiki niestandardowej: potrzebuję dodatkowego przetwarzania przed ostatecznym wstawieniem do tabeli docelowej.

Zapoznaj się z odpowiednimi sekcjami dotyczącymi sposobu konfigurowania w usłudze i najlepszych rozwiązań.

Dołączanie danych

Domyślnym zachowaniem tego złącza ujściowego Azure SQL Database jest dodawanie danych. Usługa wykonuje operację wstawiania zbiorczego, aby efektywnie zapisywać dane w tabeli. Źródło i ujście można skonfigurować odpowiednio w działaniu kopiowania.

Wykonywanie operacji upsert dla danych

Copy activity obsługuje teraz natywne ładowanie danych do tymczasowej tabeli bazy danych i aktualizuje dane w tabeli docelowej, jeśli klucz istnieje, lub wstawia nowe dane w przeciwnym wypadku. Aby dowiedzieć się więcej na temat ustawień upsert w działaniach kopiowania, zobacz Azure SQL Database jako ujście.

Zastąp całą tabelę

Właściwość preCopyScript można skonfigurować w miejscu docelowym operacji kopiowania. W takim przypadku dla każdego uruchomionego działania kopiowania usługa uruchamia skrypt jako pierwszy. Następnie uruchamia kopię, aby wstawić dane. Aby na przykład zastąpić całą tabelę najnowszymi danymi, określ skrypt, aby najpierw usunąć wszystkie rekordy przed zbiorczym załadowaniem nowych danych ze źródła.

Zapisywanie danych przy użyciu logiki niestandardowej

Kroki, które należy podjąć, aby zapisywać dane za pomocą logiki niestandardowej, są podobne do tych opisanych w sekcji Upsert data. Jeśli musisz zastosować dodatkowe przetwarzanie przed ostatecznym wstawieniem danych źródłowych do tabeli docelowej, możesz załadować dane do tabeli przejściowej, a następnie wywołać działanie procedury składowanej, wywołać procedurę składowaną jako ujście działania kopiowania, aby zastosować dane, lub użyć Mapowania przepływu danych (Mapping Data Flow).

Wywoływanie procedury składowanej z ujścia SQL

Podczas kopiowania danych do Azure SQL Database można również skonfigurować i wywołać procedurę składowaną określoną przez użytkownika z dodatkowymi parametrami w każdej partii tabeli źródłowej. Funkcja procedury składowanej korzysta z parametrów tabelarycznych.

Procedurę składowaną można użyć, gdy wbudowane mechanizmy kopiowania nie obsługują tego celu. Przykładem jest zastosowanie dodatkowego przetwarzania przed ostatecznym wstawieniem danych źródłowych do tabeli docelowej. Niektóre dodatkowe przykłady przetwarzania to, gdy chcesz scalić kolumny, wyszukać dodatkowe wartości i wstawić je do więcej niż jednej tabeli.

W poniższym przykładzie pokazano, jak za pomocą procedury składowanej wykonać operację upsert w tabeli w Azure SQL Database. Załóżmy, że dane wejściowe i docelowa tabela Marketing mają trzy kolumny: ProfileID, State i Category. Wykonaj upsert w oparciu o kolumnę ProfileID i zastosuj go tylko do określonej kategorii o nazwie "ProductA".

W bazie danych zdefiniuj typ tabeli o takiej samej nazwie jak sqlWriterTableType. Schemat typu tabeli jest taki sam jak schemat zwracany przez dane wejściowe.

CREATE TYPE [dbo].[MarketingType] AS TABLE( [ProfileID] [varchar](256) NOT NULL, [State] [varchar](256) NOT NULL, [Category] [varchar](256) NOT NULL )W bazie danych zdefiniuj procedurę składowaną o takiej samej nazwie jak sqlWriterStoredProcedureName. Obsługuje dane wejściowe z określonego źródła i scala je z tabelą wyjściową. Nazwa parametru typu tabeli w procedurze składowanej jest taka sama jak nazwa_tabeli zdefiniowana w zestawie danych.

CREATE PROCEDURE spOverwriteMarketing @Marketing [dbo].[MarketingType] READONLY, @category varchar(256) AS BEGIN MERGE [dbo].[Marketing] AS target USING @Marketing AS source ON (target.ProfileID = source.ProfileID and target.Category = @category) WHEN MATCHED THEN UPDATE SET State = source.State WHEN NOT MATCHED THEN INSERT (ProfileID, State, Category) VALUES (source.ProfileID, source.State, source.Category); ENDW potoku danych w Azure Data Factory lub Synapse sekcja SQL dla działania kopiowania jest zdefiniowana w następujący sposób:

"sink": { "type": "AzureSqlSink", "sqlWriterStoredProcedureName": "spOverwriteMarketing", "storedProcedureTableTypeParameterName": "Marketing", "sqlWriterTableType": "MarketingType", "storedProcedureParameters": { "category": { "value": "ProductA" } } }

Podczas zapisywania danych w Azure SQL Database przy użyciu procedury składowanej ujście dzieli dane źródłowe na mini partie, a następnie wykonuje wstawianie, więc dodatkowe zapytanie w procedurze składowanej można wykonać wiele razy. Jeśli masz zapytanie dotyczące aktywności kopiowania, które ma zostać uruchomione przed zapisaniem danych w Azure SQL Database, nie zaleca się dodawania go do procedury składowanej; zamiast tego, dodaj je w polu skryptu Pre-copy.

Właściwości odwzorowania przepływu danych

Podczas przekształcania danych w przepływie danych do mapowania można odczytywać i zapisywać dane w tabelach z Azure SQL Database. Aby uzyskać więcej informacji, zobacz przekształcanie źródła i przekształcanie ujścia w przepływach danych mapowania.

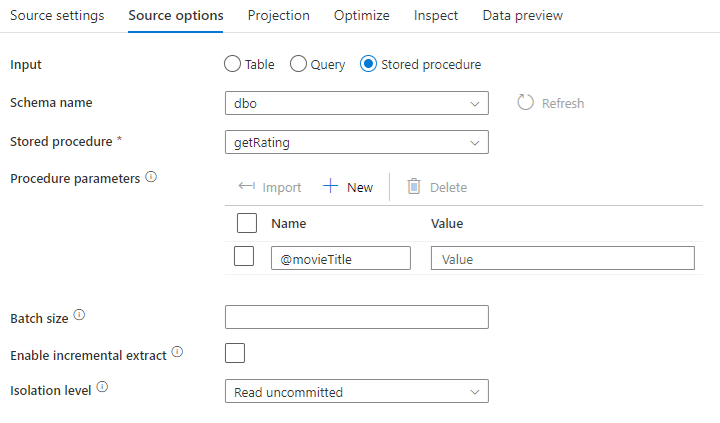

Przekształcanie źródła

Ustawienia specyficzne dla Azure SQL Database są dostępne na karcie Source Options przekształcenia źródłowego.

Dane wejściowe: wybierz, czy wskazujesz źródło w tabeli (odpowiednik Select * from <table-name>) lub wprowadź niestandardowe zapytanie SQL.

Zapytanie: w przypadku wybrania pozycji Zapytanie w polu wejściowym wprowadź zapytanie SQL dla źródła. To ustawienie zastępuje dowolną tabelę wybraną w zestawie danych. Klauzule Order By nie są obsługiwane w tym miejscu, ale można ustawić pełną instrukcję SELECT FROM. Można również użyć funkcji tabeli zdefiniowanych przez użytkownika. select * from udfGetData() to UDF w SQL, która zwraca tabelę. To zapytanie utworzy tabelę źródłową, której można użyć w przepływie danych. Korzystanie z zapytań to również doskonały sposób na zmniejszenie liczby wierszy na potrzeby testowania lub wyszukiwania.

Wskazówka

Wspólne wyrażenie tabeli (CTE) w SQL nie jest obsługiwane w trybie zapytania przepływu danych mapowania, ponieważ ten tryb wymaga, aby zapytania mogły być używane w klauzuli FROM zapytania SQL, ale CTE nie może być używane w ten sposób. Aby użyć CTE, należy utworzyć procedurę składowaną, korzystając z następującego zapytania:

CREATE PROC CTESP @query nvarchar(max)

AS

BEGIN

EXECUTE sp_executesql @query;

END

Następnie użyj trybu procedury składowanej w transformacji źródłowej przepływu danych mapowania i ustaw @query jak przykład with CTE as (select 'test' as a) select * from CTE. Następnie można użyć CTEs zgodnie z oczekiwaniami.

Procedura składowana: wybierz tę opcję, jeśli chcesz wygenerować projekcję i dane źródłowe z procedury składowanej wykonywanej z źródłowej bazy danych. Możesz wpisać schemat, nazwę procedury i parametry lub kliknąć pozycję Odśwież, aby poprosić usługę o odnalezienie schematów i nazw procedur. Następnie możesz kliknąć pozycję Importuj, aby zaimportować wszystkie parametry procedury przy użyciu formularza @paraName.

- Przykład sql:

Select * from MyTable where customerId > 1000 and customerId < 2000 - Przykład sparametryzowanego kodu SQL:

"select * from {$tablename} where orderyear > {$year}"

Rozmiar partii: wprowadź rozmiar partii, aby podzielić duże dane na odczyty.

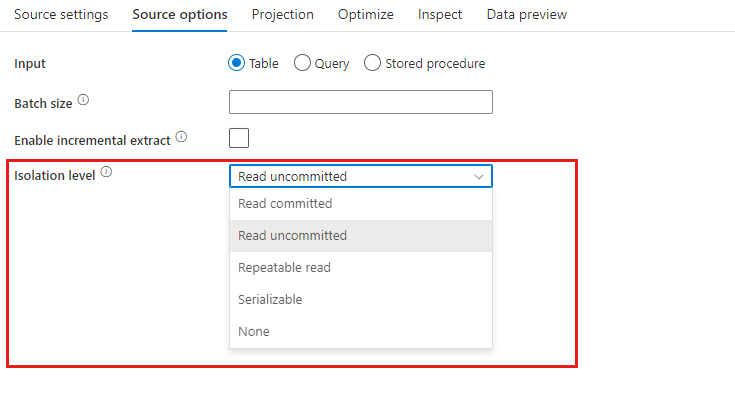

Poziom izolacji: domyślny poziom izolacji dla źródeł SQL w przepływie mapowania danych to "Read Uncommitted". W tym miejscu można zmienić poziom izolacji na jedną z następujących wartości:

- Odczyt zatwierdzony

- Odczyt w stanie niezatwierdzonym

- Powtarzalny odczyt

- Serializowalny

- Brak (ignoruj poziom izolacji)

Włącz wyodrębnianie przyrostowe: użyj tej opcji, aby poinformować usługę ADF o przetwarzaniu tylko wierszy, które uległy zmianie od czasu ostatniego wykonania potoku. Aby włączyć wyodrębnianie przyrostowe ze zmianami schematu, wybierz tabele, w których stosuje się kolumny przyrostowe/znaczniki progowe, zamiast tabel z natywnym przechwytywaniem danych o zmianach.

Kolumna przyrostowa: Podczas korzystania z funkcji wyodrębniania przyrostowego należy wybrać kolumnę z datą/godziną lub kolumnę liczbową, którą chcesz używać jako punkt odniesienia w tabeli źródłowej.

Włącz natywne przechwytywanie danych zmian (wersja zapoznawcza): użyj tej opcji, aby poinformować usługę ADF o przetwarzaniu tylko danych różnicowych przechwyconych przez technologię przechwytywania zmian SQL od czasu ostatniego wykonania potoku. Dzięki tej opcji dane różnicowe, w tym wstawianie wierszy, aktualizowanie i usuwanie, zostaną załadowane automatycznie bez konieczności wprowadzania kolumn przyrostowych. Przed użyciem tej opcji w usłudze ADF należy włączyć przechwytywanie zmian danych w bazie danych Azure SQL. Aby uzyskać więcej informacji na temat tej opcji w usłudze ADF, zobacz przechwytywanie danych zmian natywnych.

Rozpocznij odczytywanie od początku: Gdy ta opcja zostanie ustawiona dla wyodrębniania przyrostowego, usługa ADF odczyta wszystkie wiersze podczas pierwszego uruchomienia potoku z włączonym trybem wyodrębniania przyrostowego.

Przekształcenie ujścia

Ustawienia specyficzne dla Azure SQL Database są dostępne na karcie Settings transformacji sink.

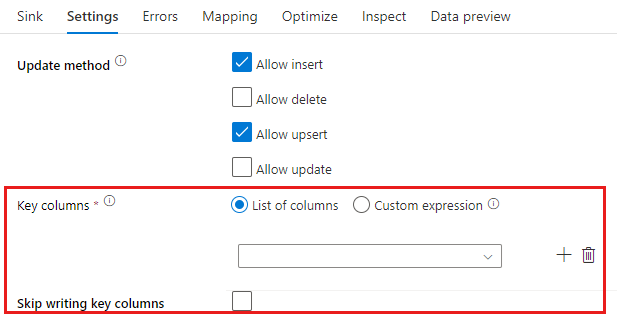

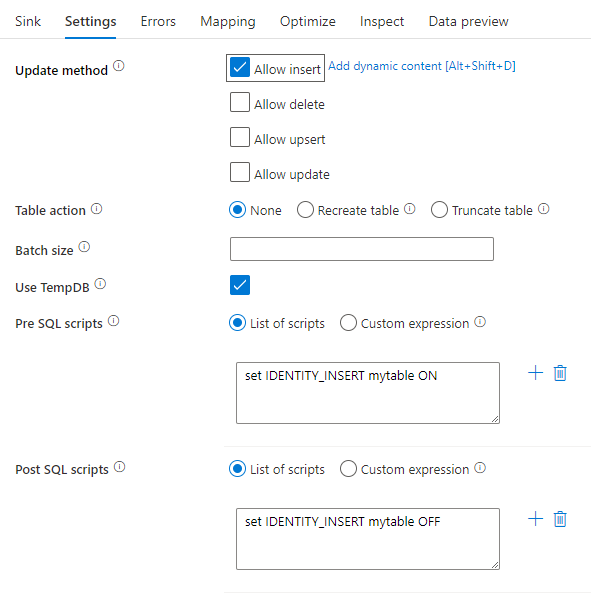

Metoda aktualizacji: określa, jakie operacje są dozwolone w miejscu docelowym bazy danych. Ustawieniem domyślnym jest zezwalanie tylko na wstawianie. Aby zaktualizować, wstawić lub usunąć wiersze, należy przekształcić wiersze za pomocą alter-row, aby je oznaczyć do tych akcji. W przypadku aktualizacji, operacji "upsert" i usuwania należy ustawić jedną lub więcej kolumn klucza w celu określenia, który wiersz ma zostać zmieniony.

Nazwa kolumny, którą wybierzesz jako klucz, będzie używana przez usługę przy kolejnych operacjach, takich jak aktualizacja, dodawanie lub kasowanie. W związku z tym należy wybrać kolumnę, która istnieje w mapowaniu ujścia. Jeśli nie chcesz zapisywać wartości w tej kolumnie klucza, kliknij pozycję "Pomiń zapisywanie kolumn kluczy".

Kolumnę klucza używaną tutaj do aktualizowania tabeli docelowej Azure SQL Database można sparametryzować. Jeśli masz wiele kolumn dla klucza złożonego, kliknij "Wyrażenie niestandardowe", aby móc dodać dynamiczną zawartość przy użyciu języka wyrażeń przepływu danych, który może zawierać tablicę łańcuchów z nazwami kolumn dla klucza złożonego.

Akcja tabeli: określa, czy należy ponownie utworzyć lub usunąć wszystkie wiersze z tabeli docelowej przed zapisem.

- Brak: żadna akcja nie zostanie wykonana w tabeli.

- Utwórz ponownie: tabela zostanie usunięta i utworzona ponownie. Wymagane w przypadku dynamicznego tworzenia nowej tabeli.

- Obcinanie: wszystkie wiersze z tabeli docelowej zostaną usunięte.

Rozmiar partii: określa liczbę wierszy zapisywanych w każdym zasobniku. Większe rozmiary partii zwiększają kompresję i optymalizację pamięci, ale istnieje ryzyko wystąpienia błędów pamięci podczas buforowania danych.

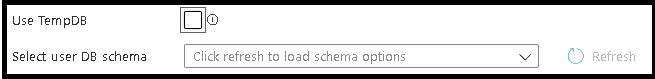

Użyj bazy danych TempDB: domyślnie usługa będzie używać globalnej tabeli tymczasowej do przechowywania danych w ramach procesu ładowania. Możesz też usunąć zaznaczenie opcji "Użyj bazy danych TempDB", a zamiast tego poprosić usługę o przechowywanie tymczasowej tabeli przechowywania w bazie danych użytkownika, która znajduje się w bazie danych używanej dla tego ujścia.

Skrypty wstępne i końcowe SQL: Wprowadź wielowierszowe skrypty SQL, które będą wykonywane przed (przetwarzaniem wstępnym) i po (przetwarzaniu końcowym), gdy dane są zapisywane w bazie danych docelowej.

Wskazówka

- Zaleca się podzielenie pojedynczych skryptów wsadowych z wieloma poleceniami na wiele partii.

- W ramach partii można uruchamiać tylko instrukcje języka DDL (Data Definition Language) i Języka manipulowania danymi (DML), które zwracają prostą liczbę aktualizacji. Dowiedz się więcej na temat wykonywania operacji wsadowych

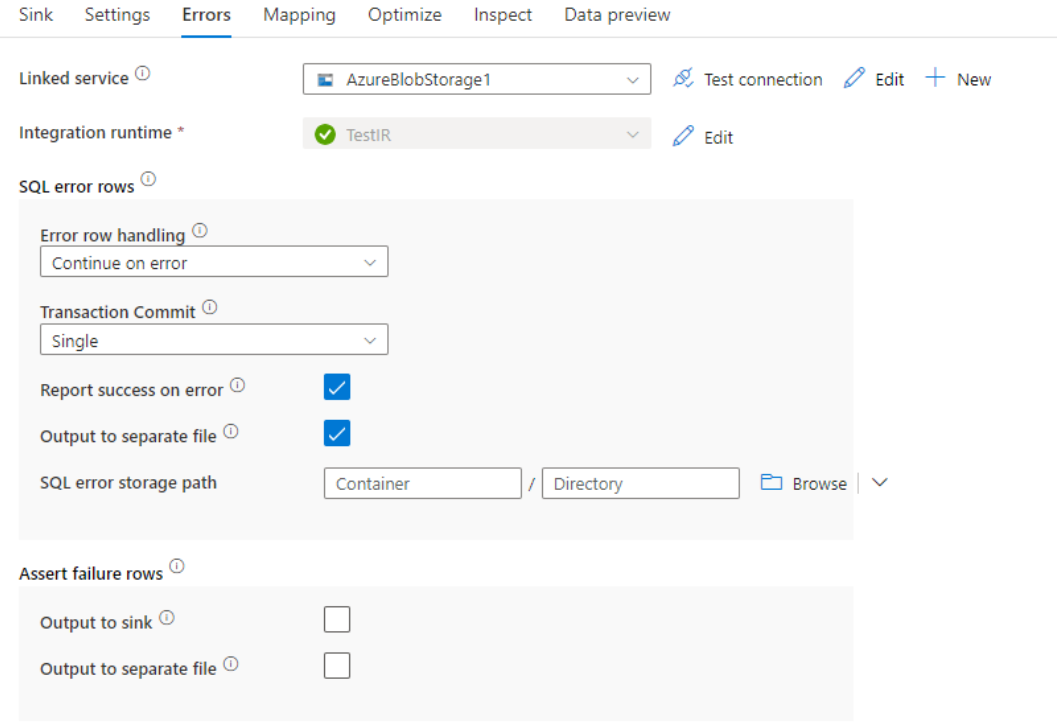

Obsługa wierszy z błędami

Podczas zapisywania w usłudze Azure SQL DB niektóre wiersze danych mogą zakończyć się niepowodzeniem z powodu ograniczeń ustawionych przez miejsce docelowe. Niektóre typowe błędy to:

- Ciąg lub dane binarne zostaną skrócone w tabeli

- Nie można wstawić wartości NULL do kolumny

- Instrukcja INSERT powoduje konflikt z ograniczeniem CHECK

Domyślnie uruchomienie przepływu danych zakończy się niepowodzeniem przy pierwszym napotkanym błędzie. Możesz wybrać opcję Kontynuuj przy błędzie , który umożliwia ukończenie przepływu danych, nawet jeśli poszczególne wiersze zawierają błędy. Usługa udostępnia różne opcje obsługi tych wierszy błędów.

Zatwierdzenie transakcji: wybierz, czy dane są zapisywane w jednej transakcji, czy w partiach. Pojedyncza transakcja zapewni gorzej wydajność, ale żadne zapisane dane nie będą widoczne dla innych do momentu zakończenia transakcji.

Wyprowadzanie odrzuconych danych: Jeśli jest włączone, możesz wyeksportować wiersze błędów do pliku CSV do konta Azure Blob Storage lub Azure Data Lake Storage Gen2 według wyboru. Spowoduje to zapisanie wierszy błędów z trzema dodatkowymi kolumnami: operacją SQL, taką jak INSERT lub UPDATE, kodem błędu przepływu danych i komunikatem o błędzie w wierszu.

Zgłoś powodzenie w przypadku błędu: Jeśli jest włączone, przepływ danych zostanie oznaczony jako zakończony powodzeniem, nawet jeśli zostaną znalezione wiersze błędów.

Mapowanie typów danych dla Azure SQL Database

Podczas kopiowania danych do lub z bazy danych Azure SQL stosowane są następujące mapowania typów danych Azure SQL Database na tymczasowe typy danych w Azure Data Factory. Te same mapowania są używane przez funkcję potoku usługi Synapse, która implementuje Azure Data Factory bezpośrednio. Aby dowiedzieć się, jak operacja kopiowania mapuje schemat źródłowy i typ danych na miejsce docelowe, zobacz Mapowanie schematu i typu danych.

| typ danych Azure SQL Database | Typ danych tymczasowych usługi Data Factory |

|---|---|

| bigint | Int64 |

| binarny | Bajt[] |

| bit | logiczny |

| char | Ciąg, Znak[] |

| data | DateTime |

| Data i czas | DateTime |

| datetime2 | DateTime |

| Datetimeoffset | DateTimeOffset |

| Dziesiętne | Dziesiętne |

| Atrybut FILESTREAM (typ varbinary(max)) | Bajt[] |

| float | Podwójna precyzja |

| obraz | Bajt[] |

| int | Int32 |

| pieniądze | Dziesiętne |

| nchar | Ciąg, Znak[] |

| ntekst | Ciąg, Znak[] |

| liczbowe | Dziesiętne |

| nvarchar | Ciąg, Znak[] |

| rzeczywiste | Pojedynczy |

| rowversion | Bajt[] |

| smalldatetime | DateTime |

| smallint | Int16 |

| smallmoney | Dziesiętne |

| sql_variant | Objekt |

| SMS | Ciąg, Znak[] |

| czas | przedział_czasu |

| sygnatura czasowa | Bajt[] |

| tinyint | Byte |

| unikalny identyfikator | Identyfikator GUID |

| varbinary | Bajt[] |

| varchar | Ciąg, Znak[] |

| xml | String |

Uwaga

W przypadku typów danych mapujących na tymczasowy typ dziesiętny, obecnie funkcja Copy activity obsługuje precyzję do 28. Jeśli masz dane o precyzji większej niż 28, rozważ przekonwertowanie na ciąg w zapytaniu SQL.

Właściwości czynności wyszukiwania

Aby dowiedzieć się więcej o właściwościach, sprawdź działanie wyszukiwania.

Właściwości działania GetMetadata

Aby dowiedzieć się więcej o właściwościach, sprawdź działanie GetMetadata

Korzystanie z funkcji Always Encrypted

Podczas kopiowania danych z/do Azure SQL Database za pomocą Always Encrypted wykonaj następujące kroki:

Zapisz klucz główny kolumny (CMK) w usłudze Azure Key Vault. Dowiedz się więcej na temat Jak skonfigurować funkcję Always Encrypted przy użyciu Azure Key Vault

Upewnij się, że masz dostęp do skarbca kluczy, w którym przechowywany jest Klucz Główny Kolumny (CMK). Zapoznaj się z tym artykułem , aby uzyskać wymagane uprawnienia.

Utwórz połączoną usługę w celu nawiązania połączenia z bazą danych SQL i włącz funkcję "Always Encrypted" przy użyciu tożsamości zarządzanej lub jednostki usługi.

Uwaga

Azure SQL Database Always Encrypted obsługuje poniższe scenariusze:

- Magazyny danych źródła lub ujścia używają tożsamości zarządzanej lub jednostki usługi jako typu uwierzytelniania dostawcy kluczy.

- Magazyny danych źródła i ujścia używają tożsamości zarządzanej jako rodzaju uwierzytelniania dostawcy kluczy.

- Magazyny danych źródła i ujścia używają tej samej jednostki głównej usługi jako typu uwierzytelnienia dostawcy kluczy.

Uwaga

Obecnie Azure SQL Database Always Encrypted nie jest obsługiwana w przypadku przekształcania ujścia w przepływach danych mapowania.

Natywne przechwytywanie zmian danych

Azure Data Factory może obsługiwać natywne funkcje przechwytywania danych zmian dla SQL Server, Azure SQL DB i Azure SQL MI. Zmienione dane, w tym wstawianie wierszy, aktualizowanie i usuwanie w magazynach SQL, można automatycznie wykrywać i wyodrębniać przez przepływ danych mapowania usługi ADF. Dzięki bezkodowemu doświadczeniu w mapowaniu przepływu danych, użytkownicy mogą łatwo zrealizować scenariusz replikacji danych z magazynów SQL, dodając bazę danych jako magazyn docelowy. Co więcej, użytkownicy mogą również tworzyć dowolną logikę przekształcania danych między operacjami, aby osiągnąć przyrostowy scenariusz ETL z repozytoriów SQL.

Upewnij się, że nazwy pipeline'u i działań pozostają niezmienione, aby punkty kontrolne mogły być rejestrowane przez usługę ADF w celu automatycznego pobierania zmienionych danych z ostatniego uruchomienia. Jeśli zmienisz nazwę pipeline'u lub nazwę działania, punkt kontrolny zostanie zresetowany, co oznacza, że będziesz musiał rozpocząć od początku lub uwzględnić zmiany od momentu kolejne uruchomienie. Jeśli chcesz zmienić nazwę kolejki lub nazwę działania, ale chcesz zachować punkt kontrolny, aby automatycznie uzyskiwać dane zmienione podczas ostatniego uruchomienia, użyj własnego klucza punktu kontrolnego w działaniu przepływu danych, aby to osiągnąć.

Podczas debugowania potoku ta funkcja działa tak samo. Pamiętaj, że punkt kontrolny zostanie zresetowany podczas odświeżania przeglądarki podczas uruchamiania debugowania. Po zadowoleniu z wyniku pipeline z działania debugowania, możesz przystąpić do opublikowania i uruchomienia pipeline. W chwili, gdy pierwszy raz uruchamiasz opublikowany potok, automatycznie zaczyna się od początku lub wprowadza zmiany od tej chwili.

W sekcji monitorowania zawsze masz możliwość ponownego uruchomienia potoku. Podczas wykonywania tych czynności zmienione dane są zawsze przechwytywane z poprzedniego punktu kontrolnego wybranego przebiegu potoku.

Przykład 1:

Jeśli bezpośrednio połączysz przekształcenie źródłowe, odwołując się do zestawu danych z włączoną funkcją SQL CDC, z przekształceniem docelowym, które odnosi się do bazy danych w przepływie danych mapowanych, zmiany wprowadzone w źródle SQL zostaną automatycznie zastosowane do docelowej bazy danych, w ten sposób łatwo uzyskasz scenariusz replikacji danych między bazami danych. Możesz użyć metody update w transformacji wyjściowej, aby wybrać, czy chcesz zezwolić na wstawianie, zezwolić na aktualizację lub zezwolić na usuwanie w docelowej bazie danych. Przykładowy skrypt w mapowaniu przepływu danych jest następujący.

source(output(

id as integer,

name as string

),

allowSchemaDrift: true,

validateSchema: false,

enableNativeCdc: true,

netChanges: true,

skipInitialLoad: false,

isolationLevel: 'READ_UNCOMMITTED',

format: 'table') ~> source1

source1 sink(allowSchemaDrift: true,

validateSchema: false,

deletable:true,

insertable:true,

updateable:true,

upsertable:true,

keys:['id'],

format: 'table',

skipDuplicateMapInputs: true,

skipDuplicateMapOutputs: true,

errorHandlingOption: 'stopOnFirstError') ~> sink1

Przykład 2:

Jeśli chcesz włączyć scenariusz ETL zamiast replikacji danych między bazami danych za pomocą SQL CDC, możesz użyć wyrażeń isInsert(1), isUpdate(1) i isDelete(1) w przepływie danych w mapowaniu, aby odróżnić wiersze z różnymi typami operacji. Poniżej przedstawiono jeden z przykładowych skryptów do mapowania przepływu danych, który wyprowadza jedną kolumnę z wartością: 1 - aby wskazać wstawione wiersze, 2 - aby wskazać zaktualizowane wiersze, i 3 - aby wskazać usunięte wiersze dla dalszych przekształceń w procesie przetwarzania danych różnicowych.

source(output(

id as integer,

name as string

),

allowSchemaDrift: true,

validateSchema: false,

enableNativeCdc: true,

netChanges: true,

skipInitialLoad: false,

isolationLevel: 'READ_UNCOMMITTED',

format: 'table') ~> source1

source1 derive(operationType = iif(isInsert(1), 1, iif(isUpdate(1), 2, 3))) ~> derivedColumn1

derivedColumn1 sink(allowSchemaDrift: true,

validateSchema: false,

skipDuplicateMapInputs: true,

skipDuplicateMapOutputs: true) ~> sink1

Znane ograniczenie:

- Tylko zmiany netto z systemu CDC SQL zostaną załadowane przez system ADF za pośrednictwem cdc.fn_cdc_get_net_changes_.

Uaktualnianie wersji Azure SQL Database

Aby uaktualnić wersję Azure SQL Database, na stronie Edytuj połączoną usługę wybierz Recommended w obszarze Version i skonfiguruj połączoną usługę, odwołując się do właściwości usługi Linked dla zalecanej wersji.

Różnice między zalecaną i starszą wersją

W poniższej tabeli przedstawiono różnice między Azure SQL Database przy użyciu zalecanej i starszej wersji.

| Rekomendowana wersja | Starsza wersja |

|---|---|

Obsługuj TLS 1.3 za pośrednictwem encrypt jako strict. |

Protokół TLS 1.3 nie jest obsługiwany. |

Powiązana zawartość

Aby uzyskać listę magazynów danych obsługiwanych jako źródła i ujścia działania kopiowania, zobacz Obsługiwane magazyny danych i formaty.