Modellkatalog och samlingar i Azure AI Studio

Viktigt!

Vissa av de funktioner som beskrivs i den här artikeln kanske bara är tillgängliga i förhandsversionen. Den här förhandsversionen tillhandahålls utan ett serviceavtal och vi rekommenderar det inte för produktionsarbetsbelastningar. Vissa funktioner kanske inte stöds eller kan vara begränsade. Mer information finns i Kompletterande villkor för användning av Microsoft Azure-förhandsversioner.

Modellkatalogen i Azure AI Studio är navet för att identifiera och använda ett brett utbud av modeller som gör att du kan skapa Generative AI-program. Modellkatalogen innehåller hundratals modeller mellan modellleverantörer som Azure OpenAI-tjänsten, Mistral, Meta, Cohere, Nvidia, Hugging Face, inklusive modeller som tränats av Microsoft. Modeller från andra leverantörer än Microsoft är icke-Microsoft-produkter, enligt definitionen i Microsofts produktvillkor, och omfattas av villkoren i modellen.

Modellsamlingar

Modellkatalogen organiserar modeller i samlingar. Det finns tre typer av samlingar i modellkatalogen:

- Modeller som har kurerats av Azure AI: De mest populära modellerna med öppen vikt och proprietära från tredje part som paketerats och optimerats för att fungera sömlöst på Azure AI-plattformen. Användning av dessa modeller omfattas av modellleverantörens licensvillkor som tillhandahålls med modellen. När den distribueras i Azure AI Studio omfattas modellens tillgänglighet av tillämpligt Azure-serviceavtal, och Microsoft tillhandahåller stöd för distributionsproblem. Modeller från partner som Meta, NVIDIA, Mistral AI är exempel på modeller som är tillgängliga i samlingen "Curated by Azure AI" i katalogen. Dessa modeller kan identifieras med en grön bockmarkering på modellpanelerna i katalogen eller så kan du filtrera efter samlingen "Kurerade av Azure AI".

- Azure OpenAI-modeller, exklusivt tillgängliga i Azure: Flaggskeppsmodeller för Azure OpenAI via samlingen "Azure OpenAI" via en integrering med Azure OpenAI-tjänsten. Microsoft stöder dessa modeller och deras användning enligt produktvillkoren och serviceavtalet för Azure OpenAI Service.

- Öppna modeller från Hugging Face Hub: Hundratals modeller från HuggingFace-hubben är tillgängliga via samlingen "Hugging Face" för realtidsinferens med hanterad beräkning. HuggingFace skapar och underhåller modeller som finns i HuggingFace-samlingen. Använd HuggingFace-forumet eller HuggingFace-supporten om du behöver hjälp. Läs mer i Distribuera öppna modeller .

Föreslå tillägg till modellkatalogen: Du kan skicka en begäran om att lägga till en modell i modellkatalogen med hjälp av det här formuläret.

Översikt över modellkatalogfunktioner

Information om Azure OpenAI-modeller finns i Azure OpenAI Service.

Vissa modeller i modellerna Curated by Azure AI och Open från Hugging Face Hub-samlingarna kan distribueras med ett hanterat beräkningsalternativ, och vissa modeller är tillgängliga för distribution med serverlösa API:er med betala per användning-fakturering. Dessa modeller kan identifieras, jämföras, utvärderas, finjusteras (när de stöds) och distribueras i stor skala och integreras i dina Generative AI-program med säkerhet och datastyrning i företagsklass.

- Upptäck: Granska modellkort, prova exempelinferens och bläddra bland kodexempel för att utvärdera, finjustera eller distribuera modellen.

- Jämför: Jämför riktmärken mellan modeller och datauppsättningar som är tillgängliga i branschen för att bedöma vilken som uppfyller ditt affärsscenario.

- Utvärdera: Utvärdera om modellen passar för din specifika arbetsbelastning genom att tillhandahålla dina egna testdata. Med utvärderingsmått blir det enkelt att visualisera hur bra den valda modellen fungerar i ditt scenario.

- Finjustera: Anpassa finjusteringsbara modeller med dina egna träningsdata och välj den bästa modellen genom att jämföra mått mellan alla dina finjusteringsjobb. Inbyggda optimeringar påskyndar finjusteringen och minskar det minne och den beräkning som behövs för finjustering.

- Distribuera: Distribuera förtränad modeller eller finjusterade modeller sömlöst för slutsatsdragning. Modeller som kan distribueras till hanterad beräkning kan också laddas ned.

Modelldistribution: Hanterad beräkning och serverlöst API (betala per användning)

Modellkatalogen erbjuder två olika sätt att använda modeller från katalogen för din användning: hanterade beräknings- och serverlösa API:er. Vilka distributionsalternativ som är tillgängliga för varje modell varierar. Läs mer om funktionerna i distributionsalternativen och vilka alternativ som är tillgängliga för specifika modeller i följande tabeller. Läs mer om databehandling med distributionsalternativen.

| Funktioner | Hantera databearbetning | Serverlöst API (betala per användning) |

|---|---|---|

| Distributionsupplevelse och fakturering | Modellvikter distribueras till dedikerade virtuella datorer med hanterade onlineslutpunkter. Den hanterade onlineslutpunkten, som kan ha en eller flera distributioner, gör ett REST API tillgängligt för slutsatsdragning. Du debiteras för den virtuella datorns kärntimmar som används av distributionerna. | Åtkomst till modeller sker via en distribution som etablerar ett API för åtkomst till modellen. API:et ger åtkomst till den modell som hanteras och hanteras av Microsoft för slutsatsdragning. Du debiteras för indata och utdata till API:erna, vanligtvis i token. prisinformation tillhandahålls innan du distribuerar. |

| API-autentisering | Nycklar och Microsoft Entra ID autentisering. | Endast nycklar. |

| Innehållssäkerhet | Använd Api:er för Azure Content Safety-tjänsten. | Azure AI-innehållssäkerhetsfilter är tillgängliga integrerade med slutsatsdragnings-API:er. Azure AI-innehållssäkerhetsfilter faktureras separat. |

| Nätverksisolering | Konfigurera hanterade nätverk för Azure AI Studio-hubbar. | Slutpunkter följer hubbens PNA-flagga (Public Network Access). Mer information finns i avsnittet Nätverksisolering för modeller som distribueras via serverlösa API:er . |

| Modell | Hantera databearbetning | Serverlöst API (betala per användning) |

|---|---|---|

| Llama-familjemodeller | Llama-2-7b Llama-2-7b-chat Llama-2-13b Llama-2-13b-chat Llama-2-70b Llama-2-70b-chat Llama-3-8B-Instruct Llama-3-70B-Instruct Llama-3-8B Llama-3-70B |

Llama-3-70B-Instruct Llama-3-8B-Instruct Llama-2-7b Llama-2-7b-chat Llama-2-13b Llama-2-13b-chat Llama-2-70b Llama-2-70b-chat |

| Mistral-familjemodeller | mistralai-Mixtral-8x22B-v0-1 mistralai-Mixtral-8x22B-Instruct-v0-1 mistral-community-Mixtral-8x22B-v0-1 mistralai-Mixtral-8x7B-v01 mistralai-Mistral-7B-Instruct-v0-2 mistralai-Mistral-7B-v01 mistralai-Mixtral-8x7B-Instruct-v01 mistralai-Mistral-7B-Instruct-v01 |

Mistral-large Mistral-small |

| Gemensamma familjemodeller | Inte tillgängliga | Cohere-command-r-plus Cohere-command-r Cohere-embed-v3-english Cohere-embed-v3-multilingual |

| JAIS | Inte tillgängliga | jais-30b-chat |

| Phi3-familjemodeller | Phi-3-small-128k-Instruct Phi-3-small-8k-Instruct Phi-3-mini-4k-Instruct Phi-3-mini-128k-Instruct Phi3-medium-128k-instruct Phi3-medium-4k-instruct |

Phi-3-mini-4k-Instruct Phi-3-mini-128k-Instruct Phi3-medium-128k-instruct Phi3-medium-4k-instruct |

| Nixtla | Inte tillgängliga | TimeGEN-1 |

| Andra modeller | Tillgängligt | Inte tillgängligt |

Hantera databearbetning

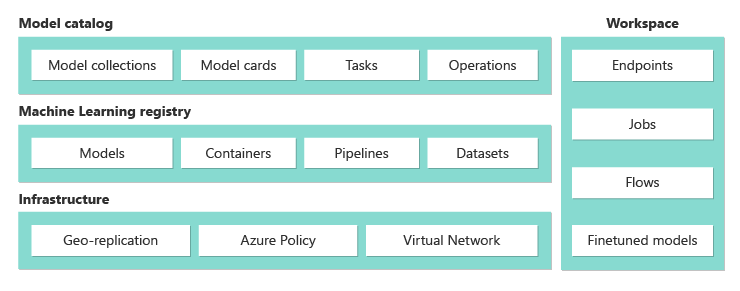

Möjligheten att distribuera modeller som en hanterad beräkning bygger på plattformsfunktioner i Azure Mašinsko učenje för att möjliggöra sömlös integrering över hela LLMOps-livscykeln för den breda samlingen modeller i modellkatalogen.

Hur görs modeller tillgängliga för distribution som hanterad beräkning?

Modellerna görs tillgängliga via Azure Machine Learning-register som aktiverar ML:s första metod för att hantera och distribuera maskininlärningstillgångar, till exempel modellvikter, containerkörningar för att köra modellerna, pipelines för utvärdering och finjustering av modeller och datauppsättningar för benchmarks och exempel. Dessa ML-register bygger på en mycket skalbar och företagsklar infrastruktur som:

Levererar artefakter med låg latensåtkomstmodell till alla Azure-regioner med inbyggd geo-replikering.

Stöder företagets säkerhetskrav som begränsar åtkomsten till modeller med Azure Policy och säker distribution med hanterade virtuella nätverk.

Distribuera modeller för slutsatsdragning med hanterad beräkning

Modeller som är tillgängliga för distribution till en hanterad beräkning kan distribueras till Azure Mašinsko učenje Online-slutpunkter för realtidsinferens. När du distribuerar till hanterad beräkning måste du ha en kvot för virtuella datorer i din Azure-prenumeration för de specifika SKU:er som behövs för att köra modellen optimalt. Med vissa modeller kan du distribuera till en tillfälligt delad kvot för att testa modellen. Läs mer om att distribuera modeller:

Skapa generativa AI-appar med hanterad beräkning

Prompt flow erbjuder en bra upplevelse för prototyper. Du kan använda modeller som distribuerats med hanterade beräkningar i Prompt Flow med VERKTYGET ÖPPNA MODELL LLM. Du kan också använda REST-API:et som exponeras av hanterad beräkning i populära LLM-verktyg som LangChain med Azure Mašinsko učenje-tillägget.

Innehållssäkerhet för modeller som distribueras som hanterad beräkning

Tjänsten Azure AI Content Safety (AACS) är tillgänglig för användning med hanterade beräkningar för att söka efter olika kategorier av skadligt innehåll, till exempel sexuellt innehåll, våld, hat och självskadebeteende och avancerade hot som riskidentifiering av jailbreak och skyddad materialtextidentifiering. Du kan referera till den här notebook-filen för referensintegrering med AACS för Llama 2 eller använda verktyget Innehållssäkerhet (text) i Prompt Flow för att skicka svar från modellen till AACS för screening. Du debiteras separat enligt AACS-priser för sådan användning.

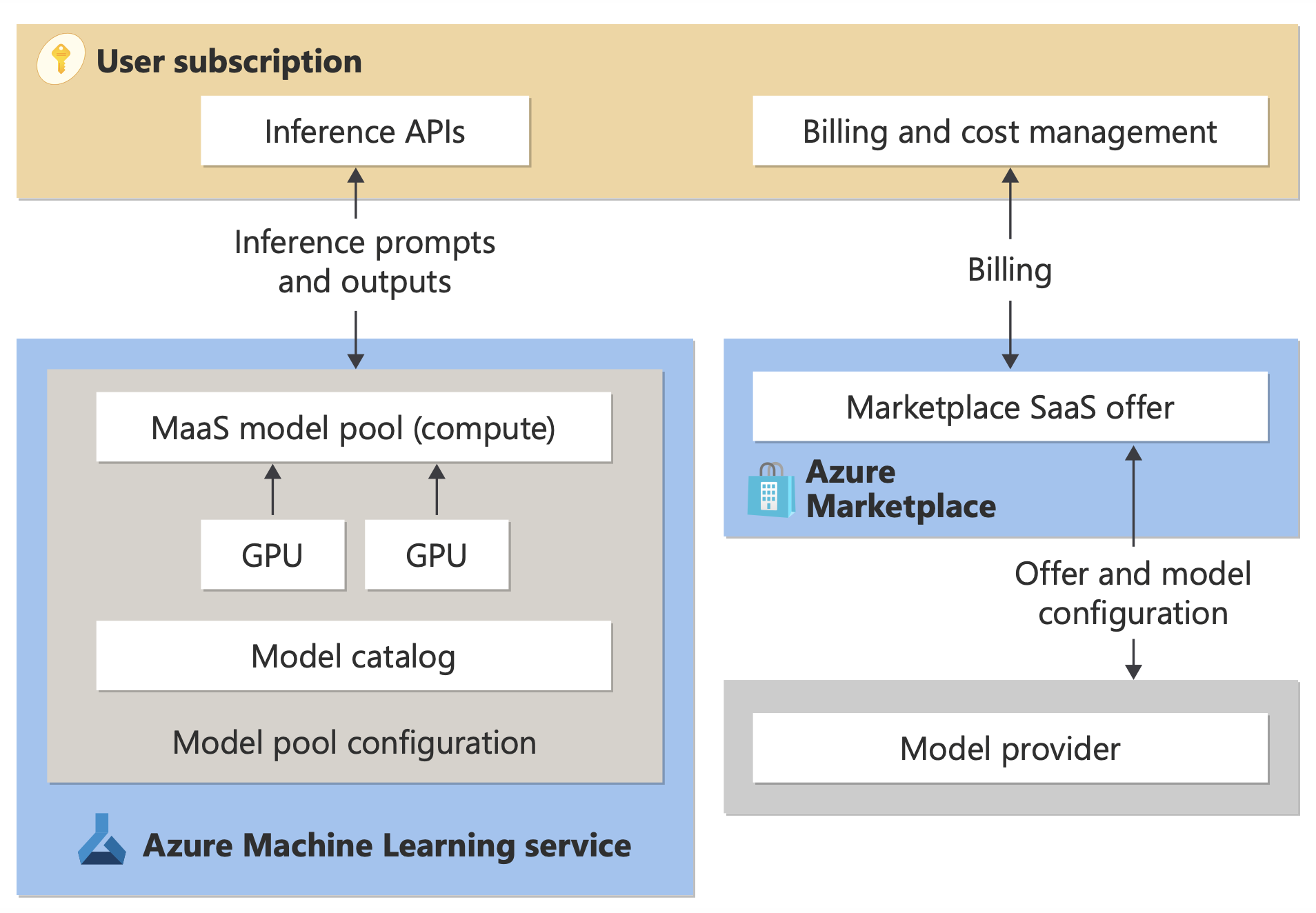

Serverlösa API:er med betala per användning-fakturering

Vissa modeller i modellkatalogen kan distribueras som serverlösa API:er med betala per användning-fakturering, vilket ger ett sätt att använda dem som ett API utan att vara värd för dem i din prenumeration. Modeller finns i infrastruktur som hanteras av Microsoft, vilket ger API-baserad åtkomst till modellleverantörens modell. API-baserad åtkomst kan avsevärt minska kostnaden för att komma åt en modell och avsevärt förenkla etableringsupplevelsen.

Modeller som är tillgängliga för distribution som serverlösa API:er med betala per användning-fakturering erbjuds av modellprovidern men finns i Microsoft-hanterad Azure-infrastruktur och nås via API. Modellleverantörer definierar licensvillkoren och anger priset för användning av sina modeller, medan Azure Mašinsko učenje-tjänsten hanterar värdinfrastrukturen, gör slutsatsdragnings-API:erna tillgängliga och fungerar som dataprocessor för frågor som skickas och innehållsutdata från modeller som distribueras via MaaS. Läs mer om databehandling för MaaS i artikeln om datasekretess .

Fakturering

Identifierings-, prenumerations- och förbrukningsupplevelsen för modeller som distribueras via MaaS finns i Azure AI Studio och Azure Mašinsko učenje studio. Användare accepterar licensvillkor för användning av modellerna och prisinformation för förbrukning tillhandahålls under distributionen. Modeller från tredjepartsleverantörer debiteras via Azure Marketplace i enlighet med användningsvillkoren för den kommersiella marknadsplatsen . Modeller från Microsoft debiteras med Hjälp av Azure-mätare som förbrukningstjänster från första part. Som beskrivs i produktvillkoren köps Förbrukningstjänster från första part med Hjälp av Azure-mätare men omfattas inte av Azure-tjänstvillkor. Användning av dessa modeller omfattas av de licensvillkor som anges.

Finjustera modeller

Vissa modeller stöder även serverlös finjustering där användarna kan dra nytta av värdbaserad finjustering med betala per användning-fakturering för att skräddarsy modellerna med hjälp av data som de tillhandahåller. Mer information finns i översikten över finjustering.

RAG med modeller som distribueras som serverlösa API:er

Med Azure AI Studio kan användarna använda vektorindex och hämtningsförhöjd generation. Modeller som kan distribueras via serverlöst API kan användas för att generera inbäddningar och slutsatsdragning baserat på anpassade data för att generera svar som är specifika för deras användningsfall. Mer information finns i Skapa ett vektorindex.

Regional tillgänglighet för erbjudanden och modeller

Betala per användning-fakturering är endast tillgängligt för användare vars Azure-prenumeration tillhör ett faktureringskonto i ett land där modellleverantören har gjort erbjudandet tillgängligt (se "erbjudandetillgänglighetsregion" i tabellen i nästa avsnitt). Om erbjudandet är tillgängligt i den relevanta regionen måste användaren sedan ha en hubb/ett projekt i Azure-regionen där modellen är tillgänglig för distribution eller finjustering, i förekommande fall (se kolumnerna "hub/project region" i tabellen nedan).

| Modell | Erbjudande tillgänglighetsregion | Hubb/projektregion för distribution | Hubb/projektregion för finjustering |

|---|---|---|---|

| Llama-3-70B-Instruct Llama-3-8B-Instruct |

Microsoft Managed Countries | USA, östra, USA, östra 2, USA, norra centrala, USA, södra centrala, Sverige, centrala, USA, västra, USA, västra 3 | Inte tillgängliga |

| Llama-2-7b Llama-2-13b Llama-2-70b |

Microsoft Managed Countries | USA, östra, USA, östra 2, USA, norra centrala, USA, södra centrala, USA, västra, USA, västra 3 | USA, västra 3 |

| Llama-2-7b-chat Llama-2-13b-chat Llama-2-70b-chat |

Microsoft Managed Countries | USA, östra, USA, östra 2, USA, norra centrala, USA, södra centrala, USA, västra, USA, västra 3, | Inte tillgängliga |

| Mistral Small | Microsoft Managed Countries | USA, östra, USA, östra 2, USA, norra centrala, USA, södra centrala, Sverige, centrala, USA, västra, USA, västra 3 | Inte tillgängliga |

| Mistral-Large | Microsoft Managed Countries Brasilien Hongkong Israel |

USA, östra, USA, östra 2, USA, norra centrala, USA, södra centrala, Sverige, centrala, USA, västra, USA, västra 3 | Inte tillgängliga |

| Cohere-command-r-plus Cohere-command-r Cohere-embed-v3-english Cohere-embed-v3-multilingual |

Microsoft Managed Countries Japan |

USA, östra, USA, östra 2, USA, norra centrala, USA, södra centrala, Sverige, centrala, USA, västra, USA, västra 3 | Inte tillgängliga |

| TimeGEN-1 | Microsoft Managed Countries Mexico Israel |

USA, östra, USA, östra 2, USA, norra centrala, USA, södra centrala, Sverige, centrala, USA, västra, USA, västra 3 | Inte tillgängliga |

| jais-30b-chat | Microsoft Managed Countries | USA, östra, USA, östra 2, USA, norra centrala, USA, södra centrala, Sverige, centrala, USA, västra, USA, västra 3 | Inte tillgängliga |

| Phi-3-mini-4k-instruct | Microsoft Managed Countries | USA, östra 2, Kanada, centrala, Sverige, centrala, USA, västra 3 | Inte tillgängliga |

| Phi-3-mini-128k-instruct Phi-3-medium-4k-instruct Phi-3-medium-128k-instruct |

Microsoft Managed Countries | USA, östra 2, Sverige, centrala | Inte tillgängliga |

Innehållssäkerhet för modeller som distribueras via serverlösa API:er

Viktigt!

Vissa av de funktioner som beskrivs i den här artikeln kanske bara är tillgängliga i förhandsversionen. Den här förhandsversionen tillhandahålls utan ett serviceavtal och vi rekommenderar det inte för produktionsarbetsbelastningar. Vissa funktioner kanske inte stöds eller kan vara begränsade. Mer information finns i Kompletterande villkor för användning av Microsoft Azure-förhandsversioner.

För språkmodeller som distribueras via serverlösa API:er implementerar Azure AI en standardkonfiguration av textmodereringsfilter för Azure AI Content Safety som identifierar skadligt innehåll som hat, självskadebeteende, sexuellt och våldsamt innehåll. Mer information om innehållsfiltrering (förhandsversion) finns i skadekategorier i Azure AI Innehållssäkerhet.

Dricks

Innehållsfiltrering (förhandsversion) är inte tillgängligt för vissa modelltyper som distribueras via serverlösa API:er. Dessa modelltyper omfattar inbäddningsmodeller och tidsseriemodeller.

Innehållsfiltrering (förhandsversion) sker synkront när tjänsten bearbetar uppmaningar om att generera innehåll, och du kan debiteras separat enligt AACS-priser för sådan användning. Du kan inaktivera innehållsfiltrering (förhandsversion) för enskilda serverlösa slutpunkter, antingen vid den tidpunkt då du först distribuerar en språkmodell eller senare på sidan med distributionsinformation genom att välja växlingsknappen för innehållsfiltrering.

Anta att du bestämmer dig för att använda ett annat API än Azure AI Model Inference API för att arbeta med en modell som distribueras via ett serverlöst API. I sådana fall är innehållsfiltrering (förhandsversion) inte aktiverat om du inte implementerar det separat med hjälp av Azure AI Content Safety. Mer information om hur du kommer igång med Azure AI Content Safety finns i Snabbstart: Analysera textinnehåll. Om du inte använder innehållsfiltrering (förhandsversion) när du arbetar med modeller som distribueras via serverlösa API:er löper du en högre risk att utsätta användare för skadligt innehåll.

Nätverksisolering för modeller som distribueras via serverlösa API:er

Slutpunkter för modeller som distribueras som Serverlösa API:er följer flaggan för offentlig nätverksåtkomst (PNA) för AI Studio Hub som har projektet där distributionen finns. Om du vill skydda din MaaS-slutpunkt inaktiverar du PNA-flaggan på din AI Studio Hub. Du kan skydda inkommande kommunikation från en klient till slutpunkten med hjälp av en privat slutpunkt för hubben.

Så här anger du PNA-flaggan för Azure AI-hubben:

- Gå till Azure Portal

- Sök efter den resursgrupp som hubben tillhör och välj din Azure AI-hubb från de resurser som anges för den här resursgruppen.

- På sidan Översikt för hubb använder du det vänstra navigeringsfönstret för att gå till Inställningar>Nätverk.

- Under fliken Offentlig åtkomst kan du konfigurera inställningar för åtkomstflaggan för offentligt nätverk.

- Spara dina ändringar. Det kan ta upp till fem minuter att sprida ändringarna.

Begränsningar

- Om du har en AI Studio-hubb med en privat slutpunkt som skapats före den 11 juli 2024 följer inte nya MaaS-slutpunkter som lagts till i projekt i den här hubben nätverkskonfigurationen för hubben. I stället måste du skapa en ny privat slutpunkt för hubben och skapa nya serverlösa API-distributioner i projektet så att de nya distributionerna kan följa hubbens nätverkskonfiguration.

- Om du har en AI Studio Hub med MaaS-distributioner som skapats före den 11 juli 2024 och du aktiverar en privat slutpunkt på den här hubben följer inte de befintliga MaaS-distributionerna hubbens nätverkskonfiguration. För att serverlösa API-distributioner i hubben ska kunna följa hubbens nätverkskonfiguration måste du skapa distributionerna igen.

- För närvarande är stöd för Dina data inte tillgängligt för MaaS-distributioner i privata hubbar, eftersom privata hubbar har PNA-flaggan inaktiverad.

- Alla ändringar i nätverkskonfigurationen (till exempel aktivering eller inaktivering av PNA-flaggan) kan ta upp till fem minuter att sprida.

Gå vidare

Feedback

Kommer snart: Under hela 2024 kommer vi att fasa ut GitHub-problem som feedbackmekanism för innehåll och ersätta det med ett nytt feedbacksystem. Mer information finns i: https://aka.ms/ContentUserFeedback.

Skicka och visa feedback för