Not

Bu sayfaya erişim yetkilendirme gerektiriyor. Oturum açmayı veya dizinleri değiştirmeyi deneyebilirsiniz.

Bu sayfaya erişim yetkilendirme gerektiriyor. Dizinleri değiştirmeyi deneyebilirsiniz.

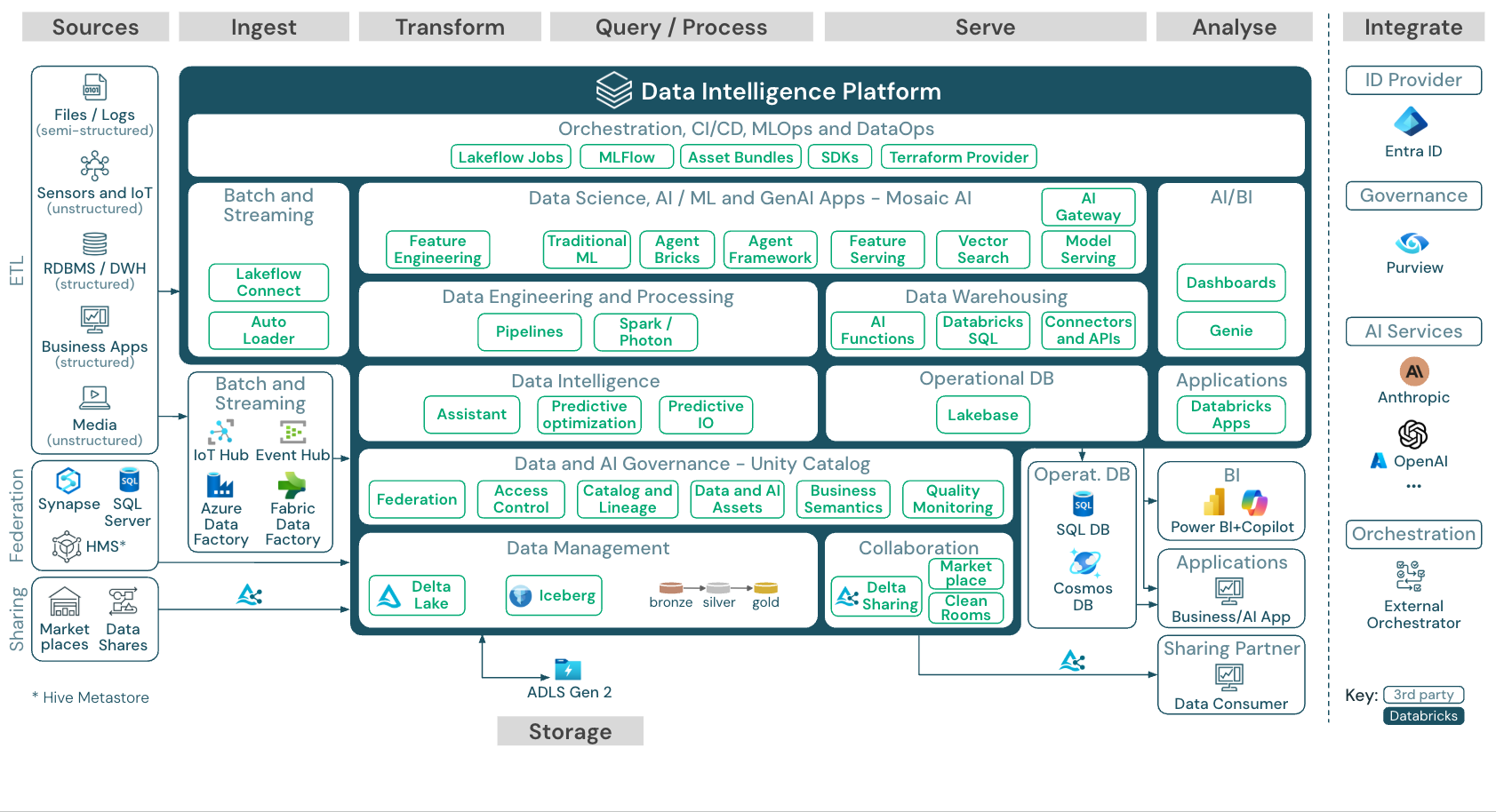

Bu makalede lakehouse için veri kaynakları, veri alımı, dönüştürme, sorgulama ve işleme, hizmet verme, analiz ve depolamayı kapsayan mimari rehberlik sağlanmaktadır.

Her başvuru mimarisi 11 x 17 (A3) biçiminde indirilebilir bir PDF'ye sahiptir.

Databricks'teki lakehouse, büyük bir iş ortağı araçları ekosistemiyle entegre olan açık bir platform olmasına rağmen, referans mimarileri yalnızca Azure hizmetlerine ve Databricks lakehouse'a odaklanır. Gösterilen bulut sağlayıcısı hizmetleri, kavramları göstermek için seçilir ve kapsamlı değildir.

İndirme: Azure Databricks lakehouse için başvuru mimarisi

Azure başvuru mimarisi, alma, depolama, sunma ve analiz için aşağıdaki Azure'a özgü hizmetleri gösterir:

- Lakehouse Federation için kaynak sistemler olarak Azure Synapse ve SQL Server

- Akış verisi alımı için Azure IoT Hub ve Azure Event Hubs

- Azure Data Factory ile toplu veri alma

- Veriler ve yapay zeka varlıkları için nesne depolama alanı olarak Azure Data Lake Storage 2. Nesil (ADLS)

- İşletimsel veritabanları olarak Azure SQL DB ve Azure Cosmos DB

- UC'nin şema ve köken bilgilerini dışarı aktardığı kurumsal katalog olarak Azure Purview

- BI aracı olarak Power BI

- Azure OpenAI, Model Hizmetinde dış bir LLM olarak kullanılabilir.

Başvuru mimarilerinin organizasyonu

Referans mimarisi, iş akışları boyunca, Kaynak, Alma, Dönüştürme, Sorgu/İşlem, Hizmet, Analiz ve Depolama şeklinde yapılandırılmıştır.

Source

Dış verileri Veri Zekası Platformu ile tümleştirmenin üç yolu vardır:

- ETL: Platform, yarı yapılandırılmış ve yapılandırılmamış veriler (algılayıcılar, IoT cihazları, medya, dosyalar ve günlükler gibi) ve ilişkisel veritabanlarından veya iş uygulamalarından yapılandırılmış veriler sağlayan sistemlerle tümleştirme sağlar.

- Lakehouse Federasyonu: İlişkisel veritabanları gibi SQL kaynakları, ETL olmadan lakehouse'a ve Unity Kataloğu'na entegre edilebilir. Bu durumda, kaynak sistem verileri Unity Kataloğu tarafından yönetilir ve sorgular kaynak sisteme gönderilir.

- Katalog Federasyonu: Hive Meta Veri Deposu katalogları da katalog federasyonu aracılığıyla Unity Kataloğu ile tümleştirilebilir ve Unity Kataloğu'na Hive Meta Veri Deposu'nda depolanan tabloları denetleme olanağı tanır.

Ingest

Toplu işlem veya akış yoluyla verileri lakehouse'a aktarın.

- Databricks Lakeflow Connect , kurumsal uygulamalardan ve veritabanlarından alım için yerleşik bağlayıcılar sunar. Sonuçta elde edilen veri yutma işlem hattı Unity Kataloğu tarafından yönetilir ve sunucusuz bilişim ve Pipelines tarafından desteklenir.

- Bulut depolamaya teslim edilen dosyalar Databricks Otomatik Yükleyicisi kullanılarak doğrudan yüklenebilir.

- Databricks lakehouse, kurumsal uygulamalardan Delta Lake'e toplu veri alımı için bu kayıt sistemleri için belirli bağdaştırıcılara sahip iş ortağı alma araçlarını kullanır.

- Akış olayları, Databricks Yapılandırılmış Akış kullanılarak Kafka gibi olay akış sistemlerinden doğrudan alınabiliyor. Akış kaynakları algılayıcılar, IoT veya değişiklik veri yakalama işlemleri olabilir.

Storage

- Veriler genellikle ETL işlem hatlarının verileri Delta dosyaları/tabloları veya Apache Iceberg tabloları olarak seçilmiş bir şekilde depolamak için madalyon mimarisini kullandığı bulut depolama sisteminde depolanır.

Dönüştürme ve Sorgulama /işlem

Databricks lakehouse, tüm dönüştürmeler ve sorgular için apache Spark ve Photon altyapılarını kullanır.

İşlem hatları güvenilir, sürdürülebilir ve test edilebilir veri işleme işlem hatlarını basitleştirmeye ve iyileştirmeye yönelik bildirim temelli bir çerçevedir.

Apache Spark ve Photon tarafından desteklenen Databricks Veri Zekası Platformu her iki iş yükü türünü de destekler: SQL ambarları aracılığıyla SQL sorguları ve çalışma alanı kümeleri aracılığıyla SQL, Python ve Scala iş yükleri.

Veri bilimi (ML Modelleme ve Gen AI) için Databricks AI ve Machine Learning platformu, AutoML ve ML işlerini kodlamak için özel ML çalışma zamanları sağlar. Tüm veri bilimi ve MLOps iş akışları en iyi şekilde MLflow tarafından desteklenir.

Serving

Databricks lakehouse, veri ambarı (DWH) ve BI kullanım örnekleri için Databricks SQL, SQL ambarları tarafından desteklenen veri ambarı ve sunucusuz SQL ambarları sağlar.

Makine öğrenmesi için Mozaik AI Model Sunma , Databricks kontrol düzleminde barındırılan ölçeklenebilir, gerçek zamanlı, kurumsal sınıf bir model sunma özelliğidir. Mozaik AI Ağ Geçidi , Databricks'in desteklenen üretken yapay zeka modellerine ve bunların ilişkili model sunum uç noktalarına erişimi yönetmeye ve izlemeye yönelik çözümüdür.

İşletimsel veritabanları:

- Lakebase , Postgres tabanlı ve Databricks Veri Zekası Platformu ile tamamen tümleştirilmiş bir çevrimiçi işlem işleme (OLTP) veritabanıdır. Databricks'te OLTP veritabanları oluşturmanıza ve OLTP iş yüklerini Lakehouse'unuzla tümleştirmenize olanak tanır.

- İşletimsel veritabanları gibi dış sistemler, son veri ürünlerini depolamak ve kullanıcı uygulamalarına teslim etmek için kullanılabilir.

Collaboration:

İş ortakları , Delta Sharing aracılığıyla ihtiyaç duydukları verilere güvenli erişim elde eder.

Delta Paylaşımına dayalı olarak Databricks Market , veri ürünleri alışverişi için açık bir forumdur.

Temiz Odalar , birden çok kullanıcının birbirlerinin verilerine doğrudan erişmeden hassas kurumsal veriler üzerinde birlikte çalışabileceği güvenli ve gizliliği koruyan ortamlardır.

Analysis

Nihai iş uygulamaları bu kulvarda yer alır. Örnekler arasında gerçek zamanlı çıkarım için Mozaik Yapay Zeka Modeli Sunma'ya bağlı yapay zeka uygulamaları gibi özel istemciler veya göl evinden işletimsel veritabanına gönderilen verilere erişen uygulamalar yer alır.

BI kullanım örnekleri için analistler genellikle veri ambarlarına erişmek için BI araçlarını kullanır. SQL geliştiricileri ayrıca sorgular ve pano oluşturma için Databricks SQL Düzenleyicisi'ni (diyagramda gösterilmez) kullanabilir.

Veri Zekası Platformu ayrıca veri görselleştirmeleri oluşturmak ve içgörüleri paylaşmak için panolar sunar.

Integrate

- Databricks platformu , kullanıcı yönetimi ve çoklu oturum açma (SSO) için standart kimlik sağlayıcılarıyla tümleştirilir.

OpenAI, LangChain veya HuggingFace gibi dış yapay zeka hizmetleri doğrudan Databricks Intelligence Platform'un içinden kullanılabilir.

Dış düzenleyiciler kapsamlı

REST API veya apache Airflowgibi dış düzenleme araçlarına ayrılmış bağlayıcıları kullanabilir. Unity Kataloğu, Databricks Intelligence Platform'daki tüm veri ve yapay zeka idaresi için kullanılır ve Lakehouse Federation aracılığıyla diğer veritabanlarını kendi idaresiyle tümleştirebilir.

Ayrıca Unity Kataloğu, purview gibi diğer kurumsal kataloglarla tümleştirilebilir. Ayrıntılar için kurumsal katalog satıcısına başvurun.

Tüm iş yükleri için ortak özellikler

Ayrıca Databricks lakehouse, tüm iş yüklerini destekleyen yönetim özellikleriyle birlikte gelir:

Veri ve yapay zeka idaresi

Databricks Veri Zekası Platformu'ndaki merkezi veriler ve yapay zeka idare sistemi Unity Kataloğu'dur. Unity Kataloğu, tüm çalışma alanlarında geçerli olan veri erişim ilkelerini yönetmek için tek bir yer sağlar ve tablolar, birimler, özellikler (özellik deposu) ve modeller (model kayıt defteri) gibi göl evinde oluşturulan veya kullanılan tüm varlıkları destekler. Unity Kataloğu, Databricks'te çalıştırılacak sorgular arasında çalışma zamanı veri kökenini yakalamak için de kullanılabilir.

Databricks Veri Kalitesi İzleme , hesabınızdaki tüm tabloların veri kalitesini izlemenizi sağlar. Tüm tablolarınızdaki anomalileri algılar ve her tablo için tam veri profili sağlar.

Gözlemlenebilirlik için sistem tabloları , hesabınızın işletimsel verilerinin Databricks tarafından barındırılan bir analiz deposudur. Sistem tabloları, hesabınızdaki geçmiş gözlemlenebilirlik için kullanılabilir.

Veri zekası altyapısı

Databricks Veri Zekası Platformu, kuruluşunuzun tamamının verileri ve yapay zekayı kullanabilmesine olanak tanırken, üretken yapay zekayı bir lakehouse'un birleştirme avantajlarıyla birleştirerek verilerinizin benzersiz semantiğini anlamanıza yardımcı olur. Bkz. Databricks AI yardımcı özellikleri.

Genie Code , Databricks not defterlerinde, SQL düzenleyicisinde, dosya düzenleyicisinde ve başka bir yerde kullanıcılar için bağlama duyarlı bir yapay zeka yardımcısı olarak kullanılabilir.

Otomasyon ve Düzenleme

Lakeflow İşleri Databricks Veri Zekası Platformu'nda veri işleme, makine öğrenmesi ve analiz işlem hatlarını düzenler. Lakeflow Spark Bildirimli İşlem Hatları , bildirim temelli söz dizimi ile güvenilir ve sürdürülebilir ETL işlem hatları oluşturmanıza olanak sağlar. Platform CI/CD ve MLOps'u da destekler

Azure'da Veri Zekası Platformu için üst düzey kullanım örnekleri

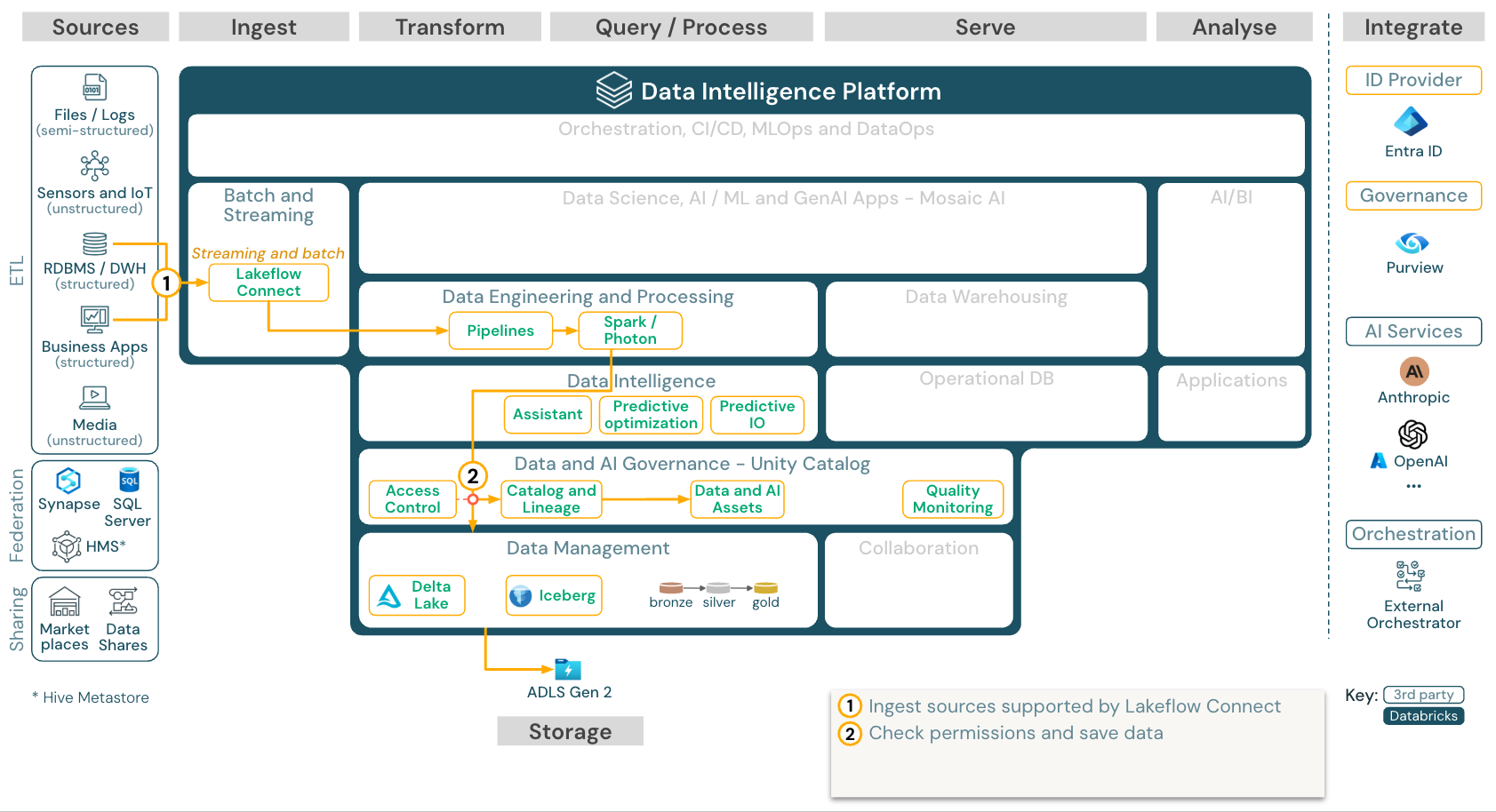

Lakeflow Connect ile SaaS uygulamalarından ve veritabanlarından yerleşik veri alma

Azure Databricks'te LFC kullanarak veri alımı

İndir: Azure Databricks için Lakeflow Connect başvuru mimarisi.

Databricks Lakeflow Connect , kurumsal uygulamalardan ve veritabanlarından alım için yerleşik bağlayıcılar sunar. Sonuçta elde edilen veri alım hattı, Unity Catalog tarafından yönetilmektedir ve sunucusuz işlem ile Lakeflow Spark Deklaratif İşlem Hatları tarafından desteklenmektedir.

Lakeflow Connect, veri alımını daha hızlı, ölçeklenebilir ve daha uygun maliyetli hale getirmek için verimli artımlı okuma ve yazma işlemlerinden yararlanırken, verileriniz aşağı akış tüketimi için güncel kalır.

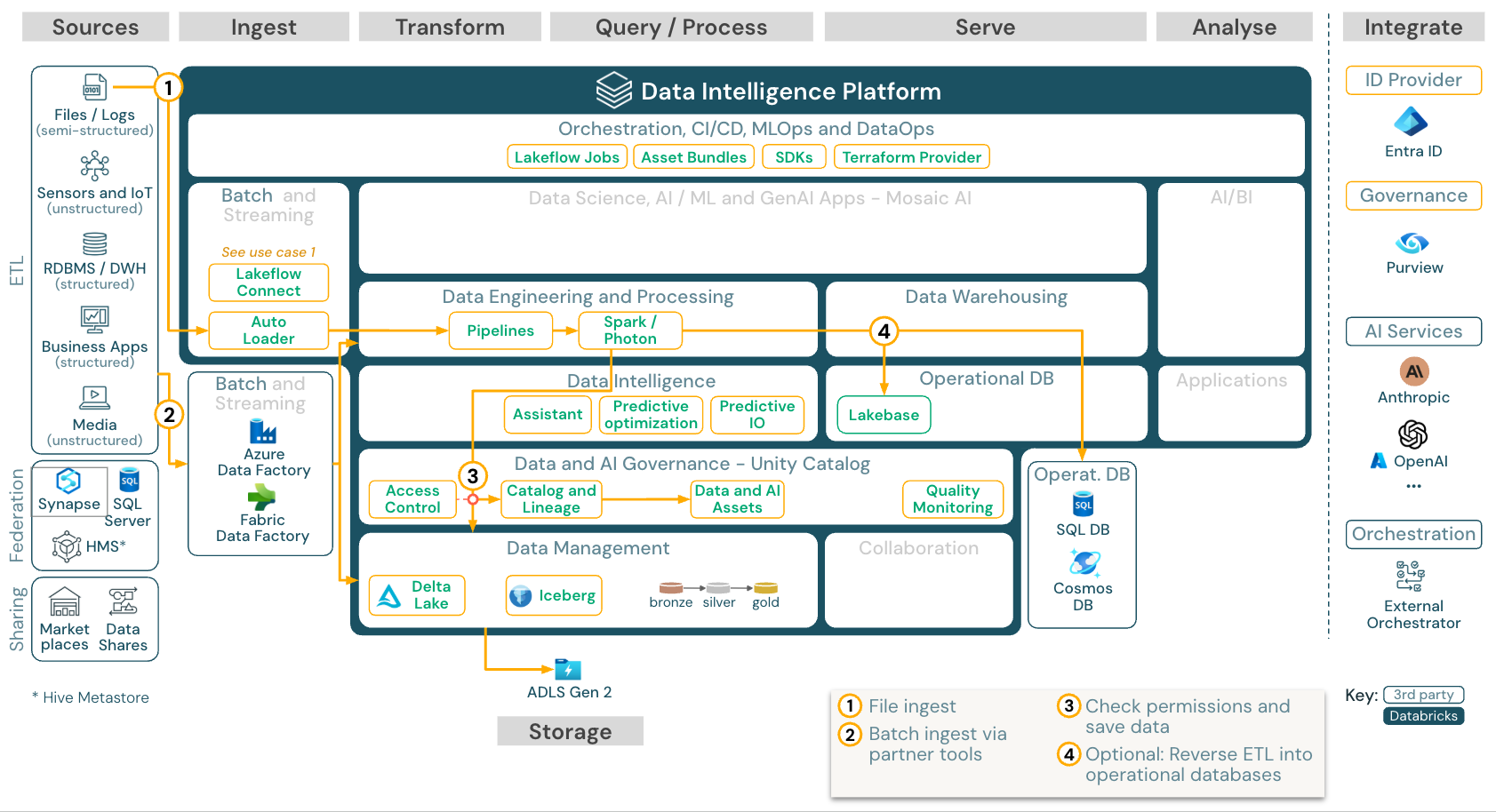

Toplu veri alımı ve ETL

İndirme: Azure Databricks için Batch ETL başvuru mimarisi

Alma araçları, kaynaktaki verileri okumak için kaynağa özgü bağdaştırıcıları kullanır ve ardından verileri Auto Loader'ın okuyabileceği bulut depolama alanına depolar veya doğrudan Databricks'i çağırır (örneğin, Databricks lakehouse ile entegre edilmiş iş ortağı alma araçlarıyla). Verileri yüklemek için Databricks ETL ve işleme altyapısı sorguları pipelines aracılığıyla çalıştırır. Lakeflow İşleri'ni kullanarak tek veya çok görevli işleri düzenleme ve Unity Kataloğu'nu (erişim denetimi, denetim, köken vb.) kullanarak bunları yönetme. Düşük gecikmeli işletim sistemleri için belirli altın tablolara erişim sağlamak için, tabloları ETL işlem hattının sonundaki RDBMS veya anahtar-değer deposu gibi bir işletimsel veritabanına aktarın.

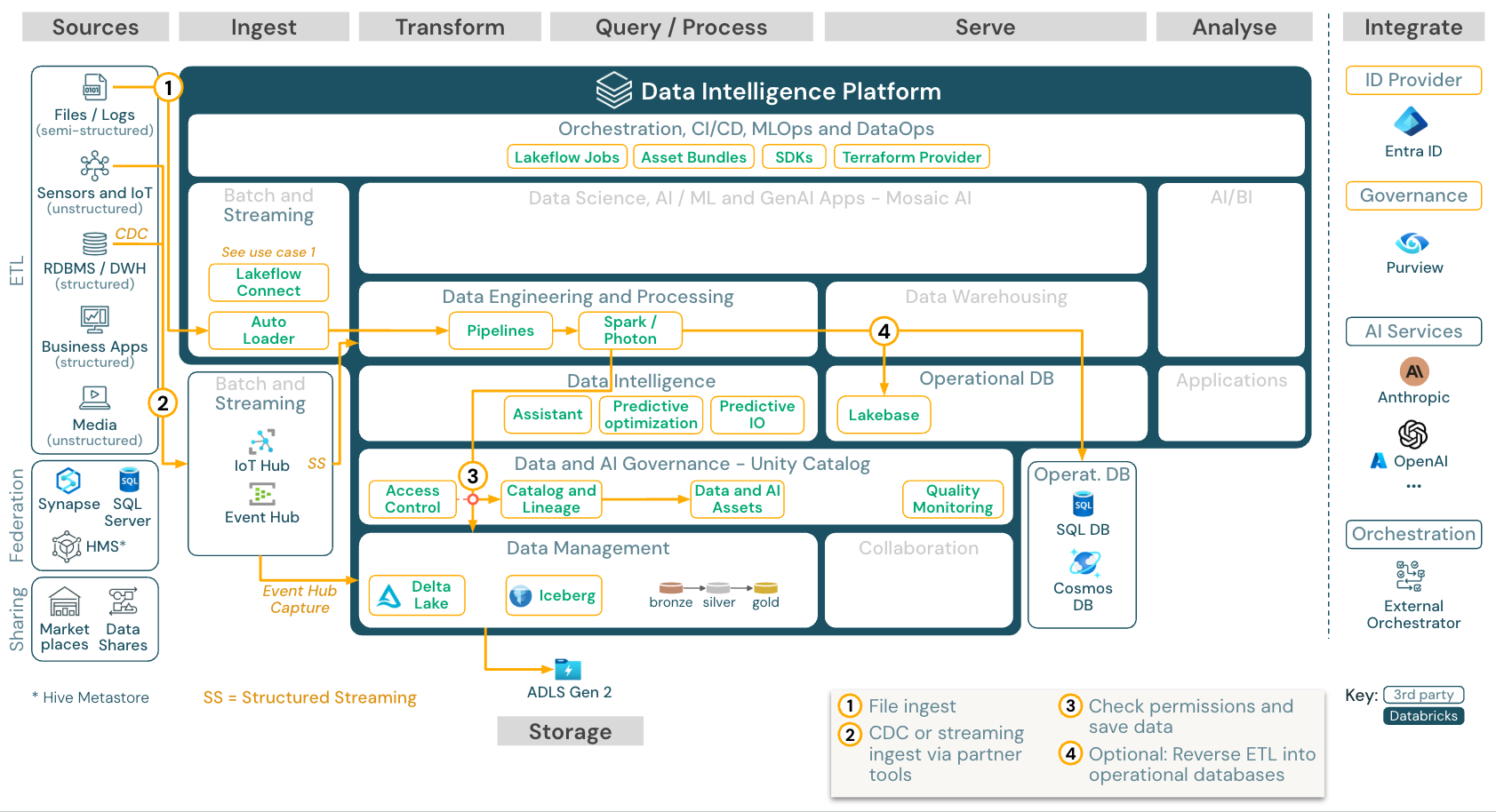

Akış ve değişiklik veri yakalama (CDC)

İndirme: Azure Databricks için Spark yapılandırılmış akış mimarisi

Databricks ETL altyapısı, Apache Kafka veya Azure Event Hub gibi olay kuyruklarından okumak için Spark Yapılandırılmış Akış kullanır. Aşağı akış adımları, yukarıdaki Batch kullanım örneğinin yaklaşımını izler.

Gerçek zamanlı değişiklik veri yakalama (CDC) genellikle ayıklanan olayları bir olay kuyruğunda depolar. Buradan itibaren, kullanım örneği akış kullanım senaryosunu takip eder.

CDC, toplu olarak yapılırsa ve ayıklanan kayıtlar önce bulut depolamada saklanırsa, Databricks Auto Loader bunları okuyabilir ve bu kullanım durumu Batch ETL sürecini takip eder.

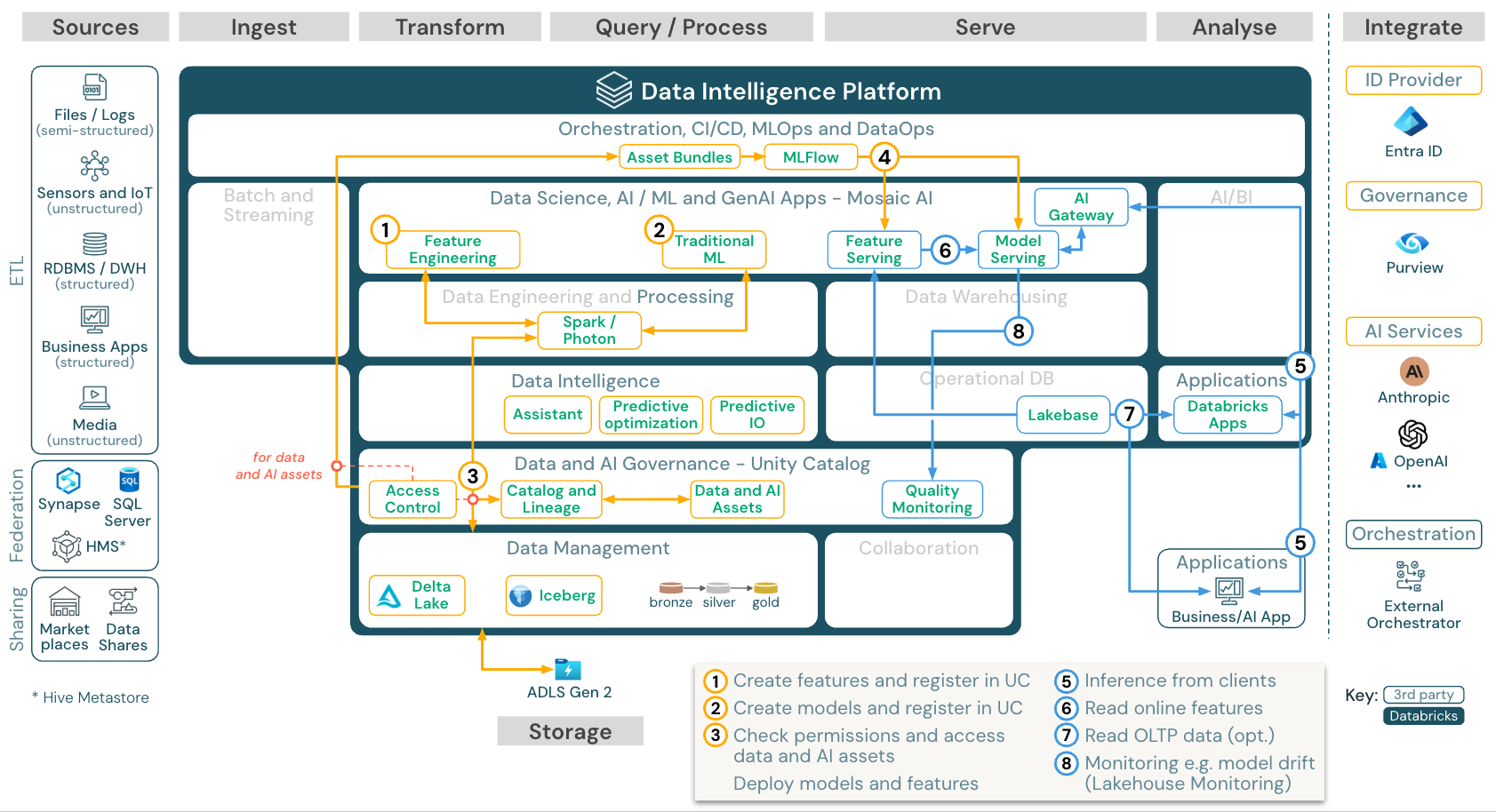

Makine öğrenmesi ve yapay zeka (geleneksel)

İndirme: Azure Databricks için makine öğrenmesi ve yapay zeka başvuru mimarisi

Databricks Veri Zekası Platformu, makine öğrenmesi için en son özelliklere sahip makine ve derin öğrenme kitaplıklarıyla birlikte gelen Mozaik AI sunar. Özellik Deposu ve Model Kayıt Defteri (her ikisi de Unity Kataloğu ile tümleşik), AutoML ile düşük kod özellikleri ve veri bilimi yaşam döngüsüyle MLflow tümleştirmesi gibi özellikler sağlar.

Unity Kataloğu, veri bilimiyle ilgili tüm varlıkları (tablolar, özellikler ve modeller) yönetir ve veri bilimciler işlerini yönetmek için Lakeflow İşleri'ni kullanabilir.

Modelleri ölçeklenebilir ve kurumsal düzeyde dağıtmak için MLOps özelliklerini kullanarak modelleri model sunmada yayımlayın.

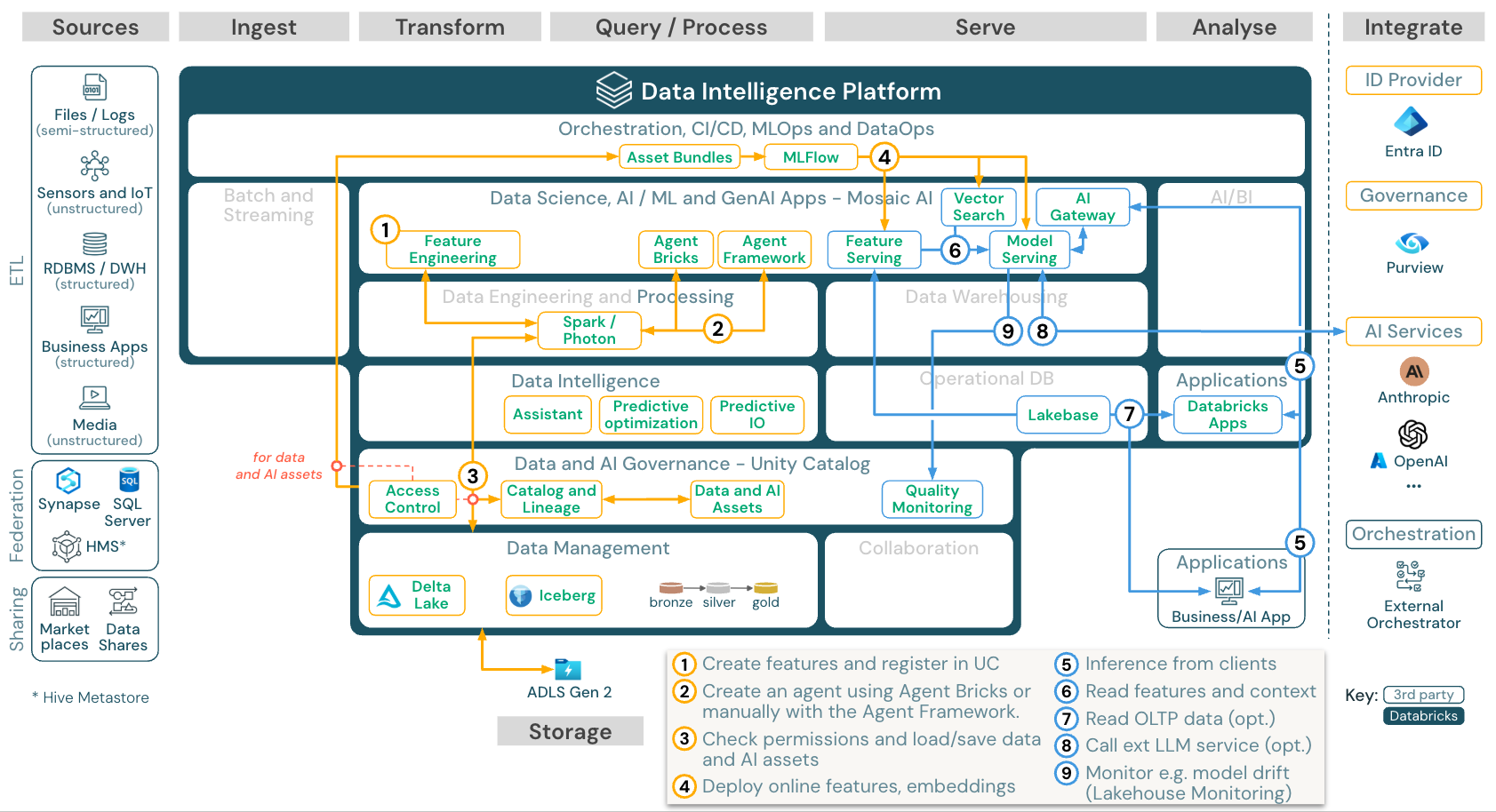

AI Aracısı uygulamaları (Gen AI)

İndirme: Azure Databricks için Gen AI uygulama başvuru mimarisi

Modelleri ölçeklenebilir ve kurumsal düzeyde dağıtmak için MLOps özelliklerini kullanarak modelleri model sunmada yayımlayın.

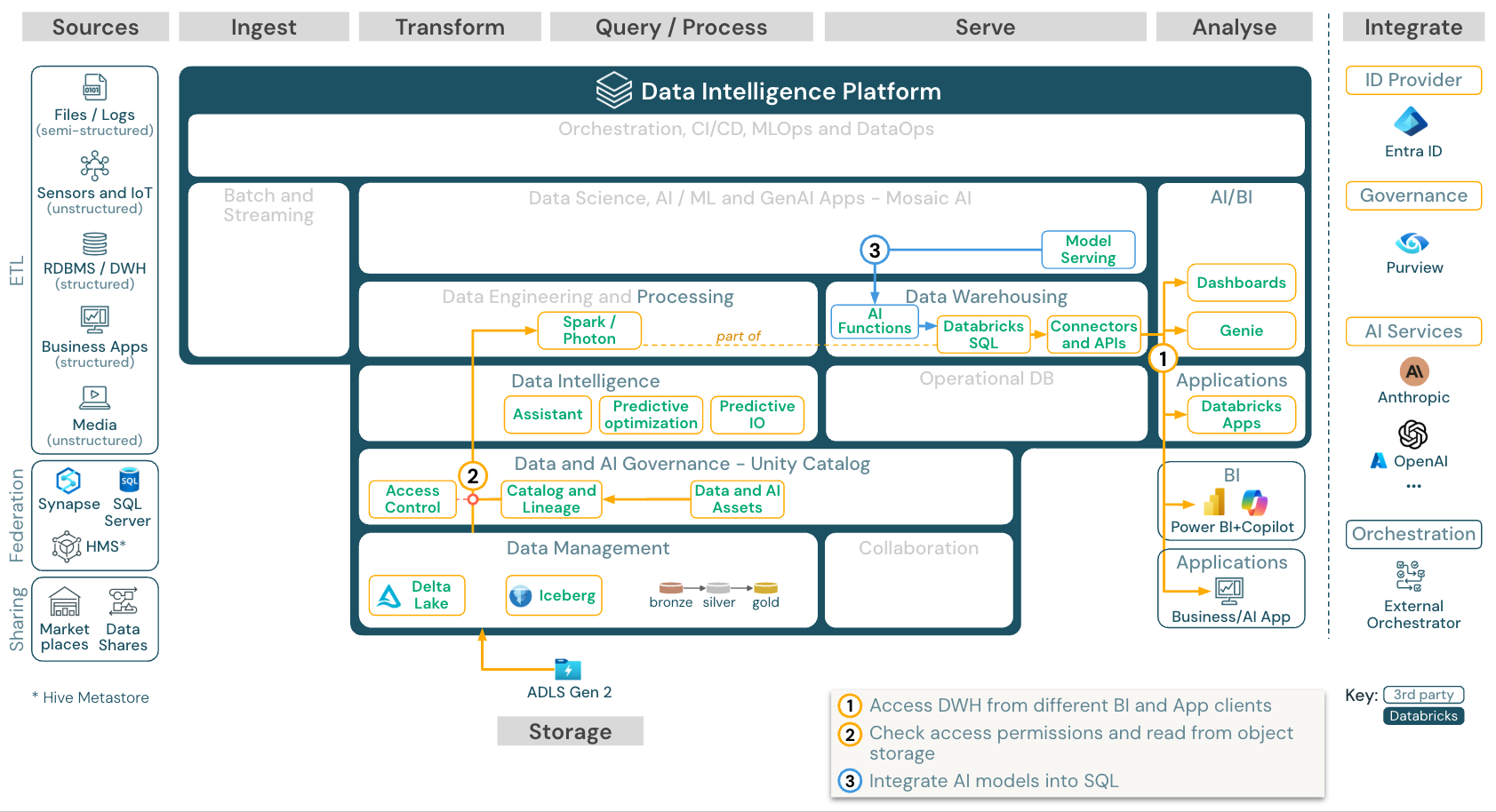

BI ve SQL analizi

İndirme: Azure Databricks için BI ve SQL analizi başvuru mimarisi

İş analistleri, IŞ zekası kullanım örnekleri için panoları, Databricks SQL düzenleyicisini veya Tableau veya Power BI gibi BI araçlarını kullanabilir. Her durumda, altyapı Databricks SQL 'dir (sunucusuz veya sunucusuz değildir) ve Unity Kataloğu veri bulma, araştırma ve erişim denetimi sağlar.

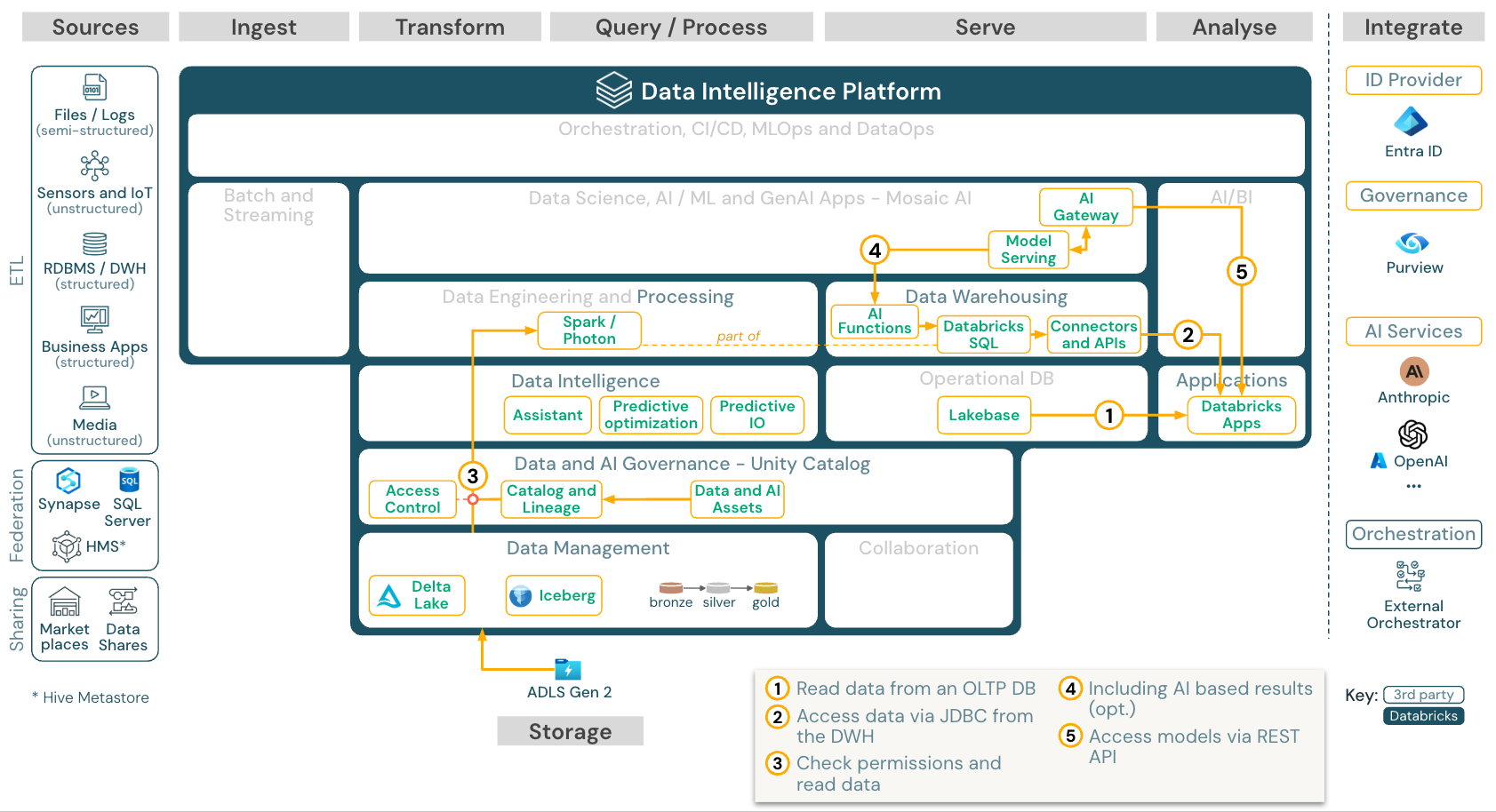

İş Uygulamaları

İndirme: Azure Databricks için Business Apps for Databricks

Databricks Uygulamaları , geliştiricilerin güvenli verileri ve yapay zeka uygulamalarını doğrudan Databricks platformunda oluşturup dağıtarak ayrı altyapı gereksinimini ortadan kaldırır. Uygulamalar Databricks sunucusuz platformunda barındırılır ve temel platform hizmetleriyle tümleştirilir. Uygulamanın Lakehouse'dan eşitlenmiş OLTP verilerine ihtiyacı varsa Lakebase'i kullanın.

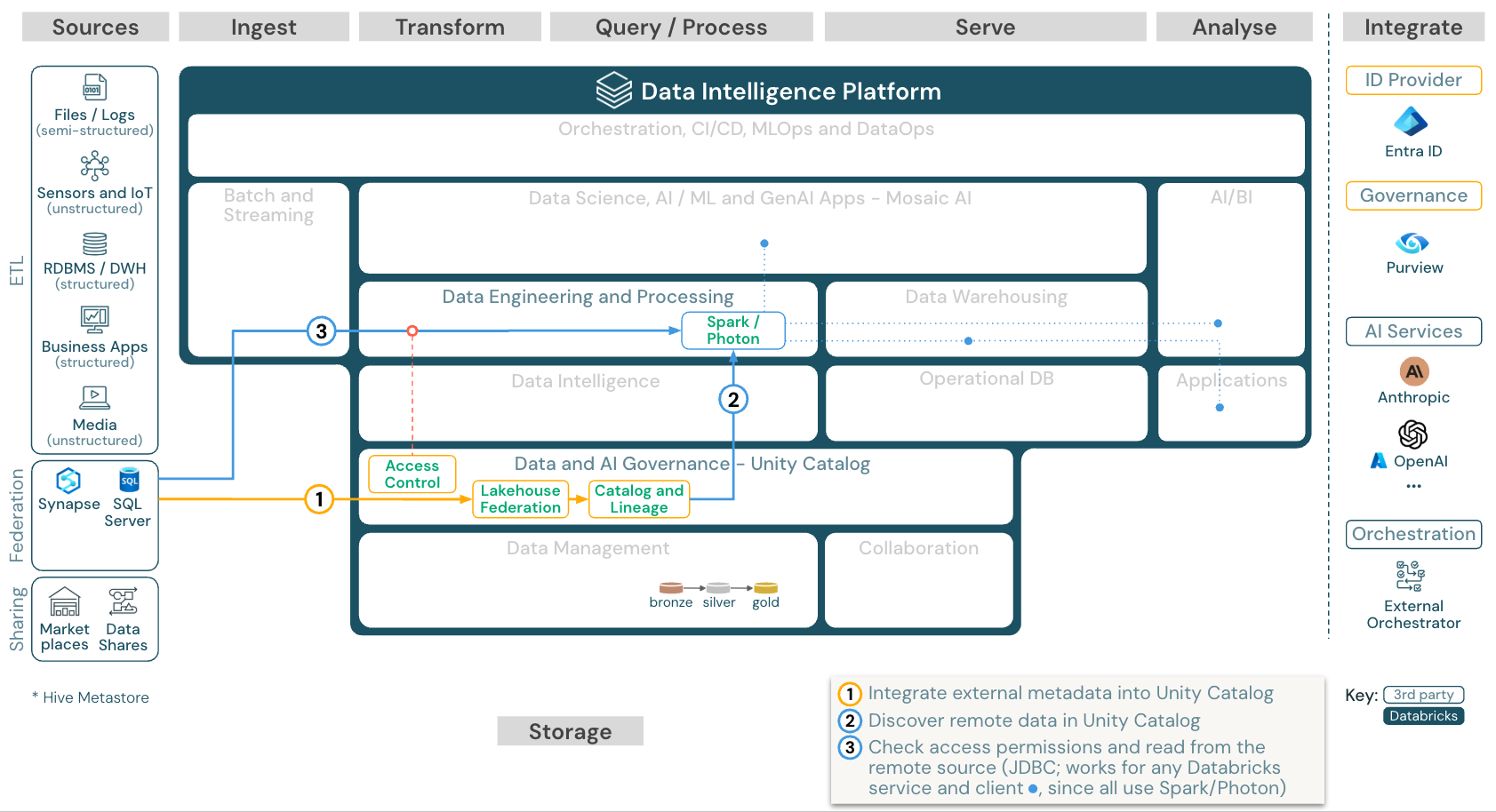

Lakehouse federasyonu

İndir: Azure Databricks için Lakehouse federasyonu başvuru mimarisi

Lakehouse Federation dış veri SQL veritabanlarının (MySQL, Postgres, SQL Server veya Azure Synapse gibi) Databricks ile tümleştirilmesine olanak tanır.

Tüm iş yükleri (AI, DWH ve BI), verileri önce ETL işlemine tabi tutarak nesne depolamaya aktarmaya gerek kalmadan bundan faydalanabilir. Dış kaynak kataloğu Unity kataloğuna eşlenir ve Databricks platformu aracılığıyla erişime ayrıntılı erişim denetimi uygulanabilir.

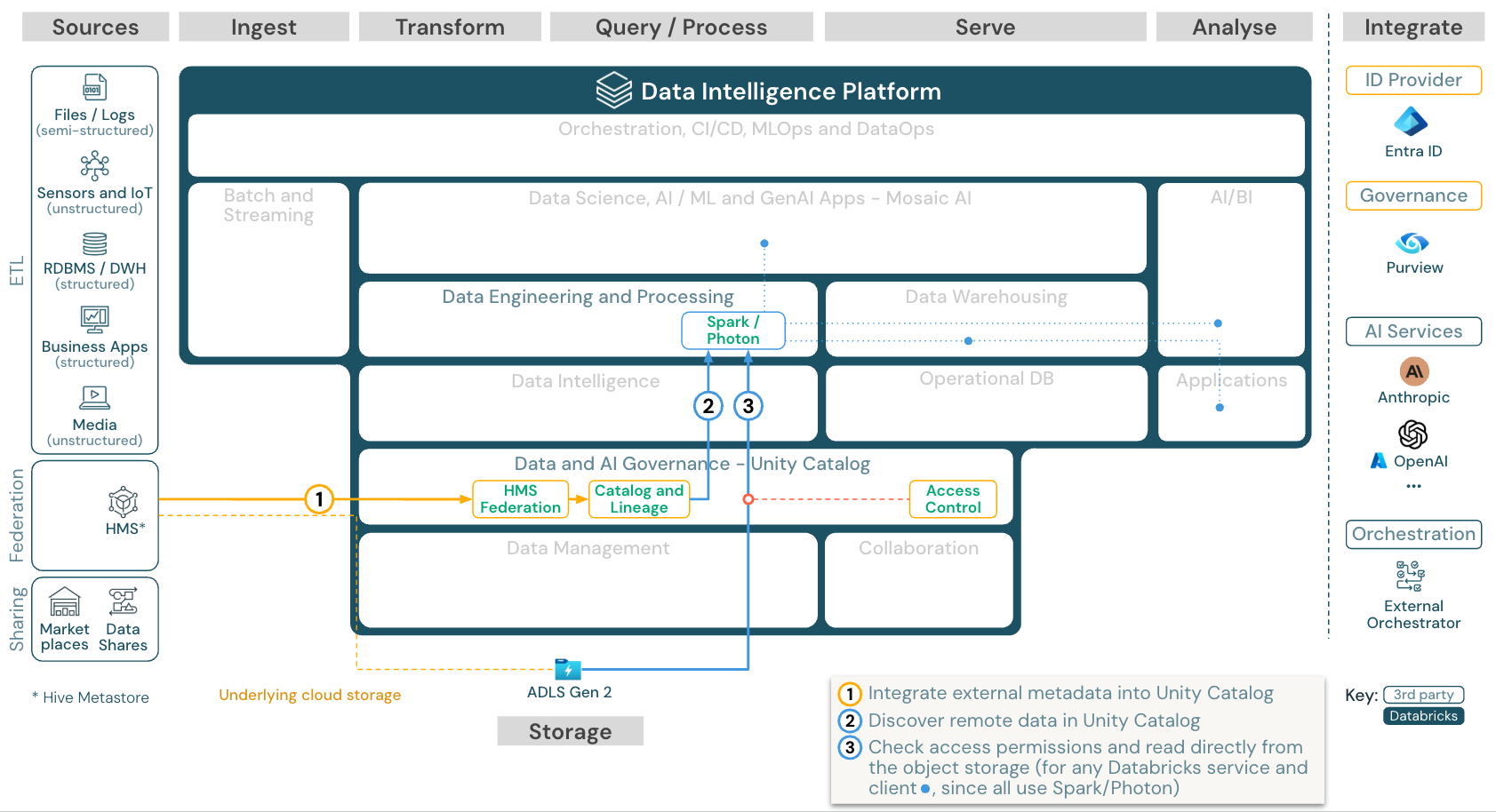

Katalog birleştirme

İndirme: Azure Databricks için katalog federasyon başvuru mimarisi

Katalog federasyonu dış Hive Meta veri depolarının (MySQL, Postgres, SQL Server veya Azure Synapse gibi) Databricks ile tümleştirilmesine olanak tanır.

Tüm iş yükleri (AI, DWH ve BI), verileri önce ETL işlemine tabi tutarak nesne depolamaya aktarmaya gerek kalmadan bundan faydalanabilir. Dış kaynak kataloğu, Databricks platformu aracılığıyla ayrıntılı erişim denetiminin uygulandığı Unity Kataloğu'na eklenir.

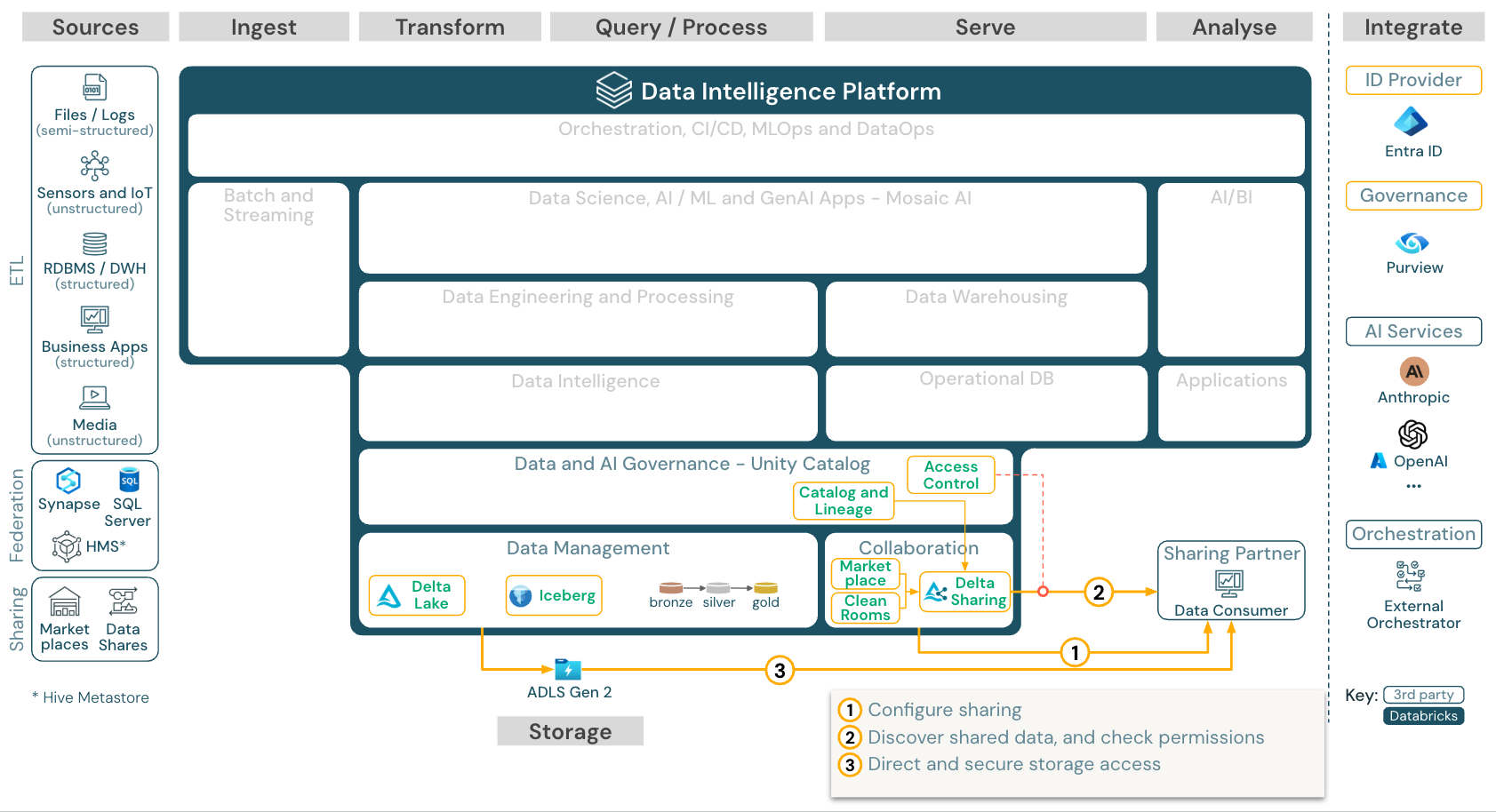

Üçüncü taraf araçlarıyla Veri Paylaşma

İndirme: Azure Databricks için 3. taraf araçlar başvuru mimarisiyle veri paylaşma

Üçüncü taraflarla kurumsal düzeyde veri paylaşımı Delta Sharing tarafından sağlanır. Unity Kataloğu tarafından güvenliği sağlanan nesne deposundaki verilere doğrudan erişim sağlar. Bu özellik, veri ürünleri alışverişi için açık bir forum olan Databricks Market'te de kullanılır.

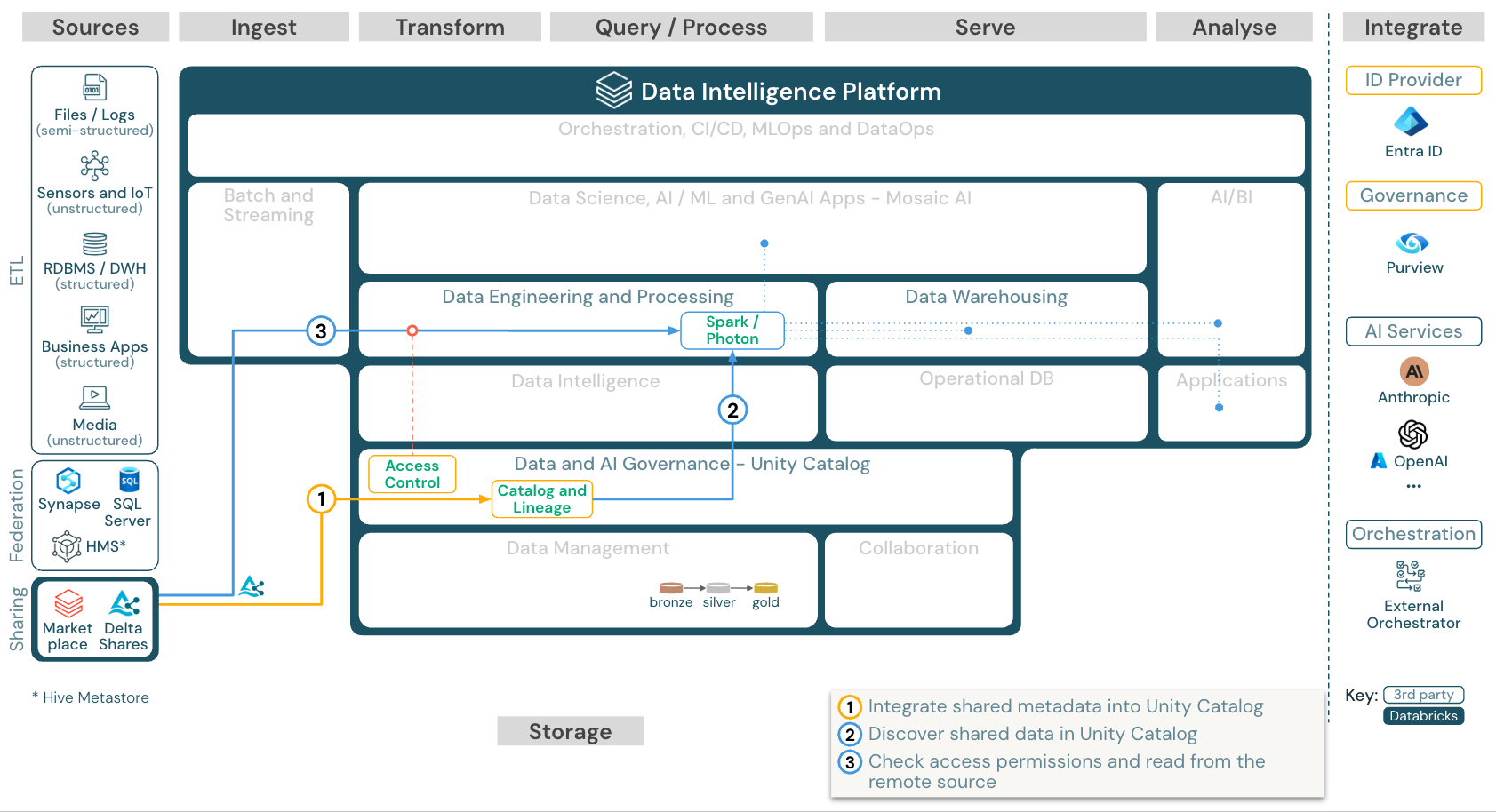

Databricks'ten paylaşılan verileri kullanma

İndirme: Azure Databricks için Databricks başvuru mimarisinden paylaşılan verileri kullanma

Delta Sharing Databricks-To-Databricks protokolü, kullanıcının Unity Kataloğu için etkinleştirilmiş bir çalışma alanına erişimi olduğu sürece hesap veya bulut konağı ne olursa olsun tüm Databricks kullanıcılarıyla güvenli bir şekilde veri paylaşmasına olanak tanır.