Menyalin dan mengubah data di Microsoft Fabric Lakehouse menggunakan Azure Data Factory atau Azure Synapse Analytics

BERLAKU UNTUK:  Azure Data Factory

Azure Data Factory  Azure Synapse Analytics

Azure Synapse Analytics

Tip

Cobalah Data Factory di Microsoft Fabric, solusi analitik all-in-one untuk perusahaan. Microsoft Fabric mencakup semuanya mulai dari pergerakan data hingga ilmu data, analitik real time, kecerdasan bisnis, dan pelaporan. Pelajari cara memulai uji coba baru secara gratis!

Microsoft Fabric Lakehouse adalah platform arsitektur data untuk menyimpan, mengelola, dan menganalisis data terstruktur dan tidak terstruktur dalam satu lokasi. Untuk mencapai akses data yang mulus di semua mesin komputasi di Microsoft Fabric, buka Tabel Lakehouse dan Delta untuk mempelajari lebih lanjut. Secara default, data ditulis ke Lakehouse Table dalam V-Order, dan Anda dapat membuka pengoptimalan tabel Delta Lake dan V-Order untuk informasi selengkapnya.

Artikel ini menguraikan cara menggunakan aktivitas Salin untuk menyalin data dari dan ke Microsoft Fabric Lakehouse dan menggunakan Aliran Data untuk mengubah data di Microsoft Fabric Lakehouse. Untuk mempelajari lebih lanjut, baca artikel pengantar untuk Azure Data Factory atau Azure Synapse Analytics.

Kemampuan yang didukung

Konektor Microsoft Fabric Lakehouse ini didukung untuk kemampuan berikut:

| Kemampuan yang didukung | IR |

|---|---|

| Salin aktivitas (sumber/sink) | (1) (2) |

| Memetakan aliran data (sumber/sink) | (1) |

| Aktivitas pencarian | (1) (2) |

| Aktivitas GetMetadata | (1) (2) |

| Aktivitas penghapusan | (1) (2) |

① Runtime integrasi Azure ② Runtime integrasi yang dihost sendiri

Memulai

Untuk melakukan aktivitas Salin dengan alur, Anda dapat menggunakan salah satu alat atau SDK berikut:

- Alat Penyalinan Data

- Portal Microsoft Azure

- SDK .NET

- SDK Python

- Azure PowerShell

- REST API

- Templat Azure Resource Manager

Membuat layanan tertaut Microsoft Fabric Lakehouse menggunakan UI

Gunakan langkah-langkah berikut untuk membuat layanan tertaut Microsoft Fabric Lakehouse di antarmuka pengguna portal Azure.

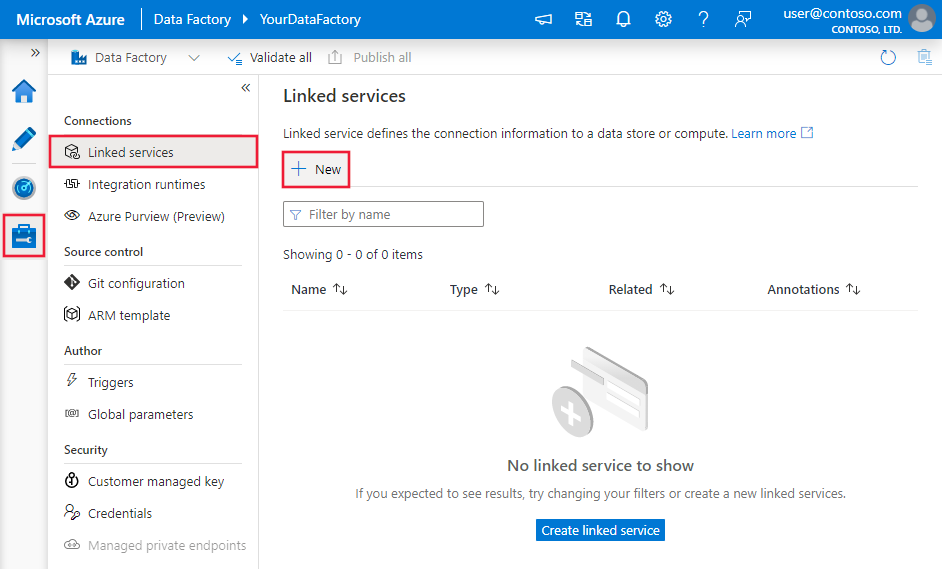

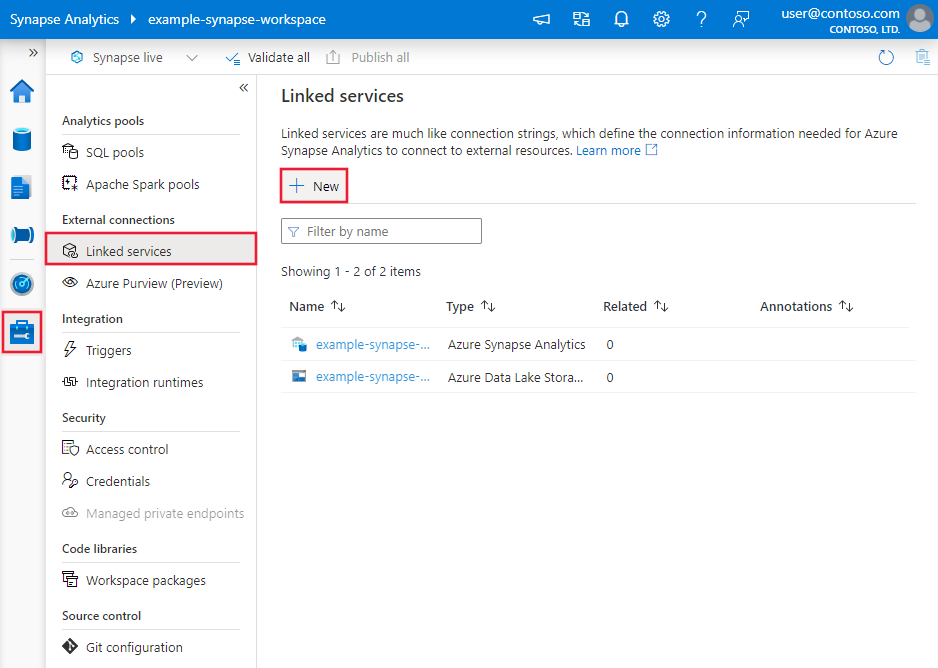

Telusuri ke tab Kelola di ruang kerja Azure Data Factory atau Synapse Anda dan pilih Layanan Tertaut, lalu pilih Baru:

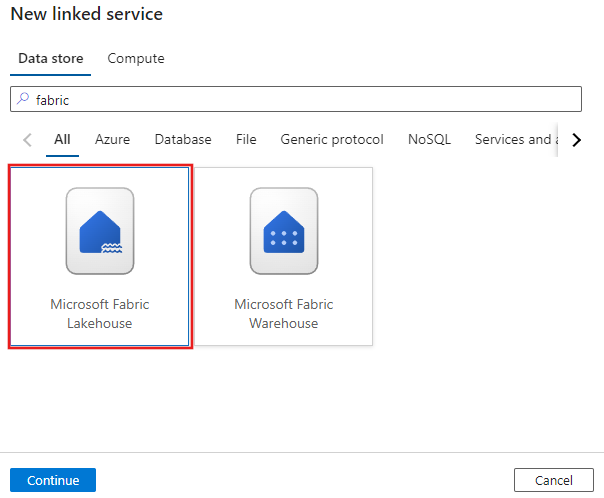

Cari Microsoft Fabric Lakehouse dan pilih konektor.

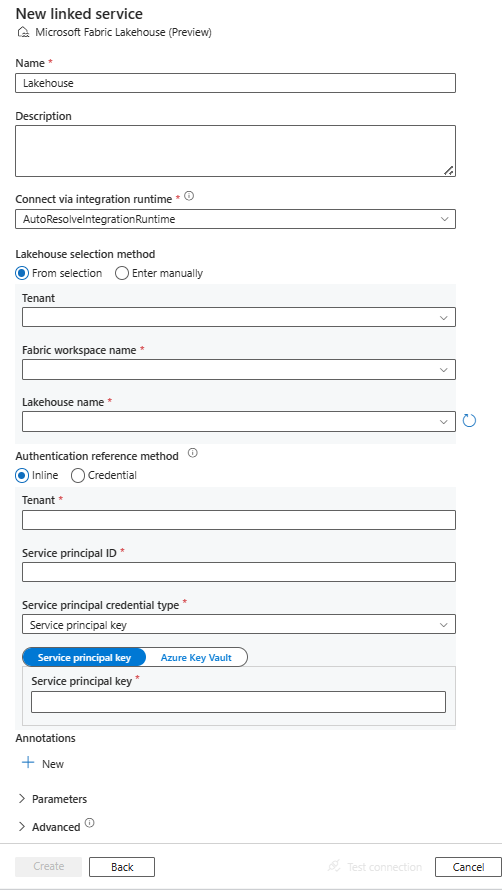

Konfigurasikan detail layanan, uji koneksi, dan buat layanan tertaut baru.

Detail konfigurasi konektor

Bagian berikut ini menyediakan detail tentang properti yang digunakan untuk menentukan entitas Data Factory khusus untuk Microsoft Fabric Lakehouse.

Properti layanan tertaut

Konektor Microsoft Fabric Lakehouse mendukung jenis autentikasi berikut. Lihat bagian terkait untuk detailnya:

Autentikasi perwakilan layanan

Untuk menggunakan autentikasi perwakilan layanan, ikuti langkah-langkah berikut ini.

Daftarkan aplikasi dengan platform Identitas Microsoft dan tambahkan rahasia klien. Setelah itu, catat nilai-nilai ini, yang Anda gunakan untuk menentukan layanan tertaut:

- ID aplikasi (klien), yang merupakan ID perwakilan layanan dalam layanan tertaut.

- Nilai rahasia klien, yang merupakan kunci perwakilan layanan dalam layanan tertaut.

- ID Penyewa

Berikan perwakilan layanan setidaknya peran Kontributor di ruang kerja Microsoft Fabric. Ikuti langkah-langkah ini:

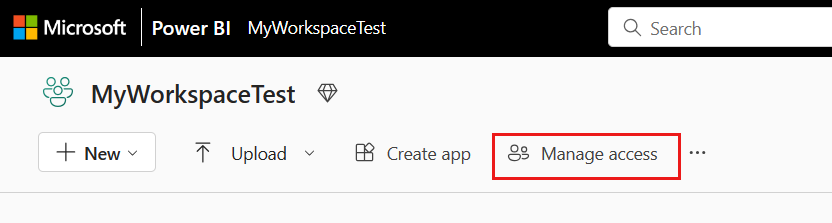

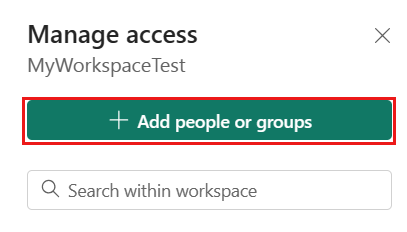

Buka ruang kerja Microsoft Fabric Anda, pilih Kelola akses di bilah atas. Lalu pilih Tambahkan orang atau grup.

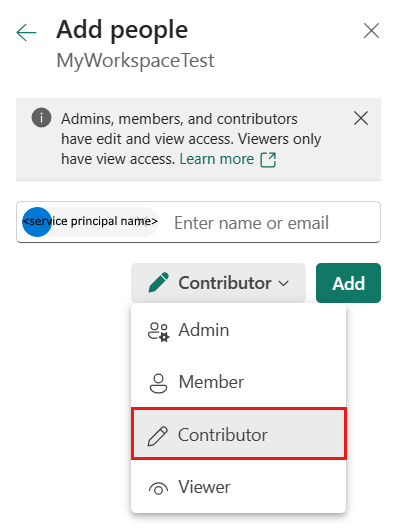

Di panel Tambahkan orang , masukkan nama perwakilan layanan Anda, dan pilih perwakilan layanan Anda dari daftar drop-down.

Catatan

Perwakilan layanan tidak akan muncul di daftar Tambahkan orang kecuali pengaturan penyewa Power BI mengaktifkan akses perwakilan layanan ke FABRIC API.

Tentukan peran sebagai Kontributor atau yang lebih tinggi (Admin, Anggota), lalu pilih Tambahkan.

Perwakilan layanan Anda ditampilkan di panel Kelola akses .

Properti ini didukung untuk layanan tertaut:

| Properti | Deskripsi | Wajib |

|---|---|---|

| jenis | Properti jenis harus diatur ke Lakehouse. | Ya |

| workspaceId | ID ruang kerja Microsoft Fabric. | Ya |

| artifactId | ID objek Microsoft Fabric Lakehouse. | Ya |

| penyewa | Tentukan informasi penyewa (nama domain atau ID penyewa) tempat aplikasi Anda berada. Ambil dengan mengarahkan mouse ke sudut kanan atas portal Microsoft Azure. | Ya |

| servicePrincipalId | Menentukan ID klien aplikasi. | Ya |

| servicePrincipalCredentialType | Jenis informasi masuk yang digunakan untuk autentikasi perwakilan layanan. Nilai yang diizinkan adalah ServicePrincipalKey dan ServicePrincipalCert. | Ya |

| servicePrincipalCredential | Informasi masuk perwakilan layanan. Saat Anda menggunakan ServicePrincipalKey sebagai jenis kredensial, tentukan nilai rahasia klien aplikasi. Tandai bidang ini sebagai SecureString untuk menyimpannya dengan aman, atau lihat rahasia yang disimpan di Azure Key Vault. Saat Anda menggunakan ServicePrincipalCert sebagai kredensial, rujuk sertifikat di Azure Key Vault, dan pastikan jenis konten sertifikatnya adalah PKCS #12. |

Ya |

| connectVia | Runtime integrasi yang akan digunakan untuk menyambungkan ke penyimpanan data. Anda dapat menggunakan runtime integrasi Azure atau runtime integrasi yang dihost sendiri jika penyimpanan data Anda berada di jaringan privat. Jika tidak ditentukan, runtime integrasi Azure default digunakan. | No |

Contoh: menggunakan autentikasi kunci perwakilan layanan

Anda juga dapat menyimpan kunci perwakilan layanan di Azure Key Vault.

{

"name": "MicrosoftFabricLakehouseLinkedService",

"properties": {

"type": "Lakehouse",

"typeProperties": {

"workspaceId": "<Microsoft Fabric workspace ID>",

"artifactId": "<Microsoft Fabric Lakehouse object ID>",

"tenant": "<tenant info, e.g. microsoft.onmicrosoft.com>",

"servicePrincipalId": "<service principal id>",

"servicePrincipalCredentialType": "ServicePrincipalKey",

"servicePrincipalCredential": {

"type": "SecureString",

"value": "<service principal key>"

}

},

"connectVia": {

"referenceName": "<name of Integration Runtime>",

"type": "IntegrationRuntimeReference"

}

}

}

Properti himpunan data

Konektor Microsoft Fabric Lakehouse mendukung dua jenis himpunan data, yaitu himpunan data Microsoft Fabric Lakehouse Files dan himpunan data Microsoft Fabric Lakehouse Table. Lihat bagian terkait untuk detailnya.

Untuk daftar lengkap bagian dan properti yang tersedia untuk menentukan himpunan data, lihat Himpunan data.

Himpunan data Microsoft Fabric Lakehouse Files

Konektor Microsoft Fabric Lakehouse mendukung format file berikut. Lihat setiap artikel untuk mengetahui cara melakukan pengaturan berbasis format.

Properti berikut ini didukung di bawah location pengaturan dalam himpunan data Microsoft Fabric Lakehouse Files berbasis format:

| Properti | Deskripsi | Wajib |

|---|---|---|

| jenis | Properti jenis di bawah location dalam himpunan data harus diatur ke LakehouseLocation. |

Ya |

| folderPath | Jalur ke folder. Jika Anda ingin menggunakan kartubebas untuk memfilter folder, lewati pengaturan ini dan tentukan dalam pengaturan sumber aktivitas. | No |

| fileName | Nama file di folderPath yang diberikan. Jika Anda ingin menggunakan kartubebas untuk memfilter file, lewati pengaturan ini dan tentukan dalam pengaturan sumber aktivitas. | No |

Contoh:

{

"name": "DelimitedTextDataset",

"properties": {

"type": "DelimitedText",

"linkedServiceName": {

"referenceName": "<Microsoft Fabric Lakehouse linked service name>",

"type": "LinkedServiceReference"

},

"typeProperties": {

"location": {

"type": "LakehouseLocation",

"fileName": "<file name>",

"folderPath": "<folder name>"

},

"columnDelimiter": ",",

"compressionCodec": "gzip",

"escapeChar": "\\",

"firstRowAsHeader": true,

"quoteChar": "\""

},

"schema": [ < physical schema, optional, auto retrieved during authoring > ]

}

}

Himpunan data Microsoft Fabric Lakehouse Table

Properti berikut ini didukung untuk himpunan data Microsoft Fabric Lakehouse Table:

| Properti | Deskripsi | Wajib |

|---|---|---|

| jenis | Properti jenis himpunan data harus diatur ke LakehouseTable. | Ya |

| skema | Nama skema. Jika tidak ditentukan, nilai defaultnya adalah dbo. |

No |

| tabel | Nama tabel Anda. | Ya |

Contoh:

{

"name": "LakehouseTableDataset",

"properties": {

"type": "LakehouseTable",

"linkedServiceName": {

"referenceName": "<Microsoft Fabric Lakehouse linked service name>",

"type": "LinkedServiceReference"

},

"typeProperties": {

"schema": "<schema_name>",

"table": "<table_name>"

},

"schema": [< physical schema, optional, retrievable during authoring >]

}

}

Properti aktivitas salin

Properti aktivitas salin untuk himpunan data Microsoft Fabric Lakehouse Files dan himpunan data Microsoft Fabric Lakehouse Table berbeda. Lihat bagian terkait untuk detailnya.

- Microsoft Fabric Lakehouse Files dalam aktivitas Salin

- Microsoft Fabric Lakehouse Table dalam aktivitas Salin

Untuk daftar lengkap bagian dan properti yang tersedia untuk menentukan aktivitas, lihat Konfigurasi aktivitas penyalinan dan alur dan aktivitas.

Microsoft Fabric Lakehouse Files dalam aktivitas Salin

Untuk menggunakan jenis himpunan data Microsoft Fabric Lakehouse Files sebagai sumber atau sink dalam aktivitas Salin, buka bagian berikut untuk konfigurasi terperinci.

Microsoft Fabric Lakehouse Files sebagai jenis sumber

Konektor Microsoft Fabric Lakehouse mendukung format file berikut. Lihat setiap artikel untuk mengetahui cara melakukan pengaturan berbasis format.

Anda memiliki beberapa opsi untuk menyalin data dari Microsoft Fabric Lakehouse menggunakan himpunan data Microsoft Fabric Lakehouse Files:

- Salin dari jalur yang ditentukan dalam himpunan data.

- Filter kartubebas terhadap jalur folder atau nama file, lihat

wildcardFolderPathdanwildcardFileName. - Salin file yang ditentukan dalam file teks tertentu sebagai himpunan file, lihat

fileListPath.

Properti berikut berada di bawah storeSettings pengaturan dalam sumber salinan berbasis format saat menggunakan himpunan data Microsoft Fabric Lakehouse Files:

| Properti | Deskripsi | Wajib |

|---|---|---|

| jenis | Properti jenis di bawah storeSettings harus diatur ke LakehouseReadSettings. |

Ya |

| Menemukan file yang akan disalin: | ||

| OPSI 1: jalur statik |

Salin dari jalur folder/file yang ditentukan dalam himpunan data. Jika Anda ingin menyalin semua file dari folder, tentukan juga wildcardFileName sebagai *. |

|

| OPSI 2: kartubebas - wildcardFolderPath |

Jalur folder dengan karakter kartubebas untuk memfilter folder sumber. Kartubebas yang diizinkan adalah: * (cocok dengan nol karakter atau lebih) dan ? (cocok dengan nol atau satu karakter); gunakan ^ untuk karakter escape jika nama folder Anda yang sebenarnya memiliki karakter kartubebas atau karakter escape ini di dalamnya. Lihat contoh lainnya dalam Contoh filter folder dan file. |

No |

| OPSI 2: kartubebas - wildcardFileName |

Nama file dengan karakter kartubebas di bawah folderPath/wildcardFolderPath yang diberikan untuk memfilter file sumber. Kartubebas yang diizinkan adalah: * (cocok dengan nol karakter atau lebih) dan ? (cocok dengan nol atau satu karakter); gunakan ^ untuk karakter escape jika nama file Anda yang sebenarnya memiliki karakter kartubebas atau karakter escape ini di dalamnya. Lihat contoh lainnya dalam Contoh filter folder dan file. |

Ya |

| OPSI 3: daftar file - fileListPath |

Mengindikasikan untuk menyalin set file yang diberikan. Arahkan ke file teks yang menyertakan daftar file yang ingin Anda salin, satu file per baris, yang merupakan jalur relatif ke jalur yang dikonfigurasi dalam himpunan data. Saat menggunakan opsi ini, jangan tentukan nama file dalam himpunan data. Lihat contoh lainnya dalam Contoh daftar file. |

No |

| Pengaturan tambahan: | ||

| recursive | Menunjukkan apakah data dibaca secara rekursif dari subfolder atau hanya dari folder yang ditentukan. Ketika rekursif diatur menjadi true dan sink-nya adalah penyimpanan berbasis file, folder atau subfolder kosong tidak disalin atau dibuat di sink. Nilai yang diizinkan adalah true (default) dan false. Properti ini tidak berlaku saat Anda mengonfigurasi fileListPath. |

No |

| deleteFilesAfterCompletion | Menunjukkan apakah file biner akan dihapus dari penyimpanan sumber setelah berhasil pindah ke penyimpanan tujuan. Penghapusan file adalah per file, jadi ketika aktivitas salin gagal, Anda melihat beberapa file telah disalin ke tujuan dan dihapus dari sumber, sementara yang lain masih tersisa di penyimpanan sumber. Properti ini hanya valid dalam skenario penyalinan file biner. Nilai default: false. |

No |

| modifiedDatetimeStart | Filter file berdasarkan atribut: Terakhir Diubah. File akan dipilih jika waktu modifikasi terakhir file tersebut lebih besar dari atau sama dengan modifiedDatetimeStart dan kurang dari modifiedDatetimeEnd. Waktu diterapkan ke zona waktu UTC dalam format "2018-12-01T05:00:00Z". Properti dapat menjadi NULL, yang berarti tidak ada filter atribut file yang akan diterapkan ke himpunan data. Ketika modifiedDatetimeStart memiliki nilai tanggalwaktu tetapi modifiedDatetimeEnd NULL, hal ini berarti file dengan nilai atribut terakhir diubah lebih besar dari atau sama dengan nilai tanggalwaktu akan dipilih. Ketika modifiedDatetimeEnd memiliki nilai tanggalwaktu tetapi modifiedDatetimeStart NULL, hal ini berarti file dengan nilai atribut terakhir diubah lebih kecil dari nilai tanggalwaktu akan dipilih.Properti ini tidak berlaku saat Anda mengonfigurasi fileListPath. |

No |

| modifiedDatetimeEnd | Sama dengan atas. | No |

| enablePartitionDiscovery | Untuk file yang dipartisi, tentukan apakah akan mengurai partisi dari jalur file dan menambahkannya sebagai kolom sumber lain. Nilai yang diperbolehkan adalah false (default) dan true. |

No |

| partitionRootPath | Ketika penemuan partisi diaktifkan, tentukan jalur akar absolut untuk membaca folder yang dipartisi sebagai kolom data. Jika tidak ditentukan, secara default, - Ketika Anda menggunakan jalur file dalam himpunan data atau daftar file pada sumber, jalur akar partisi adalah jalur yang dikonfigurasi dalam himpunan data. - Ketika Anda menggunakan filter folder kartubebas, jalur akar partisi adalah subpath sebelum wildcard pertama. Misalnya, dengan asumsi Anda mengonfigurasi jalur dalam himpunan data sebagai "root/folder/year=2020/month=08/day=27": - Jika Anda menentukan jalur akar partisi sebagai "root/folder/year=2020", aktivitas salin menghasilkan dua kolom month lagi dan day dengan nilai "08" dan "27" masing-masing, selain kolom di dalam file.- Jika jalur akar partisi tidak ditentukan, tidak ada kolom tambahan yang dihasilkan. |

No |

| maxConcurrentConnections | Batas atas koneksi bersamaan yang ditetapkan ke penyimpanan data selama eksekusi aktivitas. Menentukan nilai hanya saat Anda ingin membatasi koneksi bersamaan. | No |

Contoh:

"activities": [

{

"name": "CopyFromLakehouseFiles",

"type": "Copy",

"inputs": [

{

"referenceName": "<Delimited text input dataset name>",

"type": "DatasetReference"

}

],

"outputs": [

{

"referenceName": "<output dataset name>",

"type": "DatasetReference"

}

],

"typeProperties": {

"source": {

"type": "DelimitedTextSource",

"storeSettings": {

"type": "LakehouseReadSettings",

"recursive": true,

"enablePartitionDiscovery": false

},

"formatSettings": {

"type": "DelimitedTextReadSettings"

}

},

"sink": {

"type": "<sink type>"

}

}

}

]

Microsoft Fabric Lakehouse Files sebagai jenis sink

Konektor Microsoft Fabric Lakehouse mendukung format file berikut. Lihat setiap artikel untuk mengetahui cara melakukan pengaturan berbasis format.

Properti berikut berada di bawah storeSettings pengaturan dalam sink salinan berbasis format saat menggunakan himpunan data Microsoft Fabric Lakehouse Files:

| Properti | Deskripsi | Wajib |

|---|---|---|

| jenis | Properti jenis di bawah storeSettings harus diatur ke LakehouseWriteSettings. |

Ya |

| copyBehavior | Menentukan perilaku salin saat sumber berupa file dari penyimpanan data berbasis file. Nilai yang diperbolehkan adalah: - (default) PreserveHierarchy: Mempertahankan hierarki file di folder target. Jalur relatif dari file sumber ke folder sumber sama dengan jalur relatif file target ke folder target. - FlattenHierarchy: Semua file dari folder sumber berada di tingkat pertama folder target. File target memiliki nama yang ditulis secara otomatis. - MergeFiles: Menggabungkan semua file dari folder sumber dalam satu file. Jika nama file ditentukan, nama file yang digabungkan adalah nama yang ditentukan. Jika tidak, nama tersebut adalah nama file yang ditulis secara otomatis. |

No |

| blockSizeInMB | Tentukan ukuran blok dalam MB yang digunakan untuk menulis data ke Microsoft Fabric Lakehouse. Pelajari lebih lanjut tentang Block Blobs. Nilai yang diizinkan adalah antara 4 MB dan 100 MB. Secara default, ADF secara otomatis menentukan ukuran blok berdasarkan jenis dan data penyimpanan sumber Anda. Untuk salinan nonbiner ke Microsoft Fabric Lakehouse, ukuran blok default adalah 100 MB sehingga sesuai dengan paling banyak data 4,75 TB. Ini mungkin tidak optimal ketika data Anda tidak besar, terutama ketika Anda menggunakan Runtime Integrasi yang Dihost sendiri dengan jaringan yang buruk yang mengakibatkan batas waktu operasi atau masalah performa. Anda dapat secara eksplisit menentukan ukuran blok, sementara memastikan blockSizeInMB*50000 cukup besar untuk menyimpan data, jika tidak, eksekusi aktivitas salin gagal. |

No |

| maxConcurrentConnections | Batas atas koneksi bersamaan yang ditetapkan ke penyimpanan data selama eksekusi aktivitas. Menentukan nilai hanya saat Anda ingin membatasi koneksi bersamaan. | No |

| metadata | Set metadata khusus saat menyalin ke sink. Setiap objek di bawah metadataarray mewakili kolom tambahan. name mendefinisikan nama kunci metadata, dan value menunjukkan nilai data dari kunci tersebut. Jika fitur pertahankan atribut digunakan, metadata yang ditentukan akan digabungkan/ditimpa dengan metadata file sumber.Nilai data yang diperbolehkan adalah: - $$LASTMODIFIED: variabel yang dicadangkan menunjukkan untuk menyimpan waktu modifikasi terakhir file sumber. Sebarkan ke sumber berbasis file dengan format biner saja.- Ekspresi - Nilai statis |

No |

Contoh:

"activities": [

{

"name": "CopyToLakehouseFiles",

"type": "Copy",

"inputs": [

{

"referenceName": "<input dataset name>",

"type": "DatasetReference"

}

],

"outputs": [

{

"referenceName": "<Parquet output dataset name>",

"type": "DatasetReference"

}

],

"typeProperties": {

"source": {

"type": "<source type>"

},

"sink": {

"type": "ParquetSink",

"storeSettings": {

"type": "LakehouseWriteSettings",

"copyBehavior": "PreserveHierarchy",

"metadata": [

{

"name": "testKey1",

"value": "value1"

},

{

"name": "testKey2",

"value": "value2"

}

]

},

"formatSettings": {

"type": "ParquetWriteSettings"

}

}

}

}

]

Contoh filter folder dan file

Bagian ini menjelaskan perilaku yang dihasilkan dari jalur folder dan nama file dengan filter kartubebas.

| folderPath | fileName | recursive | Struktur folder sumber dan hasil filter (file dalam huruf tebal diambil) |

|---|---|---|---|

Folder* |

(Kosong, gunakan default) | salah | FolderA File1.csv File2.json Subfolder1 File3.csv File4.json File5.csv AnotherFolderB File6.csv |

Folder* |

(Kosong, gunakan default) | benar | FolderA File1.csv File2.json Subfolder1 File3.csv File4.json File5.csv AnotherFolderB File6.csv |

Folder* |

*.csv |

salah | FolderA File1.csv File2.json Subfolder1 File3.csv File4.json File5.csv AnotherFolderB File6.csv |

Folder* |

*.csv |

benar | FolderA File1.csv File2.json Subfolder1 File3.csv File4.json File5.csv AnotherFolderB File6.csv |

Contoh daftar file

Bagian ini menjelaskan perilaku yang dihasilkan dari penggunaan jalur daftar file di sumber aktivitas salin.

Dengan asumsi Anda memiliki struktur folder sumber berikut dan ingin menyalin file dengan bold:

| Struktur sumber sampel | Konten dalam FileListToCopy.txt | Konfigurasi ADF |

|---|---|---|

| filesystem FolderA File1.csv File2.json Subfolder1 File3.csv File4.json File5.csv Metadata FileListToCopy.txt |

File1.csv Subfolder1/File3.csv Subfolder1/File5.csv |

Dalam himpunan data: - Jalur folder: FolderADi sumber aktivitas salin: - Jalur daftar file: Metadata/FileListToCopy.txt Jalur daftar file mengarah ke file teks di penyimpanan data yang sama yang menyertakan daftar file yang ingin Anda salin, satu file per baris dengan jalur relatif ke jalur yang dikonfigurasi dalam himpunan data. |

Beberapa contoh rekursif dan copyBehavior

Bagian ini menjelaskan perilaku yang dihasilkan dari operasi salin untuk kombinasi yang berbeda dari nilai recursive dan copyBehavior.

| recursive | copyBehavior | Struktur folder sumber | Target yang dihasilkan |

|---|---|---|---|

| benar | preserveHierarchy | Folder1 File1 File2 Subfolder1 File3 File4 File5 |

Target Folder1 dibuat dengan struktur yang sama dengan sumbernya: Folder1 File1 File2 Subfolder1 File3 File4 File5 |

| benar | flattenHierarchy | Folder1 File1 File2 Subfolder1 File3 File4 File5 |

Target Folder1 dibuat dengan struktur berikut: Folder1 nama yang ditulis secara otomatis untuk File1 nama yang ditulis secara otomatis untuk File2 nama yang ditulis secara otomatis untuk File3 nama yang ditulis secara otomatis untuk File4 nama yang ditulis secara otomatis untuk File5 |

| benar | mergeFiles | Folder1 File1 File2 Subfolder1 File3 File4 File5 |

Target Folder1 dibuat dengan struktur berikut: Folder1 konten File1 + File2 + File3 + File4 + File5 digabungkan ke dalam satu file, dengan nama file yang ditulis secara otomatis. |

| salah | preserveHierarchy | Folder1 File1 File2 Subfolder1 File3 File4 File5 |

Target Folder1 dibuat dengan struktur berikut: Folder1 File1 File2 Subfolder1 dengan File3, File4, dan File5 tidak diambil. |

| salah | flattenHierarchy | Folder1 File1 File2 Subfolder1 File3 File4 File5 |

Target Folder1 dibuat dengan struktur berikut: Folder1 nama yang ditulis secara otomatis untuk File1 nama yang ditulis secara otomatis untuk File2 Subfolder1 dengan File3, File4, dan File5 tidak diambil. |

| salah | mergeFiles | Folder1 File1 File2 Subfolder1 File3 File4 File5 |

Target Folder1 dibuat dengan struktur berikut: Folder1 konten File1 + File2 digabungkan ke dalam satu file, dengan nama file yang ditulis secara otomatis. nama yang ditulis secara otomatis untuk File1 Subfolder1 dengan File3, File4, dan File5 tidak diambil. |

Microsoft Fabric Lakehouse Table dalam aktivitas Salin

Untuk menggunakan himpunan data Microsoft Fabric Lakehouse Table sebagai himpunan data sumber atau sink dalam aktivitas Salin, buka bagian berikut untuk konfigurasi terperinci.

Microsoft Fabric Lakehouse Table sebagai jenis sumber

Untuk menyalin data dari Microsoft Fabric Lakehouse menggunakan himpunan data Microsoft Fabric Lakehouse Table, atur properti jenis di salin sumber aktivitas ke LakehouseTableSource. Properti berikut ini didukung di bagian Salin sumber aktivitas:

| Properti | Deskripsi | Wajib |

|---|---|---|

| jenis | Properti jenis sumber Aktivitas Salin harus diatur ke LakehouseTableSource. | Ya |

| timestampAsOf | Tanda waktu untuk mengkueri rekam jepret yang lebih lama. | No |

| versionAsOf | Versi untuk mengkueri rekam jepret yang lebih lama. | No |

Contoh:

"activities":[

{

"name": "CopyFromLakehouseTable",

"type": "Copy",

"inputs": [

{

"referenceName": "<Microsoft Fabric Lakehouse Table input dataset name>",

"type": "DatasetReference"

}

],

"outputs": [

{

"referenceName": "<output dataset name>",

"type": "DatasetReference"

}

],

"typeProperties": {

"source": {

"type": "LakehouseTableSource",

"timestampAsOf": "2023-09-23T00:00:00.000Z",

"versionAsOf": 2

},

"sink": {

"type": "<sink type>"

}

}

}

]

Microsoft Fabric Lakehouse Table sebagai jenis sink

Untuk menyalin data ke Microsoft Fabric Lakehouse menggunakan himpunan data Microsoft Fabric Lakehouse Table, atur properti jenis di sink Aktivitas Salin ke LakehouseTableSink. Properti berikut ini didukung di bagian sink aktivitas Salin:

| Properti | Deskripsi | Wajib |

|---|---|---|

| jenis | Properti jenis sumber Aktivitas Salin harus diatur ke LakehouseTableSink. | Ya |

Catatan

Data ditulis ke Tabel Lakehouse dalam Urutan V secara default. Untuk informasi selengkapnya, buka pengoptimalan tabel Delta Lake dan V-Order.

Contoh:

"activities":[

{

"name": "CopyToLakehouseTable",

"type": "Copy",

"inputs": [

{

"referenceName": "<input dataset name>",

"type": "DatasetReference"

}

],

"outputs": [

{

"referenceName": "<Microsoft Fabric Lakehouse Table output dataset name>",

"type": "DatasetReference"

}

],

"typeProperties": {

"source": {

"type": "<source type>"

},

"sink": {

"type": "LakehouseTableSink",

"tableActionOption ": "Append"

}

}

}

]

Properti pemetaan aliran data

Saat mengubah data dalam pemetaan aliran data, Anda dapat membaca dan menulis ke file atau tabel di Microsoft Fabric Lakehouse. Lihat bagian terkait untuk detailnya.

- Microsoft Fabric Lakehouse Files dalam pemetaan aliran data

- Microsoft Fabric Lakehouse Table dalam pemetaan aliran data

Untuk informasi selengkapnya, lihat transformasi sumber dan transformasi sink dalam aliran data pemetaan.

Microsoft Fabric Lakehouse Files dalam pemetaan aliran data

Untuk menggunakan himpunan data Microsoft Fabric Lakehouse Files sebagai himpunan data sumber atau sink dalam pemetaan aliran data, buka bagian berikut untuk konfigurasi terperinci.

Microsoft Fabric Lakehouse Files sebagai jenis sumber atau sink

Konektor Microsoft Fabric Lakehouse mendukung format file berikut. Lihat setiap artikel untuk mengetahui cara melakukan pengaturan berbasis format.

Untuk menggunakan konektor berbasis file Fabric Lakehouse dalam jenis himpunan data sebaris, Anda perlu memilih jenis himpunan data sebaris yang tepat untuk data Anda. Anda dapat menggunakan DelimitedText, Avro, JSON, ORC, atau Parquet tergantung pada format data Anda.

Microsoft Fabric Lakehouse Table dalam pemetaan aliran data

Untuk menggunakan himpunan data Microsoft Fabric Lakehouse Table sebagai himpunan data sumber atau sink dalam pemetaan aliran data, buka bagian berikut untuk konfigurasi terperinci.

Microsoft Fabric Lakehouse Table sebagai jenis sumber

Tidak ada properti yang dapat dikonfigurasi di bawah opsi sumber.

Catatan

Dukungan CDC untuk sumber tabel Lakehouse saat ini tidak tersedia.

Microsoft Fabric Lakehouse Table sebagai jenis sink

Properti berikut ini didukung di bagian sink Pemetaan Aliran Data:

| Nama | Deskripsi | Wajib diisi | Nilai yang diizinkan | Properti skrip aliran data |

|---|---|---|---|---|

| Perbarui() metode | Saat Anda memilih "Izinkan sisipan" saja atau saat Anda menulis ke tabel delta baru, target menerima semua baris masuk terlepas dari kebijakan Baris yang ditetapkan. Jika data Anda berisi baris kebijakan Baris lainnya, data tersebut perlu dikecualikan menggunakan transformasi Filter sebelumnya. Ketika semua metode Pembaruan dipilih, Gabungkan dilakukan, di mana baris disisipkan/dihapus/diperbarui sesuai Kebijakan Baris yang ditetapkan menggunakan transformasi Ubah Baris sebelumnya. |

yes | true atau false |

dapat disisipkan dapat dideletable dapat ditingkatkan updateable |

| Tulis yang Dioptimalkan | Mencapai throughput yang lebih tinggi untuk operasi tulis dengan mengoptimalkan acak internal di eksekutor Spark. Akibatnya, Anda mungkin melihat lebih sedikit partisi dan file yang berukuran lebih besar | no | true atau false |

dioptimalkanWrite: true |

| Ringkas Otomatis | Setelah operasi penulisan selesai, Spark akan secara otomatis menjalankan OPTIMIZE perintah untuk mengatur ulang data, menghasilkan lebih banyak partisi jika perlu, untuk performa pembacaan yang lebih baik di masa mendatang |

no | true atau false |

lengkapiOtomatis: true |

| Gabungkan Skema | Opsi gabungkan skema memungkinkan evolusi skema, yaitu kolom apa pun yang ada di aliran masuk saat ini tetapi tidak dalam tabel Delta target secara otomatis ditambahkan ke skemanya. Opsi ini didukung di semua metode pembaruan. | no | true atau false |

mergeSchema: true |

Contoh: Sink Microsoft Fabric Lakehouse Table

sink(allowSchemaDrift: true,

validateSchema: false,

input(

CustomerID as string,

NameStyle as string,

Title as string,

FirstName as string,

MiddleName as string,

LastName as string,

Suffix as string,

CompanyName as string,

SalesPerson as string,

EmailAddress as string,

Phone as string,

PasswordHash as string,

PasswordSalt as string,

rowguid as string,

ModifiedDate as string

),

deletable:false,

insertable:true,

updateable:false,

upsertable:false,

optimizedWrite: true,

mergeSchema: true,

autoCompact: true,

skipDuplicateMapInputs: true,

skipDuplicateMapOutputs: true) ~> CustomerTable

Untuk konektor berbasis tabel Fabric Lakehouse dalam jenis himpunan data sebaris, Anda hanya perlu menggunakan Delta sebagai jenis himpunan data. Ini akan memungkinkan Anda untuk membaca dan menulis data dari tabel Fabric Lakehouse.

Properti aktivitas pencarian

Untuk mempelajari detail tentang properti, lihat Aktivitas pencarian.

Properti aktivitas GetMetadata

Untuk mempelajari rincian tentang properti ini, periksa Aktivitas GetMetadata

Properti aktivitas penghapusan

Untuk mempelajari rincian tentang properti ini, periksa Aktivitas penghapusan

Konten terkait

Untuk daftar penyimpanan data yang didukung sebagai sumber dan sink oleh aktivitas salin, lihat Penyimpanan data yang didukung.