Uwaga

Dostęp do tej strony wymaga autoryzacji. Może spróbować zalogować się lub zmienić katalogi.

Dostęp do tej strony wymaga autoryzacji. Możesz spróbować zmienić katalogi.

DOTYCZY:  Azure Data Factory

Azure Data Factory  Azure Synapse Analytics

Azure Synapse Analytics

Napiwek

Wypróbuj usługę Data Factory w usłudze Microsoft Fabric — rozwiązanie analityczne typu all-in-one dla przedsiębiorstw. Usługa Microsoft Fabric obejmuje wszystko, od przenoszenia danych do nauki o danych, analizy w czasie rzeczywistym, analizy biznesowej i raportowania. Dowiedz się, jak bezpłatnie rozpocząć nową wersję próbną !

W tym artykule opisano sposób kopiowania danych do i z usługi Azure Data Lake Storage Gen1. Aby dowiedzieć się więcej, przeczytaj artykuł wprowadzający dotyczący usługi Azure Data Factory lub Azure Synapse Analytics.

Uwaga

Usługa Azure Data Lake Storage Gen1 została wycofana 29 lutego 2024 r. Przeprowadź migrację do łącznika usługi Azure Data Lake Storage Gen2. Zapoznaj się z tym artykułem , aby uzyskać wskazówki dotyczące migracji usługi Azure Data Lake Storage Gen1.

Obsługiwane możliwości

Ten łącznik usługi Azure Data Lake Storage Gen1 jest obsługiwany w następujących funkcjach:

| Obsługiwane możliwości | IR |

|---|---|

| działanie Kopiuj (źródło/ujście) | (1) (2) |

| Przepływ danych mapowania (źródło/ujście) | (1) |

| Działanie Lookup | (1) (2) |

| Działanie GetMetadata | (1) (2) |

| Działanie usuwania | (1) (2) |

(1) Środowisko Azure Integration Runtime (2) Self-hosted Integration Runtime

W szczególności za pomocą tego łącznika można wykonywać następujące czynności:

- Skopiuj pliki przy użyciu jednej z następujących metod uwierzytelniania: jednostki usługi lub tożsamości zarządzanych dla zasobów platformy Azure.

- Kopiowanie plików w formacie is lub analizowanie lub generowanie plików z obsługiwanymi formatami plików i koderami kompresji.

- Zachowaj listy ACL podczas kopiowania do usługi Azure Data Lake Storage Gen2.

Ważne

Jeśli skopiujesz dane przy użyciu własnego środowiska Integration Runtime, skonfiguruj zaporę firmową, aby zezwolić na ruch wychodzący do <ADLS account name>.azuredatalakestore.net i login.microsoftonline.com/<tenant>/oauth2/token na porcie 443. Ta ostatnia jest usługą tokenu zabezpieczającego platformy Azure, z którą środowisko Integration Runtime musi komunikować się w celu uzyskania tokenu dostępu.

Rozpocznij

Napiwek

Aby zapoznać się z instrukcjami dotyczącymi korzystania z łącznika usługi Azure Data Lake Store, zobacz Ładowanie danych do usługi Azure Data Lake Store.

Aby wykonać działanie Kopiuj za pomocą potoku, możesz użyć jednego z następujących narzędzi lub zestawów SDK:

- Narzędzie do kopiowania danych

- Witryna Azure Portal

- Zestaw SDK platformy .NET

- Zestaw SDK języka Python

- Azure PowerShell

- Interfejs API REST

- Szablon usługi Azure Resource Manager

Tworzenie połączonej usługi z usługą Azure Data Lake Storage Gen1 przy użyciu interfejsu użytkownika

Wykonaj poniższe kroki, aby utworzyć połączoną usługę z usługą Azure Data Lake Storage Gen1 w interfejsie użytkownika witryny Azure Portal.

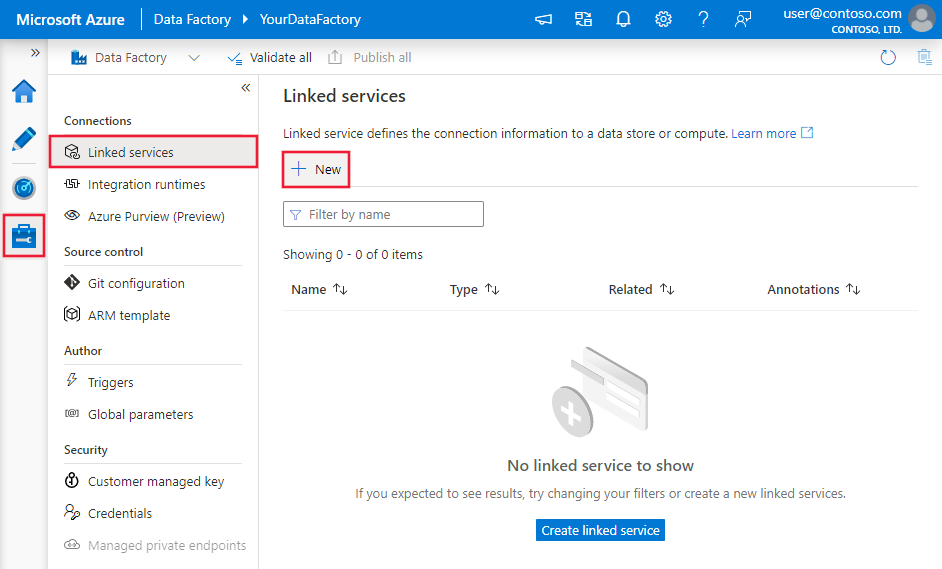

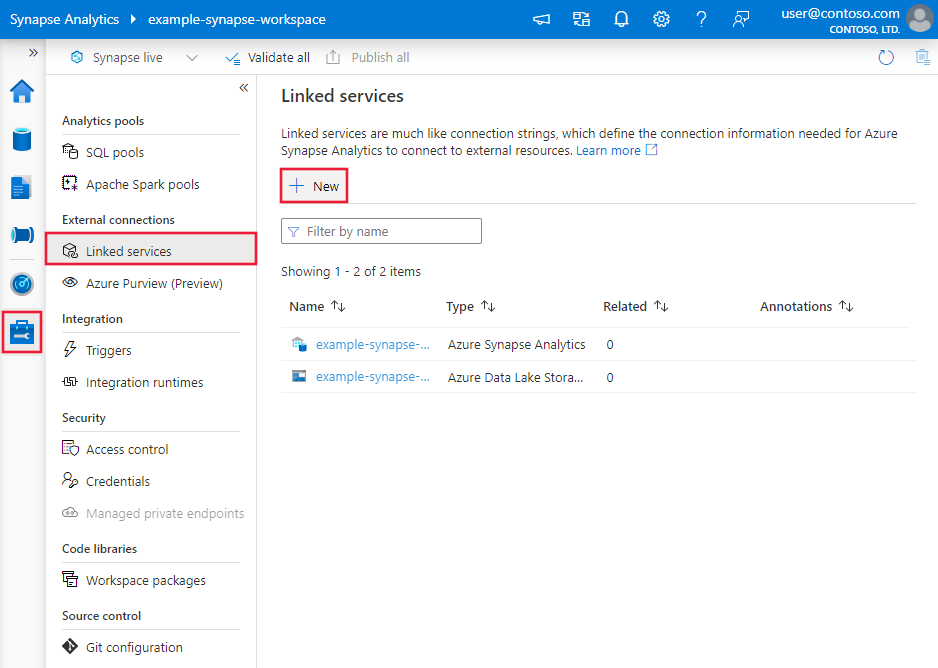

Przejdź do karty Zarządzanie w obszarze roboczym usługi Azure Data Factory lub Synapse i wybierz pozycję Połączone usługi, a następnie wybierz pozycję Nowe:

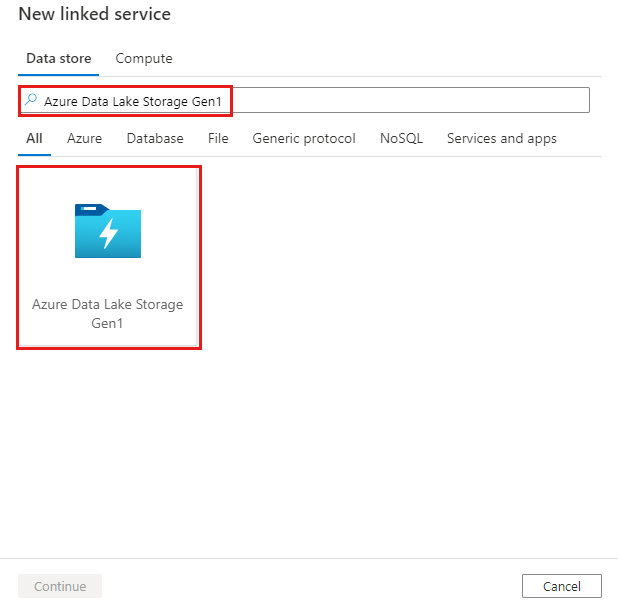

Wyszukaj usługę Azure Data Lake Storage Gen1 i wybierz łącznik Usługi Azure Data Lake Storage Gen1.

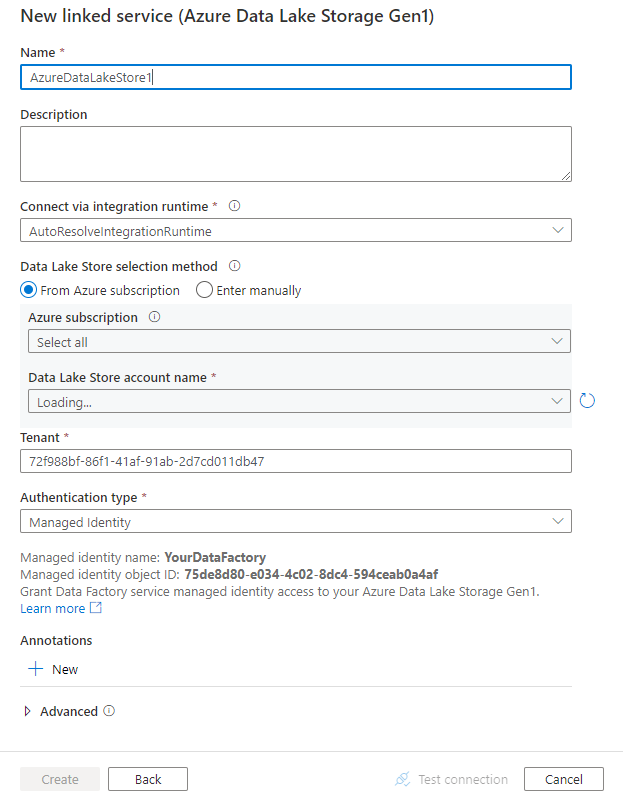

Skonfiguruj szczegóły usługi, przetestuj połączenie i utwórz nową połączoną usługę.

Szczegóły konfiguracji łącznika

Poniższe sekcje zawierają informacje o właściwościach używanych do definiowania jednostek specyficznych dla usługi Azure Data Lake Store Gen1.

Właściwości połączonej usługi

Następujące właściwości są obsługiwane w przypadku połączonej usługi Azure Data Lake Store:

| Właściwości | Opis | Wymagania |

|---|---|---|

| type | Właściwość musi być ustawiona type na AzureDataLakeStore. |

Tak |

| dataLakeStoreUri | Informacje o koncie usługi Azure Data Lake Store. Te informacje mają jeden z następujących formatów: https://[accountname].azuredatalakestore.net/webhdfs/v1 lub adl://[accountname].azuredatalakestore.net/. |

Tak |

| subscriptionId | Identyfikator subskrypcji platformy Azure, do którego należy konto usługi Data Lake Store. | Wymagane do ujścia |

| resourceGroupName | Nazwa grupy zasobów platformy Azure, do której należy konto usługi Data Lake Store. | Wymagane do ujścia |

| connectVia | Środowisko Integration Runtime do nawiązania połączenia z magazynem danych. Możesz użyć środowiska Azure Integration Runtime lub własnego środowiska Integration Runtime, jeśli magazyn danych znajduje się w sieci prywatnej. Jeśli ta właściwość nie zostanie określona, zostanie użyte domyślne środowisko Azure Integration Runtime. | Nie. |

Korzystanie z uwierzytelniania jednostki usługi

Aby użyć uwierzytelniania jednostki usługi, wykonaj następujące kroki.

Zarejestruj jednostkę aplikacji w usłudze Microsoft Entra ID i przyznaj jej dostęp do usługi Data Lake Store. Aby uzyskać szczegółowe instrukcje, zobacz Uwierzytelnianie typu service-to-service. Zanotuj następujące wartości, których użyjesz do zdefiniowania połączonej usługi:

- Application ID

- Klucz aplikacji

- Identyfikator dzierżawy

Przyznaj jednostce usługi odpowiednie uprawnienie. Zobacz przykłady działania uprawnień w usłudze Data Lake Storage Gen1 z kontroli dostępu w usłudze Azure Data Lake Storage Gen1.

- Jako źródło: W eksploratorze>danych Access przyznaj co najmniej uprawnienie Wykonaj dla wszystkich folderów nadrzędnych, w tym katalogu głównego, wraz z uprawnieniem Odczyt do kopiowania plików. Możesz dodać element do tego folderu i wszystkich elementów podrzędnych w celu cyklicznego cyklicznego dodawania jako uprawnienia dostępu i domyślnego wpisu uprawnień. Kontrola dostępu na poziomie konta (IAM, account-level access control) nie jest wymagana.

- Jako ujście: w eksploratorze>danych Access przyznaj co najmniej uprawnienie Wykonaj dla wszystkich folderów nadrzędnych, w tym katalogu głównego, wraz z uprawnieniem Zapis dla folderu ujścia. Możesz dodać element do tego folderu i wszystkich elementów podrzędnych w celu cyklicznego cyklicznego dodawania jako uprawnienia dostępu i domyślnego wpisu uprawnień.

Obsługiwane są następujące właściwości:

| Właściwości | Opis | Wymagania |

|---|---|---|

| servicePrincipalId | Określ identyfikator klienta aplikacji. | Tak |

| servicePrincipalKey | Określ klucz aplikacji. Oznacz to pole jako SecureString obiekt w celu bezpiecznego przechowywania lub odwołuj się do wpisu tajnego przechowywanego w usłudze Azure Key Vault. |

Tak |

| tenant | Określ informacje o dzierżawie, takie jak nazwa domeny lub identyfikator dzierżawy, w ramach których znajduje się aplikacja. Możesz go pobrać, umieszczając wskaźnik myszy w prawym górnym rogu witryny Azure Portal. | Tak |

| azureCloudType | W przypadku uwierzytelniania jednostki usługi określ typ środowiska chmury platformy Azure, do którego zarejestrowano aplikację Firmy Microsoft Entra. Dozwolone wartości to AzurePublic, AzureChina, AzureUsGovernment i AzureGermany. Domyślnie używane jest środowisko chmury usługi. |

Nie. |

Przykład:

{

"name": "AzureDataLakeStoreLinkedService",

"properties": {

"type": "AzureDataLakeStore",

"typeProperties": {

"dataLakeStoreUri": "https://<accountname>.azuredatalakestore.net/webhdfs/v1",

"servicePrincipalId": "<service principal id>",

"servicePrincipalKey": {

"type": "SecureString",

"value": "<service principal key>"

},

"tenant": "<tenant info, e.g. microsoft.onmicrosoft.com>",

"subscriptionId": "<subscription of ADLS>",

"resourceGroupName": "<resource group of ADLS>"

},

"connectVia": {

"referenceName": "<name of Integration Runtime>",

"type": "IntegrationRuntimeReference"

}

}

}

Korzystanie z uwierzytelniania tożsamości zarządzanej przypisanej przez system

Obszar roboczy fabryki danych lub usługi Synapse może być skojarzony z tożsamością zarządzaną przypisaną przez system, która reprezentuje usługę na potrzeby uwierzytelniania. Tę tożsamość zarządzaną przypisaną przez system można bezpośrednio użyć do uwierzytelniania usługi Data Lake Store, podobnie jak w przypadku własnej jednostki usługi. Dzięki temu wyznaczonemu zasobowi można uzyskiwać dostęp do danych i kopiować je do lub z usługi Data Lake Store.

Aby użyć uwierzytelniania tożsamości zarządzanej przypisanej przez system, wykonaj następujące kroki.

Pobierz informacje o tożsamości zarządzanej przypisanej przez system, kopiując wartość "Identyfikator aplikacji tożsamości usługi" wygenerowaną wraz z fabryką lub obszarem roboczym usługi Synapse.

Udziel przypisanej przez system tożsamości zarządzanej dostępu do usługi Data Lake Store. Zobacz przykłady działania uprawnień w usłudze Data Lake Storage Gen1 z kontroli dostępu w usłudze Azure Data Lake Storage Gen1.

- Jako źródło: W eksploratorze>danych Access przyznaj co najmniej uprawnienie Wykonaj dla wszystkich folderów nadrzędnych, w tym katalogu głównego, wraz z uprawnieniem Odczyt do kopiowania plików. Możesz dodać element do tego folderu i wszystkich elementów podrzędnych w celu cyklicznego cyklicznego dodawania jako uprawnienia dostępu i domyślnego wpisu uprawnień. Kontrola dostępu na poziomie konta (IAM, account-level access control) nie jest wymagana.

- Jako ujście: w eksploratorze>danych Access przyznaj co najmniej uprawnienie Wykonaj dla wszystkich folderów nadrzędnych, w tym katalogu głównego, wraz z uprawnieniem Zapis dla folderu ujścia. Możesz dodać element do tego folderu i wszystkich elementów podrzędnych w celu cyklicznego cyklicznego dodawania jako uprawnienia dostępu i domyślnego wpisu uprawnień.

Nie musisz określać żadnych właściwości innych niż ogólne informacje o usłudze Data Lake Store w połączonej usłudze.

Przykład:

{

"name": "AzureDataLakeStoreLinkedService",

"properties": {

"type": "AzureDataLakeStore",

"typeProperties": {

"dataLakeStoreUri": "https://<accountname>.azuredatalakestore.net/webhdfs/v1",

"subscriptionId": "<subscription of ADLS>",

"resourceGroupName": "<resource group of ADLS>"

},

"connectVia": {

"referenceName": "<name of Integration Runtime>",

"type": "IntegrationRuntimeReference"

}

}

}

Korzystanie z uwierzytelniania tożsamości zarządzanej przypisanej przez użytkownika

Fabrykę danych można przypisać za pomocą jednej lub wielu tożsamości zarządzanych przypisanych przez użytkownika. Tej tożsamości zarządzanej przypisanej przez użytkownika można użyć do uwierzytelniania usługi Blob Storage, które umożliwia dostęp do danych i kopiowanie ich z usługi Data Lake Store. Aby dowiedzieć się więcej o tożsamościach zarządzanych dla zasobów platformy Azure, zobacz Tożsamości zarządzane dla zasobów platformy Azure

Aby użyć uwierzytelniania tożsamości zarządzanej przypisanej przez użytkownika, wykonaj następujące kroki:

Utwórz jedną lub wiele tożsamości zarządzanych przypisanych przez użytkownika i przyznaj dostęp do usługi Azure Data Lake. Zobacz przykłady działania uprawnień w usłudze Data Lake Storage Gen1 z kontroli dostępu w usłudze Azure Data Lake Storage Gen1.

- Jako źródło: W eksploratorze>danych Access przyznaj co najmniej uprawnienie Wykonaj dla wszystkich folderów nadrzędnych, w tym katalogu głównego, wraz z uprawnieniem Odczyt do kopiowania plików. Możesz dodać element do tego folderu i wszystkich elementów podrzędnych w celu cyklicznego cyklicznego dodawania jako uprawnienia dostępu i domyślnego wpisu uprawnień. Kontrola dostępu na poziomie konta (IAM, account-level access control) nie jest wymagana.

- Jako ujście: w eksploratorze>danych Access przyznaj co najmniej uprawnienie Wykonaj dla wszystkich folderów nadrzędnych, w tym katalogu głównego, wraz z uprawnieniem Zapis dla folderu ujścia. Możesz dodać element do tego folderu i wszystkich elementów podrzędnych w celu cyklicznego cyklicznego dodawania jako uprawnienia dostępu i domyślnego wpisu uprawnień.

Przypisz jedną lub wiele tożsamości zarządzanych przypisanych przez użytkownika do fabryki danych i utwórz poświadczenia dla każdej tożsamości zarządzanej przypisanej przez użytkownika.

Obsługiwana jest następująca właściwość:

| Właściwości | Opis | Wymagania |

|---|---|---|

| poświadczenia | Określ tożsamość zarządzaną przypisaną przez użytkownika jako obiekt poświadczeń. | Tak |

Przykład:

{

"name": "AzureDataLakeStoreLinkedService",

"properties": {

"type": "AzureDataLakeStore",

"typeProperties": {

"dataLakeStoreUri": "https://<accountname>.azuredatalakestore.net/webhdfs/v1",

"subscriptionId": "<subscription of ADLS>",

"resourceGroupName": "<resource group of ADLS>",

"credential": {

"referenceName": "credential1",

"type": "CredentialReference"

},

"connectVia": {

"referenceName": "<name of Integration Runtime>",

"type": "IntegrationRuntimeReference"

}

}

}

Właściwości zestawu danych

Aby uzyskać pełną listę sekcji i właściwości dostępnych do definiowania zestawów danych, zobacz artykuł Zestawy danych.

Usługa Azure Data Factory obsługuje następujące formaty plików. Zapoznaj się z każdym artykułem, aby zapoznać się z ustawieniami opartymi na formacie.

- Format Avro

- Format binarny

- Format tekstu rozdzielanego

- Format programu Excel

- Format JSON

- Format ORC

- Format Parquet

- Format XML

Następujące właściwości są obsługiwane w przypadku usługi Azure Data Lake Store Gen1 w ustawieniach location w zestawie danych opartym na formacie:

| Właściwości | Opis | Wymagania |

|---|---|---|

| type | Właściwość type w obszarze location w zestawie danych musi być ustawiona na Wartość AzureDataLakeStoreLocation. |

Tak |

| folderPath | Ścieżka do folderu. Jeśli chcesz używać symbolu wieloznakowego do filtrowania folderów, pomiń to ustawienie i określ je w ustawieniach źródła działań. | Nie. |

| fileName | Nazwa pliku pod danym folderPath. Jeśli chcesz używać symbolu wieloznakowego do filtrowania plików, pomiń to ustawienie i określ je w ustawieniach źródła działań. | Nie. |

Przykład:

{

"name": "DelimitedTextDataset",

"properties": {

"type": "DelimitedText",

"linkedServiceName": {

"referenceName": "<ADLS Gen1 linked service name>",

"type": "LinkedServiceReference"

},

"schema": [ < physical schema, optional, auto retrieved during authoring > ],

"typeProperties": {

"location": {

"type": "AzureDataLakeStoreLocation",

"folderPath": "root/folder/subfolder"

},

"columnDelimiter": ",",

"quoteChar": "\"",

"firstRowAsHeader": true,

"compressionCodec": "gzip"

}

}

}

Właściwości działania kopiowania

Aby uzyskać pełną listę sekcji i właściwości dostępnych do definiowania działań, zobacz Pipelines (Potoki). Ta sekcja zawiera listę właściwości obsługiwanych przez źródło i ujście usługi Azure Data Lake Store.

Usługa Azure Data Lake Store jako źródło

Usługa Azure Data Factory obsługuje następujące formaty plików. Zapoznaj się z każdym artykułem, aby zapoznać się z ustawieniami opartymi na formacie.

- Format Avro

- Format binarny

- Format tekstu rozdzielanego

- Format programu Excel

- Format JSON

- Format ORC

- Format Parquet

- Format XML

Następujące właściwości są obsługiwane w przypadku usługi Azure Data Lake Store Gen1 w ustawieniach storeSettings w źródle kopiowania opartym na formacie:

| Właściwości | Opis | Wymagania |

|---|---|---|

| type | Właściwość type w obszarze storeSettings musi być ustawiona na Wartość AzureDataLakeStoreReadSettings. |

Tak |

| Znajdź pliki do skopiowania: | ||

| OPCJA 1: ścieżka statyczna |

Skopiuj z podanej ścieżki folderu/pliku określonej w zestawie danych. Jeśli chcesz skopiować wszystkie pliki z folderu, dodatkowo określ wildcardFileName jako *. |

|

| OPCJA 2: zakres nazw - listAfter |

Pobierz foldery/pliki, których nazwa znajduje się po tej wartości alfabetycznie (wyłącznie). Wykorzystuje filtr po stronie usługi dla usługi ADLS Gen1, który zapewnia lepszą wydajność niż filtr wieloznaczny. Usługa stosuje ten filtr do ścieżki zdefiniowanej w zestawie danych, a obsługiwany jest tylko jeden poziom jednostki. Zobacz więcej przykładów w sekcji Przykłady filtrów zakresu nazw. |

Nie. |

| OPCJA 2: zakres nazw - listBefore |

Pobierz foldery/pliki, których nazwa jest wcześniejsza niż ta wartość alfabetycznie (włącznie). Wykorzystuje filtr po stronie usługi dla usługi ADLS Gen1, który zapewnia lepszą wydajność niż filtr wieloznaczny. Usługa stosuje ten filtr do ścieżki zdefiniowanej w zestawie danych, a obsługiwany jest tylko jeden poziom jednostki. Zobacz więcej przykładów w sekcji Przykłady filtrów zakresu nazw. |

Nie. |

| OPCJA 3: symbol wieloznaczny - symbol wieloznacznyFolderPath |

Ścieżka folderu z symbolami wieloznacznymi do filtrowania folderów źródłowych. Dozwolone symbole wieloznaczne to: * (pasuje do zera lub większej liczby znaków) i ? (pasuje do zera lub pojedynczego znaku); użyj ^ , aby uniknąć, jeśli rzeczywista nazwa folderu ma symbol wieloznaczny lub znak ucieczki wewnątrz. Zobacz więcej przykładów w przykładach filtru folderów i plików. |

Nie. |

| OPCJA 3: symbol wieloznaczny - symbol wieloznacznyFileName |

Nazwa pliku z symbolami wieloznacznymi w ramach danego folderuPath/symbol wieloznacznyFolderPath do filtrowania plików źródłowych. Dozwolone symbole wieloznaczne to: * (pasuje do zera lub większej liczby znaków) i ? (pasuje do zera lub pojedynczego znaku); użyj ^ , aby uniknąć, jeśli rzeczywista nazwa pliku ma symbol wieloznaczny lub znak ucieczki wewnątrz. Zobacz więcej przykładów w przykładach filtru folderów i plików. |

Tak |

| OPCJA 4: lista plików - fileListPath |

Wskazuje, aby skopiować dany zestaw plików. Wskaż plik tekstowy zawierający listę plików, które chcesz skopiować, jeden plik na wiersz, czyli ścieżkę względną do ścieżki skonfigurowanej w zestawie danych. W przypadku korzystania z tej opcji nie należy określać nazwy pliku w zestawie danych. Zobacz więcej przykładów na przykładach na liście plików. |

Nie. |

| Dodatkowe ustawienia: | ||

| Cykliczne | Wskazuje, czy dane są odczytywane rekursywnie z podfolderów, czy tylko z określonego folderu. Gdy rekursywna jest ustawiona na wartość true, a ujście jest magazynem opartym na plikach, pusty folder lub podfolder nie jest kopiowany ani tworzony w ujściu. Dozwolone wartości to true (wartość domyślna) i false. Ta właściwość nie ma zastosowania podczas konfigurowania fileListPathelementu . |

Nie. |

| deleteFilesAfterCompletion | Wskazuje, czy pliki binarne zostaną usunięte z magazynu źródłowego po pomyślnym przeniesieniu do magazynu docelowego. Usunięcie pliku jest na plik, więc gdy działanie kopiowania zakończy się niepowodzeniem, zobaczysz, że niektóre pliki zostały już skopiowane do miejsca docelowego i usunięte ze źródła, podczas gdy inne nadal pozostają w magazynie źródłowym. Ta właściwość jest prawidłowa tylko w scenariuszu kopiowania plików binarnych. Wartość domyślna: false. |

Nie. |

| modifiedDatetimeStart | Filtr plików na podstawie atrybutu: Ostatnia modyfikacja. Pliki są wybierane, jeśli ich czas ostatniej modyfikacji jest większy lub równy modifiedDatetimeStart i mniejszy niż modifiedDatetimeEnd. Czas jest stosowany do strefy czasowej UTC w formacie "2018-12-01T05:00:00Z". Właściwości mogą mieć wartość NULL, co oznacza, że do zestawu danych nie jest stosowany filtr atrybutu pliku. Jeśli modifiedDatetimeStart ma wartość data/godzina, ale modifiedDatetimeEnd ma wartość NULL, oznacza to, że wybrano pliki, których ostatnio zmodyfikowany atrybut jest większy lub równy wartości daty/godziny. Jeśli modifiedDatetimeEnd ma wartość data/godzina, ale modifiedDatetimeStart ma wartość NULL, oznacza to, że pliki, których ostatnio zmodyfikowany atrybut jest mniejszy niż wartość daty/godziny jest zaznaczona.Ta właściwość nie ma zastosowania podczas konfigurowania fileListPathelementu . |

Nie. |

| modifiedDatetimeEnd | Jak wyżej. | Nie. |

| enablePartitionDiscovery | W przypadku plików podzielonych na partycje określ, czy analizować partycje ze ścieżki pliku i dodać je jako dodatkowe kolumny źródłowe. Dozwolone wartości to false (wartość domyślna) i true. |

Nie. |

| partitionRootPath | Po włączeniu odnajdywania partycji określ bezwzględną ścieżkę katalogu głównego, aby odczytywać foldery podzielone na partycje jako kolumny danych. Jeśli nie jest określony, domyślnie, — Jeśli używasz ścieżki pliku w zestawie danych lub liście plików w źródle, ścieżka główna partycji jest ścieżką skonfigurowaną w zestawie danych. — W przypadku używania filtru folderów wieloznacznych ścieżka główna partycji jest ścieżką podrzędną przed pierwszym symbolem wieloznacznymi. Załóżmy na przykład, że ścieżka w zestawie danych zostanie skonfigurowana jako "root/folder/year=2020/month=08/day=27": - Jeśli określisz ścieżkę główną partycji jako "root/folder/year=2020", działanie kopiowania generuje dwie kolejne kolumny month i day z wartością "08" i "27" odpowiednio, oprócz kolumn w plikach.— Jeśli ścieżka główna partycji nie jest określona, nie jest generowana żadna dodatkowa kolumna. |

Nie. |

| maxConcurrentConnections | Górny limit połączeń współbieżnych ustanowionych z magazynem danych podczas uruchamiania działania. Określ wartość tylko wtedy, gdy chcesz ograniczyć połączenia współbieżne. | Nie. |

Przykład:

"activities":[

{

"name": "CopyFromADLSGen1",

"type": "Copy",

"inputs": [

{

"referenceName": "<Delimited text input dataset name>",

"type": "DatasetReference"

}

],

"outputs": [

{

"referenceName": "<output dataset name>",

"type": "DatasetReference"

}

],

"typeProperties": {

"source": {

"type": "DelimitedTextSource",

"formatSettings":{

"type": "DelimitedTextReadSettings",

"skipLineCount": 10

},

"storeSettings":{

"type": "AzureDataLakeStoreReadSettings",

"recursive": true,

"wildcardFolderPath": "myfolder*A",

"wildcardFileName": "*.csv"

}

},

"sink": {

"type": "<sink type>"

}

}

}

]

Usługa Azure Data Lake Store jako ujście

Usługa Azure Data Factory obsługuje następujące formaty plików. Zapoznaj się z każdym artykułem, aby zapoznać się z ustawieniami opartymi na formacie.

Następujące właściwości są obsługiwane w przypadku usługi Azure Data Lake Store Gen1 w ustawieniach storeSettings ujścia kopiowania opartego na formacie:

| Właściwości | Opis | Wymagania |

|---|---|---|

| type | Właściwość type w obszarze storeSettings musi być ustawiona na Wartość AzureDataLakeStoreWriteSettings. |

Tak |

| copyBehavior | Definiuje zachowanie kopiowania, gdy źródłem są pliki z magazynu danych opartego na plikach. Dozwolone wartości to: - PreserveHierarchy (wartość domyślna): Zachowuje hierarchię plików w folderze docelowym. Ścieżka względna pliku źródłowego do folderu źródłowego jest identyczna ze ścieżką względną pliku docelowego do folderu docelowego. - FlattenHierarchy: Wszystkie pliki z folderu źródłowego znajdują się na pierwszym poziomie folderu docelowego. Pliki docelowe mają automatycznie wygenerowane nazwy. - MergeFiles: Scala wszystkie pliki z folderu źródłowego do jednego pliku. Jeśli określono nazwę pliku, scalona nazwa pliku jest określoną nazwą. W przeciwnym razie jest to automatycznie wygenerowana nazwa pliku. |

Nie. |

| expiryDateTime | Określa czas wygaśnięcia zapisanych plików. Czas jest stosowany do godziny UTC w formacie "2020-03-01T08:00:00Z". Domyślnie ma wartość NULL, co oznacza, że zapisane pliki nigdy nie wygasły. | Nie. |

| maxConcurrentConnections | Górny limit połączeń współbieżnych ustanowionych z magazynem danych podczas uruchamiania działania. Określ wartość tylko wtedy, gdy chcesz ograniczyć połączenia współbieżne. | Nie. |

Przykład:

"activities":[

{

"name": "CopyToADLSGen1",

"type": "Copy",

"inputs": [

{

"referenceName": "<input dataset name>",

"type": "DatasetReference"

}

],

"outputs": [

{

"referenceName": "<Parquet output dataset name>",

"type": "DatasetReference"

}

],

"typeProperties": {

"source": {

"type": "<source type>"

},

"sink": {

"type": "ParquetSink",

"storeSettings":{

"type": "AzureDataLakeStoreWriteSettings",

"copyBehavior": "PreserveHierarchy"

}

}

}

}

]

Przykłady filtrów zakresu nazw

W tej sekcji opisano wynikowe zachowanie filtrów zakresu nazw.

| Przykładowa struktura źródła | Konfigurowanie | Result |

|---|---|---|

| root a file.csv siekiera file2.csv ax.csv b file3.csv bx.csv c file4.csv cx.csv |

W zestawie danych: - Ścieżka folderu: rootW źródle działania kopiowania: - Lista po: a- Lista przed: b |

Następnie kopiowane są następujące pliki: root siekiera file2.csv ax.csv b file3.csv |

Przykłady filtrów folderów i plików

W tej sekcji opisano wynikowe zachowanie ścieżki folderu i nazwy pliku z filtrami wieloznacznymi.

| folderPath | fileName | Cykliczne | Struktura folderu źródłowego i wynik filtru (pobierane są pliki pogrubione ) |

|---|---|---|---|

Folder* |

(Puste, użyj wartości domyślnej) | fałsz | FolderA File1.csv File2.json Podfolder1 File3.csv File4.json File5.csv InnyfolderB File6.csv |

Folder* |

(Puste, użyj wartości domyślnej) | prawda | FolderA File1.csv File2.json Podfolder1 File3.csv File4.json File5.csv InnyfolderB File6.csv |

Folder* |

*.csv |

fałsz | FolderA File1.csv File2.json Podfolder1 File3.csv File4.json File5.csv InnyfolderB File6.csv |

Folder* |

*.csv |

prawda | FolderA File1.csv File2.json Podfolder1 File3.csv File4.json File5.csv InnyfolderB File6.csv |

Przykłady listy plików

W tej sekcji opisano wynikowe zachowanie używania ścieżki listy plików w źródle działania kopiowania.

Zakładając, że masz następującą strukturę folderów źródłowych i chcesz skopiować pliki pogrubioną:

| Przykładowa struktura źródła | Zawartość w FileListToCopy.txt | Konfigurowanie |

|---|---|---|

| root FolderA File1.csv File2.json Podfolder1 File3.csv File4.json File5.csv Metadane FileListToCopy.txt |

File1.csv Podfolder1/File3.csv Podfolder1/File5.csv |

W zestawie danych: - Ścieżka folderu: root/FolderAW źródle działania kopiowania: - Ścieżka listy plików: root/Metadata/FileListToCopy.txt Ścieżka listy plików wskazuje plik tekstowy w tym samym magazynie danych, który zawiera listę plików, które chcesz skopiować, jeden plik na wiersz ze ścieżką względną do ścieżki skonfigurowanej w zestawie danych. |

Przykłady zachowania operacji kopiowania

W tej sekcji opisano wynikowe zachowanie operacji kopiowania dla różnych kombinacji recursive wartości i copyBehavior .

| Cykliczne | copyBehavior | Struktura folderu źródłowego | Wynikowy element docelowy |

|---|---|---|---|

| prawda | preserveHierarchy | Folder1 Plik1 Plik2 Podfolder1 Plik3 Plik4 Plik5 |

Folder docelowy1 jest tworzony z taką samą strukturą jak źródło: Folder1 Plik1 Plik2 Podfolder1 Plik3 Plik4 Plik5. |

| prawda | flattenHierarchy | Folder1 Plik1 Plik2 Podfolder1 Plik3 Plik4 Plik5 |

Folder docelowy1 jest tworzony z następującą strukturą: Folder1 automatycznie wygenerowana nazwa pliku File1 automatycznie wygenerowana nazwa dla pliku File2 automatycznie wygenerowana nazwa dla pliku File3 automatycznie wygenerowana nazwa dla pliku File4 automatycznie wygenerowana nazwa dla pliku File5 |

| prawda | mergeFiles | Folder1 Plik1 Plik2 Podfolder1 Plik3 Plik4 Plik5 |

Folder docelowy1 jest tworzony z następującą strukturą: Folder1 Plik1 + Plik2 + Plik3 + Plik4 + Zawartość pliku5 są scalane w jeden plik z automatycznie wygenerowaną nazwą pliku. |

| fałsz | preserveHierarchy | Folder1 Plik1 Plik2 Podfolder1 Plik3 Plik4 Plik5 |

Folder docelowy1 jest tworzony z następującą strukturą: Folder1 Plik1 Plik2 Podfolder1 z plikami File3, File4 i File5 nie są pobierane. |

| fałsz | flattenHierarchy | Folder1 Plik1 Plik2 Podfolder1 Plik3 Plik4 Plik5 |

Folder docelowy1 jest tworzony z następującą strukturą: Folder1 automatycznie wygenerowana nazwa pliku File1 automatycznie wygenerowana nazwa dla pliku File2 Podfolder1 z plikami File3, File4 i File5 nie są pobierane. |

| fałsz | mergeFiles | Folder1 Plik1 Plik2 Podfolder1 Plik3 Plik4 Plik5 |

Folder docelowy1 jest tworzony z następującą strukturą: Folder1 Zawartość file1 + File2 jest scalona z jednym plikiem z automatycznie wygenerowaną nazwą pliku. automatycznie wygenerowana nazwa pliku File1 Podfolder1 z plikami File3, File4 i File5 nie są pobierane. |

Zachowywanie list ACL w usłudze Data Lake Storage Gen2

Napiwek

Aby skopiować dane z usługi Azure Data Lake Storage Gen1 do generacji 2, zobacz Kopiowanie danych z usługi Azure Data Lake Storage Gen1 do generacji 2 , aby zapoznać się z instrukcjami i najlepszymi rozwiązaniami.

Jeśli chcesz replikować listy kontroli dostępu (ACL) wraz z plikami danych podczas uaktualniania z usługi Data Lake Storage Gen1 do usługi Data Lake Storage Gen2, zobacz Zachowywanie list ACL z usługi Data Lake Storage Gen1.

Właściwości przepływu mapowania danych

Podczas przekształcania danych w przepływach mapowania danych można odczytywać i zapisywać pliki z usługi Azure Data Lake Storage Gen1 w następujących formatach:

Ustawienia specyficzne dla formatu znajdują się w dokumentacji dla tego formatu. Aby uzyskać więcej informacji, zobacz Przekształcanie źródła w przepływie mapowania danych i Przekształcanie ujścia w przepływie danych mapowania.

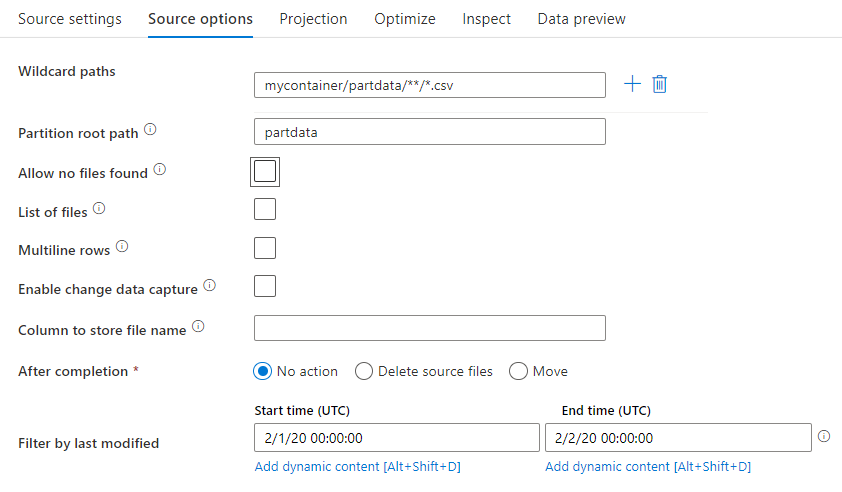

Przekształcanie źródła

W transformacji źródłowej można odczytać z kontenera, folderu lub pojedynczego pliku w usłudze Azure Data Lake Storage Gen1. Karta Opcje źródła umożliwia zarządzanie sposobem odczytu plików.

Ścieżka z symbolami wieloznacznymi: użycie wzorca z symbolami wieloznacznymi spowoduje, że usługa będzie przechodzić w pętli przez każdy pasujący folder i plik w ramach jednej transformacji źródłowej. Jest to skuteczny sposób przetwarzania wielu plików w ramach jednego przepływu. Dodaj wiele wzorców dopasowania symboli wieloznacznych za pomocą znaku + wyświetlanego podczas umieszczania wskaźnika myszy na istniejącym wzorcu wieloznacznymi.

W kontenerze źródłowym wybierz serię plików pasujących do wzorca. W zestawie danych można określić tylko kontener. W związku z tym ścieżka wieloznaczny musi zawierać również ścieżkę folderu z folderu głównego.

Przykłady symboli wieloznacznych:

*Reprezentuje dowolny zestaw znaków**Reprezentuje zagnieżdżanie katalogów cyklicznych?Zamienia jeden znak[]Pasuje do jednego z więcej znaków w nawiasach kwadratowych/data/sales/**/*.csvPobiera wszystkie pliki CSV w obszarze /data/sales/data/sales/20??/**/Pobiera wszystkie pliki cyklicznie we wszystkich pasujących folderach 20xx/data/sales/*/*/*.csvPobiera pliki CSV na dwóch poziomach w obszarze /data/sales/data/sales/2004/12/[XY]1?.csvPobiera wszystkie pliki CSV z grudnia 2004 r. począwszy od X lub Y, a następnie 1 i dowolny pojedynczy znak

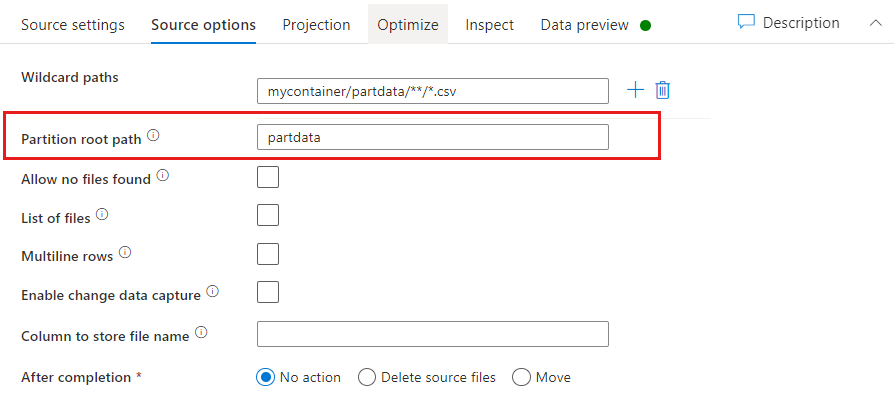

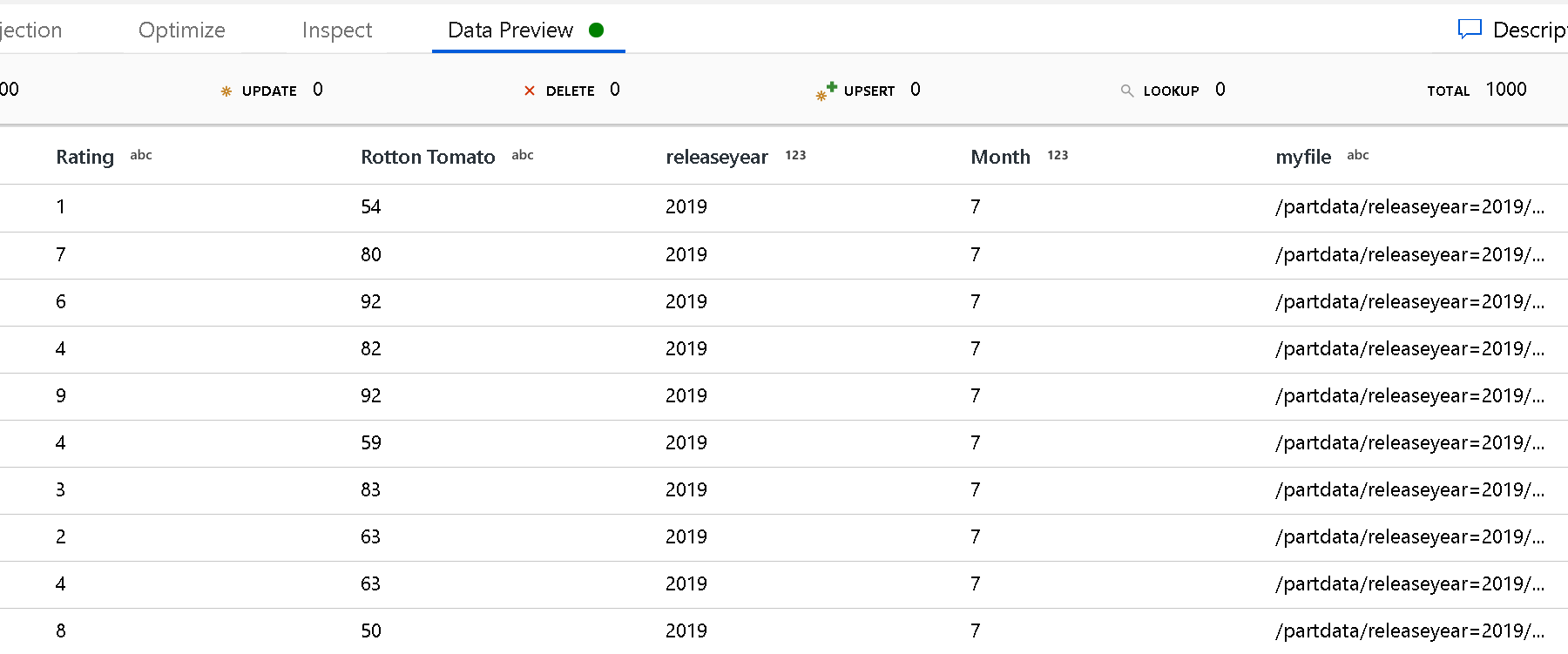

Ścieżka główna partycji: jeśli foldery partycjonowane w źródle key=value pliku mają format (na przykład year=2019), możesz przypisać najwyższy poziom drzewa folderów partycji do nazwy kolumny w strumieniu danych przepływu danych.

Najpierw ustaw symbol wieloznaczny, aby zawierał wszystkie ścieżki, które są folderami podzielonymi na partycje oraz plikami liścia, które chcesz odczytać.

Użyj ustawienia Ścieżka główna partycji, aby zdefiniować, jaki jest najwyższy poziom struktury folderów. Po wyświetleniu zawartości danych za pośrednictwem podglądu danych zobaczysz, że usługa dodaje rozpoznane partycje znalezione na każdym poziomie folderu.

Lista plików: jest to zestaw plików. Utwórz plik tekstowy zawierający listę plików ścieżki względnej do przetworzenia. Wskaż ten plik tekstowy.

Kolumna do przechowywania nazwy pliku: zapisz nazwę pliku źródłowego w kolumnie w danych. Wprowadź tutaj nową nazwę kolumny, aby zapisać ciąg nazwy pliku.

Po zakończeniu: wybierz opcję wykonania niczego z plikiem źródłowym po uruchomieniu przepływu danych, usunięciu pliku źródłowego lub przeniesieniu pliku źródłowego. Ścieżki przenoszenia są względne.

Aby przenieść pliki źródłowe do innej lokalizacji po przetworzeniu, najpierw wybierz pozycję "Przenieś" dla operacji na plikach. Następnie ustaw katalog "from". Jeśli nie używasz żadnych symboli wieloznacznych dla ścieżki, ustawienie "from" jest tym samym folderem co folder źródłowy.

Jeśli masz ścieżkę źródłową z symbolem wieloznacznymi, składnia wygląda następująco:

/data/sales/20??/**/*.csv

Możesz określić wartość "from" jako

/data/sales

I "do" jako

/backup/priorSales

W takim przypadku wszystkie pliki, które zostały pozyskane w obszarze /data/sales, są przenoszone do /backup/priorSales.

Uwaga

Operacje na plikach są uruchamiane tylko po uruchomieniu przepływu danych z uruchomienia potoku (przebiegu debugowania lub wykonywania potoku), które używa działania Wykonaj Przepływ danych w potoku. Operacje na plikach nie są uruchamiane w trybie debugowania Przepływ danych.

Filtruj według ostatniej modyfikacji: możesz filtrować, które pliki są przetwarzane, określając zakres dat ostatniej modyfikacji. Wszystkie daty i godziny są w formacie UTC.

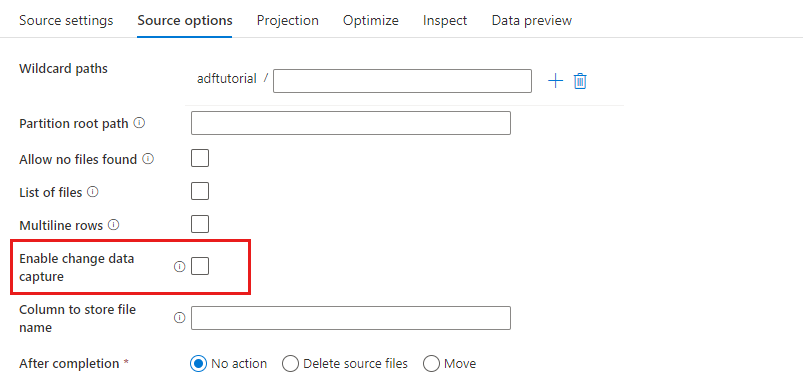

Włącz przechwytywanie zmian danych: jeśli wartość true, uzyskasz nowe lub zmienione pliki tylko z ostatniego uruchomienia. Początkowe ładowanie pełnych danych migawki będzie zawsze uzyskiwane w pierwszym uruchomieniu, a następnie przechwytywanie nowych lub zmienionych plików tylko w następnych uruchomieniach. Aby uzyskać więcej informacji, zobacz Zmienianie przechwytywania danych.

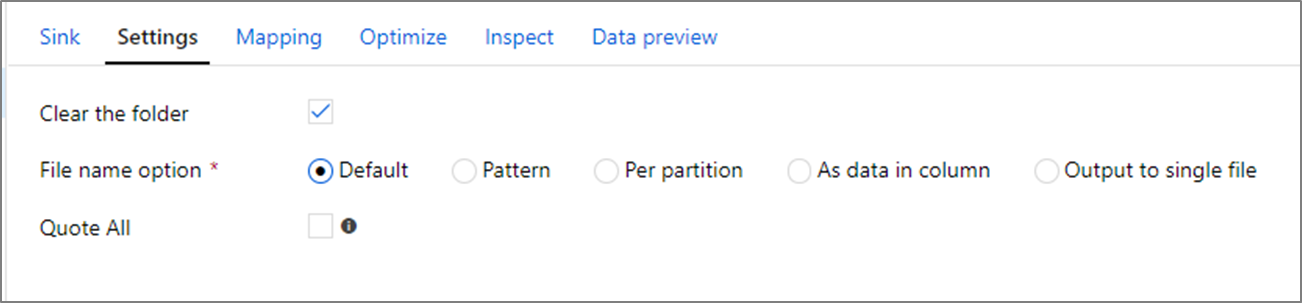

Właściwości ujścia

W transformacji ujścia można zapisać w kontenerze lub folderze w usłudze Azure Data Lake Storage Gen1. Karta Ustawienia umożliwia zarządzanie sposobem zapisywania plików.

Wyczyść folder: określa, czy folder docelowy zostanie wyczyszczone przed zapisem danych.

Opcja nazwy pliku: określa, w jaki sposób pliki docelowe są nazwane w folderze docelowym. Opcje nazwy pliku to:

- Ustawienie domyślne: Zezwalaj platformie Spark na nadawanie nazw plikom na podstawie wartości domyślnych PART.

- Wzorzec: wprowadź wzorzec wyliczający pliki wyjściowe na partycję. Na przykład pożyczki[n].csv tworzy loans1.csv, loans2.csv itd.

- Na partycję: wprowadź jedną nazwę pliku na partycję.

- Jako dane w kolumnie: ustaw plik wyjściowy na wartość kolumny. Ścieżka jest względna względem kontenera zestawu danych, a nie folderu docelowego. Jeśli masz ścieżkę folderu w zestawie danych, zostanie ona zastąpiona.

- Dane wyjściowe do pojedynczego pliku: połącz partycjonowane pliki wyjściowe w jeden nazwany plik. Ścieżka jest względna względem folderu zestawu danych. Należy pamiętać, że operacja scalania może zakończyć się niepowodzeniem na podstawie rozmiaru węzła. Ta opcja nie jest zalecana w przypadku dużych zestawów danych.

Cudzysłowy: określa, czy należy ująć wszystkie wartości w cudzysłowie

Właściwości działania wyszukiwania

Aby dowiedzieć się więcej o właściwościach, sprawdź działanie Wyszukiwania.

Właściwości działania GetMetadata

Aby dowiedzieć się więcej o właściwościach, sprawdź działanie GetMetadata

Usuń właściwości działania

Aby dowiedzieć się więcej o właściwościach, zobacz Działanie Usuwania

Starsze modele

Uwaga

Następujące modele są nadal obsługiwane zgodnie ze zgodnością z poprzednimi wersjami. Zalecamy użycie nowego modelu wymienionego w powyższych sekcjach, a interfejs użytkownika tworzenia przeszedł do generowania nowego modelu.

Starszy model zestawu danych

| Właściwości | Opis | Wymagania |

|---|---|---|

| type | Właściwość type zestawu danych musi być ustawiona na Wartość AzureDataLakeStoreFile. | Tak |

| folderPath | Ścieżka do folderu w usłudze Data Lake Store. Jeśli nie zostanie określony, wskazuje on katalog główny. Obsługiwany jest filtr wieloznaczny. Dozwolone symbole wieloznaczne to * (dopasowywały zero lub więcej znaków) i ? (dopasowywały zero lub pojedynczy znak). Użyj ^ polecenia , aby uniknąć, jeśli rzeczywista nazwa folderu ma symbol wieloznaczny lub znak ucieczki wewnątrz. Na przykład: folder główny/podfolder/. Zobacz więcej przykładów w przykładach filtru folderów i plików. |

Nie. |

| fileName | Nazwa lub filtr symboli wieloznacznych dla plików w ramach określonego "folderPath". Jeśli nie określisz wartości dla tej właściwości, zestaw danych wskazuje wszystkie pliki w folderze. W przypadku filtru dozwolone symbole wieloznaczne są * (dopasowywały zero lub więcej znaków) i ? (dopasowywały zero lub pojedynczy znak).- Przykład 1: "fileName": "*.csv"— Przykład 2: "fileName": "???20180427.txt"Użyj ^ polecenia , aby uniknąć, jeśli rzeczywista nazwa pliku ma symbol wieloznaczny lub znak ucieczki wewnątrz.Jeśli parametr fileName nie jest określony dla wyjściowego zestawu danych i parametr preserveHierarchy nie jest określony w ujściu działania działania kopiowania, działanie kopiowania automatycznie generuje nazwę pliku z następującym wzorcem: "Dane.[ identyfikator GUID przebiegu działania]. [IDENTYFIKATOR GUID, jeśli FlattenHierarchy]. [format, jeśli został skonfigurowany]. [kompresja, jeśli skonfigurowano]", na przykład "Data.0a405f8a-93ff-4c6f-b3be-f69616f1df7a.txt.gz". Jeśli kopiujesz ze źródła tabelarycznego przy użyciu nazwy tabeli zamiast zapytania, wzorzec nazwy to "[nazwa tabeli].[ format]. [kompresja, jeśli została skonfigurowana]", na przykład "MyTable.csv". |

Nie. |

| modifiedDatetimeStart | Filtr plików na podstawie atrybutu Ostatnia modyfikacja. Pliki są wybierane, jeśli ich czas ostatniej modyfikacji jest większy lub równy modifiedDatetimeStart i mniejszy niż modifiedDatetimeEnd. Czas jest stosowany do strefy czasowej UTC w formacie "2018-12-01T05:00:00Z". Ogólna wydajność przenoszenia danych ma wpływ na włączenie tego ustawienia, gdy chcesz filtrować pliki z ogromnymi ilościami plików. Właściwości mogą mieć wartość NULL, co oznacza, że do zestawu danych nie jest stosowany filtr atrybutu pliku. Jeśli modifiedDatetimeStart ma wartość typu data/godzina, ale modifiedDatetimeEnd ma wartość NULL, oznacza to, że wybrano pliki, których ostatnio zmodyfikowany atrybut jest większy lub równy wartości daty/godziny. Jeśli modifiedDatetimeEnd ma wartość data/godzina, ale modifiedDatetimeStart ma wartość NULL, oznacza to, że pliki, których ostatnio zmodyfikowany atrybut jest mniejszy niż wartość daty/godziny, są zaznaczone. |

Nie. |

| modifiedDatetimeEnd | Filtr plików na podstawie atrybutu Ostatnia modyfikacja. Pliki są wybierane, jeśli ich czas ostatniej modyfikacji jest większy lub równy modifiedDatetimeStart i mniejszy niż modifiedDatetimeEnd. Czas jest stosowany do strefy czasowej UTC w formacie "2018-12-01T05:00:00Z". Ogólna wydajność przenoszenia danych ma wpływ na włączenie tego ustawienia, gdy chcesz filtrować pliki z ogromnymi ilościami plików. Właściwości mogą mieć wartość NULL, co oznacza, że do zestawu danych nie jest stosowany filtr atrybutu pliku. Jeśli modifiedDatetimeStart ma wartość typu data/godzina, ale modifiedDatetimeEnd ma wartość NULL, oznacza to, że wybrano pliki, których ostatnio zmodyfikowany atrybut jest większy lub równy wartości daty/godziny. Jeśli modifiedDatetimeEnd ma wartość data/godzina, ale modifiedDatetimeStart ma wartość NULL, oznacza to, że pliki, których ostatnio zmodyfikowany atrybut jest mniejszy niż wartość daty/godziny, są zaznaczone. |

Nie. |

| format | Jeśli chcesz skopiować pliki w postaci między magazynami opartymi na plikach (kopiowanie binarne), pomiń sekcję formatowania zarówno w definicjach wejściowych, jak i wyjściowych zestawu danych. Jeśli chcesz przeanalizować lub wygenerować pliki w określonym formacie, obsługiwane są następujące typy formatów plików: TextFormat, JsonFormat, AvroFormat, OrcFormat i ParquetFormat. Ustaw właściwość type w formacie na jedną z tych wartości. Aby uzyskać więcej informacji, zobacz sekcje Format tekstu, Format JSON, Format Avro, Format Orc i Parquet. |

Nie (tylko w scenariuszu kopiowania binarnego) |

| kompresja | Określ typ i poziom kompresji danych. Aby uzyskać więcej informacji, zobacz Obsługiwane formaty plików i koderów kompresji. Obsługiwane typy to GZip, Deflate, BZip2 i ZipDeflate. Obsługiwane poziomy są optymalne i najszybsze. |

Nie. |

Napiwek

Aby skopiować wszystkie pliki w folderze, określ tylko folderPath .

Aby skopiować pojedynczy plik o określonej nazwie, określ folderPath ze częścią folderu i fileName nazwą pliku.

Aby skopiować podzbiór plików w folderze, określ folderPath ze częścią folderu i fileName z filtrem wieloznacznymi.

Przykład:

{

"name": "ADLSDataset",

"properties": {

"type": "AzureDataLakeStoreFile",

"linkedServiceName":{

"referenceName": "<ADLS linked service name>",

"type": "LinkedServiceReference"

},

"typeProperties": {

"folderPath": "datalake/myfolder/",

"fileName": "*",

"modifiedDatetimeStart": "2018-12-01T05:00:00Z",

"modifiedDatetimeEnd": "2018-12-01T06:00:00Z",

"format": {

"type": "TextFormat",

"columnDelimiter": ",",

"rowDelimiter": "\n"

},

"compression": {

"type": "GZip",

"level": "Optimal"

}

}

}

}

Starszy model źródła działania kopiowania

| Właściwości | Opis | Wymagania |

|---|---|---|

| type | Właściwość type źródła działania kopiowania musi być ustawiona na Wartość AzureDataLakeStoreSource. |

Tak |

| Cykliczne | Wskazuje, czy dane są odczytywane rekursywnie z podfolderów, czy tylko z określonego folderu. Gdy recursive jest ustawiona wartość true, a ujście jest magazynem opartym na plikach, pusty folder lub podfolder nie jest kopiowany ani tworzony w ujściu. Dozwolone wartości to true (wartość domyślna) i false. |

Nie. |

| maxConcurrentConnections | Górny limit połączeń współbieżnych ustanowionych z magazynem danych podczas uruchamiania działania. Określ wartość tylko wtedy, gdy chcesz ograniczyć połączenia współbieżne. | Nie. |

Przykład:

"activities":[

{

"name": "CopyFromADLSGen1",

"type": "Copy",

"inputs": [

{

"referenceName": "<ADLS Gen1 input dataset name>",

"type": "DatasetReference"

}

],

"outputs": [

{

"referenceName": "<output dataset name>",

"type": "DatasetReference"

}

],

"typeProperties": {

"source": {

"type": "AzureDataLakeStoreSource",

"recursive": true

},

"sink": {

"type": "<sink type>"

}

}

}

]

Starszy model ujścia działania kopiowania

| Właściwości | Opis | Wymagania |

|---|---|---|

| type | Właściwość type ujścia działania kopiowania musi być ustawiona na Wartość AzureDataLakeStoreSink. |

Tak |

| copyBehavior | Definiuje zachowanie kopiowania, gdy źródłem są pliki z magazynu danych opartego na plikach. Dozwolone wartości to: - PreserveHierarchy (wartość domyślna): Zachowuje hierarchię plików w folderze docelowym. Ścieżka względna pliku źródłowego do folderu źródłowego jest identyczna ze ścieżką względną pliku docelowego do folderu docelowego. - FlattenHierarchy: Wszystkie pliki z folderu źródłowego znajdują się na pierwszym poziomie folderu docelowego. Pliki docelowe mają automatycznie wygenerowane nazwy. - MergeFiles: Scala wszystkie pliki z folderu źródłowego do jednego pliku. Jeśli określono nazwę pliku, scalona nazwa pliku jest określoną nazwą. W przeciwnym razie nazwa pliku jest generowana automatycznie. |

Nie. |

| maxConcurrentConnections | Górny limit połączeń współbieżnych ustanowionych z magazynem danych podczas uruchamiania działania. Określ wartość tylko wtedy, gdy chcesz ograniczyć połączenia współbieżne. | Nie. |

Przykład:

"activities":[

{

"name": "CopyToADLSGen1",

"type": "Copy",

"inputs": [

{

"referenceName": "<input dataset name>",

"type": "DatasetReference"

}

],

"outputs": [

{

"referenceName": "<ADLS Gen1 output dataset name>",

"type": "DatasetReference"

}

],

"typeProperties": {

"source": {

"type": "<source type>"

},

"sink": {

"type": "AzureDataLakeStoreSink",

"copyBehavior": "PreserveHierarchy"

}

}

}

]

Przechwytywanie zmian danych (wersja zapoznawcza)

Usługa Azure Data Factory może pobierać nowe lub zmienione pliki tylko z usługi Azure Data Lake Storage Gen1, włączając opcję Włącz przechwytywanie danych zmian (wersja zapoznawcza) w przekształceniu źródła przepływu danych mapowania. Dzięki tej opcji łącznika można odczytywać tylko nowe lub zaktualizowane pliki i stosować przekształcenia przed załadowaniem przekształconych danych do docelowych zestawów danych.

Upewnij się, że nazwa potoku i działania pozostaje niezmieniona, aby zawsze można było rejestrować punkt kontrolny z ostatniego uruchomienia w celu pobrania zmian z tego miejsca. Jeśli zmienisz nazwę potoku lub nazwę działania, punkt kontrolny zostanie zresetowany i rozpoczniesz od początku w następnym uruchomieniu.

Podczas debugowania potoku działa również opcja Włącz przechwytywanie danych zmian (wersja zapoznawcza). Punkt kontrolny jest resetowany podczas odświeżania przeglądarki podczas uruchamiania debugowania. Po zadowoleniu z wyniku przebiegu debugowania możesz opublikować i wyzwolić potok. Zawsze zaczyna się od początku niezależnie od poprzedniego punktu kontrolnego zarejestrowanego przez przebieg debugowania.

W sekcji monitorowania zawsze masz możliwość ponownego uruchomienia potoku. W ten sposób zmiany są zawsze wprowadzane z rekordu punktu kontrolnego w wybranym przebiegu potoku.

Powiązana zawartość

Aby uzyskać listę magazynów danych obsługiwanych jako źródła i ujścia działania kopiowania, zobacz obsługiwane magazyny danych.